أحدث الذكاء الاصطناعي ثورةً في العديد من الصناعات، ومن أبرز تطبيقاته توليد الصور. من ابتكار وجوه بشرية واقعية إلى إنتاج أعمال فنية سريالية، فتحت القدرة على توليد الصور بالذكاء الاصطناعي آفاقًا جديدة في الفن والتصميم والتكنولوجيا. تتناول هذه المقالة آليات توليد الصور بالذكاء الاصطناعي، والنماذج التي تُشغّلها، والآثار الأوسع لهذه التقنية.

فهم الأساسيات: كيف يعمل توليد الصور بالذكاء الاصطناعي؟

ما هي النماذج التوليدية؟

النماذج التوليدية هي فئة من خوارزميات الذكاء الاصطناعي التي تُمكّن من إنشاء نماذج بيانات جديدة تُشبه بيانات التدريب. في سياق توليد الصور، تتعلّم هذه النماذج أنماطًا من الصور الموجودة وتستخدم هذه المعرفة لإنتاج صور جديدة مُشابهة.

دور الشبكات العصبية

تُعدّ الشبكات العصبية، وخاصةً نماذج التعلم العميق مثل الشبكات العصبية التلافيفية (CNNs)، جوهرَ توليد الصور بالذكاء الاصطناعي. صُممت هذه الشبكات لمعالجة البيانات باستخدام بنية شبكية، مما يجعلها مثاليةً لتحليل الصور وتوليدها. تعمل هذه الشبكات من خلال اكتشاف أنماط مثل الحواف والقوام والأشكال، وهي ضرورية لفهم الصور وإعادة إنشائها.

نماذج الذكاء الاصطناعي الرئيسية في توليد صور الذكاء الاصطناعي

شبكات الخصومة التوليدية (GANs)

قدّم إيان جودفيلو شبكات GAN عام ٢٠١٤، وهي تتكون من شبكتين عصبيتين: مُولّد ومُميّز. يُنشئ المُولّد صورًا، بينما يُقيّم المُميّز هذه الصور بمقارنتها بصور حقيقية. ومن خلال هذه العملية التنافسية، يُحسّن المُولّد مخرجاته لإنتاج صور أكثر واقعية.

ستايل

طورت شركة NVIDIA تقنية StyleGAN، وهي نسخة من تقنية GAN معروفة بتوليد وجوه بشرية عالية الجودة. تقدم هذه التقنية بنية مولد تعتمد على الأنماط، مما يسمح بالتحكم في مستويات مختلفة من التفاصيل في الصورة. حسّنت StyleGAN2 وStyleGAN3 جودة الصورة بشكل أكبر، وعالجت مشاكل مثل التصاق الملمس.

نماذج الانتشار

تُولّد نماذج الانتشار صورًا بالبدء بضوضاء عشوائية، ثم تحسينها تدريجيًا لتُطابق النتيجة المطلوبة. وقد اكتسبت هذه النماذج شعبيةً واسعةً بفضل قدرتها على إنتاج صور عالية الجودة ومرونتها في تطبيقات مُختلفة.

انتشار مستقر

الانتشار المستقر هو نموذج انتشار مفتوح المصدر يُمكّن من توليد النصوص إلى الصور. كما يُمكنه إجراء التلوين الداخلي والخارجي، مما يسمح بتحرير الصور وتوسيعها. وقد جعله مفتوح المصدر متاحًا على نطاق واسع للمطورين والفنانين.

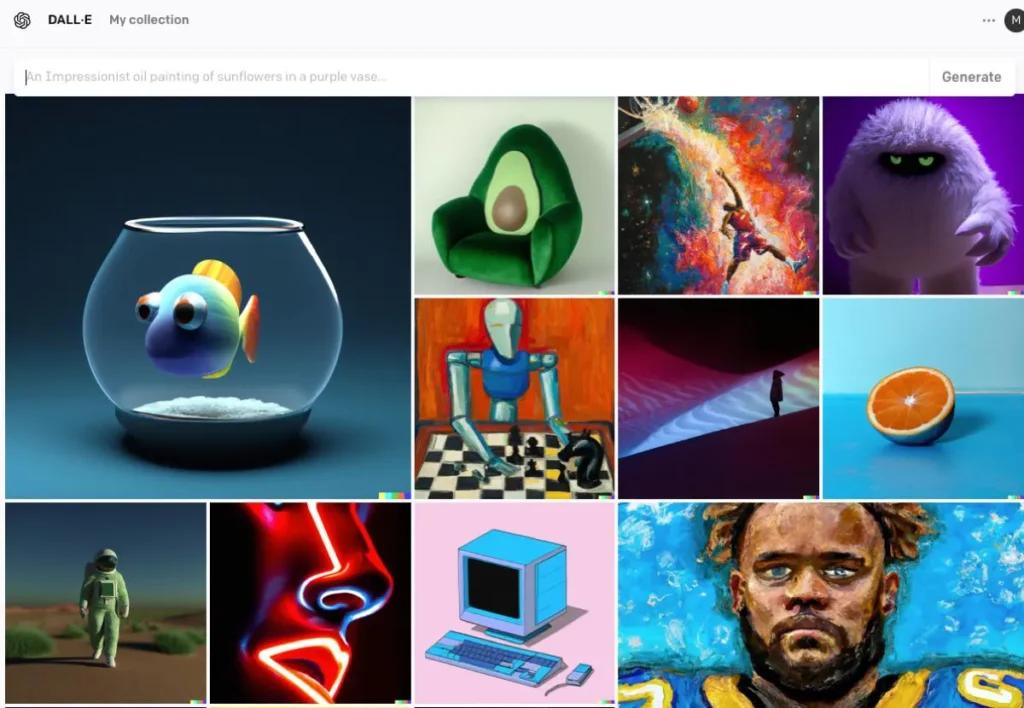

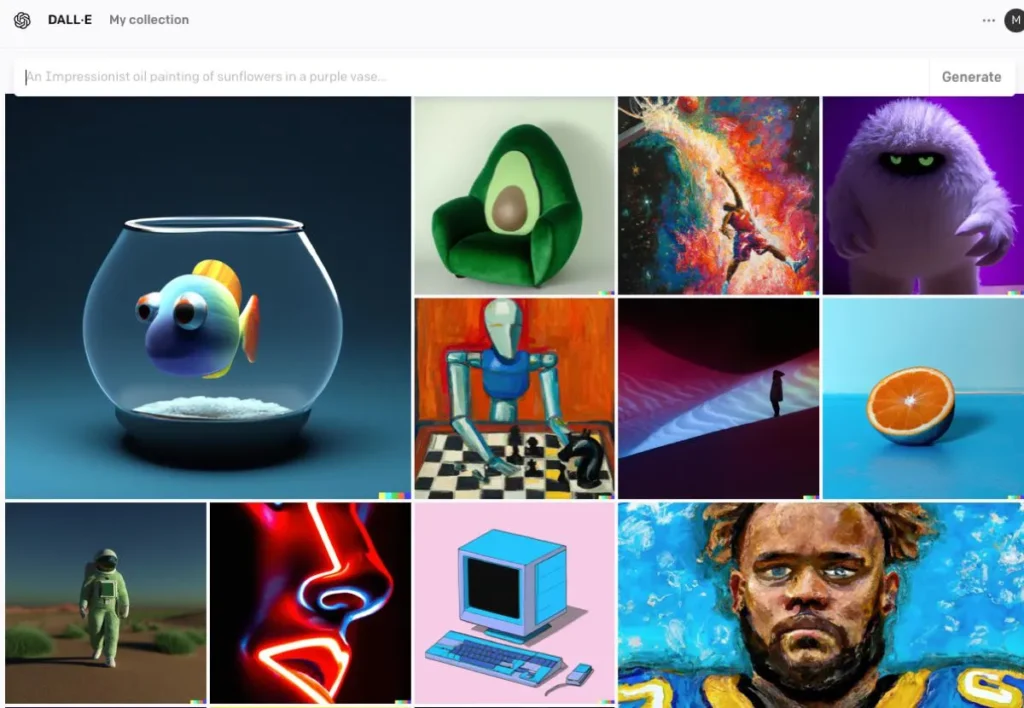

DALL · E

DALL·E، الذي طورته شركة OpenAI، هو نموذج قائم على محوّل قادر على توليد صور من أوصاف نصية. حسّن DALL·E 2 وDALL·E 3 النموذج الأصلي، موفرين دقة أعلى ومحاذاة أكثر دقة للصور والنصوص. DALL·E 3 مدمج في ChatGPT لتحسين تفاعل المستخدم.

عملية توليد الصور بالذكاء الاصطناعي

تدريب النموذج

تتطلب نماذج الذكاء الاصطناعي تدريبًا مكثفًا على مجموعات بيانات ضخمة من الصور. أثناء التدريب، يتعلم النموذج التعرف على الأنماط والخصائص داخل الصور، مما يُمكّنه من إنشاء صور جديدة تُحاكي بيانات التدريب.

إنشاء صور جديدة

بمجرد تدريب النموذج، يمكنه إنشاء صور جديدة من خلال:

- استقبال المدخلات:يمكن أن يكون هذا ضوضاء عشوائية (في شبكات GAN)، أو مطالبة نصية (في DALL·E)، أو صورة موجودة (للتحرير). تلتقط هذه الخطوة المعنى الدلالي للنص، مما يتيح للذكاء الاصطناعي فهم المحتوى والسياق.

- معالجة المدخلاتيعالج النموذج المُدخلات عبر طبقات شبكته العصبية، مُطبّقًا الأنماط والخصائص المُكتسبة. باستخدام النص المُرمّز، يستخدم الذكاء الاصطناعي نماذج مثل الشبكات التوليدية التنافسية (GANs) أو نماذج الانتشار لإنشاء الصور. تُولّد هذه النماذج الصور بالبدء بضوضاء عشوائية وتنقيحها لتتوافق مع الوصف النصي.

- الصقل والتقييم:تُحسّن الصورة المُولّدة باستخدام آليات الانتباه لضمان اتساقها مع النص. يُقيّم نموذج التمييز واقعية الصورة وتناسقها مع المُدخلات، مُقدّمًا تغذية راجعة لمزيد من التحسين.

- إخراج الصورة:النتيجة النهائية هي صورة جديدة تعكس خصائص بيانات التدريب والمدخلات المحددة المقدمة.

مثال على رمز توليد الصور بالذكاء الاصطناعي

فيما يلي أمثلة عملية لأكواد Python توضح كيفية إنشاء الصور باستخدام ثلاثة نماذج ذكاء اصطناعي بارزة: الشبكات التنافسية التوليدية (GANs)، والانتشار المستقر، وDALL·E.

الشبكات التنافسية التوليدية (GANs) مع PyTorch

تتكون الشبكات التوليدية التنافسية (GANs) من شبكتين عصبيتين - المولد والمميز - تتنافسان لتوليد نماذج بيانات جديدة وواقعية. إليك مثال مبسط باستخدام PyTorch لتوليد الصور:

pythonimport torch

import torch.nn as nn

# Define the Generator network

class Generator(nn.Module):

def __init__(self):

super(Generator, self).__init__()

self.fc1 = nn.Linear(100, 128)

self.fc2 = nn.Linear(128, 784) # Assuming output image size is 28x28

def forward(self, x):

x = torch.relu(self.fc1(x))

x = torch.tanh(self.fc2(x))

return x

# Instantiate the generator

generator = Generator()

# Generate a random noise vector

noise = torch.randn(1, 100)

# Generate an image

generated_image = generator(noise)

يُعرّف هذا الكود شبكة مولدات بسيطة تأخذ مُتجه ضوضاء ذي 100 بُعد كمُدخل وتُنتج مُخرجًا ذي 784 بُعدًا، والذي يُمكن إعادة تشكيله إلى صورة 28×28. tanh تضمن دالة التنشيط أن تكون قيم الإخراج ضمن النطاق ، وهو أمر شائع لبيانات الصورة.

انتشار مستقر مع موزعات الوجه المعانقة

الانتشار المستقر هو نموذج قوي لتحويل النص إلى صورة، يُولّد صورًا بناءً على أوصاف نصية. الوجه المعانق diffusers توفر المكتبة واجهة سهلة لاستخدام هذا النموذج:

pythonfrom diffusers import StableDiffusionPipeline

import torch

# Load the pre-trained Stable Diffusion model

pipe = StableDiffusionPipeline.from_pretrained("CompVis/stable-diffusion-v1-4")

pipe = pipe.to("cuda") # Move the model to GPU for faster inference

# Generate an image from a text prompt

prompt = "A serene landscape with mountains and a river"

image = pipe(prompt).images

# Save the generated image

image.save("generated_image.png")

يُحمّل هذا البرنامج النصي نموذج الانتشار المستقر ويُولّد صورةً بناءً على الطلب المُقدّم. تأكد من تثبيت التبعيات اللازمة ووحدة معالجة الرسومات المتوافقة لتحقيق الأداء الأمثل.

DALL·E مع واجهة برمجة تطبيقات OpenAI

DALL·E هو نموذج آخر لتحويل النص إلى صورة من تطوير OpenAI. يمكنك التفاعل معه باستخدام واجهة برمجة تطبيقات OpenAI:

pythonimport openai

import requests

from PIL import Image

from io import BytesIO

# Set your OpenAI API key

openai.api_key = "your-api-key"

# Generate an image using DALL·E

response = openai.Image.create(

prompt="A futuristic cityscape at sunset",

n=1,

size="512x512"

)

# Get the URL of the generated image

image_url = response

# Download and display the image

image_response = requests.get(image_url)

image = Image.open(BytesIO(image_response.content))

image.save("dalle_generated_image.png")

استبدل "your-api-key" باستخدام مفتاح OpenAI API الفعلي. يُرسل هذا البرنامج النصي رسالة إلى نموذج DALL·E ويسترجع الصورة المُولّدة. ثم تُحفظ الصورة محليًا.

يتكامل CometAPI أيضًا دال-E 3 API، يمكنك أيضًا استخدام مفتاح CometAPI للوصول دال-E 3 API، وهو أكثر ملاءمة وأسرع من OpenAI.

لمزيد من المعلومات حول النموذج في Comet API، يرجى الاطلاع على وثيقة API.

تُوفر هذه الأمثلة نقطة انطلاق لإنشاء صور باستخدام نماذج ذكاء اصطناعي مختلفة. لكل نموذج إمكانياته ومتطلباته الخاصة، لذا اختر النموذج الأنسب لاحتياجات مشروعك.

الخاتمة

يُمثل توليد الصور بالذكاء الاصطناعي نقطة التقاء بين التكنولوجيا والإبداع، مُتيحًا إمكانيات غير مسبوقة في إنشاء المحتوى المرئي. يُعد فهم كيفية توليد الذكاء الاصطناعي للصور، والنماذج المستخدمة، وتداعيات هذه التقنية أمرًا بالغ الأهمية في سعينا لدمجها في مختلف جوانب المجتمع.

الوصول إلى واجهة برمجة تطبيقات الصور AI في CometAPI

يوفر CometAPI إمكانية الوصول إلى أكثر من 500 نموذج ذكاء اصطناعي، بما في ذلك نماذج مفتوحة المصدر ومتعددة الوسائط متخصصة للدردشة والصور والبرمجة وغيرها. تكمن قوته الأساسية في تبسيط عملية دمج الذكاء الاصطناعي المعقدة تقليديًا. بفضله، يمكنك الوصول إلى أدوات الذكاء الاصطناعي الرائدة مثل Claude وOpenAI وDeepseek وGemini من خلال اشتراك واحد موحد. يمكنك استخدام واجهة برمجة التطبيقات في CometAPI لإنشاء الموسيقى والأعمال الفنية، وإنشاء مقاطع الفيديو، وبناء سير عملك الخاصة.

كوميت ايه بي اي عرض سعر أقل بكثير من السعر الرسمي لمساعدتك على التكامل واجهة برمجة تطبيقات GPT-4o ,منتصف الرحلة API واجهة برمجة تطبيقات الانتشار المستقرة (واجهة برمجة تطبيقات Stable Diffusion XL 1.0) و Flux API(FLUX.1 API إلخ)، وستحصل على 1 دولار في حسابك بعد التسجيل وتسجيل الدخول!

يدمج CometAPI أحدث واجهة برمجة تطبيقات GPT-4o-image .