أعلنت DeepSeek رسميًا عن معاينة V4 كعائلة نماذج مفتوحة المصدر، والعنوان هنا ليس مجرد "تحديث نموذج آخر". تضع الشركة V4 كنظام طويل السياق وملائم للوكلاء، ومبني لأعباء عمل واقعية: تحليل كثيف المستندات، مساعدين للبرمجة، وكلاء بحث، وأتمتة متعددة الخطوات. الإصدار متاح الآن على الويب، والتطبيق، وواجهة API، وتقدم سلسلة V4 نافذة سياق اقتصادية بطول 1M رمز عبر خدماتها الرسمية.

ما يجعل هذا الإطلاق لافتًا بشكل خاص هو الجمع بين الحجم والكفاءة. تقول DeepSeek إن V4‑Pro يحوي 1.6T من المعاملات الإجمالية مع 49B نشطة، بينما V4‑Flash يحوي 284B من المعاملات الإجمالية مع 13B نشطة. وفي التقرير التقني، تزعم DeepSeek أن بنية V4 تستخدم انتباهًا هجينًا، وتوجيه MoE، وتدريبًا لاحقًا صُمم لتحسين السلوك الوكيلي مع تقليص عبء الحوسبة لسياقات فائقة الطول.

ما هو DeepSeek V4؟

DeepSeek‑V4 هي أحدث عائلة رائدة في وضع المعاينة لدى الشركة، ويشمل الإصدار متغيرين عامّين: V4‑Pro وV4‑Flash. تصف DeepSeek V4‑Pro بأنه النموذج الأقوى في معرفة العالم والرياضيات وعلوم STEM والبرمجة والترميز الوكيلي، بينما V4‑Flash هو الخيار الأكثر تجاوبًا وكفاءةً من حيث التكلفة مع احتفاظ كبير بجودة الاستدلال والقدرة على السياق الطويل. يتصدر V4‑Pro النماذج المفتوحة الحالية في الترميز الوكيلي ومعرفة العالم، فيما صُمم V4‑Flash للسرعة والنشر الاقتصادي.

يستخدم V4 بنية انتباه هجينة تجمع بين انتباه متفرق مضغوط (CSA) وانتباه مضغوط بدرجة كبيرة (HCA)، إضافة إلى وصلات فائقة مقيّدة بمتعدد الشعب ومُحسّن Muon. وتقول الشركة أيضًا إن النماذج درِّبت مسبقًا على أكثر من 32T رمزًا، وأنه عند سياق 1M يحتاج V4‑Pro إلى 27% فقط من عمليات FLOPs للاستدلال لكل رمز واحد و10% من ذاكرة KV المؤقتة مقارنةً بـ DeepSeek‑V3.2. قصة الكفاءة هي العنوان الحقيقي وراء هذا الإصدار.

DeepSeek‑V4‑Pro مقابل DeepSeek‑V4‑Flash

DeepSeek‑V4‑Pro

V4‑Pro هو النموذج الرائد للمستخدمين الذين يهمهم الجودة قبل كل شيء. يقدم DeepSeek‑V4‑Pro أداءً أقوى في الترميز الوكيلي، ومعرفةً أغزر بالعالم، واستدلالًا على مستوى عالمي، ويقود النماذج المفتوحة الحالية بينما يتأخر فقط عن Gemini‑3.1‑Pro في معرفة العالم وفق صفحة الإطلاق. في التقرير التقني، يعد V4‑Pro النموذج الأكبر في العائلة، ويتاح DeepSeek‑V4‑Pro عبر الواجهات المتوافقة مع OpenAI وAnthropic نفسها مثل V4‑Flash.

DeepSeek‑V4‑Flash

V4‑Flash هو نموذج يضع الكفاءة أولًا؛ قدراته في الاستدلال تقترب كثيرًا من V4‑Pro، ويؤدي على قدم المساواة مع V4‑Pro في المهام الوكيلية البسيطة، مع استخدام بصمة معاملات أصغر وأزمنة استجابة أسرع. يدعم وضعي التفكير وغير التفكير، وبالطول نفسه للسياق (1M) والميزات الأساسية ذاتها مثل Pro، ولكن بتكلفة أقل بكثير.

أيهما تختار؟

استخدم V4‑Pro عندما تكون المهمة عالية المخاطر، كثيفة المعرفة، أو يصعب التحقق منها: أبحاث المؤسسات، برمجة معقدة، دعم قرارات متعددة الخطوات، أو مهام تريد فيها أقوى إجابة ممكنة. استخدم V4‑Flash عندما يهمك معدل المرور أو زمن الاستجابة أو تكلفة الرموز أكثر من اقتناص آخر نقاط الأداء في المقاييس. هذا الاختيار يتسق مع التموضع الرسمي والفروقات المبلغ عنها في المقاييس بين النموذجين.

| البند | DeepSeek‑V4‑Flash | DeepSeek‑V4‑Pro |

|---|---|---|

| إجمالي المعاملات | 284B | 1.6T |

| المعاملات النشطة | 13B | 49B |

| طول السياق | 1M | 1M |

| أوضاع الاستدلال | Non‑think + think | Non‑think + think |

| أفضل ملاءمة | استدلال سريع، تطبيقات عالية المرور، وكلاء حسّاسة للتكلفة | أقصى قدرات الاستدلال، مهام برمجة ومعرفة أصعب |

| تسعير الـ API الرسمي | Cache hit $0.028 / cache miss $0.14 / output $0.28 لكل 1M رمز | Cache hit $0.145 / cache miss $1.74 / output $3.48 لكل 1M رمز |

| الحد الأقصى للإخراج | 384K | 384K |

يوفّر CometAPI الوصول إلى Deepseek v4 Pro وV4 Flash —أرخص بنسبة 20% من الرسمي— بالإضافة إلى تبديل سلس بين أكثر من 500 نموذج (GPT‑5.4، Gemini 3.1، إلخ) عبر نقطة نهاية واحدة متوافقة مع OpenAI أو Anthropic Messages.

معايير الأداء

DeepSeek‑V3.2 مقابل V4‑Flash مقابل V4‑Pro

في جدول مقارنة النماذج الأساسية، يتفوق كل من V4‑Flash وV4‑Pro على DeepSeek‑V3.2 عبر المقاييس الأساسية، مع تقدّم V4‑Pro غالبًا. على سبيل المثال، يسرد التقرير النتائج التالية: AGIEval 82.6 / 83.1 مقابل 80.1 في V3.2؛ MMLU 88.7 / 90.1 مقابل 87.8؛ MMLU‑Pro 68.3 / 73.5 مقابل 65.5؛ HumanEval 69.5 / 76.8 مقابل 62.8؛ وLongBench‑V2 44.7 / 51.5 مقابل 40.2 لـ V3.2، حيث الرقم الأوسط هو V4‑Flash والأخير V4‑Pro.

| المعيار | DeepSeek‑V3.2‑Base | DeepSeek‑V4‑Flash‑Base | DeepSeek‑V4‑Pro‑Base |

|---|---|---|---|

| AGIEval (EM) | 80.1 | 82.6 | 83.1 |

| MMLU (EM) | 87.8 | 88.7 | 90.1 |

| MMLU‑Pro (EM) | 65.5 | 68.3 | 73.5 |

| HumanEval (Pass@1) | 62.8 | 69.5 | 76.8 |

| LongBench‑V2 (EM) | 40.2 | 44.7 | 51.5 |

المصدر: التقرير التقني لـ DeepSeek‑V4، الجدول 1.

النمط واضح: Flash يضيّق الفجوة مع Pro، لكن Pro لا يزال النموذج العام الأقوى. يجعل ذلك V4‑Flash الخيار العملي الافتراضي لكثير من أنظمة الإنتاج، بينما V4‑Pro هو النموذج المناسب عندما تكون جودة الإجابة أهم من التكلفة أو زمن الاستجابة.

مقارنات مع النماذج الغربية: أين يتموضع V4

في أحد التقييمات البشرية لمهام الموظفين المكتبيين باللغة الصينية، يقول التقرير إن DeepSeek‑V4‑Pro‑Max تفوّق على Claude Opus 4.6‑Max مع معدل عدم خسارة 63%. كما أن DeepSeek‑V4‑Pro "يتفوق بشكل ملحوظ" على Claude Sonnet 4.5 ويقترب من Claude Opus 4.5 في معيار ترميز R&D.

| مجال التقييم | نتيجة DeepSeek | المقارنة مع النماذج الغربية | ما الذي يوحي به |

|---|---|---|---|

| مهام الموظفين الصينيين | V4‑Pro‑Max، معدل عدم خسارة 63% | مقابل Claude Opus 4.6‑Max | أداء قوي في مهام أعمال عملية |

| معيار ترميز R&D | معدل نجاح V4‑Pro‑Max بلغ 67 | مقابل Claude Sonnet 4.5 عند 47؛ Opus 4.5 عند 70؛ Opus 4.6 Thinking عند 80 | منافس للنماذج المتصدرة، خصوصًا أمام أنظمة فئة Sonnet |

إنه ليس "الأول في كل جانب"، لكنه وصل بالفعل إلى مستوى "يجب تقييمه بجدية".

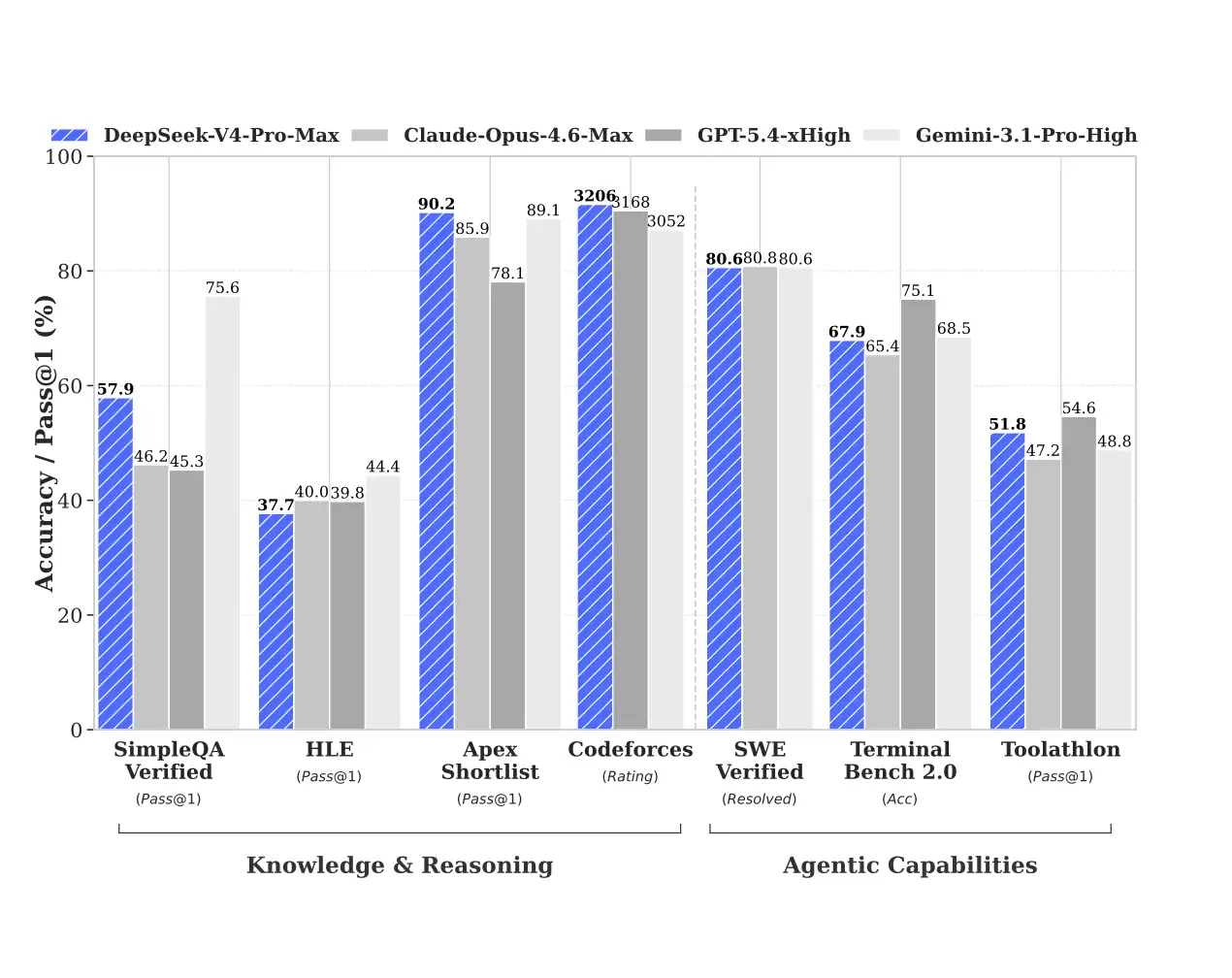

يقارن التقرير التقني لـ DeepSeek V4 بين V4‑Pro‑Max وClaude Opus 4.6 Max وGPT‑5.4 xHigh وGemini 3.1 Pro High في الجدول ذاته. النتائج ليست تبسيطية: ما تزال النماذج الغربية المغلقة المصدر قوية في بعض جوانب المعرفة والاستدلال؛ لكن V4‑Pro‑Max يتمتع بحضور قوي جدًا في الشفرة، والسياقات الطويلة، وبعض مهام الوكلاء. بمعنى آخر، لم يعد السرد منخفض الأبعاد لـ"بدائل محلية"، بل دخل مرحلة "أيّها أنسب لسيناريو عملك".

من حيث المعرفة والقدرة على الاستدلال، فهو على قدم المساواة مع Opus 4.6 Max وGPT‑5.4 xHigh وGemini 3.1 ProHigh. ومع ذلك، يتخلف قليلًا في القدرات الوكيلية، رغم أن الفارق غير كبير.

يتمتع DeepSeek‑V4‑Pro‑Max بقدرة تنافسية عالية في سيناريوهات موجهة للشفرة وللسياقات الطويلة، بينما تظل النماذج الغربية قوية جدًا في عدة مقاييس للمعرفة والاستدلال الخالص. هذه هي القراءة الصحيحة للإصدار: DeepSeek V4 حاضر بقوة في نقاش النماذج المتقدمة، لكن صدارة المقاييس تبقى معتمدة على نوع المهمة.

كيفية الوصول إلى DeepSeek V4

1) استخدام الويب والتطبيق الرسميين

تقول DeepSeek إن V4 Preview متاح الآن على الويب، والتطبيق، وواجهة API. بالنسبة للمستخدمين العاديين، يظل أبسط طريق هو واجهة الدردشة الرسمية، حيث يمكن الوصول إلى النموذج عبر وضع الخبراء أو الوضع الفوري.

2) استخدام الـ API

أوصي بشدة باستخدام CometAPI للوصول إلى deepseek V4، لأنه يقدم أفضل سعر ومزايا التجميع.

أسماء النماذج هي:

deepseek-v4-flashdeepseek-v4-pro

تقول DeepSeek أيضًا إن الأسماء القديمة

deepseek-chatوdeepseek-reasonerستُوقَف، وهي حاليًا تُطابِق وضعَي غير التفكير والتفكير من V4‑Flash حتى 2026‑07‑24. هذا مهم لتخطيط الهجرة إذا كانت لديك تكاملات أقدم في الإنتاج.

- قم بالتسجيل في CometAPI واحصل على مفتاح الـ API الخاص بك.

- استخدم حزمة OpenAI Python SDK القياسية (أو أي عميل متوافق) مع عنوان أساسي مخصص:

إليك مثالًا نظيفًا باستخدام التنسيق المتوافق مع OpenAI:

import os

from openai import OpenAIclient = OpenAI(

api_key=os.environ["cometapi_API_KEY"],

base_url="https://api.cometapi.com"

)response = client.chat.completions.create(

model="deepseek-v4-pro",

messages=[

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": "Summarize the benefits of million-token context."}

],

extra_body={"thinking": {"type": "enabled"}},

reasoning_effort="high"

)print(response.choices[0].message.content)

يتبع هذا النمط إرشادات البدء السريع: اضبط العنوان الأساسي، واختر deepseek-v4-pro أو deepseek-v4-flash، وفعّل وضع التفكير عندما تحتاج إلى استدلال أعمق.

كيفية استخدام DeepSeek V4 بفعالية

بالنسبة لسير عمل المستندات الطويلة، النمط الأقوى هو إبقاء السياق نظيفًا ومنظمًا. نافذة 1M‑رمز هي ميزة كبيرة، لكن النموذج ما يزال يعطي أفضل أداء عندما يُنظَّم الإدخال في أقسام واقتباسات مصادر وتعليمات مهمة وقيود إخراج واضحة. هذه الطريقة الأكثر طبيعية لاستغلال قدرة السياق الطويل التي تروّج لها DeepSeek.

بالنسبة لسير عمل الشفرة والوكلاء، ابدأ بـ V4‑Flash للتكرار السريع، ثم انتقل إلى V4‑Pro للتشغيل النهائي أو للخطوات الأصعب. يتوافق هذا النهج مع التموضع الرسمي: Flash هو الخيار الكفؤ، Pro هو النموذج الأقوى، وكلاهما يتشاركان سطح الـ API وطول السياق ذاته.

كلمة أخيرة

يبرز DeepSeek‑V4 لأنه يجمع أربعة أمور طالبت بها السوق في الوقت نفسه: سياق طويل، استدلال قوي، إتاحة مفتوحة، وتسعير هجومي. القصة الحقيقية ليست مجرد أن DeepSeek أصدرت نموذجًا آخر؛ بل أن الشركة تحاول جعل الذكاء الاصطناعي على مستوى الحدّ الأمامي قابلًا للاستخدام اقتصاديًا في الإنتاج. بالنسبة للفرق التي تقيّم أين تضع رهانها التالي على الذكاء الاصطناعي، فهذه إشارة تستحق الاختبار لا التجاهل.

بالنسبة للفرق التي تبني عبر مزودين متعددين، فهذا بالضبط النوع من الإصدارات الذي يستحق القياس داخل منصتك. يمكن أن تكون CometAPI طبقة عملية لمقارنة DeepSeek‑V4 إلى جانب نماذج رائدة أخرى دون إجبار فريق منتجك على إعادة بناء التكامل كلما تغيّر السوق.