أعلنت Google DeepMind رسميًا عن إطلاق Gemma 4 في 2 أبريل 2026، ما يمثل محطة رئيسية في الذكاء الاصطناعي مفتوح المصدر. تقدّم عائلة النماذج هذه ذكاءً من المستوى الريادي لكل معلمة، وقد بُنيت على نفس الأبحاث والتقنيات التي تدعم Gemini 3. وعلى عكس إصدارات Gemma السابقة ذات التراخيص المخصصة، تأتي Gemma 4 بموجب ترخيص Apache 2.0 المتساهل بالكامل، ما يتيح استخدامًا تجاريًا غير مقيّد، وتعديلًا، وإعادة توزيع دون قيود.

تتألق Gemma 4 بقدرات متعددة الوسائط (مدخلات نص + صورة عبر جميع الأحجام، إضافةً إلى الصوت على نماذج الطرف)، ودعم أصيل للاستدلال المتقدم وسير العمل القائم على الوكلاء، ونوافذ سياق طويلة تصل إلى 256K رمز، وتحسينات تمتد من الهواتف الذكية وRaspberry Pi إلى وحدات معالجة الرسوميات عالية الأداء. وهي تدعم أكثر من 140 لغة وتؤكد على الكفاءة، ما يجعل الذكاء الاصطناعي القوي متاحًا على أجهزة المستهلك والأجهزة الطرفية دون الاعتماد على السحابة.

CometAPI توفر واجهات برمجة تطبيقات ممتازة للنماذج مفتوحة المصدر ومغلقة المصدر.

ما هي Gemma 4؟

Gemma 4 هي أحدث عائلة من النماذج اللغوية الكبيرة (LLMs) المفتوحة ومتعددة الوسائط من Google DeepMind، صُمّمت خصيصًا للاستدلال المتقدم، وسير العمل القائم على الوكلاء، والنشر الفعال على الجهاز. وهي تعظّم “الذكاء لكل معلمة” بالاستفادة من رؤى أبحاث Gemini 3 المملوكة، مع البقاء مفتوحة الأوزان ومفتوحة المصدر بالكامل.

أهم التطورات مقارنة بنماذج Gemma السابقة تشمل:

- متعددة الوسائط أصلاً: فهم النص + الصورة (جميع النماذج)، مع دعم الصوت في المتغيرات الطرفية الأصغر.

- وضع تفكير قابل للتهيئة: استدلال خطوة بخطوة مع مخرجات <|think|> مُهيكلة.

- استدعاء الدوال واستخدام الأدوات أصيلاً: مثالي للوكلاء الذاتيين.

- سياق ممتد: حتى 256K رمز في النماذج الأكبر.

- بنية انتباه هجينة: تجمع بين نافذة منزلقة محلية وانتباه عالمي لتحقيق الكفاءة وأداء السياق الطويل.

- Per-Layer Embeddings (PLE) في النماذج الأصغر وذاكرة تخزين مؤقت KV مشتركة لتوفير الذاكرة.

- دعم متعدد اللغات واسع: مُدرّب مسبقًا على بيانات تغطي 140+ لغة مع وعي بالفروق الثقافية.

وبطرحها بموجب Apache 2.0، تزيل Gemma 4 قيود الترخيص السابقة التي حدّت من تبنّي المؤسسات. يمكن للمطورين الآن الضبط الدقيق، والنشر، والتجاريّة دون احتكاك—ما يضعها كمنافس مباشر لمنظومات مفتوحة بالكامل مثل Llama وQwen.

تستهدف Gemma 4 عتادًا متنوعًا: الأجهزة الطرفية (الهواتف، إنترنت الأشياء، Raspberry Pi، Jetson Nano) لذكاء منخفض الكمون دون اتصال، ومحطات العمل/وحدات معالجة الرسوميات للخوادم المحلية عالية الأداء. يضع هذا التصميم “المحلي أولًا” الخصوصية وتخفيض التكلفة وانعدام الكمون في الاستدلال ضمن الأولويات.

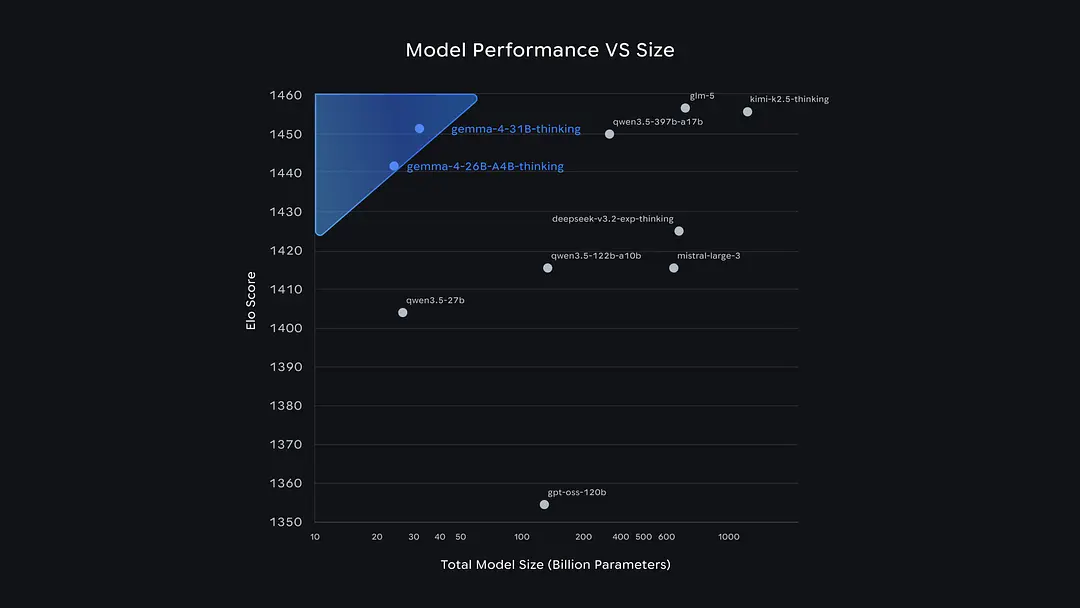

النماذج مفتوحة المصدر المتصدرة قبلها على لوحة صدارة Arena تأتي أساسًا من فرق صينية. لا تختلف Gemma 4 كثيرًا عن Qwen 3.5 وGLM-5، لكنها تختلف بشكل ملحوظ عن OpenAI's GPT-OSS-120B.

يمكن للمطورين الآن العثور على GLM-5، Qwen 3.5 وغيرها على CometAPI.

الإصدارات الأربعة من Gemma 4

طرحت Google أربعة أحجام من Gemma 4 جرى تحسينها بعناية، يوازن كلٌ منها بين الأداء والكفاءة وسيناريوهات النشر. يستخدم اثنان بنى كثيفة مع ابتكار Per-Layer Embeddings (PLE) لكفاءة الطرف؛ وأحدها Mixture-of-Experts (MoE) لأداء عالٍ بتكلفة معلمات نشطة منخفضة؛ وواحد كثيف يمثل الرائد.

| النموذج | البنية | إجمالي المعلمات | المعلمات النشطة (MoE) | المعلمات الفعّالة | طول السياق | الوسائط | الأجهزة المستهدفة |

|---|---|---|---|---|---|---|---|

| Gemma 4 E2B | كثيف + PLE | ~5.1B (بما في ذلك embeddings) | غير متوفر | 2.3B | 128K | نص، صورة، صوت | الهواتف الذكية، Raspberry Pi، إنترنت الأشياء الطرفي |

| Gemma 4 E4B | كثيف + PLE | ~8B (بما في ذلك embeddings) | غير متوفر | 4.5B | 128K | نص، صورة، صوت | الأجهزة المحمولة، وحدات معالجة رسوميات خفيفة، Jetson |

| Gemma 4 26B A4B | MoE (8 نشطة / 128 إجمالي + 1 مشترك) | 25.2B | 3.8B–4B | غير متوفر | 256K | نص، صورة | محطات العمل، وحدات معالجة رسوميات للمستهلكين، خوادم محلية |

| Gemma 4 31B | كثيف | 30.7B | غير متوفر | غير متوفر | 256K | نص، صورة | وحدات معالجة رسوميات عالية المستوى (يتسع على H100/A100 واحدة بدقة FP16) |

Gemma 4 E2B وE4B (محسّنة للطرف): تستخدم PLE لإضافة تخصّص لكل طبقة مع حد أدنى من زيادة المعلمات. مثالية للأجهزة العاملة بالبطارية أو المقيدة بالذاكرة. يتيح المرمّز الصوتي (Conformer بأسلوب USM، ~300M معلمة) تحويل الكلام إلى نص والترجمة.

Gemma 4 26B A4B (MoE): يفعّل فقط ~4B معلمة أثناء الاستدلال رغم حجم إجمالي يتجاوز 25B. يقدّم أداءً يقارب 31B بتكلفة حوسبة أقل بكثير—مثالي للتوسّع الاقتصادي.

Gemma 4 31B (كثيف): نموذجٌ رائد لأقصى قدرات. يتسع على وحدة GPU واحدة بسعة 80GB بالدقة الكاملة ويأتي ضمن أفضل النماذج المفتوحة على لوائح الترتيب.

تتضمن جميع النماذج متغيرات مضبوطة على التعليمات (“-it”) محسّنة للدردشة والاستدلال واستخدام الأدوات، إضافةً إلى نسخ أساسية مُدرّبة مسبقًا للضبط الدقيق. يتبع النموذجان الأكبران نهجين مختلفين: يسعى نموذج 31B الكثيف إلى الجودة القصوى ويعد أفضل أساس للضبط الدقيق؛ بينما يفضّل نموذج 26B القائم على MoE السرعة، إذ يفعّل 3.8 مليار معلمة فقط أثناء الاستدلال، ما ينتج عنه توليد كلمات أسرع بكثير مع جودة إجمالية أقل قليلًا.

أما النموذجان الأصغر، E2B وE4B، فمصممان خصيصًا للهواتف المحمولة وأجهزة إنترنت الأشياء: يمكنهما العمل دون اتصال بالكامل، ما يوفر الذاكرة والطاقة. علاوة على ذلك، يمتلك هذان النموذجان الصغيران قدرة لا تتوفر في النماذج الأكبر: إدخال صوتي أصيل يتيح التعرف المباشر على الكلام.

القدرات الأساسية لـ Gemma 4

تتفوّق Gemma 4 في الجوانب الأكثر أهمية لتطبيقات الذكاء الاصطناعي الواقعية:

1. الاستدلال المتقدم ووضع التفكير

استدلال خطوة بخطوة قابل للتهيئة عبر تعليمات النظام أو enable_thinking=True. يُنتج وسوم <|think|> مُهيكلة تليها الإجابات النهائية. يحسّن الأداء بشكل كبير في المهام المعقدة دون ضبط دقيق إضافي.

2. الفهم متعدد الوسائط

- الرؤية: كشف الكائنات (مربعات حدود JSON)، OCR (متعدد اللغات)، تحليل المستندات/ملفات PDF، فهم الرسوم البيانية، فهم واجهات المستخدم، التعرف على الكتابة اليدوية، والتعامل مع الصور ذات الدقة المتغيرة (موازنات الرموز: 70–1120 رمزًا).

- الفيديو: حتى 60 ثانية (معالجة إطار بمعدل 1 fps).

- الصوت (E2B/E4B فقط): التعرف التلقائي على الكلام (ASR) وترجمة الكلام إلى نص (حد أقصى 30 ثانية).

- مدخلات متداخلة: مزج النصوص والصور والصوت بأي ترتيب.

3. سير العمل القائم على الوكلاء واستدعاء الدوال

يتيح دعم الأدوات الأصلي إنشاء وكلاء ذاتيين للتخطيط متعدد الخطوات، واستدعاء واجهات برمجة التطبيقات، والتنقّل داخل التطبيقات، وإتمام المهام. أداء قوي على τ2-bench (استخدام الأدوات القائم على الوكلاء).

4. البرمجة وأدوات المطورين

توليد واكمال وتصحيح الشيفرة بشكل استثنائي، مع فهم على مستوى المستودع. يدعم مخرجات مُهيكلة بصيغة JSON للتكامل السلس. يحقق 80.0% (31B) على LiveCodeBench v6، ما يضعه كمساعد برمجة محلي أولًا مناسب لسيناريوهات التطوير دون اتصال.

5. سياق طويل وتعدد اللغات

يتعامل بثقة مع 128K–256K رمز (مُختبر على MRCR needle-in-haystack). مُدرّب مسبقًا على بيانات حتى حد يناير 2025، بأداء قوي عبر اللغات. هذا ليس مجرد ترجمة متعددة اللغات؛ بل تدريب أصيل يغطي أكثر من 140 لغة.

بيانات القياس: تفصيل أداء Gemma 4

تضع Gemma 4 معايير جديدة للنماذج المفتوحة. تحقق إصدارات 31B و26B درجات كانت حكرًا على أنظمة أكبر مملوكة، بينما تتفوّق نماذج الطرف على سابقتها الأكبر Gemma 3.

النتائج الكاملة للقياسات (نماذج مضبوطة على التعليمات)

| المعيار | الفئة | Gemma 4 31B | Gemma 4 26B A4B | Gemma 4 E4B | Gemma 4 E2B | Gemma 3 27B (no think) |

|---|---|---|---|---|---|---|

| MMLU Pro | الاستدلال والمعرفة | 85.2% | 82.6% | 69.4% | 60.0% | 67.6% |

| AIME 2026 (no tools) | الرياضيات | 89.2% | 88.3% | 42.5% | 37.5% | 20.8% |

| GPQA Diamond | علوم دراسات عليا | 84.3% | 82.3% | 58.6% | 43.4% | 42.4% |

| Tau2 (avg) | استخدام الأدوات القائم على الوكلاء | 76.9% | 68.2% | 42.2% | 24.5% | 16.2% |

| LiveCodeBench v6 | البرمجة | 80.0% | 77.1% | 52.0% | 44.0% | 29.1% |

| Codeforces ELO | البرمجة التنافسية | 2150 | 1718 | 940 | 633 | 110 |

| MMMU Pro | استدلال متعدد الوسائط | 76.9% | 73.8% | 52.6% | 44.2% | 49.7% |

| MATH-Vision | رياضيات + رؤية | 85.6% | 82.4% | 59.5% | 52.4% | 46.0% |

| MRCR v2 (8-needle, 128K) | سياق طويل | 66.4% | 44.1% | 25.4% | 19.1% | 13.5% |

أهم الاستنتاجات:

- قفزة ضخمة عن Gemma 3: يحسن نموذج 31B الرياضيات في AIME من 20.8% إلى 89.2% وLiveCodeBench من 29.1% إلى 80.0%.

- كفاءة MoE: يقترب 26B A4B من 31B مع استخدام حوسبة أقل بكثير أثناء الاستدلال.

- تفوق الطرف: يتفوق E4B وE2B على Gemma 3 27B في العديد من المقاييس رغم أنهما أصغر بـ 6–10 مرات.

- ترتيبات لوائح التفضيل: يسجّل 31B نحو ~1452 على Arena AI (النص)؛ و26B A4B نحو ~1441. وتشير التقارير إلى أن متغير 26B يتفوق على نماذج أكبر بكثير مثل Qwen 3.5 397B في تفضيلات المستخدم والبرمجة.

تؤكد معايير الرؤية والصوت أداءً متعدد الوسائط قويًا من خارج الصندوق دون ضبط دقيق متخصص.

النظام البيئي ودعم الأدوات

يحظى Gemma 4 بتكامل واسع وفوري في النظام البيئي:

- Hugging Face: دعم من اليوم الأول مع

transformers،pipeline("any-to-any")، وGGUF، وONNX، ومعالجات متعددة الوسائط. - بيئات تشغيل محلية: Ollama، Llama.cpp (LM Studio، Jan)، MLX (Apple Silicon مع TurboQuant)، Mistral.rs (Rust)، وTransformers.js (استدلال WebGPU في المتصفح).

- الضبط الدقيق: TRL، Unsloth، PEFT، Vertex AI، ودعم مجموعات بيانات متعددة الوسائط بالكامل.

- تحسين العتاد: NVIDIA RTX/DGX Spark/Jetson (عبر TensorRT-LLM)، أدوات Google AI Edge، والنشر على الجهاز لنظامي Android/iOS.

- أطر الوكلاء: OpenClaw، Hermes، Pi، واختبارات المحاكاة CARLA.

- السحابة/الاستوديو: Google AI Studio للاختبار السريع؛ Kaggle Models للتنزيل.

يجعل هذا النظام البيئي Gemma 4 قابلاً للنشر خلال دقائق على الحواسيب المحمولة أو الخوادم أو الأجهزة الطرفية.

القيود والسلامة:

- حد بيانات التدريب: يناير 2025 (لا معرفة آنية دون أدوات).

- الصوت مقتصر على الكلام (ليس الموسيقى)؛ الفيديو محدود بـ 60 ثانية.

- خطر الهلوسة لا يزال قائمًا—استخدم وضع التفكير والتحقق.

- السلامة: تصفية صارمة وتقييمات وفق مبادئ Google للذكاء الاصطناعي؛ على المطورين إضافة ضوابط خاصة بالتطبيق.

لماذا تُعد Gemma 4 مهمة في 2026

تُنمذج Gemma 4 ديمقراطية الذكاء الاصطناعي المتقدّم. من خلال الجمع بين ذكاء متعدد الوسائط، وقدرات قائمة على الوكلاء، وحرية Apache 2.0 مع كفاءة غير معتمدة على العتاد، تمكّن المطورين والمؤسسات من بناء حلول ذكاء اصطناعي آمنة وخاصة وفعّالة التكلفة على نطاق واسع. إن اختراق “الذكاء لكل معلمة”—الظاهر بوضوح في نماذج الطرف التي تتفوق على نماذج رائدة مفتوحة الأمس—يشير إلى تحوّل نحو ذكاء اصطناعي شامل فعلاً.

سواءً بتشغيل نموذج 2B على هاتف أو نموذج 31B قوي محليًا، تُثبت Gemma 4 أن الذكاء الاصطناعي مفتوح المصدر قد لحق (وفي كثير من الحالات تجاوز) البدائل المغلقة من حيث الجدوى العملية.