واجهة برمجة التطبيقات GPT-4o في الوقت الفعلي: نقطة نهاية بث متعددة الوسائط ومنخفضة الكمون تتيح للمطورين إرسال واستقبال البيانات النصية والصوتية والبصرية المتزامنة عبر WebRTC أو WebSocket (النموذج=gpt-4o-realtime-preview-<date>, stream=true) للتطبيقات التفاعلية في الوقت الحقيقي.

المعلومات الأساسية والميزات

OpenAI GPT-4o في الوقت الفعلي (معرف النموذج: gpt-4o-معاينة فورية-2025-06-03) هو أول نموذج أساس متاح للعامة تم تصميمه لـ الكلام من طرف إلى طرف (S2S) التفاعل مع زمن انتقال أقل من ثانيةمشتق من عائلة "omni" GPT-4o، الصمامات البديلة في الوقت الفعلي التعرف على الكلام، والتفكير اللغوي الطبيعي، والتحويل العصبي للنص إلى كلام في شبكة واحدة، مما يسمح للمطورين ببناء وكلاء صوتيين يتحدثون بسلاسة كالبشر. يُعرض النموذج من خلال واجهة مصممة خصيصًا واجهة برمجة التطبيقات في الوقت الفعلي وهو متكامل بشكل وثيق مع الجديد وكيل الوقت الحقيقي التجريد داخل مجموعة أدوات تطوير البرامج للوكلاء (TypeScript و Python).

مجموعة الميزات الأساسية — S2S من البداية إلى النهاية • معالجة الانقطاعات • استدعاء الأدوات

• تحويل الكلام الأصلي إلى كلام: يتم استقبال المدخلات الصوتية كتدفقات مستمرة، تُرمز داخليًا، وتُحلل منطقيًا، ثم تُعاد ككلام مُركّب. لا حاجة لمخازن مؤقتة خارجية STT/TTS، مما يُلغي تأخر خط الأنابيب الذي قد يمتد لثوانٍ عديدة.

• زمن الوصول بالمللي ثانية: التقليم المعماري، وتقطير النموذج، ومجموعة الخدمة المُحسّنة لوحدة معالجة الرسومات (GPU) ~300–500 مللي ثانية زمن انتقال الرمز الأول في عمليات النشر السحابية النموذجية، تقترب من معايير تبادل الأدوار بين البشر.

• تعليمات قوية - متابعة: تم ضبط GPT-4o Realtime على نصوص المحادثة وتتبع استدعاء الوظيفة، ويوضح >25% انخفاض في أخطاء تنفيذ المهام بالمقارنة مع خط الأساس GPT-2024o لشهر مايو 4.

• استدعاء الأدوات الحتمية: ينتج النموذج JSON منظمًا يتوافق مع OpenAI مخطط استدعاء الوظيفةيسمح بالاستدعاء الحتمي لواجهات برمجة التطبيقات الخلفية (أنظمة الحجز، قواعد البيانات، إنترنت الأشياء). إعادة المحاولة مع مراعاة الأخطاء والتحقق من صحة الحجج مُدمجة.

• المقاطعات اللطيفة: يتيح جهاز كشف نشاط الصوت في الوقت الفعلي المقترن بفك التشفير التدريجي للوكيل إيقاف الكلام في منتصف الجملة، استيعاب مقاطعة المستخدم، واستئناف أو إعادة التخطيط للاستجابة بسلاسة.

• معدل الكلام القابل للتكوين: جديد سرعة تتيح المعلمة (0.25–4× الوقت الفعلي) للمطورين تخصيص وتيرة الإخراج لتطبيقات إمكانية الوصول أو التطبيقات السريعة.

الهندسة المعمارية التقنية — محول متعدد الوسائط موحد

وحدة ترميز وفك ترميز موحدة: يشارك GPT-4o Realtime بنية Omni محول أحادي المكدس حيث تتعايش رموز الصوت والنص والرؤية (المستقبلية) في مساحة كامنة واحدة. يختصر الحساب التكيفي الطبقي إطارات الصوت مباشرةً إلى كتل الانتباه اللاحقة، مما يوفر من ٢٠ إلى ٤٠ مللي ثانية لكل تمريرة.

ترميز الصوت الهرمي: يتم تقسيم PCM الخام بمعدل 16 كيلو هرتز إلى رقع log-mel → يتم تكميمها إلى رموز صوتية خشنة الحبيبات → يتم ضغطها إلى رموز دلالية، مما يؤدي إلى تحسين رمز في الثانية الميزانية دون التضحية بالعروض.

نوى الاستدلال منخفضة البت: يتم تشغيل الأوزان المنشورة عند التكميم NF4 رباعي البتات من خلال نوى Triton / TensorRT-LLM، يتم مضاعفة الإنتاجية مقابل fp16 مع الحفاظ على فقدان جودة MOS <1 ديسيبل.

بث الاهتمام: تسمح التضمينات الدوارة للنافذة المنزلقة وتخزين القيمة الرئيسية للنموذج بالاهتمام بآخر 15 ثانية من الصوت باستخدام ذاكرة O(L)، وهو أمر بالغ الأهمية للحوارات التي تستغرق مدة مكالمة الهاتف.

التفاصيل الفنية

- إصدار API:

2025-06-03-preview - بروتوكولات النقل:

- WebRTC: زمن انتقال منخفض للغاية (< 80 مللي ثانية) لتدفقات الصوت/الفيديو من جانب العميل

- WebSocket:البث من خادم إلى خادم مع زمن انتقال أقل من 100 مللي ثانية

- ترميز البيانات:

- أبوس الترميز داخل RTP حزم الصوت

- H.264 / H.265 إطارات الفيديو

- خدمات البث: يدعم

stream: trueلتقديم الإضافية يتم إنشاء الاستجابات الجزئية كرموز - لوحة صوتية جديدة:يقدم ثمانية أصوات جديدة—أشابة, رماد, أغنية راقصة, مرجان, صدى, حكيم, وميضو بيت شعر—للمزيد معبر, مثل الإنسان التفاعلات ..

تطور GPT-4o في الوقت الفعلي

- مايو 2024: GPT-4o أومني لأول مرة مع دعم متعدد الوسائط للنصوص والصوت والرؤية.

- أكتوبر ٢٠٢٠: واجهة برمجة التطبيقات في الوقت الفعلي يدخل إلى النسخة التجريبية الخاصة (

2024-10-01-preview), تم تحسينه للصوت منخفض الكمون. - ديسمبر ٢٠٢٠:توسع التوافر العالمي لـ

gpt-4o-realtime-preview-2024-12-17مضيفا التخزين المؤقت الفوري والمزيد من الأصوات. - 3 يونيو، 2025: اخر تحديث (

2025-06-03-preview) يخرج المكرر لوحة صوتية وتحسينات الأداء.

الأداء المعياري

- MMLU: 88.7، متجاوزًا 4 من GPT-86.5 فهم لغة متعددة المهام ضخمة .

- التعرف على الكلام:يحقق الرائدة في صناعة معدلات أخطاء الكلمات في البيئات الصاخبة، متجاوزة همس خطوط الأساس.

- اختبارات زمن الوصول:

- نهاية إلى نهاية (الكلام في → النص خارج): 50 - 80 مللي ثانية عبر WebRTC

- الصوت ذهابًا وإيابًا (الكلام الداخل → الكلام الخارج): <100 ms .

المؤشرات الفنية

- الإنتاجية:يدعم 15 رمزًا/ثانية لتدفقات النصوص؛ كيلوبت في الثانية 24 عمل صوتي.

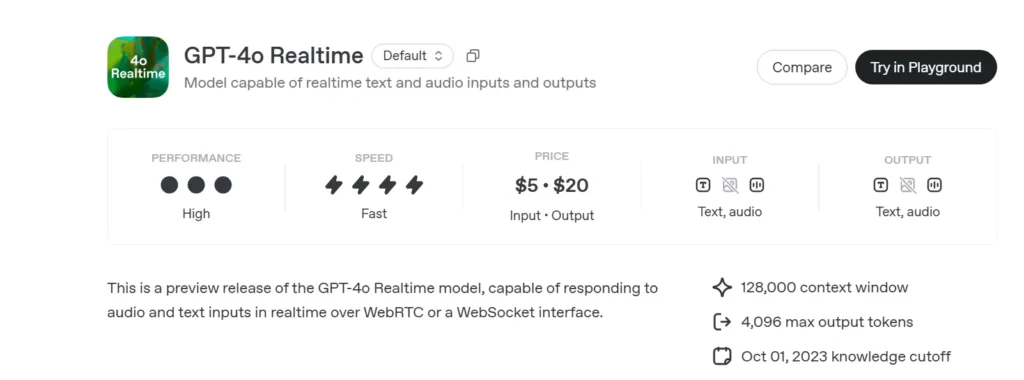

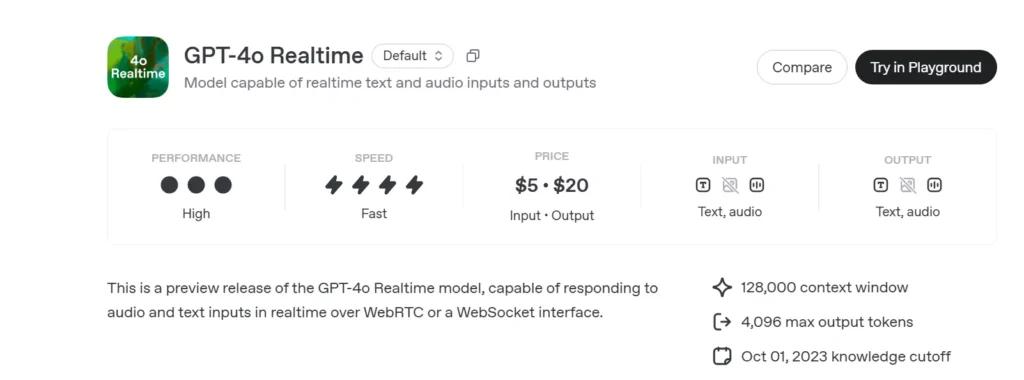

- الأسعار:

- نص: 5 دولارات لكل مليون رمز إدخال؛ 1 دولارًا لكل مليون رمز إخراج

- Audio: 100 دولار أمريكي لكل مليون رمز إدخال؛ و1 دولار أمريكي لكل مليون رمز إخراج.

- التوفر:تم نشره عالميًا في جميع المناطق التي تدعم واجهة برمجة التطبيقات في الوقت الفعلي.

كيفية استدعاء واجهة برمجة التطبيقات GPT-4o Realtime من CometAPI

GPT-4o Realtime تسعير واجهة برمجة التطبيقات (API) في CometAPI:

- رموز الإدخال: 2 دولار / مليون رمز

- رموز الإخراج: 8 دولار / مليون رمز

الخطوات المطلوبة

- تسجيل الدخول إلى كوميتابي.كوم. إذا لم تكن مستخدمًا لدينا بعد، فيرجى التسجيل أولاً

- احصل على مفتاح API لبيانات اعتماد الوصول للواجهة. انقر على "إضافة رمز" في رمز API في المركز الشخصي، واحصل على مفتاح الرمز: sk-xxxxx، ثم أرسله.

- احصل على عنوان URL لهذا الموقع: https://api.cometapi.com/

طرق الاستخدام

- حدد "**

gpt-4o-realtime-preview-2025-06-03**نقطة نهاية لإرسال الطلب وتعيين نصه. يتم الحصول على طريقة الطلب ونصه من وثيقة واجهة برمجة التطبيقات (API) الخاصة بموقعنا الإلكتروني. كما يوفر موقعنا الإلكتروني اختبار Apifox لتسهيل الأمر عليك. - يستبدل باستخدام مفتاح CometAPI الفعلي الخاص بك من حسابك.

- أدخل سؤالك أو طلبك في حقل المحتوى - وهذا ما سيستجيب له النموذج.

- . قم بمعالجة استجابة API للحصول على الإجابة الناتجة.

للحصول على معلومات حول الوصول إلى النموذج في Comet API، يرجى الاطلاع على وثيقة API.

للحصول على معلومات حول سعر النموذج في Comet API، يرجى الاطلاع على https://api.cometapi.com/pricing.

عينة من الكود وتكامل واجهة برمجة التطبيقات

import openai

openai.api_key = "YOUR_API_KEY"

# Establish a Realtime WebRTC connection

connection = openai.Realtime.connect(

model="gpt-4o-realtime-preview-2025-06-03",

version="2025-06-03-preview",

transport="webrtc"

)

# Stream audio frames and receive incremental text

with open("user_audio.raw", "rb") as audio_stream:

for chunk in iter(lambda: audio_stream.read(2048), b""):

result = connection.send_audio(chunk)

print("Assistant:", result)

- المعلمات الرئيسية:

model: "gpt-4o-معاينة فورية-2025-06-03"version: "معاينة 2025-06-03"transport: "ويبرتك" لـ الحد الأدنى من الكمونstream:trueلـ الإضافية التحديثات

من خلال الجمع بين دولة من بين الفن الاستدلال المتعدد الوسائط، أ قوي لوحة صوتية جديدة، و منخفضة للغاية تدفق زمن الوصول، GPT-4o في الوقت الفعلي (2025-06-03) يمكّن المطورين من بناء حقيقي التفاعلية, تحادثي تطبيقات الذكاء الاصطناعي.

انظر أيضا واجهة برمجة تطبيقات o3-Pro

الامتثال سلامة

تقوم OpenAI بشحن GPT-4o Realtime مع:

• حواجز الحماية على مستوى النظام: سياسة مصممة لرفض الطلبات المرفوضة (التطرف، السلوك غير المشروع).

• تصفية المحتوى في الوقت الفعلي: تقوم المصنفات التي تقل مدتها عن 100 مللي ثانية بفحص كل من إدخال المستخدم ومخرجات النموذج قبل البث.

• مسارات الموافقة البشرية: يتم تشغيله عند استدعاء أدوات عالية المخاطر (المدفوعات، والمشورة القانونية)، والاستفادة من عناصر الموافقة الجديدة لـ SDK للوكلاء.