في الفترة 2025–2026، استمر مشهد أدوات الذكاء الاصطناعي في التوحّد: توسّعت واجهات برمجة تطبيقات البوابة (مثل CometAPI) لتوفير وصول بأسلوب OpenAI إلى مئات النماذج، بينما واصلت تطبيقات LLM الموجّهة للمستخدم النهائي (مثل AnythingLLM) تحسين موفّر “Generic OpenAI” لديها للسماح لتطبيقات سطح المكتب والتطبيقات المحلية أولًا باستدعاء أي نقطة نهاية متوافقة مع OpenAI. وهذا يجعل من السهل اليوم توجيه حركة AnythingLLM عبر CometAPI والحصول على مزايا اختيار النموذج، وتوجيه التكلفة، والفوترة الموحّدة — مع الاستمرار في استخدام واجهة AnythingLLM المحلية وميزات RAG/الوكيل الخاصة به.

ما هو AnythingLLM ولماذا قد ترغب في ربطه بـ CometAPI؟

ما هو AnythingLLM؟

AnythingLLM هو تطبيق ذكاء اصطناعي مفتوح المصدر وشامل، وعميل محلي/سحابي لبناء مساعدين للمحادثة، وسير عمل التوليد المعزّز بالاسترجاع (RAG)، والوكلاء المعتمدين على LLM. يوفّر واجهة مستخدم أنيقة، وواجهة برمجة تطبيقات للمطورين، وميزات مساحات العمل/الوكلاء، ودعمًا لنماذج LLM المحلية والسحابية — وهو مصمم ليكون خاصًا افتراضيًا وقابلًا للتوسعة عبر الإضافات. يوفّر AnythingLLM موفّر Generic OpenAI الذي يتيح له التحدث إلى واجهات برمجة تطبيقات LLM المتوافقة مع OpenAI.

ما هو CometAPI؟

CometAPI هو منصة تجارية لتجميع واجهات برمجة التطبيقات توفّر أكثر من 500 نموذج ذكاء اصطناعي عبر واجهة REST واحدة بأسلوب OpenAI وفوترة موحّدة. عمليًا، يتيح لك استدعاء نماذج من عدة مزودين (OpenAI وAnthropic وGoogle/Gemini ومتغيراتها، ونماذج الصور/الصوت، إلخ) عبر نقاط النهاية نفسها https://api.cometapi.com/v1 ومفتاح API واحد (بالتنسيق sk-xxxxx). يدعم CometAPI نقاط نهاية قياسية بأسلوب OpenAI مثل /v1/chat/completions و/v1/embeddings وغيرها، مما يجعل من السهل تكييف الأدوات التي تدعم بالفعل واجهات API المتوافقة مع OpenAI.

لماذا تدمج AnythingLLM مع CometAPI؟

ثلاثة أسباب عملية:

- اختيار النموذج ومرونة المزود: يمكن لـ AnythingLLM استخدام “أي” نموذج LLM متوافق مع OpenAI عبر غلاف Generic OpenAI الخاص به. توجيه هذا الغلاف إلى CometAPI يمنحك وصولًا فوريًا إلى مئات النماذج دون تغيير واجهة AnythingLLM أو تدفقاته.

- تحسين التكلفة والعمليات: يتيح لك استخدام CometAPI تبديل النماذج (أو الانتقال إلى نماذج أرخص) بشكل مركزي للتحكم في التكلفة، مع الاحتفاظ بفوترة موحّدة بدلًا من إدارة مفاتيح مزودين متعددين.

- تجريب أسرع: يمكنك إجراء اختبار A/B لنماذج مختلفة (مثل

gpt-4oوgpt-4.5ومتغيرات Claude أو النماذج المفتوحة المصدر متعددة الوسائط) عبر واجهة AnythingLLM نفسها — وهذا مفيد للوكلاء، وردود RAG، والتلخيص، والمهام متعددة الوسائط.

ما البيئة والشروط التي يجب تحضيرها قبل الدمج

متطلبات النظام والبرمجيات (بمستوى عالٍ)

- جهاز مكتبي أو خادم يشغّل AnythingLLM (Windows أو macOS أو Linux) — سواء تثبيتًا مكتبيًا أو نسخة مستضافة ذاتيًا. تأكد من أنك تستخدم إصدارًا حديثًا يوفّر إعدادات LLM Preferences / AI Providers.

- حساب CometAPI ومفتاح API (السر بتنسيق

sk-xxxxx). ستستخدم هذا السر في موفّر Generic OpenAI داخل AnythingLLM. - اتصال شبكي من جهازك إلى

https://api.cometapi.com(من دون جدار حماية يحظر اتصالات HTTPS الصادرة). - اختياري لكن موصى به: بيئة Python حديثة أو Node حديثة للاختبار (Python 3.10+ أو Node 18+)، وcurl، وعميل HTTP (Postman / HTTPie) للتحقق من CometAPI قبل ربطه بـ AnythingLLM.

شروط خاصة بـ AnythingLLM

يُعد موفّر Generic OpenAI لمسارات LLM هو الطريق الموصى به لنقاط النهاية التي تحاكي واجهة API الخاصة بـ OpenAI. وتُحذّر وثائق AnythingLLM من أن هذا الموفّر موجّه للمطورين ويجب أن تفهم المدخلات التي تقدمها. إذا كنت تستخدم البث أو إذا كانت نقطة النهاية لديك لا تدعم البث، فإن AnythingLLM يتضمن إعدادًا لتعطيل البث لموفّر Generic OpenAI.

قائمة التحقق الأمنية والتشغيلية

- تعامل مع مفتاح CometAPI كما تتعامل مع أي سر آخر — لا تقم بإيداعه في المستودعات؛ خزّنه في سلاسل مفاتيح نظام التشغيل أو متغيرات البيئة حيثما أمكن.

- إذا كنت تخطط لاستخدام مستندات حساسة في RAG، فتأكد من أن ضمانات خصوصية نقطة النهاية تلبي متطلبات الامتثال لديك (راجع وثائق/شروط CometAPI).

- حدّد حدودًا قصوى لعدد الرموز ونافذة السياق لمنع الفواتير غير المنضبطة.

كيف تهيّئ AnythingLLM لاستخدام CometAPI (خطوة بخطوة)؟

فيما يلي تسلسل خطوات عملي — يليه أمثلة لمتغيرات البيئة ومقتطفات كود لاختبار الاتصال قبل حفظ الإعدادات في واجهة AnythingLLM.

الخطوة 1 — احصل على مفتاح CometAPI الخاص بك

- سجّل أو سجّل الدخول إلى CometAPI.

- انتقل إلى “API Keys” وأنشئ مفتاحًا — ستحصل على سلسلة تبدو مثل

sk-xxxxx. احتفظ بها بسرية.

الخطوة 2 — تحقّق من أن CometAPI يعمل عبر طلب سريع

استخدم curl أو Python لاستدعاء نقطة نهاية إكمال محادثة بسيطة لتأكيد الاتصال.

مثال Curl

curl -X POST "https://api.cometapi.com/v1/chat/completions" \

-H "Authorization: Bearer sk-xxxxx" \

-H "Content-Type: application/json" \

-d '{

"model": "gpt-4o",

"messages": ,

"max_tokens": 50

}'

إذا أعاد هذا استجابة 200 وJSON يحتوي على مصفوفة choices، فهذا يعني أن المفتاح والشبكة يعملان. (تُظهر وثائق CometAPI الواجهة ونقاط النهاية بأسلوب OpenAI).

مثال Python (requests)

import requests

url = "https://api.cometapi.com/v1/chat/completions"

headers = {"Authorization": "Bearer sk-xxxxx", "Content-Type": "application/json"}

payload = {

"model": "gpt-4o",

"messages": ,

"max_tokens": 64

}

r = requests.post(url, json=payload, headers=headers, timeout=15)

print(r.status_code, r.json())

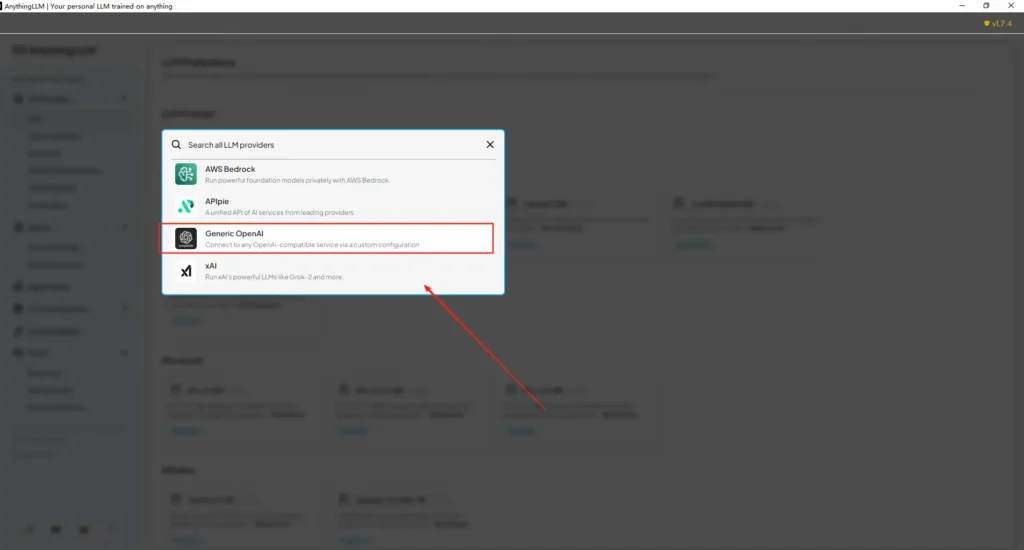

الخطوة 3 — إعداد AnythingLLM (واجهة المستخدم)

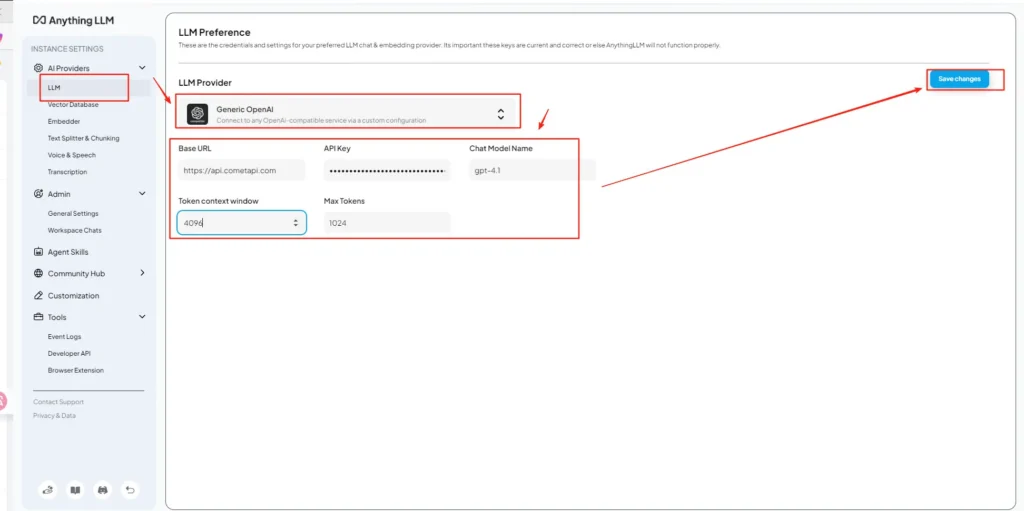

افتح AnythingLLM ← Settings ← AI Providers ← LLM Preferences (أو مسار مشابه في إصدارك). استخدم موفّر Generic OpenAI واملأ الحقول كما يلي:

إعدادات API (مثال)

• ادخل إلى قائمة إعدادات AnythingLLM، وحدّد LLM Preferences ضمن AI Providers.

• اختر Generic OpenAI كمزوّد النموذج، وأدخلhttps://api.cometapi.com/v1في حقل URL.

• الصقsk-xxxxxمن CometAPI في مربع إدخال مفتاح API. املأ Token context window وMax Tokens وفقًا للنموذج الفعلي. يمكنك أيضًا تخصيص أسماء النماذج في هذه الصفحة، مثل إضافة نموذجgpt-4o.

يتوافق هذا مع إرشادات “Generic OpenAI” في AnythingLLM (غلاف للمطورين) ونهج عنوان URL الأساسي المتوافق مع OpenAI في CometAPI.

الخطوة 4 — اضبط أسماء النماذج وحدود الرموز

في شاشة الإعدادات نفسها، أضف أو خصّص أسماء النماذج تمامًا كما ينشرها CometAPI (مثل gpt-4o وminimax-m2 وkimi-k2-thinking) حتى تتمكن واجهة AnythingLLM من عرض هذه النماذج للمستخدمين. ينشر CometAPI سلاسل النماذج لكل مزوّد.

الخطوة 5 — اختبر داخل AnythingLLM

ابدأ محادثة جديدة أو استخدم مساحة عمل موجودة، واختر موفّر Generic OpenAI (إذا كان لديك عدة مزودين)، ثم اختر أحد أسماء نماذج CometAPI التي أضفتها، وشغّل مطالبة بسيطة. إذا حصلت على إكمالات مترابطة، فقد تم الدمج بنجاح.

كيف يستخدم AnythingLLM هذه الإعدادات داخليًا

يقوم غلاف Generic OpenAI في AnythingLLM بإنشاء طلبات بأسلوب OpenAI (/v1/chat/completions و/v1/embeddings)، لذا بمجرد توجيه عنوان URL الأساسي وتقديم مفتاح CometAPI، سيقوم AnythingLLM بتوجيه المحادثات، واستدعاءات الوكلاء، وطلبات التضمين عبر CometAPI بشكل شفاف. وإذا كنت تستخدم وكلاء AnythingLLM (تدفقات @agent)، فسيرثون المزوّد نفسه.

ما أفضل الممارسات والمشكلات المحتملة؟

أفضل الممارسات

- استخدم إعدادات سياق مناسبة للنموذج: طابق Token Context Window وMax Tokens في AnythingLLM مع النموذج الذي تختاره في CometAPI. يؤدي عدم التطابق إلى اقتطاع غير متوقع أو فشل الاستدعاءات.

- أمّن مفاتيح API الخاصة بك: خزّن مفاتيح CometAPI في متغيرات البيئة و/أو Kubernetes/مدير الأسرار؛ ولا تُدخلها أبدًا إلى git. سيخزن AnythingLLM المفاتيح في إعداداته المحلية إذا أدخلتها في الواجهة — لذا اعتبر تخزين المضيف حساسًا.

- ابدأ بنماذج أرخص/أصغر لتدفقات التجربة: استخدم CometAPI لتجربة نماذج أقل تكلفة أثناء التطوير، واحتفِظ بالنماذج المتميزة للإنتاج. يعلن CometAPI صراحة عن تبديل التكلفة والفوترة الموحّدة.

- راقب الاستخدام واضبط التنبيهات: يوفّر CometAPI لوحات متابعة للاستخدام — اضبط الميزانيات/التنبيهات لتجنب الفواتير المفاجئة.

- اختبر الوكلاء والأدوات بشكل معزول: يمكن لوكلاء AnythingLLM تشغيل إجراءات؛ اختبرهم باستخدام مطالبات آمنة وعلى بيئات مرحلية أولًا.

المشكلات الشائعة

- تعارض واجهة المستخدم مع

.env: عند الاستضافة الذاتية، قد تؤدي إعدادات الواجهة إلى الكتابة فوق تغييرات.env(والعكس صحيح). تحقّق من الملف المُنشأ/app/server/.envإذا عادت الأمور إلى حالتها السابقة بعد إعادة التشغيل. تشير مشكلات المجتمع إلى إعادة تعيينLLM_PROVIDER. - عدم تطابق أسماء النماذج: سيؤدي استخدام اسم نموذج غير متاح على CometAPI إلى 400/404 من البوابة. تأكد دائمًا من النماذج المتاحة في قائمة نماذج CometAPI.

- حدود الرموز والبث: إذا كنت بحاجة إلى استجابات متدفقة، فتحقق من أن نموذج CometAPI يدعم البث (وأن إصدار واجهة AnythingLLM لديك يدعمه). تختلف بعض المزودات في دلالات البث.

ما حالات الاستخدام الواقعية التي يفتحها هذا الدمج؟

التوليد المعزّز بالاسترجاع (RAG)

استخدم أدوات تحميل المستندات + قاعدة بيانات المتجهات في AnythingLLM مع نماذج CometAPI LLM لإنشاء إجابات واعية بالسياق. يمكنك تجربة تضمينات رخيصة + نماذج محادثة مكلفة، أو إبقاء كل شيء على CometAPI لفوترة موحّدة. تُعد تدفقات RAG في AnythingLLM ميزة أساسية مدمجة.

أتمتة الوكلاء

يدعم AnythingLLM سير عمل @agent (تصفح الصفحات، استدعاء الأدوات، تشغيل الأتمتة). يوفّر توجيه استدعاءات LLM الخاصة بالوكلاء عبر CometAPI اختيارًا للنماذج لخطوات التحكم/التفسير دون تعديل كود الوكيل.

اختبار A/B متعدد النماذج وتحسين التكلفة

بدّل النماذج لكل مساحة عمل أو ميزة (مثل gpt-4o للإجابات الإنتاجية، وgpt-4o-mini للتطوير). يجعل CometAPI تبديل النماذج أمرًا بسيطًا ويُركّز التكاليف في مكان واحد.

خطوط أنابيب متعددة الوسائط

يوفّر CometAPI نماذج صور وصوت ونماذج متخصصة. إن دعم AnythingLLM متعدد الوسائط (عبر المزودين) بالإضافة إلى نماذج CometAPI يتيح إنشاء تدفقات لتعليق الصور، أو التلخيص متعدد الوسائط، أو نسخ الصوت عبر الواجهة نفسها.

الخلاصة

يواصل CometAPI ترسيخ مكانته كبوابة متعددة النماذج (أكثر من 500 نموذج، وواجهة API بأسلوب OpenAI) — مما يجعله شريكًا طبيعيًا لتطبيقات مثل AnythingLLM التي تدعم بالفعل موفّر Generic OpenAI. وبالمثل، فإن الموفّر العام في AnythingLLM وخيارات التهيئة الحديثة فيه تجعل الاتصال بمثل هذه البوابات أمرًا مباشرًا. هذا التقارب يبسّط التجريب والانتقال إلى الإنتاج في أواخر 2025.

كيفية البدء مع Comet API

CometAPI هي منصة API موحّدة تجمع أكثر من 500 نموذج ذكاء اصطناعي من مزودين رائدين — مثل سلسلة GPT من OpenAI، وGemini من Google، وClaude من Anthropic، وMidjourney، وSuno، وغير ذلك — ضمن واجهة واحدة سهلة الاستخدام للمطورين. ومن خلال توفير مصادقة متسقة، وتنسيق موحّد للطلبات، ومعالجة موحدة للاستجابات، تعمل CometAPI على تبسيط دمج قدرات الذكاء الاصطناعي في تطبيقاتك بشكل كبير. سواء كنت تبني روبوتات دردشة، أو مولدات صور، أو مؤلفات موسيقية، أو خطوط أنابيب تحليلية قائمة على البيانات، فإن CometAPI تتيح لك التكرار بسرعة أكبر، والتحكم في التكاليف، والبقاء مستقلًا عن المزوّد — مع الاستفادة في الوقت نفسه من أحدث الاختراقات عبر منظومة الذكاء الاصطناعي.

للبدء، استكشف قدرات نماذج CometAPI في Playground واطّلع على دليل API للحصول على تعليمات مفصلة. قبل الوصول، يُرجى التأكد من أنك سجلت الدخول إلى CometAPI وحصلت على مفتاح API. تقدّم CometAPI سعرًا أقل بكثير من السعر الرسمي لمساعدتك على التكامل.

هل أنت مستعد للانطلاق؟→ سجّل في CometAPI اليوم !

إذا كنت تريد معرفة المزيد من النصائح والأدلة والأخبار حول الذكاء الاصطناعي، فتابعنا على VK وX وDiscord!