Llama 4 API هي واجهة قوية تسمح للمطورين بدمج مييتاااأحدث نماذج اللغة الكبيرة متعددة الوسائط من Microsoft، والتي تتيح إمكانيات معالجة النصوص والصور والفيديو المتقدمة عبر تطبيقات مختلفة.

نظرة عامة على سلسلة Llama 4

تُقدّم سلسلة لاما 4 من ميتا نماذج ذكاء اصطناعي متطورة مُصمّمة لمعالجة وترجمة مختلف صيغ البيانات، بما في ذلك النصوص والفيديو والصور والصوت، مما يُعزّز تنوع التطبيقات. تشمل السلسلة:

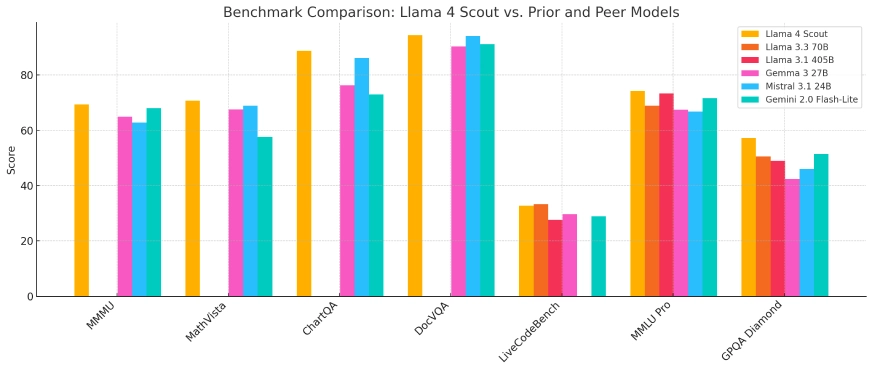

- لاما 4 كشافنموذج مدمج مُحسَّن للنشر على وحدة معالجة رسومية واحدة من نوع Nvidia H100، يتميز بنافذة سياقية تضم 10 ملايين رمز. يتفوق هذا النموذج على منافسيه، مثل Gemma 3 من Google وMistral 3.1، في مختلف المعايير.

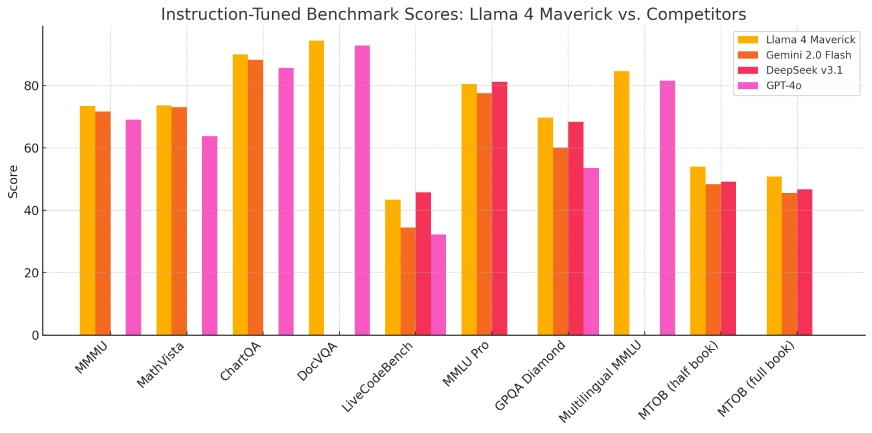

- لاما 4 مافريك:نموذج أكبر قابل للمقارنة في الأداء مع GPT-4o و DeepSeek-V3 من OpenAI في مهام الترميز والاستدلال، مع استخدام عدد أقل من المعلمات النشطة.

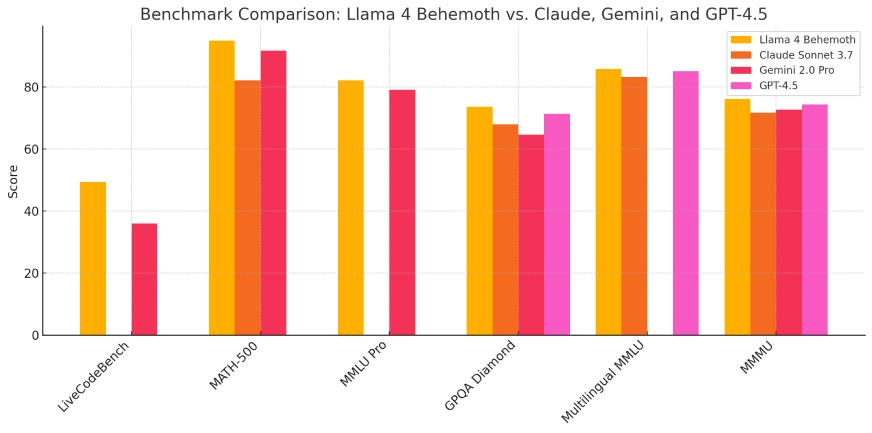

- لاما 4 بيهيموث:هذا النموذج قيد التطوير حاليًا، ويشتمل على 288 مليار معلمة نشطة وإجمالي 2 تريليون، ويهدف إلى تجاوز نماذج مثل GPT-4.5 وClaude Sonnet 3.7 في معايير STEM.

تم دمج هذه النماذج في مساعد الذكاء الاصطناعي الخاص بـ Meta عبر منصات مثل WhatsApp وMessenger وInstagram والويب، مما يعزز تفاعلات المستخدم مع قدرات الذكاء الاصطناعي المتقدمة.

| الموديل | إجمالي المعلمات | المعلمات النشطة | نحن خبراء بالتدريب | طول السياق | يعمل على | وصول الجمهور | مثالية ل |

|---|---|---|---|---|---|---|---|

| كشاف | 109B | 17B | 16 | 10 مليون توكينز | بطاقة Nvidia H100 واحدة | نعم | مهام الذكاء الاصطناعي خفيفة الوزن، وتطبيقات السياق الطويل |

| مستقل | 400B | 17B | 128 | لم يتم تحديد | وحدة معالجة رسومية واحدة أو متعددة | نعم | البحث، تطبيقات المؤسسات، البرمجة |

| شخص ضخم جدا | ~ 2 طن | 288B | 16 | لم يتم تحديد | البنية التحتية الداخلية | ❌ لا | التدريب على النموذج الداخلي والمقارنة المعيارية |

الهندسة المعمارية والابتكارات التقنية

تعتمد سلسلة Llama 4 على بنية "مزيج الخبراء"، وهو نهج مبتكر يُحسّن استخدام الموارد من خلال تفعيل مجموعات فرعية ذات صلة فقط من معلمات النموذج أثناء مهام محددة. يُحسّن هذا التصميم كفاءة وأداء الحوسبة، مما يسمح للنماذج بمعالجة المهام المعقدة بفعالية أكبر.

تطلّب تدريب هذه النماذج موارد حاسوبية ضخمة. استخدمت ميتا مجموعة وحدات معالجة رسومية تضم أكثر من 100,000 شريحة Nvidia H100، مما يُمثّل إحدى أكبر البنى التحتية لتدريب الذكاء الاصطناعي حتى الآن. سهّلت هذه القدرة الحاسوبية الهائلة تطوير نماذج ذات قدرات ومقاييس أداء مُحسّنة.

التطور من النماذج السابقة

بناءً على الأساس الذي أرسته الإصدارات السابقة، تُمثل سلسلة Llama 4 تطورًا هامًا في تطوير نموذج الذكاء الاصطناعي لشركة Meta. يُعالج دمج قدرات المعالجة متعددة الوسائط واعتماد بنية MoE القيود التي لوحظت في النماذج السابقة، مثل التحديات في التفكير المنطقي والمهام الرياضية. تُمكّن هذه التطورات Llama 4 من أن يكون منافسًا قويًا في مجال الذكاء الاصطناعي.

أداء معياري ومؤشرات فنية

في تقييمات الأداء المعياري، أظهر Llama 4 Scout أداءً متفوقًا على نماذج مثل Gemma 3 وMistral 3.1 من Google، لا سيما في المهام التي تتطلب معالجة سياقية مكثفة. أظهر Llama 4 Maverick قدرات تُضاهي النماذج الرائدة مثل GPT-4o من OpenAI، لا سيما في مهام البرمجة والاستدلال، مع الحفاظ على كفاءة أعلى في استخدام المعلمات. تُؤكد هذه النتائج فعالية بنية MoE ونظام التدريب المكثف المُستخدم.

لاما 4 كشاف

لاما 4 مافريك

لاما 4 بيهيموث:

سيناريوهات التطبيق

يتيح تنوع سلسلة Llama 4 تطبيقها في مختلف المجالات:

- تكامل وسائل التواصل الاجتماعي:تعزيز تفاعلات المستخدمين على منصات مثل WhatsApp وMessenger وInstagram من خلال ميزات متقدمة تعتمد على الذكاء الاصطناعي، بما في ذلك توصيات المحتوى المحسنة ووكلاء المحادثة.

- إنشاء المحتوى:مساعدة المبدعين في إنشاء محتوى عالي الجودة ومتعدد الوسائط من خلال معالجة النصوص والصور ومقاطع الفيديو وتوليفها، وبالتالي تبسيط العملية الإبداعية.

- أدوات تعليمية:تسهيل تطوير أنظمة التدريس الذكية القادرة على تفسير والاستجابة لتنسيقات البيانات المختلفة، مما يوفر تجربة تعليمية أكثر شمولاً.

- تحليل الأعمال:تمكين المؤسسات من تحليل وتفسير مجموعات البيانات المعقدة، بما في ذلك المعلومات النصية والمرئية، لاستخلاص رؤى قابلة للتنفيذ وإبلاغ عمليات صنع القرار.

ويجسد دمج نماذج Llama 4 في منصات Meta فائدتها العملية وإمكاناتها في تحسين تجارب المستخدم عبر التطبيقات المتنوعة.

الاعتبارات الأخلاقية واستراتيجية المصدر المفتوح

بينما تُروّج ميتا لسلسلة لاما 4 باعتبارها مفتوحة المصدر، فإن شروط الترخيص تتضمن قيودًا على الكيانات التجارية التي يزيد عدد مستخدميها عن 700 مليون مستخدم. أثار هذا النهج انتقادات من مبادرة المصدر المفتوح، مُسلّطًا الضوء على الجدل الدائر حول التوازن بين الوصول المفتوح والمصالح التجارية في تطوير الذكاء الاصطناعي.

وتؤكد الاستثمارات الكبيرة التي قامت بها شركة ميتا، والتي تصل إلى 65 مليار دولار في البنية التحتية للذكاء الاصطناعي، التزام الشركة بتطوير قدرات الذكاء الاصطناعي والحفاظ على ميزة تنافسية في مشهد الذكاء الاصطناعي سريع التطور.

الخاتمة

يُمثل إطلاق سلسلة لاما 4 من ميتا نقلة نوعية في مجال الذكاء الاصطناعي، إذ يُظهر تحسينات كبيرة في المعالجة متعددة الوسائط، والكفاءة، والأداء. بفضل تصاميمها المعمارية المبتكرة واستثماراتها الحاسوبية الكبيرة، تُرسي هذه النماذج معايير جديدة في قدرات الذكاء الاصطناعي. ومع استمرار ميتا في دمج هذه النماذج عبر منصاتها واستكشاف المزيد من التطورات، من المتوقع أن تلعب سلسلة لاما 4 دورًا محوريًا في رسم ملامح مستقبل تطبيقات وخدمات الذكاء الاصطناعي.

كيفية استدعاء Llama 4 API من CometAPI

1.تسجيل الدخول إلى كوميتابي.كوم. إذا لم تكن مستخدمًا لدينا بعد، فيرجى التسجيل أولاً

2.احصل على مفتاح API لبيانات اعتماد الوصول للواجهة. انقر على "إضافة رمز" في رمز واجهة برمجة التطبيقات في المركز الشخصي، واحصل على مفتاح الرمز: sk-xxxxx، ثم أرسله.

-

احصل على عنوان URL لهذا الموقع: https://api.cometapi.com/

-

حدد Llama 4 (اسم الطراز: لاما-4-مافريك; لاما-4-كشافة) نقطة نهاية لإرسال طلب واجهة برمجة التطبيقات وتعيين نص الطلب. يتم الحصول على طريقة الطلب ونصه من وثيقة API لموقعنا على الويبيوفر موقعنا أيضًا اختبار Apifox لراحتك.

- للحصول على معلومات حول النموذج الموجود في Comet API، يرجى الاطلاع على https://api.cometapi.com/new-model.

- للحصول على معلومات حول سعر النموذج في Comet API، يرجى الاطلاع على https://api.cometapi.com/pricing

| الفئة | لاما-4-مافريك | لاما-4-كشافة |

| تسعير API | رموز الإدخال: 0.48 دولارًا أمريكيًا / مليون رمز | رموز الإدخال: 0.216 دولار أمريكي / مليون رمز |

| رموز الإخراج: 1.44 دولار/ مليون رمز | رموز الإخراج: 1.152 دولار/ مليون رمز |

- عالج استجابة واجهة برمجة التطبيقات (API) للحصول على الإجابة المُولَّدة. بعد إرسال طلب واجهة برمجة التطبيقات، ستتلقى كائن JSON يحتوي على الإكمال المُولَّد.