ما هي واجهة برمجة تطبيقات GPT-5.2

واجهة برمجة تطبيقات GPT-5.2 هي نفسها GPT-5.2 Thinking في ChatGPT. GPT-5.2 Thinking هي الفئة المتوسطة من عائلة GPT-5.2 من OpenAI المصممة لـ العمل الأعمق: الاستدلال متعدد الخطوات، تلخيص المستندات الطويلة، توليد الشيفرة عالية الجودة، وأعمال المعرفة المهنية حيث تهم الدقة والبنية القابلة للاستخدام أكثر من الإنتاجية الخام. في الواجهة تُعرض كنموذج gpt-5.2 (Responses API / Chat Completions)، وتأتي بين نسخة Instant منخفضة الكمون ونسخة Pro الأعلى جودة والأعلى تكلفة.

الميزات الرئيسية

- سياق طويل جداً وضغط: نافذة فعّالة بحجم 400K وأدوات ضغط لإدارة الصلة عبر المحادثات والمستندات الطويلة.

- جهد استدلال قابل للضبط:

none | medium | high | xhigh(xhigh يتيح أقصى حوسبة داخلية للاستدلالات الصعبة).xhighمتاح لنسختي Thinking/Pro. - دعم أقوى للأدوات والدوال: استدعاء أدوات من الدرجة الأولى، قواعد (CFG/Lark) لتقييد المخرجات المهيكلة، وسلوكيات عاملية محسّنة تبسط الأتمتة المعقدة متعددة الخطوات.

- فهم متعدد الوسائط: فهم أكثر ثراءً للصورة + النص ودمجهما في مهام متعددة الخطوات.

- تحسينات في الأمان/التعامل مع المحتوى الحساس: تدخلات موجهة لتقليل الاستجابات غير المرغوبة في مجالات مثل إيذاء النفس وسياقات حساسة أخرى.

القدرات التقنية والمواصفات (من منظور المطور)

- نقاط نهاية API ومعرّفات النماذج:

gpt-5.2لنسخة Thinking (Responses API)، وgpt-5.2-chat-latestلتدفقات الدردشة/الاستجابة الفورية، وgpt-5.2-proللشريحة Pro؛ متاحة عبر Responses API وChat Completions حيثما أشير. - رموز الاستدلال وإدارة الجهد: تدعم الواجهة معاملات صريحة لتخصيص الحوسبة (جهد الاستدلال) لكل طلب؛ يزيد الجهد الأعلى من الكمون والتكلفة لكنه يحسّن جودة المخرجات للمهام المعقدة.

- أدوات للمخرجات المهيكلة: دعم لقواعد (Lark / CFG) لتقييد مخرجات النموذج إلى DSL أو صياغة دقيقة (مفيد لـ SQL وJSON وتوليد DSL).

- استدعاء أدوات متوازٍ وتنسيق عاملي: تحسين التوازي وتنظيم الأدوات بشكل أنظف يقللان الحاجة إلى أوامر نظام معقدة وهياكل متعددة العوامل.

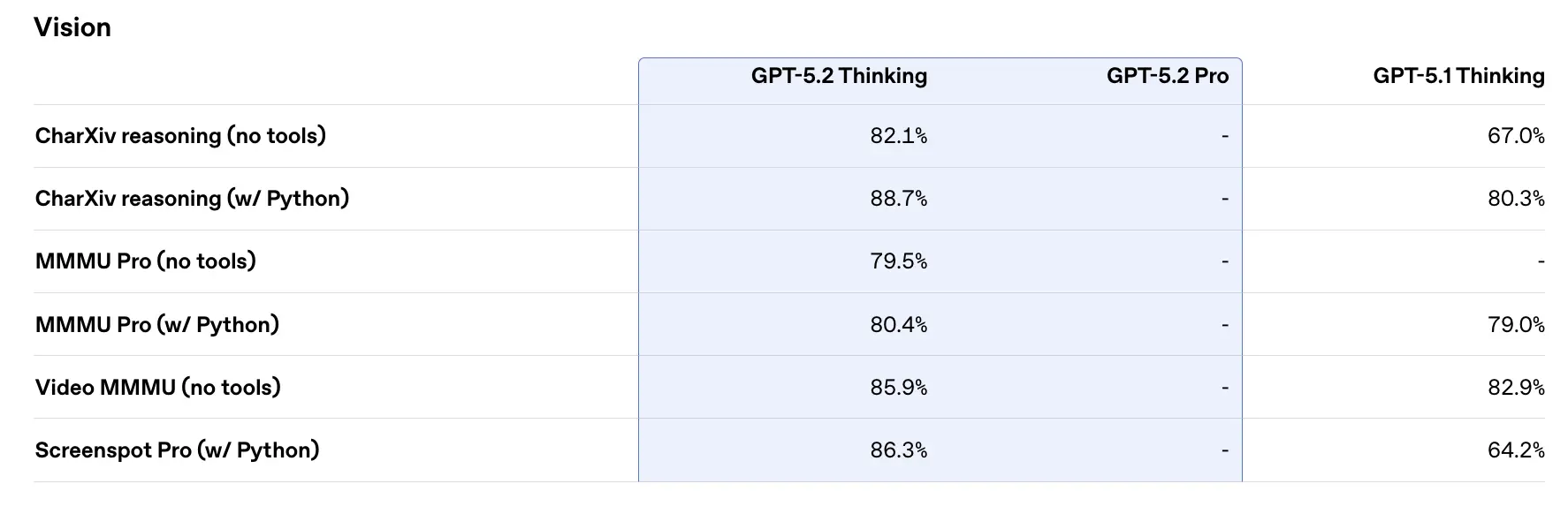

أداء الاختبارات والبيانات الداعمة

نشرت OpenAI مجموعة متنوعة من نتائج الاختبارات القياسية الداخلية والخارجية لـ GPT-5.2. فيما يلي أبرز النقاط (بحسب أرقام OpenAI المعلنة):

- GDPval (44 مهنة، أعمال معرفية) — يتفوق GPT-5.2 Thinking أو يعادل أفضل محترفي الصناعة في 70.9% من المقارنات؛ وتفيد OpenAI بأن المخرجات أُنتجت بسرعة >11× وتكلفة <1% مقارنة بالمحترفين الخبراء في مهامهم على GDPval (تقديرات السرعة والتكلفة مبنية على بيانات تاريخية). تشمل هذه المهام نماذج جداول البيانات، العروض التقديمية ومقاطع الفيديو القصيرة.

- SWE-Bench Pro (البرمجة) — يحقق GPT-5.2 Thinking نسبة ≈55.6% على SWE-Bench Pro و**~80%** على SWE-Bench Verified (Python فقط) وفق OpenAI، ما يرسّخ معياراً جديداً لحالات تقييم توليد الشيفرة/الهندسة في اختباراتهم. يترجم هذا عملياً إلى تصحيح أخطاء أكثر موثوقية وحلول شاملة من البداية إلى النهاية، وفق أمثلة OpenAI.

- GPQA Diamond (أسئلة وأجوبة على مستوى الدراسات العليا في العلوم Q&A) — GPT-5.2 Pro: 93.2%، وGPT-5.2 Thinking: 92.4% على GPQA Diamond (دون أدوات، أقصى استدلال).

- سلسلة ARC-AGI — على ARC-AGI-2 (اختبار أكثر صعوبة للاستدلال السائل)، حقق GPT-5.2 Thinking نسبة 52.9% وGPT-5.2 Pro نسبة 54.2% (تقول OpenAI إنها علامات جديدة متقدمة لنماذج بأسلوب تسلسل التفكير).

- السياق الطويل (OpenAI MRCRv2) — يُظهر GPT-5.2 Thinking دقة تقارب 100% على نسخة MRCR ذات 4 إبر حتى 256k رمز، وتحسناً كبيراً مقارنةً بـ GPT-5.1 عبر إعدادات السياق الطويل. (نشرت OpenAI مخططات وجداول MRCRv2.)

المقارنة مع النماذج المعاصرة

- مقابل Google Gemini 3 (Gemini 3 Pro / Deep Think): تم الترويج لـ Gemini 3 Pro بنافذة سياق ~1,048,576 (≈1M) رمز ومدخلات متعددة الوسائط واسعة (نص، صورة، صوت، فيديو، PDFs) وتكاملات عاملية قوية عبر Vertex AI / AI Studio. على الورق، نافذة السياق الأكبر لـ Gemini 3 تميزّه لأعباء العمل الضخمة جداً في جلسة واحدة؛ من الموازَنات السطح الأداتي والملاءمة مع النظام البيئي.

- مقابل Anthropic Claude Opus 4.5: يركز Opus 4.5 من Anthropic على تدفقات العمل المؤسسية للبرمجة/العوامل ويبلّغ عن نتائج قوية على SWE-bench ومتانة لجلسات عاملية طويلة؛ وتضع Anthropic نموذج Opus للأتمتة وتوليد الشيفرة مع نافذة سياق 200k وتكاملات متخصصة مع العوامل/Excel. يُعد Opus 4.5 منافساً قوياً في أتمتة المؤسسات ومهام الشيفرة.

الخلاصة العملية: يستهدف GPT-5.2 مجموعة متوازنة من التحسينات (سياق 400k، مخرجات رمزية عالية، استدلال/برمجة محسنين). يستهدف Gemini 3 أكبر سياقات الجلسة الواحدة على الإطلاق (≈1M)، بينما يركز Claude Opus على هندسة المؤسسات ومتانة السلوك العاملي. اختر وفقاً لمطابقة حجم السياق، واحتياجات الوسائط، وملاءمة الميزات/الأدوات، ومقايضات التكلفة/الكمون.

كيفية الوصول إلى واستخدام واجهة برمجة تطبيقات GPT-5.2

الخطوة 1: التسجيل للحصول على مفتاح API

سجّل الدخول إلى cometapi.com. إذا لم تكن مستخدماً لدينا بعد، يرجى التسجيل أولاً. سجّل الدخول إلى CometAPI console. احصل على مفتاح واجهة برمجة التطبيقات API key. انقر “Add Token” ضمن رمز API في المركز الشخصي، واحصل على مفتاح الرمز: sk-xxxxx وقدّمه.

الخطوة 2: إرسال الطلبات إلى واجهة برمجة تطبيقات GPT-5.2

اختر نقطة النهاية “gpt-5.2” لإرسال طلب API واضبط جسم الطلب. يتم الحصول على طريقة الطلب وجسم الطلب من وثائق API على موقعنا. يوفر موقعنا أيضاً اختبار Apifox لراحتك. استبدل <YOUR_API_KEY> بمفتاح CometAPI الفعلي من حسابك. يستدعي المطورون هذه عبر Responses API / Chat endpoints.

أدرج سؤالك أو طلبك في حقل content—هذا ما سيرد عليه النموذج. عالج استجابة API للحصول على الإجابة المُولدة.

الخطوة 3: استرجاع النتائج والتحقق منها

عالج استجابة API للحصول على الإجابة المُولدة. بعد المعالجة، تستجيب الواجهة بحالة المهمة وبيانات المخرجات.

راجع أيضًا Gemini 3 Pro Preview API