GLM-4.6 هو أحدث إصدار رئيسي ضمن عائلة GLM من Z.ai (المعروفة سابقًا باسم Zhipu AI): نموذج MoE (مزيج من الخبراء) من الجيل الرابع، مخصص لـ سير عمل قائم على الوكلاء، والاستدلال في سياقات طويلة والبرمجة الواقعية. يركز الإصدار على التكامل العملي بين الوكلاء/الأدوات، ونافذة سياق كبيرة جدًا، وإتاحة الأوزان المفتوحة للنشر المحلي.

الميزات الأساسية

- سياق طويل — نافذة سياق 200K رمز أصلية (موسّعة من 128K). (docs.z.ai)

- قدرات البرمجة والوكلاء — تحسينات مُعلن عنها في مهام البرمجة الواقعية واستدعاء الأدوات بشكل أفضل للوكلاء.

- الكفاءة — انخفاض مُبلغ عنه بنسبة ~30% في استهلاك الرموز مقارنةً بـ GLM-4.5 في اختبارات Z.ai.

- النشر والتكميم — أول إعلان عن تكامل FP8 وInt4 لرقاقات Cambricon؛ دعم FP8 أصلي على Moore Threads عبر vLLM.

- حجم النموذج ونوع الموتر — تشير المواد المنشورة إلى نموذج بمعاملات ~357B (موترات BF16 / F32) على Hugging Face.

تفاصيل تقنية

أنماط الإدخال/الإخراج والصيغ. GLM-4.6 هو نموذج نصي فقط (LLM) (أنماط الإدخال والإخراج: نص). طول السياق = 200K رمز؛ الحد الأقصى للمخرجات = 128K رمز.

التكميم ودعم الأجهزة. يذكر الفريق تكميم FP8/Int4 على رقاقات Cambricon وتنفيذ FP8 أصلي على وحدات معالجة رسوميات Moore Threads باستخدام vLLM للاستدلال — وهو أمر مهم لخفض تكلفة الاستدلال وإتاحة النشر داخل المؤسسة وعلى السحابات المحلية.

الأدوات والتكاملات. يوزَّع GLM-4.6 عبر API الخاصة بـ Z.ai، وشبكات مزوّدي الطرف الثالث (مثل CometAPI)، ومتكامل في وكلاء البرمجة (Claude Code، Cline، Roo Code، Kilo Code).

تفاصيل تقنية

أنماط الإدخال/الإخراج والصيغ. GLM-4.6 هو نموذج نصي فقط (LLM) (أنماط الإدخال والإخراج: نص). طول السياق = 200K رمز؛ الحد الأقصى للمخرجات = 128K رمز.

التكميم ودعم الأجهزة. يذكر الفريق تكميم FP8/Int4 على رقاقات Cambricon وتنفيذ FP8 أصلي على وحدات معالجة رسوميات Moore Threads باستخدام vLLM للاستدلال — وهو أمر مهم لخفض تكلفة الاستدلال وإتاحة النشر داخل المؤسسة وعلى السحابات المحلية.

الأدوات والتكاملات. يوزَّع GLM-4.6 عبر API الخاصة بـ Z.ai، وشبكات مزوّدي الطرف الثالث (مثل CometAPI)، ومتكامل في وكلاء البرمجة (Claude Code، Cline، Roo Code، Kilo Code).

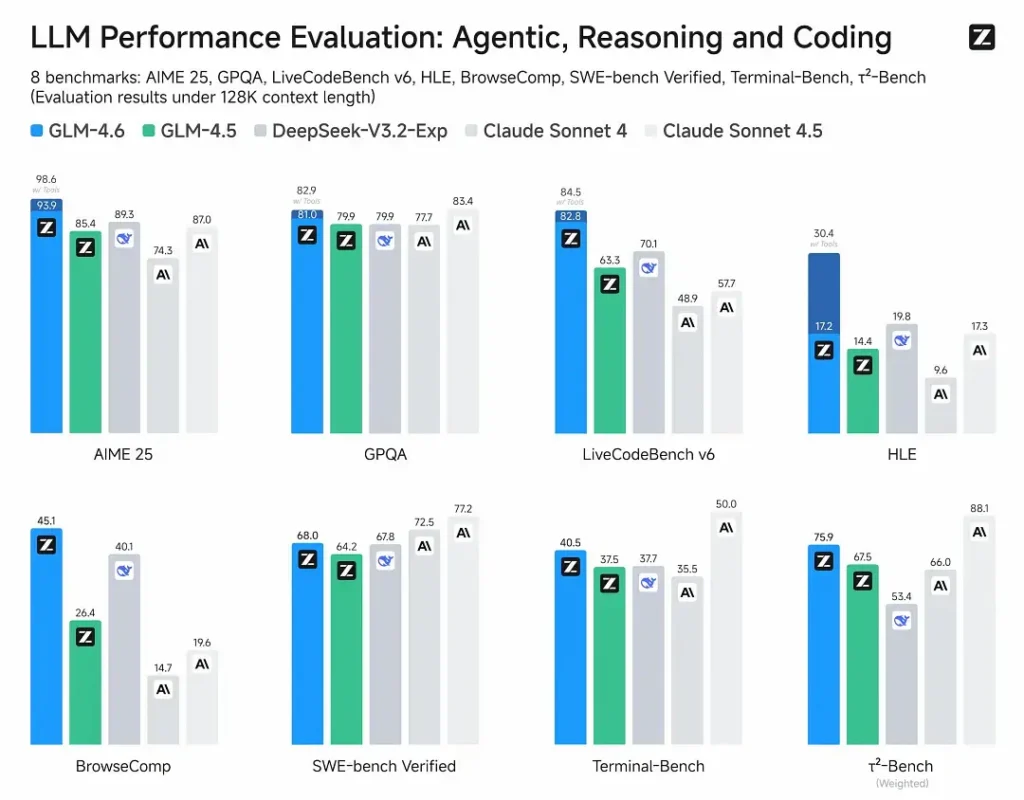

أداء القياسات المعيارية

- تقييمات منشورة: تم اختبار GLM-4.6 على ثمانية معايير عامة تغطي الوكلاء والاستدلال والبرمجة ويُظهر تفوقًا واضحًا على GLM-4.5. في اختبارات البرمجة الواقعية المُقيّمة بشريًا (نسخة موسّعة من CC-Bench)، يستخدم GLM-4.6 ~15% رموزًا أقل مقارنةً بـ GLM-4.5 ويحقق معدل فوز ~48.6% مقابل Claude Sonnet 4 من Anthropic (تقارب شبه متكافئ في العديد من القوائم).

- التموضع: النتائج تدّعي أن GLM-4.6 ينافس النماذج الرائدة محليًا ودوليًا (تتضمن الأمثلة DeepSeek-V3.1 وClaude Sonnet 4).

القيود والمخاطر

- الهلاوس والأخطاء: مثل جميع النماذج الحالية، يرتكب GLM-4.6 أخطاءً واقعية — توضح وثائق Z.ai صراحةً أن المخرجات قد تحتوي على أخطاء. ينبغي للمستخدمين تطبيق التحقق والاسترجاع/RAG للمحتوى الحرج.

- تعقيد النموذج وتكلفة الخدمة: سياق 200K ومخرجات كبيرة جدًا يزيدان بشكل كبير متطلبات الذاكرة والزمن وقد يرفعان تكاليف الاستدلال؛ يلزم تكميم/هندسة الاستدلال للتشغيل على نطاق واسع.

- فجوات في المجالات: رغم أن GLM-4.6 يورد أداءً قويًا في الوكلاء/البرمجة، تُشير بعض التقارير العامة إلى أنه لا يزال يتأخر عن بعض الإصدارات من النماذج المنافسة في اختبارات مصغّرة محددة (مثل بعض مقاييس البرمجة مقابل Sonnet 4.5). قيّم حسب المهمة قبل استبدال نماذج الإنتاج.

- السلامة والسياسات: الأوزان المفتوحة تزيد الوصول لكنها تثير أيضًا أسئلة الحوكمة (تظل وسائل التخفيف والحواجز والاختبار الأحمر مسؤولية المستخدم).

حالات الاستخدام

- أنظمة الوكلاء وتنظيم الأدوات: سلاسل آثار الوكلاء الطويلة، التخطيط متعدد الأدوات، الاستدعاء الديناميكي للأدوات؛ معايرة النموذج للوكلاء هي نقطة بيع أساسية.

- مساعدو البرمجة الواقعية: توليد الشيفرة متعدد الجولات، مراجعة الشيفرة ومساعدو بيئات التطوير التفاعلية (مُتكامل في Claude Code وCline وRoo Code — وفق Z.ai). تحسينات كفاءة الرموز تجعله جذابًا لخطط المطورين كثيفة الاستخدام.

- سير عمل المستندات الطويلة: التلخيص، التركيب متعدد المستندات، المراجعات القانونية/التقنية الطويلة نظرًا لنافذة 200K.

- إنشاء المحتوى والشخصيات الافتراضية: حوارات ممتدة، الحفاظ على شخصية متسقة في السيناريوهات متعددة الجولات.

كيف يقارن GLM-4.6 بالنماذج الأخرى

- GLM-4.5 → GLM-4.6: قفزة في حجم السياق (128K → 200K) وكفاءة الرموز (~15% رموز أقل على CC-Bench)؛ تحسين استخدام الوكلاء/الأدوات.

- GLM-4.6 مقابل Claude Sonnet 4 / Sonnet 4.5: تفيد Z.ai بوجود تقارب على عدة قوائم ومعدل فوز ~48.6% على مهام البرمجة الواقعية في CC-Bench (تنافس وثيق، مع اختبارات مصغّرة يتفوق فيها Sonnet أحيانًا). بالنسبة لفرق الهندسة الكثيفة الاستخدام، يُقدَّم GLM-4.6 كبديل فعّال من حيث التكلفة.

- GLM-4.6 مقابل نماذج السياق الطويل الأخرى (DeepSeek، Gemini، عائلة GPT-4): يركز GLM-4.6 على السياق الكبير وسير عمل البرمجة الوكيلية؛ تتباين نقاط القوة حسب المقياس (كفاءة الرموز/تكامل الوكلاء مقابل دقة توليد الشيفرة الخام أو مسارات السلامة). ينبغي أن يكون الاختيار التجريبي مُوجَّهًا بالمهمة.

أُطلق نموذج GLM-4.6 الأحدث من Zhipu AI: 355B معاملات إجمالية، 32B نشطة. يتفوق على GLM-4.5 في جميع القدرات الأساسية.

- البرمجة: يتماشى مع Claude Sonnet 4، الأفضل في الصين.

- السياق: تم التوسيع إلى 200K (من 128K).

- الاستدلال: مُحسّن، يدعم استدعاء الأدوات أثناء الاستدلال.

- البحث: تعزيز استدعاء الأدوات وأداء الوكلاء.

- الكتابة: يتوافق بدرجة أفضل مع تفضيلات البشر في الأسلوب وسهولة القراءة ولعب الأدوار.

- متعدد اللغات: تعزيز الترجمة عبر اللغات.