في 28 يوليو 2025، كشفت شركة Zhipu AI الناشئة ومقرها بكين رسميًا عن سلسلة نماذج اللغة الكبيرة مفتوحة المصدر GLM-4.5، في ما يمثل أقوى إصدار لها حتى الآن ويستهدف تطبيقات الوكلاء الأذكياء المتقدمة. وجاء الإعلان—عبر فعالية مباشرة على الإنترنت عقب المؤتمر العالمي للذكاء الاصطناعي (WAIC)—ليستعرض نسختين: النسخة الكاملة GLM-4.5 بإجمالي 355 مليار معلمة (32 مليار معلمة نشطة)، والنسخة الأكثر إحكامًا GLM-4.5-Air التي تضم 106 مليارات معلمة إجمالًا (12 مليار معلمة نشطة). ويعتمد كلا النموذجين على بنية استدلال هجينة تجمع بين “التفكير” و“عدم التفكير”، وهي مصممة لتحقيق التوازن بين الاستدلال العميق وسرعة الاستجابة، كما يقدمان نافذة سياق تبلغ 128,000 رمز لاستخدامات محادثية ومهامية موسعة .

يأتي إطلاق GLM-4.5 وسط احتدام سباق الذكاء الاصطناعي المحلي. ووفقًا لوكالة أنباء شينخوا الصينية الرسمية، أطلق المطورون الصينيون 1,509 نماذج لغة كبيرة حتى يوليو 2025، متصدرين الإجمالي العالمي البالغ 3,755 نموذجًا—وهو دليل واضح على حجم وسرعة توسع منظومة الذكاء الاصطناعي في الصين.

ترخيص المصدر المفتوح لـ GLM-4.5

في ابتعاد واضح عن النماذج الاحتكارية المغلقة، تطلق Z.ai نموذج GLM-4.5 بموجب ترخيص مفتوح المصدر بالكامل وقابل للتدقيق على نمط MIT، ما يمنح المؤسسات شفافية كاملة بشأن أوزان النموذج وشيفرة التدريب. ويمكن للمؤسسات نشر GLM-4.5 محليًا داخل بنيتها التحتية، أو ضبطه دقيقًا على مجموعات بيانات مملوكة، أو دمجه عبر خدمات استدلال مستضافة ذاتيًا، بما يجنّبها الارتهان لمورّد واحد وهياكل تسعير واجهات API غير الشفافة.

ويضمن توفر كلٍّ من GLM-4.5 لمهام الوكلاء العامة وGLM‑4.5‑Air، وهو متغير خفيف الوزن مُحسَّن للبيئات محدودة الموارد، تغطية طيف واسع من حالات الاستخدام—من عمليات النشر واسعة النطاق في مراكز البيانات إلى سيناريوهات الاستدلال على الأجهزة الطرفية .

ومن الناحية الاستراتيجية، يضع نهج Zhipu مفتوح المصدر الشركة في مواجهة اللاعبين الغربيين الراسخين ذوي النماذج المغلقة مثل OpenAI. ومن خلال إتاحة نموذج قابل للمقارنة مع GPT‑4 بموجب ترخيص MIT، تهدف Zhipu إلى تنمية مجتمع قوي من المطورين اللاحقين ووضع معايير تقنية لقدرات الذكاء الاصطناعي الوكيلي. ويشير مراقبون في القطاع إلى أن هذه الخطوة تأتي في سياق اتجاه أوسع بين “نمور الذكاء الاصطناعي” في الصين، بما في ذلك Moonshot AI وStep AI، اللتين قامتا أيضًا بفتح مصدر نماذج كبيرة لتسريع دورات الابتكار .

معايير الأداء والتحليل المقارن

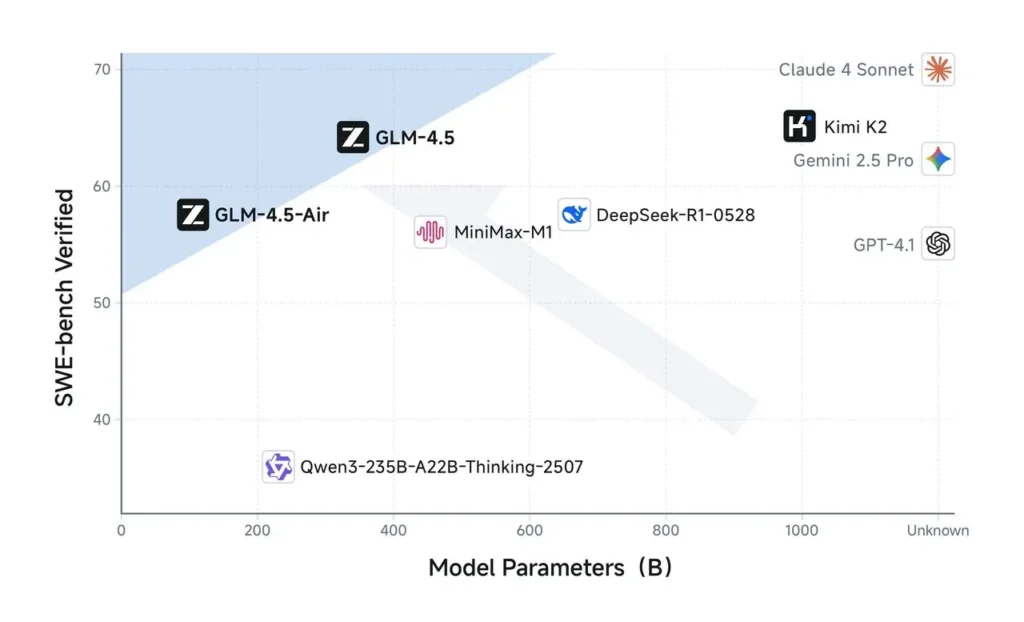

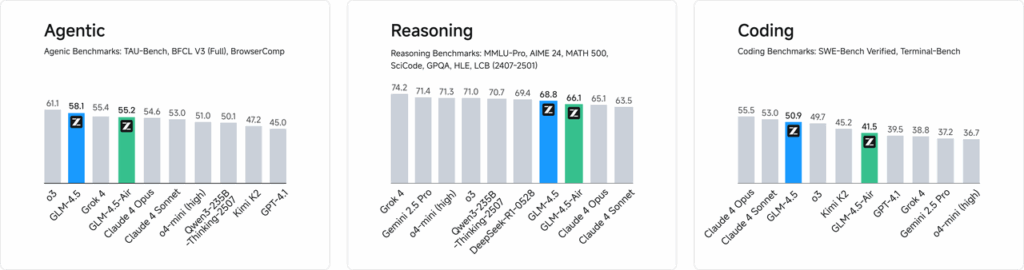

تشير المعايير الأولية التي قدمتها Zhipu AI إلى أن GLM‑4.5 يحقق درجة إجمالية قدرها 63.2 عبر 12 مجموعة تقييم معيارية على مستوى الصناعة—ما يضعه في المرتبة الثالثة بين النماذج مفتوحة المصدر والاحتكارية على حد سواء—في حين يسجل GLM‑4.5‑Air المبسط 59.8، جامعًا بين الكفاءة والدقة العالية. وتُظهر تقييمات البرمجة الداخلية كذلك أن GLM‑4.5 يتفوق على منافسين رئيسيين، محققًا معدل فوز يبلغ 53.9 بالمئة أمام Kimi K2 ومعدل نجاح قدره 80.8 بالمئة مقابل Qwen3‑Coder عبر 52 مهمة برمجية متنوعة .

وسلطت العروض التوضيحية خلال الفعالية المباشرة الضوء على قدرات GLM‑4.5 الوكيلة: إذ أجرى النموذج تلقائيًا أبحاثًا على الويب—مسترجعًا المعلومات من مصادر متعددة ومركّبًا لها—كما تفاعل مع بيئات محاكاة لوسائل التواصل الاجتماعي وبيئات التطوير لإنشاء منشورات، وتنفيذ مقاطع شيفرة، والتعامل مع عناصر واجهة المستخدم في الوقت الفعلي. ويمكن للمستخدمين المهتمين تجربة النموذج الكامل فورًا مجانًا عبر بوابة Qingyan التابعة لـ Zhipu ومنصة CometAPI، بينما يمكن للمطورين الوصول إلى نقاط API النهائية على خدمة BigModel من CometAPI أو تنزيل أوزان النموذج الكاملة من Hugging Face وModelScope بموجب ترخيص MIT .

تُعد الكفاءة من حيث التكلفة ركيزة أساسية في استراتيجية Z.ai. فبعد تدريبه على مجموعة بيانات تضم 15 تريليون رمز، يستفيد GLM‑4.5 من مسارات استدلال مُحسّنة لتقديم معدل إنتاجية يبلغ 100–200 رمز في الثانية—أي أسرع بما يصل إلى ثماني مرات من المنافسين المحليين المماثلين—بسعر معلن لا يتجاوز 0.11 دولار لكل مليون رمز، ما يجعله أقل تكلفة من نماذج مثل DeepSeek‑R1 وأحدث إصدارات Alibaba. وبموجب ترخيص MIT المتساهل، تتوفر جميع أوزان النموذج والشيفرة والوثائق مجانًا عبر Hugging Face، بهدف تعزيز مجتمع عالمي نابض من المطورين والباحثين .

وقال Zhang Peng، الرئيس التنفيذي لشركة Z.ai، في مقابلة مع CNBC: “يجسد GLM‑4.5 التزامنا بإتاحة الوصول إلى تقنيات الذكاء الاصطناعي الرائدة للجميع”. وأضاف: “من خلال فتح مصدر نموذج يتفوق في الاستدلال والبرمجة والوظائف الوكيلة، فإننا نمكّن المؤسسات من أي حجم من الابتكار دون قيود واجهات API الاحتكارية أو التكاليف الباهظة”.

البدء

CometAPI هي منصة API موحدة تجمع أكثر من 500 نموذج ذكاء اصطناعي من مزودين رائدين—مثل سلسلة GPT من OpenAI، وGemini من Google، وClaude من Anthropic، وMidjourney، وSuno، وغير ذلك—ضمن واجهة واحدة سهلة الاستخدام للمطورين. ومن خلال توفير مصادقة متسقة، وتنسيق موحد للطلبات، ومعالجة موحدة للاستجابات، تُبسّط CometAPI بشكل كبير دمج قدرات الذكاء الاصطناعي في تطبيقاتك. وسواء كنت تبني روبوتات محادثة، أو مولدات صور، أو مؤلفات موسيقية، أو مسارات تحليلية قائمة على البيانات، فإن CometAPI تتيح لك التكرار بسرعة أكبر، والتحكم في التكاليف، والبقاء مستقلًا عن أي مزود بعينه—مع الاستفادة في الوقت نفسه من أحدث الاختراقات عبر منظومة الذكاء الاصطناعي.

يمكن للمطورين الوصول إلى API الخاص بـ GLM‑4.5 عبر CometAPI، وإصدارات نماذج claude الأحدث المدرجة هي كما كانت في تاريخ نشر المقال. وللبدء، استكشف قدرات النموذج في Playground وراجع دليل API للحصول على تعليمات مفصلة. وقبل الوصول، يُرجى التأكد من أنك سجلت الدخول إلى CometAPI وحصلت على مفتاح API. وتقدم CometAPI سعرًا أقل بكثير من السعر الرسمي لمساعدتك على التكامل.