OpenAIs GPT-5 blev lanceret i starten af august 2025 og blev hurtigt tilgængelig via flere leveringskanaler. En af de hurtigste måder for teams at eksperimentere med GPT-5 uden at skifte leverandør-SDK'er er CometAPI - en multimodel-gateway, der eksponerer GPT-5 sammen med hundredvis af andre modeller. Denne artikel indeholder praktisk dokumentation, der forklarer... det CometAPI tilbyder, hvordan at kalde GPT-5 igennem det, de afvejninger, du bør evaluere, og praktisk styring og omkostningskontrol, der skal implementeres, før du flytter kritiske arbejdsgange til GPT-5.

Hvad er GPT-5, og hvad adskiller den fra tidligere modeller?

GPT-5 er OpenAIs næste flagskibsfamilie af store sprogmodeller, der blev udgivet i begyndelsen af august 2025. Det præsenteres som et samlet, multimodalt ræsonnementssystem, der kombinerer hurtige ikke-ræsonnementkomponenter, en dybere "ræsonnementsvariant" (ofte omtalt som "GPT-5-tænkning") og en router, der bestemmer, hvilken undermodel der skal bruges, baseret på kompleksitet og nødvendige værktøjer. Nettoeffekten af OpenAI: bedre ræsonnement, større kontekstvinduer og forbedret understøttelse af kodning og agentopgaver.

Arkitektur og nøglefunktioner

- Flerkomponentsystem: GPT-5 beskrives som et system, der sender anmodninger til forskellige interne undermodeller (hurtig vs. dyb ræsonnement) afhængigt af behovet. Udviklere kan anmode om ræsonnementsmodellen via API'en for maksimal ydeevne.

- Stor kontekst: Modelfamilien understøtter ekstremt store kontekster (hundredtusindvis af tokens), hvilket muliggør håndtering af lange dokumenter, kodebaser eller samtaler med flere filer i én gennemgang.

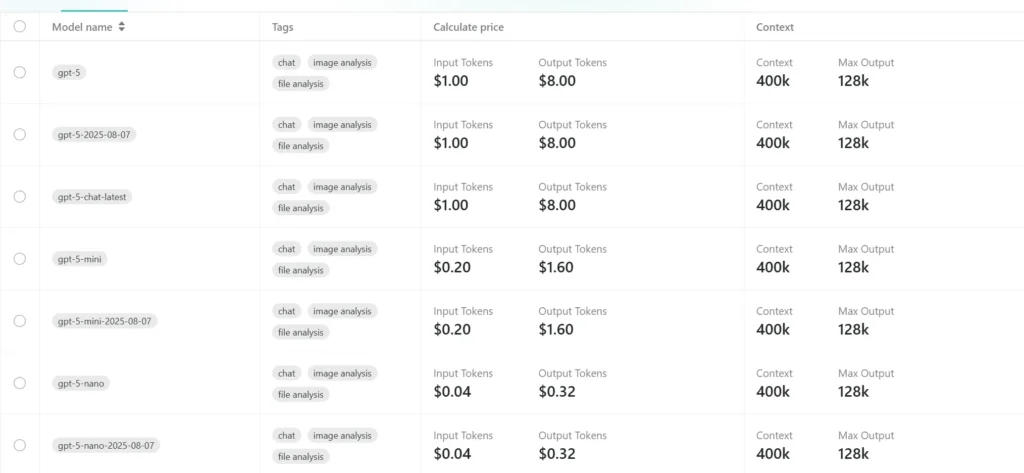

- Familie i flere størrelser: OpenAI har udgivet GPT-5 i flere størrelser (almindelig

gpt-5,gpt-5-mini,gpt-5-nano) så teams kan afveje latenstid, omkostninger og ræsonnementsevne.

Hvad er CometAPI, og tilbyder det rent faktisk GPT-5?

En hurtig definition

CometAPI er en API-aggregeringsplatform, der reklamerer for samlet adgang til hundredvis af AI-modeller (OpenAIs GPT-familier, Anthropic Claude, xAI Grok, billedmodeller og mere) via en enkelt, OpenAI-kompatibel REST-grænseflade. Det betyder, at udviklere kan skifte modeludbydere ved at ændre en modelnavnsstreng i stedet for at omskrive netværkskoden. På sine produktsider angiver CometAPI eksplicit GPT-5 og relaterede varianter (f.eks. gpt-5, gpt-5-chat-latest, gpt-5-mini) som tilgængelige slutpunkter.

Hvorfor teams bruger gateways som CometAPI

Gateway-tjenester som CometAPI er attraktive, fordi de giver dig mulighed for at:

- Byt modeller hurtigt uden at ændre store mængder integrationskode.

- Sammenlign priser og dirigere visse anmodninger til billigere eller hurtigere modelvarianter.

- Samlet fakturering og logføring på tværs af flere modeller og leverandører.

CometAPIs dokumentation giver en simpel migreringssti og en OpenAI-lignende klient (så din eksisterende OpenAI- eller "openai-kompatible" kode ofte kun behøver mindre ændringer).

Hvordan eksponerer CometAPI GPT-5 programmatisk?

CometAPI præsenterer en OpenAI-kompatibel REST API overflade: en basis-URL, Authorization: Bearer <YOUR_KEY>og anmodningstekster svarende til OpenAIs chat/fuldførelses-slutpunkter. For GPT-5 Platformen dokumenterer modelnavne som f.eks. gpt-5, gpt-5-miniog gpt-5-nano og de nævnte slutpunkter inkluderer POST https://api.cometapi.com/v1/chat/completions til chatlignende opkald og /v1/responses for nogle ikke-chatvarianter. Eksempler på konfigurationsdetaljer (basis-URL, headerformat og modelparameter) er offentliggjort i CometAPI-dokumentation og hurtigstartguider.

Typisk slutpunkt og godkendelsesmønster

- Basis URL:

https://api.cometapi.com/v1(eller den dokumenterede/v1/chat/completionstil chat og/v1/responsesfor nogle ikke-chatvarianter.). - Godkendelsesoverskrift:

Authorization: Bearer sk-xxxxxxxxxxxx(CometAPI-problemersk-stiltokens i dashboardet). - Indholdstype:

application/json. - Modelparameter: sæt

modeltilgpt-5, gpt-5-2025-08-07,gpt-5-chat-latest,gpt-5-minieller andre, se model side.

Hvordan kommer jeg i gang med CometAPI og anmoder om GPT-5? (trin for trin)

Nedenfor er et kortfattet og pålideligt onboarding-forløb, som du kan følge i dag.

Trin 1: Tilmeld dig og få en CometAPI-nøgle

- Gå til cometapi.com og opret en konto.

- Fra dit dashboard gå til API-tokens or Personligt center → Tilføj tokenCometAPI udsteder en token i

sk-...format. Opbevar dette sikkert (indlejr ikke nøgler i offentlige arkiver).

Trin 2: Vælg modelstrengen

- Vælg det modelnavn, der passer til dine behov (f.eks.

gpt-5,gpt-5-nano-2025-08-07CometAPI udgiver ofte flere aliasser for hver model, så du kan vælge en afvejning mellem nøjagtighed og omkostninger.

Trin 3: Foretag din første anmodning (krøl)

En minimal curl eksempel der følger det OpenAI-kompatible mønster:

curl -X POST "https://api.cometapi.com/v1/chat/completions" \

-H "Authorization: Bearer sk-YOUR_COMETAPI_KEY" \

-H "Content-Type: application/json" \

-d '{

"model": "gpt-5",

"messages": [{"role":"system","content":"You are a helpful assistant."},

{"role":"user","content":"Summarize the benefits of using a model aggregator."}],

"max_tokens": 500,

"temperature": 0.2

}'

Dette afspejler OpenAIs chat-API-struktur, men peger på CometAPIs basis-URL og bruger din Comet-token.

Trin 4: Python-eksempel (anmodninger)

import requests, os

COMET_KEY = os.getenv("COMETAPI_KEY") # set this in your environment

url = "https://api.cometapi.com/v1/chat/completions"

headers = {

"Authorization": f"Bearer {COMET_KEY}",

"Content-Type": "application/json",

}

payload = {

"model": "gpt-5",

"messages": [

{"role":"system","content":"You are a helpful assistant."},

{"role":"user","content":"List three concrete steps to reduce model hallucination in production."}

],

"max_tokens": 400,

"temperature": 0.1

}

resp = requests.post(url, json=payload, headers=headers, timeout=60)

resp.raise_for_status()

print(resp.json())

udskifte model med gpt-5-nano eller det nøjagtige alias CometAPI-dokumenter for mindre, billigere varianter.

Pris i CometAPI

Hvad er praktiske bedste praksisser og afbødende foranstaltninger til brug i produktion?

Nedenfor er konkrete mønstre til at reducere risiko og forbedre pålideligheden, når du bruger et mellemled som CometAPI.

Start med et lille pilotprojekt og kør side om side-tests

Kør identiske anmodninger til OpenAI (hvis du har direkte adgang) og CometAPI for at sammenligne output, latenstid og omkostninger. Det afslører eventuelle implicitte transformationer, indholdsfiltre eller uoverensstemmelser i modelalias.

Instrument til observerbarhed og kvalitetssikring

Log prompts, returnerede tokens (tilsløret for PII), latenser og fejlkoder. Implementer automatiserede tests for prompt-drift og hallucinationsrater. Spor brugen af modelalias, så migreringer kan revideres.

Beskyt nøglerne og roter dem regelmæssigt

Behandl CometAPI-tokens som enhver API-hemmelighed: gem dem i hemmelighedsadministratorer, roter dem med jævne mellemrum, og tildel tokens til miljøer (udvikling/fase/produktion).

Implementer lagdelt sikkerhed

Brug en kombination af:

- Hurtig ingeniørarbejde at reducere hallucinationer (eksplicitte begrænsninger, struktureret output).

- Efterbehandlingskontroller (faktabekræftelse, blokeringslister, regex-tjek for personligt identificerbare oplysninger).

- Mennesket i løkken for højrisikooutput.

Disse er standard for GPT-5-implementeringer, der håndterer kritisk eller lovligt indhold.

Hvad er almindelige faldgruber, og hvordan løser man problemer med adgang?

Faldgrube: "modellen findes ikke / ingen adgang." Nogle udviklere rapporterer, at modeladgang kan begrænses via udbyderverifikation eller organisationsverifikationstrin, når der bruges direkte udbyder-API'er. Lignende begrænsninger kan forekomme, når aggregatorer proxy-udbydermodeller. Hvis du ser en "model findes ikke"- eller tilladelsesfejl, skal du kontrollere: (a) om din CometAPI-nøgle er gyldig og ikke udløbet, (b) om det anmodede modelnavn nøjagtigt matcher CometAPIs understøttede liste, og (c) om der er yderligere verifikations- eller faktureringstrin, der kræves af den underliggende udbyder. Eller verifikationsrelaterede adgangsfejl og timeout-/tilladelsesanomalier – vær forberedt på at give oplysninger til kontaktpersonalet for at løse dem (e-mail: support@cometapi.com).

Faldgrube: uventet latenstid eller omkostning. Højræsonnementstilstande og store kontekster forårsager latenstid og tokenforbrug. max_tokens, Reducere temperature hvor det er passende, og foretrækker mini varianter til arbejdsbelastninger med høj kapacitet. Overvåg med logføring og alarmering.

Lukningsnotat

CometAPI giver teams en hurtig vej til at eksperimentere med GPT-5-varianter, samtidig med at modeladgang centraliseres, men produktionsbrug kræver den samme disciplin, som man ville anvende på enhver kraftfuld model: sikre nøgler, omhyggelig prompt engineering, overvågning af hallucinationer og gennemgang af politikker/juridiske parametre for følsomme arbejdsbelastninger. Start med et lille pilotprojekt, brug CometAPIs dashboards til at måle tokenforbrug og latenstid, og eskaler kun til varianter med højere argumenter efter at have valideret nøjagtighed og sikkerhed for dit domæne.

Udviklere kan få adgang GPT-5 , GPT-5 Nano og GPT-5 Mini via CometAPI (CometAPI anbefaler /v1/responses), de seneste modelversioner, der er anført, er fra artiklens udgivelsesdato. For at begynde, skal du udforske modellens muligheder i Legeplads og se API-vejledningen for detaljerede instruktioner. Før du får adgang, skal du sørge for at være logget ind på CometAPI og have fået API-nøglen. CometAPI tilbyde en pris, der er langt lavere end den officielle pris, for at hjælpe dig med at integrere.

Se også Sådan bruger du GPT-5's nye parametre og værktøjer

Ofte Stillede Spørgsmål

1. Hvilken GPT-5 modelvariant bør du vælge, og hvad med tokens/priser?

CometAPI viser flere GPT-5-varianter (standard gpt-5, chat-øjebliksbilleder som f.eks. gpt-5-chat-latestog mindre versioner som f.eks. gpt-5-mini/gpt-5-nano). Vælg efter dine behov:

gpt-5/gpt-5-chat-latest— fuld kapacitet til generel chat, bedst til kvalitet og ræsonnement.gpt-5-mini/gpt-5-nano— lavere omkostninger og latenstid for opgaver med høj volumen eller lavere kritiske kriterier.

2. Hvordan bør du strukturere opkald til store kontekster og argumentation af høj kvalitet?

Lang kontekst: GPT-5 understøtter meget store kontekstvinduer. Når du sender store dokumenter, skal du bevidst bruge chunk-input, bruge retrieval augmentation (vektor DB + kontekstvindue), og holde max_tokens for output begrænset for at kontrollere omkostningerne.

3. Hvilke sikkerheds-, privatlivs- og compliance-foranstaltninger bør du anvende?

API-nøglehygiejne. Opbevar nøgler i miljøvariabler, roter dem regelmæssigt, og giv dem et omfang, når det er muligt. Undlad at committe nøgler til arkiver. (Bedste praksis gentages på tværs af udviklervejledninger.)

Dataopbevaring og privatliv. Læs CometAPIs privatlivspolitik og vilkår (og OpenAIs politik), før du sender følsomme personlige, sundhedsmæssige eller regulerede data via en tredjepartsaggregator. Nogle virksomheder vil kræve direkte leverandørkontrakter eller private instanser.

Hastighedsgrænser og kvotebeskyttelse. Implementer afbrydere, eksponentiel backoff og kvotekontroller i produktionen for at forhindre løbende omkostninger og kaskadefejl. CometAPI-dashboards eksponerer brug og kvoter – brug dem til at håndhæve programmatiske grænser.