ByteDances forskningsafdeling Seed har lanceret Seed3D 1.0, en enkeltbillede → højkvalitets 3D-grundmodel, der producerer simuleringsklare meshes, PBR-materialer og justerede teksturer – elementer designet til direkte integration i fysikmotorer og robotsimulatorer. Udgivelsen sigter mod at lukke et smertefuldt hul: skalerbar indholdsgenerering (mangfoldigt visuelt indhold) versus fysiknøjagtighed, der kræves af indlejret AI og simulatortræning.

Hvad er ByteDance Seed3D 1.0?

Seed3D 1.0 er en 3D-fundamentsmodel bygget til at konvertere et enkelt RGB-billede af et objekt eller miljø ind i en simuleringsklar 3D-asset bundle — typisk et eksplicit, vandtæt mesh, tilhørende UV-kortlagte teksturkort og fysisk baserede rendering (PBR) materialeparametre. Modellen er designet ikke kun til at producere visuelt naturtro geometri og teksturer, men også til at udsende aktiver, der kræver minimal efterbehandling, før de bruges i simulatorer som Isaac Sim, Unity eller Unreal Engine til robotteknologi, træning eller generering af virtuelle verdener.

Vigtige designmål på overordnet niveau:

- Enkeltbillede inputFjern behovet for hardware til multiview-optagelse eller scanning.

- SimuleringsparathedSørg for, at topologi, skala og PBR-materialer er egnede til fysisk simulering.

- Scene skalerbarhed: tillader automatisk at genererede objekter samles i sammenhængende scener.

- Integrationminimal tilpasning til almindelige fysikmotorer og runtime-pipelines.

Hvilke funktioner tilbyder Seed3D 1.0?

Højtydende geometri (vandtætte masker)

Seed3D producerer lukket manifoldgeometri Designet til præcis kollisionshåndtering og pålidelig kontaktfysik. Geometrikomponenten bruger en VAE + diffusionstransformerhybrid til at producere detaljeringsniveaubevarende meshes, der bevarer fine strukturelle detaljer såsom tynde fremspring, huller og tekst. Mesh-udtrækningspipelinen bruger en dobbelt marching cubes / hierarkisk iso-surface-strategi til effektivt at udtrække overflader af høj kvalitet. ()

Fotorealistiske teksturer og PBR-materialer

Teksturpipelinen giver konsistente albedokort med flere visninger og fulde PBR-teksturer (albedo, metallisk, ruhed) og kan producere teksturoutput i op til 4K-opløsning. Disse kort er designet, så belysning opfører sig fysisk plausibelt i renderingmotorer. Et UV-indmalingsmodul fuldender okkluderede områder og sikrer rumlig kohærens på tværs af UV-atlaset.

Simulering og pipeline-beredskab

Output kan eksporteres til almindelige formater (OBJ/GLB). Genererede aktiver er bevidst simuleringsklarDe integreres i fysiksimulatorer, hvor kollisionsnet og friktions-/stivhedsparametre kan automatisk udledes eller justeres, hvilket muliggør øjeblikkelig brug i robotteknologi eller spilmotorer. Seed3D demonstrerer arbejdsgange, der placerer genererede aktiver i Isaac Sim til manipulationseksperimenter.

Scenegenerering og faktoriseret assembly

Ud over enkeltstående objekter bruger Seed3D en faktoriseret scenegenereringsmetode, hvor visionssprogsmodeller udleder layoutkort (positioner, skalaer, orienteringer), og Seed3D syntetiserer og placerer objekter i overensstemmelse hermed, hvilket muliggør en sammenhængende scenekomposition til interiører og bylayouts.

Resultat af præstationsevaluering

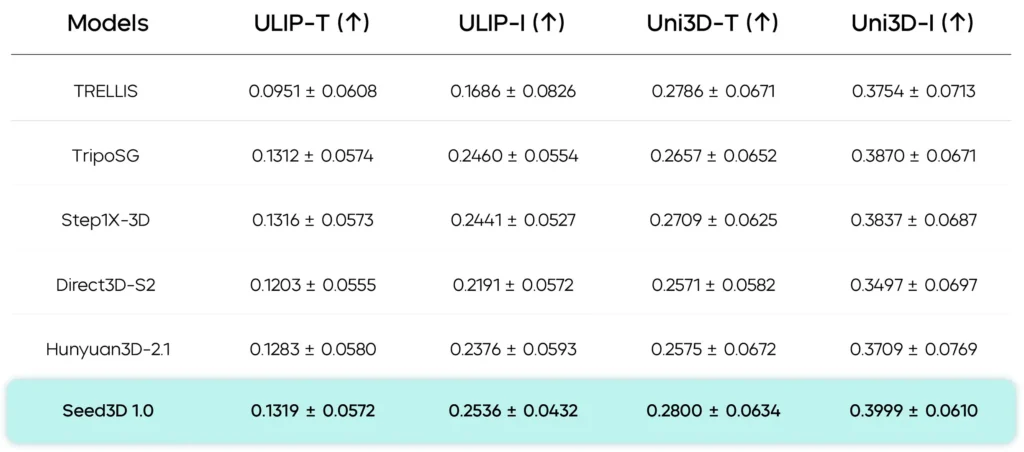

Geometrigenerering

På geometriske benchmarks opnår Seed3D 1.0's geometrimodel med 1.5 milliarder parametre (Seed3D-DiT + VAE) bedre strukturel nøjagtighed og finere detaljer sammenlignet med adskillige baselines (TRELLIS, TripoSG, Step1X-3D, Direct3D-S2 og store modeller som Hunyuan3D-2.1). Seed3Ds arkitektur - latent-space diffusion kombineret med omhyggelig SDF-dekodning og hierarkisk mesh-ekstraktion - giver meshes med færre artefakter og bedre bevarelse af højfrekvent geometri (tekst, små fremspring).

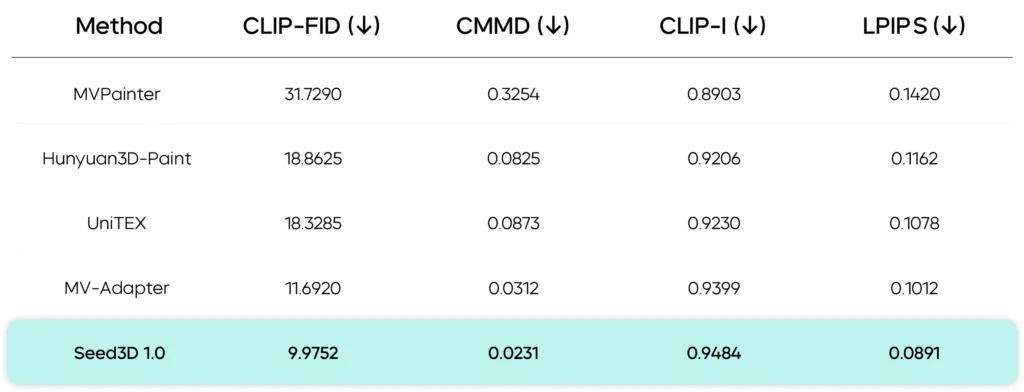

Teksturgenerering

For tekstur- og materialeestimater rapporterer Seed3D betydelige gevinster i justering med referencebilleder og i materialerealisme. Seed3D-PBR-nedbrydningen og Seed3D-UV-indmaling producerer tilsammen UV-atlasser, der bevarer højfrekvente teksturdetaljer og giver sammenhængende PBR-kort (albedo, metallisk, ruhed), der er egnede til fysisk gengivelse.

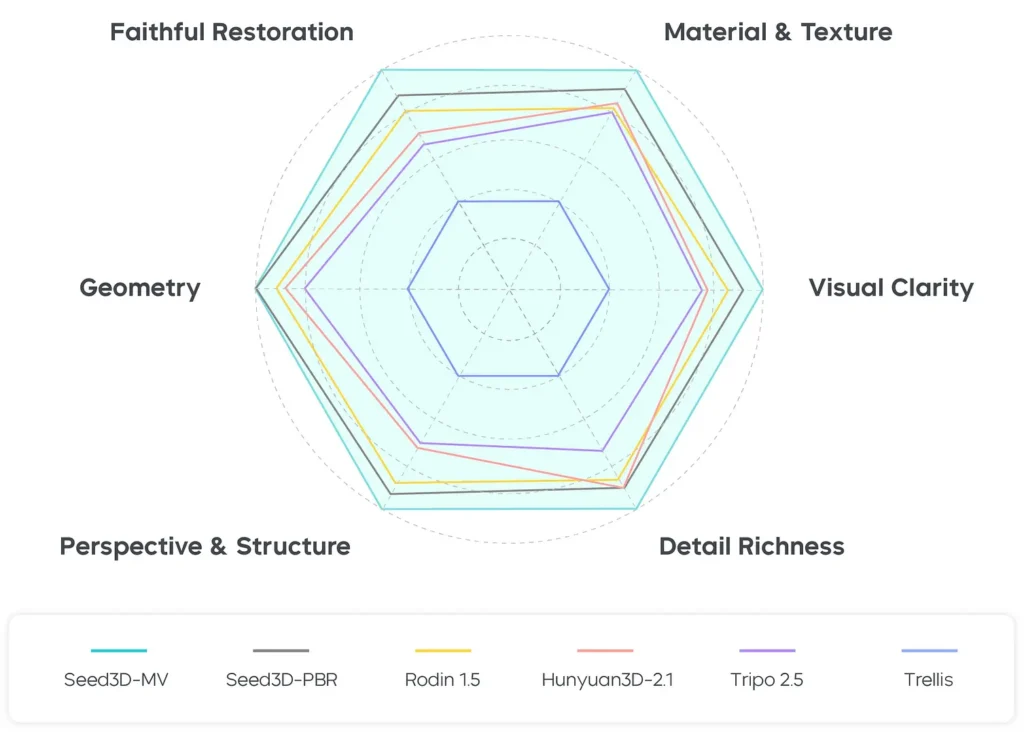

Menneskelig evaluering (brugerundersøgelse)

Artiklen rapporterer en brugerundersøgelse med 14 menneskelige evaluatorer over et testsæt med 43 billeder. Evaluatorerne sammenlignede flere metoder på tværs af dimensioner såsom visuel klarhed, naturtro restaurering, geometrisk nøjagtighed, perspektiv og struktur, materiale- og teksturrealisme samt detaljerigdom. Seed3D 1.0 modtog konsekvent højere subjektive vurderinger på tværs af disse kategorier, med de mest udtalte fordele inden for geometri og materialekvalitet. Det menneskelige studie bekræfter de kvantitative benchmarks og viser, at den opfattede realisme og simuleringsegnethed forbedredes i forhold til basislinjerne.

Hvordan fungerer Seed3D 1.0 (arkitektur og pipeline)?

Seed3D 1.0 er udformet som et flerkomponentsystem, der kombinerer repræsentationer af lært latent geometri, transformerbaseret støjreduktion i latent rum og moduler til flervisning og teksturkomplettering. Designet er bevidst modulært, så hver komponent kan optimeres og opgraderes uafhængigt.

Vigtigste komponenter

**Seed3D-VAE (latent geometri-encoder/dekoder)**Lærer en kompakt latent repræsentation for 3D-geometri (f.eks. TSDF/mesh latent). VAE'en er trænet til at rekonstruere højopløselig, vandtæt geometri fra komprimerede latente koder. Dette giver en effektiv flaskehals til genereringsfasen.

**Seed3D-DiT (diffusionstransformer til geometri)**En ensrettet flow-/støjreducerende transformer (DiT-lignende), der opererer i det latente rum med lært geometri. Betinget af indlejring af et referencebillede, støjreducerer den iterativt latente tokens til en latent geometri, som VAE afkoder til et eksplicit mesh.

**Seed3D-MV (syntese med flere visninger) og Seed3D-UV (teksturfærdiggørelse)**Efter at den indledende geometri er produceret, syntetiserer systemet flere visninger for at reducere okklusionstvetydighed og fuldfører derefter UV-kort via et indmalings-/UV-forbedringsmodul for at producere fulde, sammenhængende teksturer.

**Seed3D-PBR (materialenedbrydning)**Opdeler genererede teksturer i PBR-kort (metalhed, ruhed, normale kort osv.), så fysisk plausible skygge- og kontaktresponser bevares i simuleringen.

Vision-Language-model til scenefaktoriseringTil scenegenerering bruger pipelinen VLM'er til at detektere objekter, forudsige rumlige relationer og producere layoutkort (position, skala, orientering). Individuelle objekter genereres og samles derefter til en scene i henhold til layoutkortet. ()

Inferensflow på højt niveau

- Input: enkelt RGB-billede → billedkoder udtrækker visuel indlejring.

- Geometrigenerering: Seed3D-DiT betinget af indlejrings- og støjdæmpningsgeometriens latenter → Seed3D-VAE afkoder mesh (vandtæt).

- Multi-view-syntese: generer syntetiske visninger fra mesh + render-pipelinen til teksturfærdiggørelse.

- UV og tekstur: Seed3D-UV indmaler okklusioner og producerer komplette UV-kort → Seed3D-PBR nedbryder teksturer til materialekort.

- Eksport: Fremstil .obj/.gltf med teksturer og materialekort, klar til fysikmotorer (kollisionsnet, skalaestimering ved hjælp af VLM).

Scenegenerering

Seed3D genererer ikke kun individuelle objekter, men genererer også automatisk komplette scener.

Generationsproces:

- Input: Et billede, der indeholder flere objekter;

- VLM-modellen identificerer objekterne og de rumlige relationer i billedet;

- Seed3D genererer geometrien og teksturen for hvert objekt;

- Endelig kombineres det rumlige layout til en komplet 3D-scene.

Hvad er begrænsningerne og de åbne udfordringer?

Seed3D 1.0 er et stort skridt, men der er stadig adskillige begrænsninger – både iboende for generering af enkeltbilleder og specifikke for simuleringskontekster:

- Enkeltsyns tvetydighedAt udlede okkluderet geometri og eksakt topologi ud fra én vinkel er fundamentalt forkert formuleret; forudgående data og lært statistik hjælper, men der er stadig fejl for stærkt okkluderede områder.

- Fysisk korrekthed i stor skalaSelvom aktiver er "simuleringsklare" ifølge mange praktiske mål, kræver finkornet masse-/inertistiestimering og leddynamik for komplekse artikulerede systemer stadig domænespecifik justering.

- Sjældne materialer og mikrostrukturMeget spejlende, gennemskinnelige eller anisotrope materialer (f.eks. børstede metaller, stoffer med spredning under overfladen) er sværere at gengive nøjagtigt fra et enkelt billede.

- DatabiasTræningsdatakilder påvirker, hvad modellen indfanger godt — usædvanlige objekter eller kulturelt specifikke artefakter kan gengives dårligt.

- Intellektuel ejendom og etikSom med alle generative systemer skal skabere og organisationer overveje IP og proveniens, når de konverterer ophavsretligt beskyttede billeder til 3D-aktiver.

Applikationsscenario

Seed3D er eksplicit positioneret til indlejret AI og simulering brugsscenarier, men implikationerne spænder over flere brancher:

- Robotik og RL-træningHurtig indholdsgenerering til manipulationsbenchmarks, træningsplaner og domænerandomiserede datasæt til overførsel fra sim til realitet. Aktivernes fysikberedskab reducerer friktion under forbehandling.

- Spiludvikling og XRAccelereret oprettelse af aktiver til prototyper, baggrundsrekvisitter eller hele scener; PBR-arbejdsgangene og 4K-teksturerne er særligt nyttige til oplevelser med høj kvalitet.

- Virtuel produktion og visualiseringHurtig generering af rekvisitter og miljøelementer til konceptudvikling eller prævisualisering.

- Pipelines for indholdsoprettelseDesignere kan iterere fra 2D-referencer (fotos, kunst) til 3D-prototyper meget hurtigere, hvilket muliggør hybride arbejdsgange med mennesker og kunstig intelligens, hvor kunstnere finjusterer output. ()

- ForskningStorskalagenerering af forskellige 3D-træningsdata til vision-sprog-handlingsmodeller og anden multimodal forskning. Artiklen beskriver eksplicit Seed3D som et værktøj til at fremme forskning i simulatorer på verdensplan og kropslig intelligens.

Seed3D kan konvertere et enkelt foto til et detaljeret 3D-objekt, der er egnet til simulering og interaktiv brug, hvilket udvider adgangen til skabelse af 3D-indhold i høj kvalitet.

Konklusion

ByteDances Seed3D 1.0 repræsenterer et vigtigt skridt i retning af skalerbar 3D-generering i simuleringsklasse fra simple 2D-input. Ved at kombinere en fokuseret geometripipeline (VAE + DiT), robust tekstur-/PBR-estimering og UV-komplettering producerer systemet aktiver, der både er fotorealistiske og umiddelbart anvendelige i fysiksimulatorer - en kombination, der adresserer en vedvarende flaskehals for forskning i kropsliggjort AI og mange anvendte pipelines. Modellens rapporterede SOTA-ydeevne (geometri og tekstur) og positive resultater fra menneskelig evaluering gør den til en stærk aktør i det hurtigt udviklende 3D-generative landskab.

Kom godt i gang

CometAPI er en samlet API-platform, der samler over 500 AI-modeller fra førende udbydere – såsom OpenAIs GPT-serie, Googles Gemini, Anthropics Claude, Midjourney, Suno og flere – i en enkelt, udviklervenlig grænseflade. Ved at tilbyde ensartet godkendelse, formatering af anmodninger og svarhåndtering forenkler CometAPI dramatisk integrationen af AI-funktioner i dine applikationer. Uanset om du bygger chatbots, billedgeneratorer, musikkomponister eller datadrevne analysepipelines, giver CometAPI dig mulighed for at iterere hurtigere, kontrollere omkostninger og forblive leverandøruafhængig – alt imens du udnytter de seneste gennembrud på tværs af AI-økosystemet.

Udviklere kan få adgang til 3D-modeller og andre ByteDance-modeller, f.eks. Seedream 4.0 API gennem Comet API, den nyeste modelversion opdateres altid med den officielle hjemmeside. For at begynde, udforsk modellens muligheder i Legeplads og konsulter API guide for detaljerede instruktioner. Før du får adgang, skal du sørge for at være logget ind på CometAPI og have fået API-nøglen. CometAPI tilbyde en pris, der er langt lavere end den officielle pris, for at hjælpe dig med at integrere.

Klar til at gå? → Tilmeld dig CometAPI i dag !

Hvis du vil vide flere tips, guider og nyheder om AI, følg os på VK, X og Discord!