DeepSeek har officielt forhåndsviset V4 som en open-source modelserie, og overskriften er ikke bare “endnu en modelopdatering.” Selskabet positionerer V4 som et lang-kontekst, agentvenligt system bygget til reelle arbejdsbelastninger: dokumenttung analyse, kodeassistenter, søgeagenter og flertrins-automatisering. Udgivelsen er live på web, app og API, og V4-serien introducerer et omkostningseffektivt 1M-token kontekstvindue på tværs af de officielle tjenester.

Det, der gør denne lancering særligt bemærkelsesværdig, er kombinationen af skala og effektivitet. DeepSeek siger, at V4-Pro har 1.6T samlede parametre med 49B aktive, mens V4-Flash har 284B samlede parametre med 13B aktive. I den tekniske rapport hævder DeepSeek også, at V4-arkitekturen bruger hybrid attention, MoE-routing og eftertræning designet til at forbedre agentisk adfærd, samtidig med at beregningsbyrden for ultralang kontekst reduceres.

Hvad er DeepSeek V4?

DeepSeek-V4 er virksomhedens seneste forhåndsviste flagskibsserie, og udgivelsen omfatter to offentlige varianter: V4-Pro og V4-Flash. DeepSeek beskriver V4-Pro som den stærkere model for verdensviden, matematik, STEM, kodning og agentisk kodning, mens V4-Flash er den mere responsive, omkostningseffektive mulighed, der stadig bevarer meget af ræsonneringskvaliteten og lang-kontekst-evnen. V4-Pro fører nuværende åbne modeller inden for agentisk kodning og verdensviden, mens V4-Flash er designet til hastighed og økonomisk udrulning.

V4 bruger en hybrid attention-arkitektur med Compressed Sparse Attention (CSA) og Heavily Compressed Attention (HCA), plus Manifold-Constrained Hyper-Connections og Muon-optimeringsalgoritmen. Selskabet siger også, at modellerne blev prætrænet på mere end 32T tokens, og at V4-Pro ved 1M kontekst kun behøver 27% af single-token inferens-FLOPs og 10% af KV-cachen sammenlignet med DeepSeek-V3.2. Den effektivitetsfortælling er den egentlige overskrift bag udgivelsen.

DeepSeek-V4-Pro vs DeepSeek-V4-Flash

DeepSeek-V4-Pro

V4-Pro er flagskibsmodellen for brugere, der vægter kvalitet højest. DeepSeek-V4-Pro leverer stærkere agentisk kodningsperformance, rigere verdensviden og verdensklasse ræsonnering og fører nuværende åbne modeller, mens den ifølge lanceringssiden kun ligger efter Gemini-3.1-Pro i verdensviden. I den tekniske rapport er V4-Pro den større model i familien, og DeepSeek-V4-Pro er tilgængelig gennem de samme OpenAI-kompatible og Anthropic-kompatible grænseflader som V4-Flash.

DeepSeek-V4-Flash

V4-Flash er modellen med fokus på effektivitet; dens ræsonneringsevner nærmer sig V4-Pro, og den præsterer på linje med V4-Pro på simple agentopgaver, samtidig med at den bruger et mindre parameterfodaftryk og har hurtigere svartider. Den understøtter både tænkning og uden tænkning, med samme 1M kontekstlængde og de samme kernefunktioner som Pro, men til langt lavere omkostninger.

Hvilken skal du vælge?

Brug V4-Pro, når opgaven er højrisiko, videnstung eller svær at verificere: enterprise-forskning, kompleks kodning, flertrins beslutningsstøtte eller opgaver, hvor du ønsker det stærkest mulige svar. Brug V4-Flash, når gennemløb, latency eller token-omkostninger betyder mere end at presse de sidste få point ud af benchmarkperformance. Det valg er i tråd med den officielle positionering og de rapporterede benchmarkforskelle mellem de to modeller.

| Element | DeepSeek-V4-Flash | DeepSeek-V4-Pro |

|---|---|---|

| Samlede parametre | 284B | 1.6T |

| Aktive parametre | 13B | 49B |

| Kontekstlængde | 1M | 1M |

| Ræsonneringstilstande | Uden tænkning + tænkning | Uden tænkning + tænkning |

| Bedst egnet | Hurtig inferens, høj-throughput apps, omkostningsfølsomme agenter | Højeste kapabilitets-ræsonnering, sværere kode- og videnopgaver |

| Officiel API-pris | Cache-hit $0.028 / cache-miss $0.14 / output $0.28 pr. 1M tokens | Cache-hit $0.145 / cache-miss $1.74 / output $3.48 pr. 1M tokens |

| Maks. output | 384K | 384K |

CometAPI giver adgang til Deepseek v4 Pro og V4 Flash,—20% billigere end officielt—plus gnidningsfri switch mellem 500+ modeller (GPT-5.4, Gemini 3.1, osv.) via et enkelt OpenAI-kompatibelt eller Anthropic Messages-endpoint.

Performance-benchmark

DeepSeek-V3.2 vs V4-Flash vs V4-Pro

På sammenligningstabellen for basismodeller overgår både V4-Flash og V4-Pro DeepSeek-V3.2 på centrale benchmarks, hvor V4-Pro som regel fører. For eksempel angiver rapporten følgende score: AGIEval 82.6 / 83.1 vs V3.2’s 80.1; MMLU 88.7 / 90.1 vs 87.8; MMLU-Pro 68.3 / 73.5 vs 65.5; HumanEval 69.5 / 76.8 vs 62.8; og LongBench-V2 44.7 / 51.5 vs 40.2 for V3.2, hvor det midterste tal er V4-Flash og det sidste er V4-Pro.

| Benchmark | DeepSeek-V3.2-Base | DeepSeek-V4-Flash-Base | DeepSeek-V4-Pro-Base |

|---|---|---|---|

| AGIEval (EM) | 80.1 | 82.6 | 83.1 |

| MMLU (EM) | 87.8 | 88.7 | 90.1 |

| MMLU-Pro (EM) | 65.5 | 68.3 | 73.5 |

| HumanEval (Pass@1) | 62.8 | 69.5 | 76.8 |

| LongBench-V2 (EM) | 40.2 | 44.7 | 51.5 |

Kilde: DeepSeek-V4 teknisk rapport, Tabel 1.

Mønsteret er enkelt: Flash indsnævrer afstanden til Pro, men Pro er stadig den stærkere generelle model. Det gør V4-Flash til det praktiske standardvalg for mange produktionssystemer, mens V4-Pro er modellen, man bør vælge, når svar-kvalitet er vigtigere end omkostninger eller latency.

Vestlige model-sammenligninger: hvor V4 passer ind

I en menneskelig evaluering af kinesiske kontoropgaver siger rapporten, at DeepSeek-V4-Pro-Max overgik Claude Opus 4.6-Max, med en 63% ikke-tab-rate. DeepSeek-V4-Pro “overgår markant” Claude Sonnet 4.5 og nærmer sig Claude Opus 4.5 på en FoU-kode-benchmark.

| Evalueringsområde | DeepSeek-resultat | Vestlig model-sammenligning | Hvad det antyder |

|---|---|---|---|

| Kinesiske kontoropgaver | V4-Pro-Max, 63% ikke-tab-rate | vs Claude Opus 4.6-Max | Stærk præstation i praktiske, forretningslignende opgaver |

| FoU-kode-benchmark | V4-Pro-Max beståelsesrate 67 | vs Claude Sonnet 4.5 på 47; Opus 4.5 på 70; Opus 4.6 Thinking på 80 | Konkurrencedygtig med førende frontermodeller, især over for Sonnet-klassens systemer |

Det er ikke “nummer ét på alle områder,” men det er allerede på et niveau, der “må vurderes seriøst.”

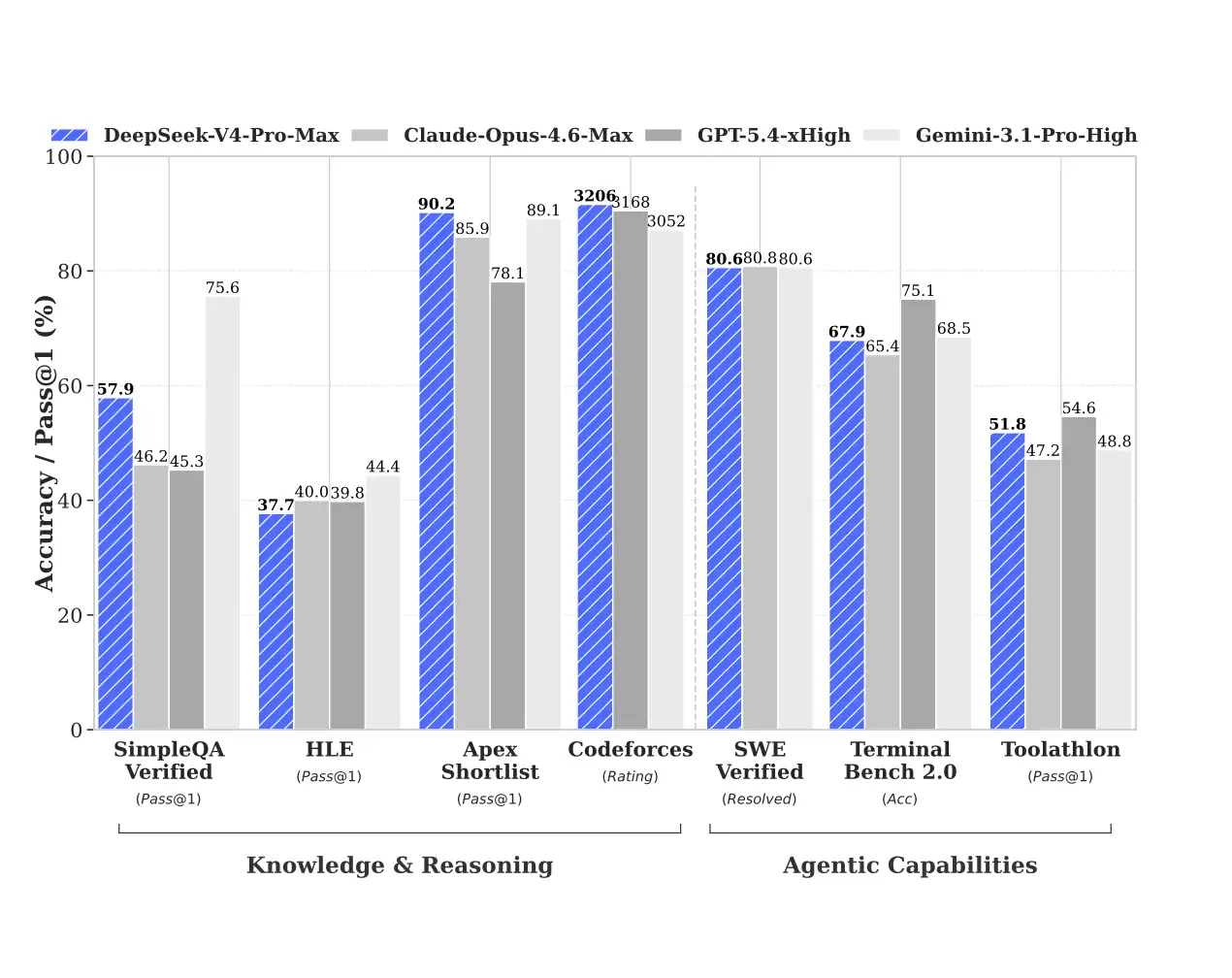

DeepSeeks tekniske rapport sammenligner V4-Pro-Max med Claude Opus 4.6 Max, GPT-5.4 xHigh og Gemini 3.1 Pro High i samme tabel. Resultaterne er ikke simplistiske: Vestlige lukkede modeller præsterer stadig stærkt i nogle videns- og inferensaspekter; dog har V4-Pro-Max en meget stærk tilstedeværelse i kode, lange kontekster og nogle agentopgaver. Med andre ord er det ikke længere en lavdimensionel fortælling om “indenlandske alternativer”, men er gået ind i stadiet “hvad er mest egnet til dit scenarie.”

Når det gælder viden og ræsonneringsevne, er det på linje med Opus 4.6 Max, GPT-5.4 xHigh og Gemini 3.1 Pro High. Dog halter det en smule efter i agentiske kapabiliteter, omend forskellen ikke er betydelig.

DeepSeek-V4-Pro-Max er særdeles konkurrencedygtig i kode-orienterede og lang-kontekst-scenarier, mens de vestlige modeller stadig ser ekstremt stærke ud i flere rene ræsonnerings- og viden-benchmarks. Det er den rigtige læsning af udgivelsen: DeepSeek V4 er solidt med i frontier-samtalen, men benchmark-lederskab afhænger stadig af opgaven.

Sådan får du adgang til DeepSeek V4

1) Brug den officielle web og app

DeepSeek siger, at V4 Preview er tilgængelig lige nu på web, app og API. For normale brugere er den enkleste vej stadig den officielle chatgrænseflade, hvor modellen kan tilgås via Expert Mode eller Instant Mode.

2) Brug API’en

Jeg kan varmt anbefale CometAPI til at tilgå DeepSeek V4, fordi det tilbyder den bedste pris og aggregeringsfordele.

Modelnavnene er:

deepseek-v4-flashdeepseek-v4-pro

DeepSeek siger også, at de ældre navne

deepseek-chatogdeepseek-reasonervil blive udfaset og aktuelt mapper til ikke-tænkning og tænkningstilstande af V4-Flash indtil 2026-07-24. Det er vigtigt for migrationsplanlægning, hvis du allerede har ældre integrationer i produktion.

- Opret en konto hos CometAPI og hent din API-nøgle.

- Brug det standard OpenAI Python SDK (eller enhver kompatibel klient) med en tilpasset base-URL:

Her er et rent eksempel, der bruger det officielle OpenAI-kompatible format:

import os

from openai import OpenAIclient = OpenAI(

api_key=os.environ["cometapi_API_KEY"],

base_url="https://api.cometapi.com"

)response = client.chat.completions.create(

model="deepseek-v4-pro",

messages=[

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": "Summarize the benefits of million-token context."}

],

extra_body={"thinking": {"type": "enabled"}},

reasoning_effort="high"

)print(response.choices[0].message.content)

Det anmodningsmønster følger quick-start-vejledningen: angiv base-URL, vælg deepseek-v4-pro eller deepseek-v4-flash, og aktiver tænkning, når du har brug for dybere ræsonnering.

Sådan bruger du DeepSeek V4 effektivt

Til arbejdsgange med lange dokumenter er det stærkeste mønster at holde konteksten ren og struktureret. V4’s 1M-token-vindue er en stor fordel, men modellen præsterer stadig bedst, når input er organiseret i sektioner, kildeuddrag, opgaveinstruktioner og eksplicitte outputbegrænsninger. Det er den mest naturlige måde at udnytte den lang-kontekst-kapabilitet, som DeepSeek reklamerer for.

Til kode- og agentarbejdsgange: start med V4-Flash for hurtig iteration, og eskalér derefter til V4-Pro til den endelige kørsel eller de mest vanskelige trin. Den tilgang passer til den officielle positionering: Flash er den effektive mulighed, Pro er den stærkere model, og begge deler den samme API-overflade og kontekstlængde.

Afsluttende ord

DeepSeek-V4 er bemærkelsesværdig, fordi den kombinerer fire ting, markedet har efterspurgt samtidigt: lang kontekst, stærk ræsonnering, åben tilgængelighed og aggressiv prissætning. Den virkelige historie er ikke bare, at DeepSeek udgav endnu en model. Det er, at virksomheden forsøger at gøre frontier-stil AI økonomisk anvendelig i produktion. For teams, der vurderer, hvor de skal placere deres næste AI-satsning, er det et signal, der er værd at teste—ikke ignorere.

For teams, der bygger på tværs af flere udbydere, er dette præcis den type udgivelse, der er værd at benchmarke i egen stack. CometAPI kan være det praktiske lag til at sammenligne DeepSeek-V4 side om side med andre frontier-modeller uden at tvinge dit produktteam til at genopbygge integrationen hver gang markedet skifter.