Google DeepMind udgav officielt Gemma 4 den 2. april 2026, hvilket markerer en stor milepæl inden for open source-AI. Denne modelfamilie leverer frontier-niveau intelligens pr. parameter, bygget på den samme forskning og teknologi, der driver Gemini 3. I modsætning til tidligere Gemma-versioner med brugerdefinerede licenser leveres Gemma 4 under en fuldt permissiv Apache 2.0-licens, som muliggør ubegrænset kommerciel brug, modifikation og videredistribution.

Gemma 4 skiller sig ud med sine multimodale kapaciteter (tekst + billedinput i alle størrelser samt lyd på edge-modeller), indbygget understøttelse af avanceret ræsonnering og agentiske arbejdsforløb, lange kontekstvinduer på op til 256K tokens og optimering til alt fra smartphones og Raspberry Pi til high-end GPU’er. Den understøtter over 140 sprog og vægter effektivitet, så kraftfuld AI bliver tilgængelig på forbruger- og edge-hardware uden afhængighed af skyen.

CometAPI leverer fremragende API’er til både open source- og lukket kilde-modeller.

Hvad er Gemma 4?

Gemma 4 er Google DeepMind’s nyeste familie af åbne multimodale store sprogmodeller (LLM’er), målrettet avanceret ræsonnering, agentiske AI-arbejdsgange og effektiv on-device-udrulning. Den maksimerer “intelligens pr. parameter” ved at udnytte indsigter fra proprietær Gemini 3-forskning, samtidig med at den forbliver fuldt open weight og open source.

Vigtige fremskridt i forhold til tidligere Gemma-modeller omfatter:

- Indbygget multimodalitet: Forståelse af tekst + billeder (alle modeller), med lydunderstøttelse på mindre edge-varianter.

- Konfigurerbar tænketilstand: Trin-for-trin ræsonnering med struktureret <|think|>-output.

- Indbygget funktionskald og værktøjsbrug: Ideel til autonome agenter.

- Udvidet kontekst: Op til 256K tokens på større modeller.

- Hybrid attention-arkitektur: Kombinerer lokal sliding-window og global attention for effektivitet og lang-kontekst-ydelse.

- Per-Layer Embeddings (PLE) i mindre modeller og delt KV-cache for hukommelsesbesparelser.

- Bred flersproget understøttelse: Forudtrænet på data, der dækker 140+ sprog med kulturel nuancebevidsthed.

Udgivet under Apache 2.0 fjerner Gemma 4 de tidligere licensbegrænsninger, som hæmmede virksomhedsadoption. Udviklere kan nu finjustere, udrulle og kommercialisere uden friktion—hvilket positionerer den som en direkte konkurrent til fuldt åbne økosystemer som Llama og Qwen.

Gemma 4 sigter mod forskelligartet hardware: edge-enheder (telefoner, IoT, Raspberry Pi, Jetson Nano) for lav-latens offline-AI, og workstations/GPU’er for højtydende lokale servere. Dette “local-first”-design prioriterer privatliv, omkostningsbesparelser og nul-latenstid inferens.

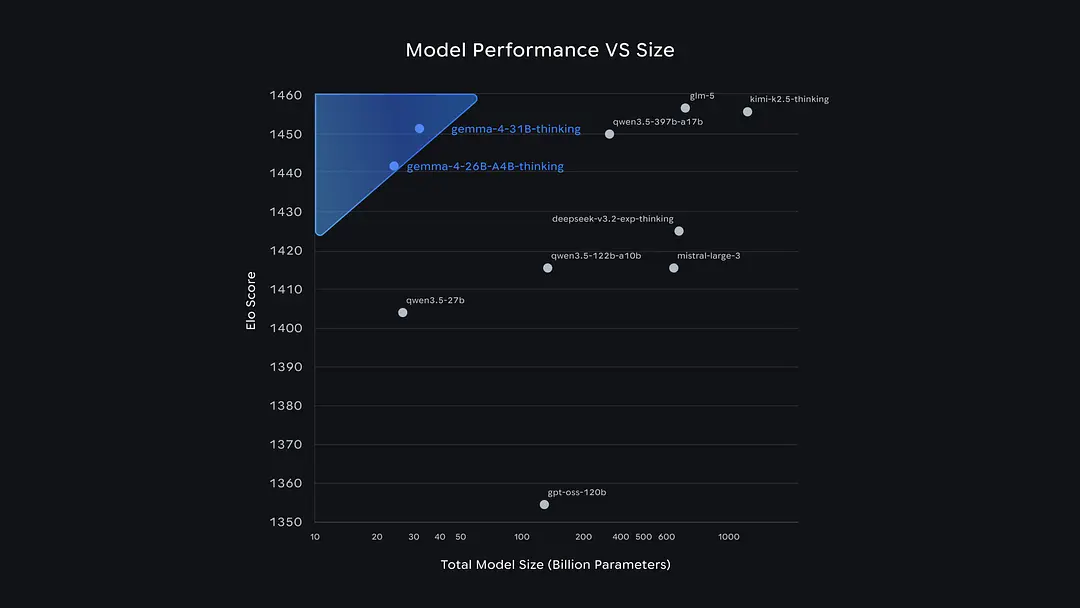

De open source-modeller, der ligger foran den på Arena-leaderboardet, er primært fra kinesiske teams. Gemma 4 adskiller sig ikke meget fra Qwen 3.5 og GLM-5, men den er markant anderledes end OpenAI’s GPT-OSS-120B.

Udviklere kan nu finde GLM-5, Qwen 3.5 osv. på CometAPI.

De fire versioner af Gemma 4

Google udgav Gemma 4 i fire omhyggeligt optimerede størrelser, som hver balancerer ydeevne, effektivitet og udrulningsscenarier. To anvender tætte arkitekturer med innovative Per-Layer Embeddings (PLE) for edge-effektivitet; én er en Mixture-of-Experts (MoE) for høj ydeevne med lavt antal aktive parametre; og én er en tæt flagskibsmodel.

| Model | Architecture | Total Params | Active Params (MoE) | Effective Params | Context Length | Modalities | Target Hardware |

|---|---|---|---|---|---|---|---|

| Gemma 4 E2B | Dense + PLE | ~5.1B (inkl. embeddings) | N/A | 2.3B | 128K | Tekst, Billede, Lyd | Smartphones, Raspberry Pi, edge-IoT |

| Gemma 4 E4B | Dense + PLE | ~8B (inkl. embeddings) | N/A | 4.5B | 128K | Tekst, Billede, Lyd | Mobile enheder, letvægts-GPU’er, Jetson |

| Gemma 4 26B A4B | MoE (8 aktive / 128 total + 1 fælles) | 25.2B | 3.8B–4B | N/A | 256K | Tekst, Billede | Workstations, forbruger-GPU’er, lokale servere |

| Gemma 4 31B | Dense | 30.7B | N/A | N/A | 256K | Tekst, Billede | High-end GPU’er (passer på enkelt H100/A100 i FP16) |

Gemma 4 E2B og E4B (edge-optimeret): Bruger PLE til at tilføje per-lagspecialisering med minimal parameter-overhead. Ideel til batteridrevne eller hukommelsesbegrænsede enheder. Lyd-enkoder (USM-stil Conformer, ~300M parametre) muliggør tale-til-tekst og oversættelse.

Gemma 4 26B A4B (MoE): Aktiverer kun ~4B parametre under inferens på trods af samlet størrelse på 25B+. Leverer næsten 31B-ydeevne til dramatisk lavere beregningsomkostning—perfekt til omkostningseffektiv skalering.

Gemma 4 31B (Dense): Flagskibet for maksimal kapabilitet. Passer på en enkelt 80GB GPU i fuld præcision og rangerer blandt de bedste åbne modeller på leaderboards.

Alle modeller inkluderer instruktions-tunede (“-it”) varianter optimeret til chat, ræsonnering og værktøjsbrug, plus forudtrænede basisversioner til finjustering. De to store modeller går hver sin vej: 31B Dense-modellen jagter ultimativ kvalitet og er den bedste base for finjustering; 26B MoE-modellen prioriterer hastighed og aktiverer kun 3,8 milliarder parametre under inferens, hvilket giver langt hurtigere ordgenerering, men med en lidt lavere samlet kvalitet.

De to mindre modeller, E2B og E4B, er specifikt designet til mobiltelefoner og IoT-enheder: De kan køre helt offline og spare hukommelse og strøm. Desuden har disse mindre modeller en kapabilitet, som de større modeller mangler: indbygget lydinput, der muliggør direkte talegenkendelse.

Kernekapabiliteter i Gemma 4

Gemma 4 excellerer på områder, der betyder mest for AI-applikationer i virkeligheden:

1. Avanceret ræsonnering og tænketilstand

Konfigurerbar trin-for-trin-ræsonnering via systemprompter eller enable_thinking=True. Giver strukturerede <|think|>-tags efterfulgt af endelige svar. Forbedrer præstationen markant på komplekse opgaver uden ekstra finjustering.

2. Multimodal forståelse

- Vision: Objektgenkendelse (JSON-bounding boxes), OCR (flersproget), dokument/PDF-parsing, diagramforståelse, UI-forståelse, håndskriftgenkendelse og variabel opløsningsbilledhåndtering (token-budgetter: 70–1120 tokens).

- Video: Op til 60 sekunder (1 fps frame-behandling).

- Lyd (kun E2B/E4B): Automatisk talegenkendelse (ASR) og tale-til-tekst-oversættelse (maks. 30s).

- Blandede input: Bland tekst, billeder og lyd i vilkårlig rækkefølge.

3. Agentiske arbejdsforløb og funktionskald

Indbygget understøttelse af værktøjsbrug muliggør autonome agenter til flertrinsplanlægning, API-kald, appnavigation og opgaveløsning. Stærk på τ2-bench (agentisk værktøjsbrug).

4. Kodning og udviklerværktøjer

Fremragende kodegenerering, -komplettering, debugging og forståelse på repository-niveau. Understøtter JSON-strukturerede output for problemfri integration. Scorer 80,0 % (31B) på LiveCodeBench v6 og positionerer sig som en local-first AI-programmeringsassistent egnet til offline-udviklingsscenarier.

5. Lang kontekst og flersprogethed

Håndterer pålideligt 128K–256K tokens (testet på MRCR needle-in-haystack). Forudtrænet på diverse data frem til cut-off januar 2025 med stærk tværsproglig ydeevne. Dette er ikke blot flersproget oversættelse; den er nativt trænet og dækker over 140 sprog.

Benchmarkdata: Gemma 4-ydelsesopdeling

Gemma 4 sætter nye standarder for åbne modeller. 31B- og 26B-varianterne leverer scores, der tidligere var forbeholdt meget større proprietære systemer, mens edge-modeller overgår Gemma 3’s større forgænger.

Fuldstændige benchmarkresultater (instruktions-tunede modeller)

| Benchmark | Category | Gemma 4 31B | Gemma 4 26B A4B | Gemma 4 E4B | Gemma 4 E2B | Gemma 3 27B (no think) |

|---|---|---|---|---|---|---|

| MMLU Pro | Ræsonnering & viden | 85.2% | 82.6% | 69.4% | 60.0% | 67.6% |

| AIME 2026 (no tools) | Matematik | 89.2% | 88.3% | 42.5% | 37.5% | 20.8% |

| GPQA Diamond | Videnskab (kandidatniveau) | 84.3% | 82.3% | 58.6% | 43.4% | 42.4% |

| Tau2 (avg) | Agentisk værktøjsbrug | 76.9% | 68.2% | 42.2% | 24.5% | 16.2% |

| LiveCodeBench v6 | Kodning | 80.0% | 77.1% | 52.0% | 44.0% | 29.1% |

| Codeforces ELO | Konkurrenceprogrammering | 2150 | 1718 | 940 | 633 | 110 |

| MMMU Pro | Multimodal ræsonnering | 76.9% | 73.8% | 52.6% | 44.2% | 49.7% |

| MATH-Vision | Matematik + vision | 85.6% | 82.4% | 59.5% | 52.4% | 46.0% |

| MRCR v2 (8-needle, 128K) | Lang kontekst | 66.4% | 44.1% | 25.4% | 19.1% | 13.5% |

Vigtige indsigter:

- Massivt spring fra Gemma 3: 31B-modellen forbedrer AIME-matematik fra 20.8% til 89.2% og LiveCodeBench fra 29.1% til 80.0%.

- MoE-effektivitet: 26B A4B matcher næsten 31B, mens den bruger langt færre beregninger under inferens.

- Edge-dominans: E4B og E2B overgår Gemma 3 27B på mange metrikker trods at være 6–10x mindre.

- Leaderboard-placeringer: 31B scorer ~1452 på Arena AI (tekst); 26B A4B ~1441. 26B-varianten overgår efter sigende langt større modeller som Qwen 3.5 397B i brugerpræference og kodning.

Vision- og lydbenchmarks bekræfter stærk multimodal ydeevne direkte ud af boksen uden specialiseret finjustering.

Økosystem og værktøjsunderstøttelse

Gemma 4 nyder øjeblikkelig, bred økosystemintegration:

- Hugging Face: Dag 1-understøttelse med

transformers,pipeline("any-to-any"), GGUF, ONNX og multimodale processorer. - Lokale runtimes: Ollama, Llama.cpp (LM Studio, Jan), MLX (Apple Silicon med TurboQuant), Mistral.rs (Rust), Transformers.js (WebGPU-browserinferens).

- Finjustering: TRL, Unsloth, PEFT, Vertex AI og understøttelse af multimodale datasæt.

- Hardwareoptimering: NVIDIA RTX/DGX Spark/Jetson (via TensorRT-LLM), Google AI Edge-værktøjer og on-device-udrulning på Android/iOS.

- Agent-rammeværk: OpenClaw, Hermes, Pi og CARLA-simulationstest.

- Cloud/Studio: Google AI Studio til hurtige tests; Kaggle Models til download.

Dette økosystem gør Gemma 4 udrullelig på få minutter på laptops, servere eller edge-enheder.

Begrænsninger og sikkerhed:

- Træningsdata cut-off: januar 2025 (ingen viden i realtid uden værktøjer).

- Lyd begrænset til tale (ikke musik); video begrænset til 60 sekunder.

- Risiko for hallucinationer består—brug tænketilstand og verifikation.

- Sikkerhed: Omfattende filtrering og evaluering i henhold til Google AI-principper; udviklere bør tilføje applikationsspecifikke værn.

Hvorfor Gemma 4 betyder noget i 2026

Gemma 4 demokratiserer frontier-AI. Ved at kombinere multimodal intelligens, agentiske kapabiliteter og Apache 2.0-frihed med hardware-agnostisk effektivitet giver den udviklere og virksomheder mulighed for at bygge sikre, private og omkostningseffektive AI-løsninger i stor skala. Gennembruddet i intelligens pr. parameter—særligt tydeligt i edge-modeller, der overgår gårsdagens åbne flagskibsmodeller—varsler et skifte mod virkelig allestedsnærværende AI.

Uanset om du kører en 2B-model på en telefon eller en 31B-kraftpakke lokalt, beviser Gemma 4, at open source-AI har indhentet (og i mange tilfælde overgået) lukkede alternativer i praktisk nytte.