pr. 15. december 2025 viser offentlige fakta, at både Google’s Gemini 3 Pro (preview) og OpenAI’s GPT-5.2 sætter nye grænser for ræsonnering, multimodalitet og lang-kontekst-arbejde — men de vælger forskellige ingeniørveje (Gemini → sparse MoE + enorm kontekst; GPT-5.2 → tætte/“routing”-designs, kompaktion og x-high reasoning-tilstande) og afvejer derfor mellem topplaceringer i benchmarks vs. ingeniørmæssig forudsigelighed, tooling og økosystem. Hvad der er “bedst” afhænger af dit primære behov: ekstrem-kontekst, multimodale agentiske applikationer hælder mod Gemini 3 Pro; stabilt enterprise-udviklerværktøj, forudsigelige omkostninger og øjeblikkelig API-tilgængelighed favoriserer GPT-5.2.

Hvad er GPT-5.2, og hvad er dets vigtigste funktioner?

GPT-5.2 er OpenAI’s udgivelse den 11. december 2025 i GPT-5-familien (varianter: Instant, Thinking, Pro). Den positioneres som virksomhedens mest kapable model til “professionelt vidensarbejde” — optimeret til regneark, præsentationer, lang-kontekst-ræsonnering, værktøjskald, kodegenerering og vision-opgaver. OpenAI gjorde GPT-5.2 tilgængelig for betalende ChatGPT-brugere og via OpenAI API (Responses API / Chat Completions) under modelnavne som gpt-5.2, gpt-5.2-chat-latest og gpt-5.2-pro.

Modelvarianter og tilsigtet brug

- gpt-5.2 / GPT-5.2 (Thinking) — bedst til kompleks, flertrins ræsonnering (standardvarianten “Thinking”, der bruges i Responses API).

- gpt-5.2-chat-latest / Instant — lavere latenstid til daglig assistent- og chatbrug.

- gpt-5.2-pro / Pro — højeste nøjagtighed/pålidelighed til de sværeste problemer (ekstra compute, understøtter

reasoning_effort: "xhigh").

Nøgletekniske funktioner (brugerrettede)

- Forbedret vision og multimodalitet — bedre rumlig ræsonnering på billeder og forbedret videoforståelse sammen med kodetools (Python-værktøj), plus støtte for tools i stil med code-interpreter til at køre snippets.

- Konfigurerbar ræsonneringsindsats (

reasoning_effort: none|minimal|low|medium|high|xhigh) til at afveje latenstid/omkostning mod dybde.xhigher nyt for GPT-5.2 (og understøttes på Pro). - Forbedret lang-kontekst-håndtering og kompaktionsegenskaber til at ræsonnere over hundredtusinder af tokens (OpenAI rapporterer stærke MRCRv2-/lang-kontekst-metrics).

- Avanceret tool calling og agentiske workflows — stærkere multi-turn koordination, bedre orkestrering af værktøjer på tværs af en “single mega-agent”-arkitektur (OpenAI fremhæver Tau2-bench-værktøjsperformance).

Hvad er Gemini 3 Pro Preview?

Gemini 3 Pro Preview er Googles mest avancerede generative AI-model, udgivet som en del af den bredere Gemini 3-familie i november 2025. Modellen er bygget med fokus på multimodal forståelse—i stand til at forstå og syntetisere tekst, billeder, video og lyd—og har et stort kontekstvindue (~1 million tokens) til at håndtere omfattende dokumenter eller kodebaser.

Google positionerer Gemini 3 Pro som state-of-the-art i ræsonneringsdybde og nuancer, og den fungerer som kerne-motoren for flere udvikler- og virksomhedsværktøjer, herunder Google AI Studio, Vertex AI og agentiske udviklingsplatforme som Google Antigravity.

Per nu er Gemini 3 Pro i preview—hvilket betyder, at funktionalitet og adgang stadig udvides, men modellen rangerer allerede højt på logik, multimodal forståelse og agentiske workflows.

Centrale tekniske og produktfunktioner

- Kontekstvindue: Gemini 3 Pro Preview understøtter et 1.000.000-tokens input-kontekstvindue (og op til 64k tokens output), hvilket er en stor praktisk fordel til indtag af ekstremt store dokumenter, bøger eller videotransskripter i én forespørgsel.

- API-funktioner: parameteren

thinking_level(low/high) til at afveje latenstid og ræsonneringsdybde;media_resolution-indstillinger til at styre multimodal fidelitet og tokenforbrug; søge-grounding, fil/URL-kontekst, kodeeksekvering og funktionskald understøttes. Thought signatures og context caching hjælper med at opretholde state på tværs af fler-kalds-workflows. - Deep Think-tilstand / højere ræsonnering: En “Deep Think”-mulighed giver et ekstra ræsonneringspass for at hæve scorer på svære benchmarks. Google udgiver Deep Think som en separat højtydende vej til komplekse problemer.;

- Native multimodal understøttelse: Tekst-, billede-, lyd- og video-input med tæt grounding til søgning og produktintegrationer (Video-MMMU-scorer og andre multimodale benchmarks fremhæves).

Hurtigt overblik — GPT-5.2 vs Gemini 3 Pro

Kompakt sammenligningstabel med de vigtigste fakta (kilder angivet).

| Aspekt | GPT-5.2 (OpenAI) | Gemini 3 Pro (Google / DeepMind) |

|---|---|---|

| Leverandør / positionering | OpenAI — flagskib i GPT-5.x-opgraderingen med fokus på professionelt vidensarbejde, kodning og agentiske workflows. | Google DeepMind / Google AI — flagskib i Gemini-generationen med fokus på ultralang-kontekst multimodal ræsonnering og værktøjsintegration. |

| Primære modelvarianter | Instant, Thinking, Pro (og Auto, der skifter mellem dem). Pro tilføjer højere ræsonneringsindsats. | Gemini 3-familien inkl. Gemini 3 Pro og Deep-Think-tilstande; fokus på multimodalitet/agentik. |

| Kontekstvindue (input / output) | ~400.000 tokens samlet inputkapacitet; op til 128.000 output-/reasoning-tokens (designet til meget lange dokumenter og kodebaser). | Op til ~1.000.000 tokens input/kontekstvindue (1M) med op til 64K-tokens output |

| Nøglestyrker / fokus | Lang-kontekst-ræsonnering, agentisk værktøjskald, kodning, strukturerede kontoropgaver (regneark, præsentationer); safety/system-kort opdateringer fremhæver robusthed. | Multimodal forståelse i skala, ræsonnering + billedkomposition, meget stor kontekst + “Deep Think”-tilstand, stærke værktøjs-/agent-integrationer i Google-økosystemet. |

| Multimodale og billedfunktioner | Forbedret vision og multimodal grounding; tunet til værktøjsbrug og dokumentanalyse. | Højfidel billedgenerering + ræsonneringsforstærket komposition, multi-reference billedredigering og læselig tekstrendering. |

| Latens / interaktivitet | Leverandøren fremhæver hurtigere inferens og prompt-respons (lavere latenstid end tidligere GPT-5.x-modeller); flere niveauer (Instant / Thinking / Pro). | Google fremhæver optimeret “Flash”/serving og sammenlignelige interaktive hastigheder i mange flows; Deep Think-tilstand afvejer latenstid mod dybere ræsonnering. |

| Bemærkelsesværdige differentieringer | Ræsonneringsindsats-niveauer (medium/high/xhigh), forbedret værktøjskald, højkvalitets kodegenerering, høj token-effektivitet til enterprise-workflows. | 1M token-kontekst, stærk native multimodal indtag (video/lyd), “Deep Think”-tilstand, tætte Google-produktintegrationer (Docs/Drive/NotebookLM). |

| Typiske bedste anvendelser (kort) | Langdokument-analyse, agentiske workflows, komplekse kodeprojekter, enterprise-automatisering (regneark/rapporter). | Ekstremt store multimodale projekter, langhorisont-agentiske workflows, der kræver 1M-tokens kontekst, avancerede billede + ræsonnerings-pipelines. |

Hvordan sammenlignes GPT-5.2 og Gemini 3 Pro arkitektonisk?

Kernearkitektur

- Benchmarks / evalueringer i virkelige opgaver: GPT-5.2 Thinking opnåede 70,9 % wins/ties på GDPval (44-erhverv vidensarbejds-evaluering) og store gevinster på ingeniør- og matematik-benchmarks vs. tidligere GPT-5-varianter. Markante forbedringer i kodning (SWE-Bench Pro) og domænevidenskab QA (GPQA Diamond).

- Værktøjer og agenter: Indbygget stærk støtte til værktøjskald, Python-eksekvering og agentiske workflows (dokumentsøgning, filanalyse, data science-agenter). 11x hastighed / <1 % omkostning vs. menneskelige eksperter for nogle GDPval-opgaver (mål for potentiel økonomisk værdi, 70,9 % vs. tidligere ~38,8 %), og viser konkrete gevinster i regnearksmodellering (f.eks. +9,3 % på en junior investment banking-opgave vs. GPT-5.1).

- Gemini 3 Pro: Sparse Mixture-of-Experts Transformer (MoE). Modellen aktiverer et lille sæt eksperter pr. token, hvilket muliggør ekstremt stor samlet parameterkapacitet med sublineær pr.-token compute. Google offentliggør et modelkort, der tydeliggør, at Sparse MoE-designet er en kernebidragsyder til den forbedrede performanceprofil. Denne arkitektur gør det muligt at skubbe modelkapaciteten langt højere uden lineære inferensomkostninger.

- GPT-5.2 (OpenAI): OpenAI fortsætter med Transformer-baserede arkitekturer med routing/kompaktion-strategier i GPT-5-familien (en “router” udløser forskellige tilstande — Instant vs. Thinking — og virksomheden dokumenterer kompaktion og token-håndteringsteknikker til lange kontekster). GPT-5.2 lægger vægt på træning og evaluering til at “tænke før svar” samt kompaktion til langhorisont-opgaver frem for at annoncere klassisk sparse-MoE i skala.

Konsekvenser af arkitekturerne

- Latens- og omkostningsafvejninger: MoE-modeller som Gemini 3 Pro kan tilbyde højere spidskapabilitet pr. token samtidig med lavere inferensomkostninger for mange opgaver, fordi kun et delmængde af eksperter kører. De kan dog tilføje kompleksitet i serving og planlægning (cold-start ekspert-balancering, IO). GPT-5.2’s tilgang (tæt/routet med kompaktion) favoriserer forudsigelig latenstid og udviklerergonomi — især når den integreres i etablerede OpenAI-værktøjer som Responses, Realtime, Assistants og batch-API’er.

- Skalering af lang kontekst: Geminis 1M input-token-kapabilitet lader dig fodre ekstremt lange dokumenter og multimodale strømme nativt. GPT-5.2’s ~400k kombinerede kontekst (input+output) er stadig enorm og dækker de fleste enterprise-behov, men er mindre end Geminis 1M-spec. Til meget store korpora eller multi-timers videotransskripter giver Geminis specifikation en klar teknisk fordel.

Tooling, agenter og multimodal infrastruktur

- OpenAI: dyb integration for værktøjskald, Python-eksekvering, “Pro”-ræsonneringstilstande og betalte agent-økosystemer (ChatGPT Agents / enterprise-værktøjsintegrationer). Stærkt fokus på kodecentriske workflows og generering af regneark/slides som førsteklasses outputs.

- Google / Gemini: indbygget grounding til Google Søgning (valgfri, faktureret funktion), kodeeksekvering, URL- og filkontekst samt eksplicit kontrol af medieopløsning for at afveje tokens mod visuel fidelitet. API’et tilbyder

thinking_levelog andre knapper til at justere omkostning/latenstid/kvalitet.

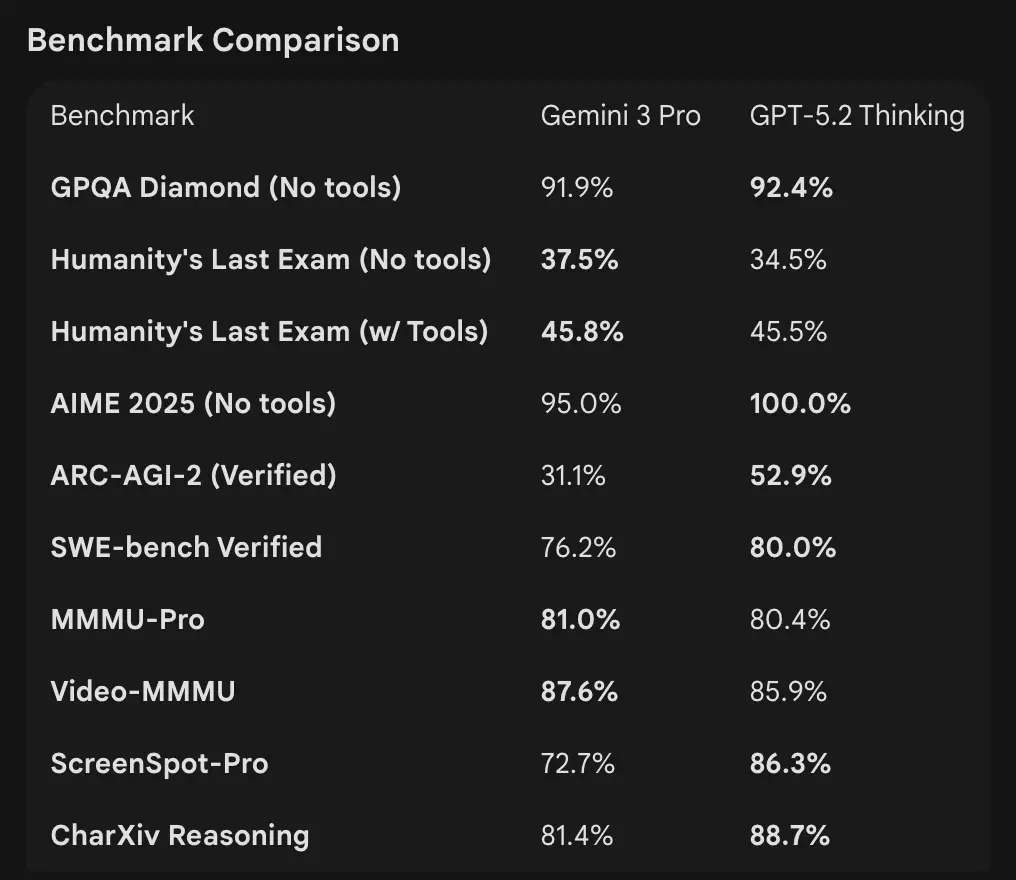

Hvordan sammenlignes benchmark-tallene

Kontekstvinduer og token-håndtering

- Gemini 3 Pro Preview: 1.000.000 input-tokens / 64k output-tokens (Pro preview modelkort). Knowledge cutoff: januar 2025 (Google).

- GPT-5.2: OpenAI demonstrerer stærk lang-kontekst-performance (MRCRv2-scorer på tværs af 4k–256k needle-opgaver med >85–95 % i mange indstillinger) og bruger kompaktion; OpenAI’s offentlige konteksteksempler indikerer robust performance selv ved meget store kontekster, men OpenAI lister variantspecifikke vinduer (og fremhæver kompaktion frem for et enkelt 1M-tal). Til API-brug er modelnavne

gpt-5.2,gpt-5.2-chat-latest,gpt-5.2-pro.

Reasoning- og agent-benchmarks

- OpenAI (udvalgt): Tau2-bench Telecom 98,7 % (GPT-5.2 Thinking), stærke gevinster i flertrins værktøjsbrug og agentiske opgaver (OpenAI fremhæver kollaps af multi-agent-systemer til en “mega-agent”). GPQA Diamond og ARC-AGI viste trinvis fremgang over GPT-5.1.

- Google (udvalgt): Gemini 3 Pro: LMArena 1501 Elo, MMMU-Pro 81 %, Video-MMMU 87,6 %, høje GPQA- og Humanity’s Last Exam-scorer; Google demonstrerer også stærk langhorisont-planlægning via agentiske eksempler.

Værktøjer og agenter:

GPT-5.2: Indbygget stærk støtte til værktøjskald, Python-eksekvering og agentiske workflows (dokumentsøgning, filanalyse, data science-agenter). 11x hastighed / <1 % omkostning vs. menneskelige eksperter for nogle GDPval-opgaver (mål for potentiel økonomisk værdi, 70,9 % vs. tidligere ~38,8 %), og viser konkrete gevinster i regnearksmodellering (f.eks. +9,3 % på en junior investment banking-opgave vs. GPT-5.1).

Fortolkning: benchmarks er komplementære — OpenAI fremhæver realistiske vidensarbejds-benchmarks (GDPval), der viser, at GPT-5.2 excellerer i produktionstasks som regneark, slides og lange agentiske sekvenser. Google fremhæver rå ræsonnerings-leaderboards og ekstremt store kontekstvinduer i enkelt-requests. Hvad der betyder mest, afhænger af din workload: agentiske, langdokument-enterprise-pipelines favoriserer GPT-5.2’s dokumenterede GDPval-performance; indtag af massiv rå kontekst (f.eks. hele videokorpora/hele bøger i én omgang) favoriserer Geminis 1M inputvindue.

Hvordan sammenlignes de multimodale kapabiliteter?

Input og output

- Gemini 3 Pro Preview: understøtter tekst, billede, video, lyd, PDF som input og tekst som output; Google leverer granulære

media_resolution-kontroller og enthinking_level-parameter til at finindstille omkostning vs. fidelitet for multimodalt arbejde. Output-tokenloft 64k; input op til 1M tokens. - GPT-5.2: understøtter rige vision- og multimodale workflows; OpenAI fremhæver forbedret rumlig ræsonnering (billedkomponent-bounding estimerede labels), videoforståelse (Video MMMU-scorer) og værktøjsunderstøttet vision (Python-værktøj på vision-opgaver forbedrer scorer). GPT-5.2 fremhæver, at komplekse vision + kode-opgaver i høj grad drager fordel, når værktøjsstøtte (Python-kodeeksekvering) er aktiveret.

Praktiske forskelle

Granularitet vs. bredde: Gemini eksponerer en række multimodale knapper (media_resolution, thinking_level) sigtet mod at lade udviklere tune afvejninger pr. medietype. GPT-5.2 fremhæver integreret værktøjsbrug (kør Python i loopet) for at kombinere vision, kode og datatransformationer. Hvis din use case er tung video + billedanalyse med ekstremt store kontekster, er Geminis 1M-kontekst overbevisende; hvis dine workflows kræver eksekvering af kode i loopet (datatransformationer, regnearksgenerering), kan GPT-5.2’s kodeværktøjer og agentvenlighed være mere bekvemme.

Hvad med API-adgang, SDK’er og priser?

OpenAI GPT-5.2 (API & priser)

- API:

gpt-5.2,gpt-5.2-chat-latest,gpt-5.2-provia Responses API / Chat Completions. Etablerede SDK’er (Python/JS), cookbook-guides og et modent økosystem. - Priser (offentlige): $1,75 / 1M input-tokens og $14 / 1M output-tokens; cache-rabatter (90 % for cachede input) reducerer den effektive pris for gentagne data. OpenAI fremhæver tokeneffektivitet (højere pris pr. token, men lavere totalomkostning for at nå en kvalitetsgrænse).

Gemini 3 Pro Preview (API & priser)

- API:

gemini-3-pro-previewvia Google GenAI SDK og Vertex AI/GenerativeLanguage-endpoints. Nye parametre (thinking_level,media_resolution) og integration med Google-groundings og -værktøjer. - Priser (public preview): Omtrent $2 / 1M input-tokens og $12 / 1M output-tokens for preview-niveauer under 200k tokens; yderligere gebyrer kan gælde for Search-grounding, Maps eller andre Google-tjenester (Search-grounding-fakturering begynder 5. januar 2026).

Brug GPT-5.2 og Gemini 3 via CometAPI

CometAPI er en gateway-/aggregator-API: et enkelt, OpenAI-lignende REST API-endpoint, der giver dig samlet adgang til hundredvis af modeller fra mange leverandører (LLM’er, billede-/videomodeller, embedding-modeller osv.). I stedet for at integrere mange leverandør-SDK’er sigter CometAPI mod at lade dig kalde velkendte OpenAI-format-endpoints (chat/completions/embeddings/images), mens du skifter modeller eller leverandører under motorhjelmen.

Udviklere kan bruge flagskibsmodeller fra to forskellige virksomheder samtidigt via CometAPI uden at skifte leverandør, og API-priserne er mere overkommelige, typisk med 20 % rabat.

Eksempel: hurtige API-snippets (kopiér-indsæt for at prøve)

Nedenfor er minimale eksempler, du kan køre. De afspejler leverandørernes publicerede quickstarts (OpenAI Responses API + Google GenAI-klient). Udskift $OPENAI_API_KEY / $GEMINI_API_KEY med dine nøgler.

GPT-5.2 — Python (OpenAI Responses API, reasoning sat til xhigh til dybe problemer)

# Python (kræver openai SDK, der understøtter responses API)from openai import OpenAIclient = OpenAI(api_key="YOUR_OPENAI_API_KEY")resp = client.responses.create( model="gpt-5.2-pro", # gpt-5.2 eller gpt-5.2-pro input="Opsummér denne virksomhedsrapport på 50k tokens og udarbejd en disposition for en 10-slides præsentation med talernoter.", reasoning={"effort": "xhigh"}, # dybere ræsonnering max_output_tokens=4000)print(resp.output_text) # eller inspicér resp for at få strukturerede outputs / tokens

Noter: reasoning.effort lader dig afveje omkostning mod dybde. Brug gpt-5.2-chat-latest til Instant chat-stil. OpenAI-dokumentationen viser eksempler for responses.create.

GPT-5.2 — curl (simpel)

curl https://api.openai.com/v1/responses \ -H "Authorization: Bearer $OPENAI_API_KEY" \ -H "Content-Type: application/json" \ -d '{ "model": "gpt-5.2", "input": "Skriv en Python-funktion, der konverterer en PDF med tabeller til en normaliseret CSV med typede kolonner.", "reasoning": {"effort":"high"} }'

(Undersøg JSON for output_text eller strukturerede outputs.)

Gemini 3 Pro Preview — Python (Google GenAI-klient)

# Python (google genai client) — eksempel fra Google-dokumenterfrom google import genaiclient = genai.Client(api_key="YOUR_GEMINI_API_KEY")response = client.models.generate_content( model="gemini-3-pro-preview", contents="Find race condition i dette multitrådede C++-snippet: <indsæt kode her>", config={ "thinkingConfig": {"thinking_level": "high"} })print(response.text)

Noter: thinking_level styrer modellens interne overvejelse; media_resolution kan angives for billeder/videoer. REST- og JS-eksempler findes i Googles Gemini-udviklerguide.;

Gemini 3 Pro — curl (REST)

curl "https://generativelanguage.googleapis.com/v1beta/models/gemini-3-pro-preview:generateContent" \ -H "x-goog-api-key: $GEMINI_API_KEY" \ -H "Content-Type: application/json" \ -X POST \ -d '{ "contents": [{ "parts": [{"text": "Forklar race condition i denne C++-kode: ..."}] }], "generationConfig": {"thinkingConfig": {"thinkingLevel": "high"}} }'

Googles dokumentation inkluderer multimodale eksempler (inline-billeddata, media_resolution).

Hvilken model er “bedre” — praktisk vejledning

Der findes ikke en “vinder” for alle; vælg i stedet baseret på use case og begrænsninger. Nedenfor er en kort beslutningsmatrix.

Vælg GPT-5.2, hvis:

- Du har brug for tæt integration med kodeeksekveringsværktøjer (OpenAI’s interpreter/tool-økosystem) til programatiske datapipelines, regnearksgenerering eller agentiske kode-workflows. OpenAI fremhæver Python-værktøjsforbedringer og agentisk mega-agent-brug.

- Du prioriterer tokeneffektivitet ifølge leverandørens påstande og ønsker eksplicit, forudsigelig OpenAI-pris pr. token med store rabatter på cachede input (hjælper batch-/produktionsworkflows).

- Du vil have OpenAI-økosystemet (ChatGPT-produktintegration, Azure/Microsoft-partnerskaber og tooling omkring Responses API og Codex).

Vælg Gemini 3 Pro, hvis:

- Du har brug for ekstrem multimodalt input (video + billeder + lyd + pdf’er) og ønsker en enkelt model, der nativt accepterer alle disse input med et 1.000.000-token inputvindue. Google markedsfører dette eksplicit til lange videoer, store dokument + video-pipelines og interaktive Search/AI Mode use cases.&

- Du bygger på Google Cloud / Vertex AI og ønsker tæt integration med Google search-grounding, Vertex-provisionering og GenAI-klient-API’er. Du vil drage fordel af Google-produktintegrationer (Search AI Mode, AI Studio, Antigravity-agentværktøjer).

Konklusion: Hvilken er bedre i 2026?

I GPT-5.2 vs. Gemini 3 Pro Preview-opgøret er svaret kontekstafhængigt:

- GPT-5.2 fører i professionelt vidensarbejde, analytisk dybde og strukturerede workflows.

- Gemini 3 Pro Preview excellerer i multimodal forståelse, integrerede økosystemer og opgaver med stor kontekst.

Ingen af modellerne er universelt “bedre” — deres styrker komplementerer forskellige virkelige behov. Kloge adoptører bør matche modelvalg til specifikke use cases, budgetbegrænsninger og økosystemtilpasning.

Det står klart i 2026, at AI-fronten har rykket sig markant, og både GPT-5.2 og Gemini 3 Pro skubber grænserne for, hvad intelligente systemer kan udrette i virksomheder og videre.

Hvis du vil prøve med det samme, så udforsk GPT-5.2 og Gemini 3 Pro's kapaciteter af CometAPI i Playground, og konsulter API-guiden for detaljerede instruktioner. Før adgang, skal du sørge for, at du har logget ind på CometAPI og fået API-nøglen. CometAPI tilbyder en pris, der er langt under den officielle pris for at hjælpe dig med integrationen.

Klar til at gå?→ Gratis prøve af GPT-5.2 og Gemini 3 Pro !

Hvis du vil