OpenAI annoncerede GPT Image 1.5, virksomhedens nye flagskibsmodel til billedgenerering og -redigering, og lancerede en fornyet “ChatGPT Images”-oplevelse på tværs af ChatGPT og API’et. OpenAI markedsfører udgivelsen som et skridt mod billedskabelse i produktionskvalitet: stærkere efterlevelse af instruktioner, mere præcise redigeringer der bevarer vigtige detaljer (ansigter, lys, logoer), output der er op til 4× hurtigere, samt lavere omkostninger for billedinput/output i API’et. Den gode nyhed er, at CometAPI har integreret GPT-image 1.5 (gpt-image-1.5) og tilbyder en lavere pris end OpenAI.

Hvad er GPT Image 1.5?

GPT Image 1.5 er OpenAI’s nyeste generation af billedmodel, frigivet som motoren bag en genopbygget ChatGPT Images-oplevelse og gjort tilgængelig via OpenAI API’et som gpt-image-1.5. OpenAI positionerer den ikke blot som et novitets-kunstværktøj, men som et produktionsklart kreativt studie: den sigter mod at lave præcise, gentagelige redigeringer og understøtte arbejdsgange som e-handelskataloger, variantgenerering af brand-assets, kreative asset-pipelines og hurtig prototypning. Den fremhæver eksplicit fremskridt i at bevare vigtige billedelementer—ansigter, logoer, lys—og i at følge trinvis redigeringsinstruktion.

To driftsdetaljer at huske: GPT Image 1.5 renderer billeder op til fire gange hurtigere end sin forgænger, og billedinput/-output er ~20% billigere i API’et sammenlignet med GPT Image 1.0 — begge dele vigtige for teams, der itererer meget. Den nye ChatGPT Images-UI tilføjer også et dedikeret sidepanel-arbejdsrum, forudindstillinger og trending prompts samt en engangs “likeness”-upload til gentagne personaliseringer.

Hvordan har GPT Image 1.5 udviklet sig fra tidligere OpenAI-billedmodeller?

OpenAI’s billedlinje er gået fra DALL·E → flere interne billedeksperimenter → GPT Image 1 (og mindre varianter). Sammenlignet med tidligere OpenAI-billedmodeller (f.eks. GPT-image-1 og tidligere ChatGPT-billedstakke) er 1.5 eksplicit optimeret til:

- Strammere efterlevelse af instruktioner — modellen følger tekstlige instruktioner tættere.

- Forbedret nøjagtighed i billedredigering — den bevarer komposition, ansigtstræk, lys og logoer på tværs af redigeringer, så gentagne redigeringer forbliver konsistente.

- Hurtigere, billigere inferens — OpenAI hævder op til 4× hastighedsforbedringer i forhold til den forrige billedmodel og reducerede token-/billedomkostninger for input og output.

Kort sagt: I stedet for at betragte billedgenerering som et enkeltstående “kunstlegetøj”, skubber OpenAI billedmodeller mod forudsigelige, gentagelige værktøjer til kreative teams og virksomhedsarbejdsgange.

Hovedfunktioner i GPT Image 1.5

Redigering og bevaring af vigtige billedelementer

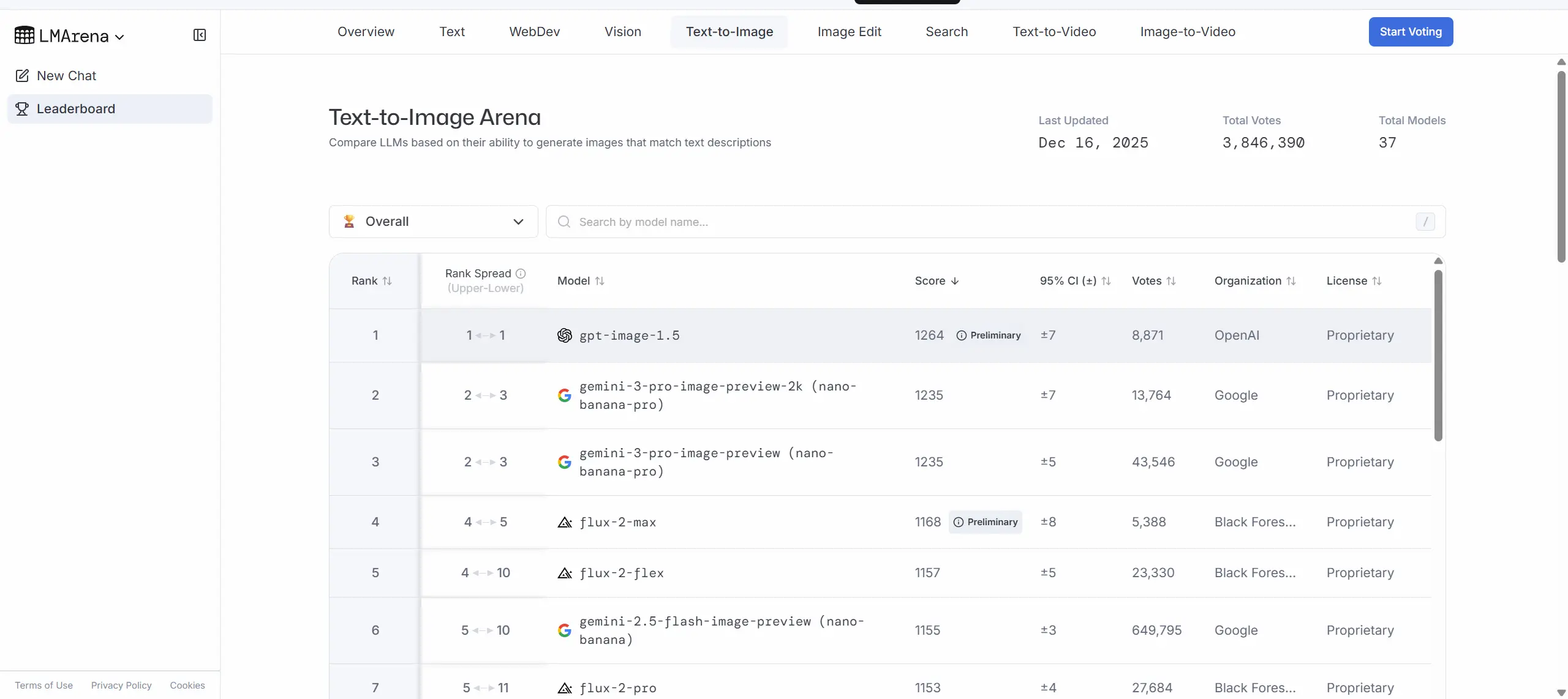

GPT Image 1.5 præsterer stærkt på flere billedgenererings- og redigerings-leaderboards, der er publiceret siden lanceringen. LMArena rapporterer, at GPT Image 1.5 rangerer i toppen eller tæt på toppen af leaderboards for tekst-til-billede og billedredigering, til tider snævert foran konkurrenter som Googles Nano Banana Pro.

En af overskriftsfunktionerne ved GPT Image 1.5 er præcis redigering, der bevarer “det, der betyder noget”: Når du beder modellen om at ændre et bestemt objekt eller attribut, forsøger den kun at ændre dette element, mens komposition, lys og personers udseende holdes konsistent på tværs af redigeringer. For brands og e-handelsteams betyder dette færre manuelle efterrettelser efter automatiske redigeringer.

Hvor hurtigt er den, og hvad betyder "4× hurtigere"?

OpenAI oplyser, at billedgenerering i ChatGPT Images er op til 4× hurtigere end før, ~20% billigere billed-I/O-omkostninger i API’et sammenlignet med GPT Image 1. Det er en produktpåstand: hurtigere rendertid betyder, at du kan iterere flere billeder i samme session, starte yderligere genereringer, mens andre stadig behandles, og reducere friktion i udforskende arbejdsgange. Hurtigere inferens reducerer ikke blot latenstid for slutbrugere, det sænker også energi pr. forespørgsel og driftsomkostninger ved udrulninger. Bemærk: “op til” betyder, at gevinster i den virkelige verden afhænger af promptkompleksitet, billedstørrelse og systembelastning.

Forbedret efterlevelse af instruktioner og tekstrendering

Stærkere efterlevelse af instruktioner end GPT Image 1.0: Modellen er bedre til at tolke flertrins-prompter og bevare brugerintention på tværs af kædede redigeringer. De fremhæver også forbedret tekstrendering (læselig tekst indlejret i billeder) og bedre rendering af små ansigter, men den markerer stadig begrænsninger i flersproget/tekstrendering i visse kanttilfælde; samlet set sigter modellen dog mod at lukke det langvarige hul, hvor genererede billeder ville producere ulæselig eller meningsløs skiltning.

GPT Image 1.5 vs Nano Banana Pro (Google) vs Qwen-Image (Alibaba)?

Hvad er Googles Nano Banana Pro?

Nano Banana Pro (branded i Googles Gemini-familie som Gemini 3 Pro Image / Nano Banana Pro) er Google/DeepMinds studioklasse-billedmodel. Google fremhæver fremragende tekstrendering, multi-billedekomposition (bland mange billeder til ét) og integration med de bredere Gemini-kapabiliteter (søge-forankring, lokalitetsbevidste oversættelser og virksomhedsarbejdsgange i Vertex AI). Nano Banana Pro sigter mod at være produktionsklar for designere, der har brug for høj fidelitet og forudsigelig tekstlayout inde i billeder.

Hvad er Qwen-Image?

Qwen-Image (fra Qwen/Tongyi-familien) er en billedmodel fra Alibaba, som er blevet evalueret på tværs af akademiske og offentlige benchmarks. Qwen-teamets tekniske rapport dokumenterer stærk præstation på tværs af benchmarks (GenEval, DPG, OneIG-Bench) og fremhæver særlige styrker i promptforståelse, flersproget tekstrendering (især kinesisk) og robust redigering. Qwen-Image omtales ofte som et af de førende open-source-/virksomhedsvenlige valg uden for de amerikanske hyperscalere.

Hoved mod hoved: hvor de hver især excellerer

- GPT Image 1.5 (OpenAI) — Styrker: hurtig generering, stærk efterlevelse af instruktioner i flertrins-arbejdsgange, velintegreret ChatGPT-UX og bred API-tilgængelighed. Tidlige benchmarks placerer den i eller meget tæt på toppen i kombinerede genererings- og redigeringsmålinger; OpenAI præsenterer modellen som et “kreativt studie” til praktisk produktivitet.

- Nano Banana Pro (Google) — Styrker: enestående tekstrendering og virksomheds-integrationer (Vertex AI, Google Workspace), stærk lokalisering og multi-billedekomposition, studioklasse-kontroller for vinkel/lys/aspekt/2K output. Google understreger modellens anvendelighed til marketing-/lokaliseringspipelines og præcis plakat/mockup-generering.

- Qwen-Image (Alibaba) — Styrker: præstation på tværs af internationale datasæt, åben teknisk rapportering og stærk flersproget tekstrendering. Et overbevisende valg for udviklere og virksomheder med fokus på asiatiske markeder og teams, der søger transparente benchmarkresultater.

Praktiske forskelle, som udviklere vil bemærke

- API’er & integrationsmønstre: OpenAI eksponerer GPT Image 1.5 via Image API og Responses API; Google eksponerer Nano Banana Pro via Gemini/Vertex; Alibaba publicerer modeldokumentation og demo-endpoints. Prissætning og raterestriktioner varierer mellem udbydere og vil påvirke produktionsomkostninger og gennemløbsbeslutninger.

- Kontrol vs. hastighed-afvejninger: Nogle udbydere tilbyder “fast/flash”-tilstande vs. “thinking/pro”-tilstande — f.eks. Nano Banana (fast) vs. Nano Banana Pro (thinking). OpenAI’s budskab antyder, at GPT Image 1.5 reducerer det praktiske behov for at bytte kvalitet for hastighed, men tuning af pris/ydelse vil stadig være vigtig ved massegenerering.

Hvordan får man adgang til og bruger GPT Image 1.5

Der er to måder at få adgang til GPT Image 1.5:

ChatGPT (UI) — GPT Image 1.5 driver den nye ChatGPT Images-oplevelse (Images-fanen). Brug den til at generere fra tekst, uploade billeder og lave redigeringer eller iterere interaktivt.

API — Brug Image API (/v1/images/generations og /v1/images/edits) til at generere og redigere billeder med gpt-image-1.5. Svar er base64-kodede billeder for GPT-billedmodeller.

Den gode nyhed er, at CometAPI har integreret GPT-image 1.5 (gpt-image-1.5) og tilbyder en lavere pris end OpenAI. Du kan bruge CometAPI til samtidig at bruge og sammenligne Nano banana pro og Qwen image.

Hvilke praktiske anvendelser og anbefalede arbejdsgange findes der?

Anvendelser der får mest udbytte

- E-handel og produktkatalogisering: skab mange konsistente produktfotos fra et enkelt eksemplar, skift baggrunde, og hold lys/facetter konsistente på tværs af billeder. GPT Image 1.5’s redigeringsstabilitet hjælper her.

- Annoncekreativer og hurtig iteration: hurtigere generering reducerer cyklustid for A/B-varianter.

- Fotoretouchering og lokalisering: byt rekvisitter eller outfits, mens modelidentitet holdes konsistent for regionalt lokaliserede kampagner.

- Designprototyper og konceptkunst: modellen understøtter både fotorealistiske og stærkt stiliserede outputs, nyttigt for tidlig konceptudforskning.

Hvem har mest gavn af GPT Image 1.5?

- Indholdsskabere og sociale-medie-teams, der har brug for hurtig, iterativ redigering og kreative transformationer.

- Designere og produktteams, der prototyper UI/UX-assets, hero-billeder eller reklame-mockups, som kræver hurtige udkast.

- E-handel-teams, der laver produktmockups (tøjeprøvninger, baggrundsskift, tekstoverlæg).

- Udviklere, der bygger samtalebaserede, billeddrevne oplevelser (f.eks. chat-baserede fotoredigeringsværktøjer, marketingautomatisering).

Foreslået arbejdsgang for kreative

- Prototyp i ChatGPT Images for at finpudse instruktioner (brug presets til at opdage stilarter).

- Fastfrys et snapshot i API-brug for produktionsstabilitet (

gpt-image-1.5-YYYY-MM-DD). - Kør kontrollerede A/B-tests og sammenlign modeloutput med omkostninger til menneskelig efterbehandling.

- Integrér moderationschecks og et menneske-i-løkken til brand- eller sikkerhedsfølsomme opgaver.

Omkostnings- og ydelseshensyn

Hurtigere generering kan reducere latenstid og (afhængigt af prissætning) pris pr. billede, men virksomhedsanvendelse bør måle både gennemløb og token-/compute-priser.

Sikkerhed, bias og hallucinationer

GPT Image 1.5 reducerer visse fejltilstande (dårlige redigeringer, inkonsistente ansigter), men eliminerer ikke hallucinerede eller biasede outputs. Ligesom andre generative modeller kan den reproducere kulturelle bias eller lave upræcise afbildninger, hvis prompter er dårligt specificeret. Implementér værn: indholdsfiltre, menneskelig gennemgang og testsuiter, der afspejler forventede kanttilfælde.

Konklusion — Skal du prøve GPT Image 1.5?

Hvis dit projekt har brug for billedgenerering i høj kvalitet eller robust, iterativ redigering i samtalebaserede arbejdsgange (for eksempel: marketingkreativer, produktmockups, virtuelle try-ons eller en billedaktiveret SaaS-pro).

For at komme i gang kan du udforske GPT Image 1.5’s kapabiliteter i Playground og konsultere API-guiden for detaljerede instruktioner. Før adgang, skal du sikre dig, at du er logget ind på CometAPI og har fået API-nøglen. CometAPI tilbyder en pris langt under den officielle pris for at hjælpe dig med at integrere.

Klar til at gå i gang?→ Gratis prøve af GPT Image 1.5-modeller !