I 2025–2026 fortsatte landskabet for AI-værktøjer med at konsolidere sig: gateway-API’er (som CometAPI) blev udvidet til at give OpenAI-lignende adgang til hundredvis af modeller, mens slutbruger-LLM-apps (som AnythingLLM) fortsatte med at forbedre deres “Generic OpenAI”-udbyder, så desktop- og lokal-først-apps kan kalde ethvert OpenAI-kompatibelt endepunkt. Det gør det i dag ligetil at rute AnythingLLM-trafik gennem CometAPI og få fordelene ved modelvalg, omkostningsruting og samlet fakturering — samtidig med at du stadig bruger AnythingLLM’s lokale UI og RAG-/agent-funktioner.

Hvad er AnythingLLM, og hvorfor vil du forbinde det til CometAPI?

Hvad er AnythingLLM?

AnythingLLM er en open source, alt-i-en AI-applikation og lokal/cloud-klient til at bygge chatassistenter, retrieval-augmented generation (RAG)-workflows og LLM-drevne agentter. Den tilbyder et elegant UI, et developer-API, arbejdsområde-/agentfunktioner og understøttelse af lokale og cloud-baserede LLM’er — designet til at være privat som standard og udvideligt via plugins. AnythingLLM tilbyder en Generic OpenAI-udbyder, der lader den tale med OpenAI-kompatible LLM-API’er.

Hvad er CometAPI?

CometAPI er en kommerciel API-aggregeringsplatform, der eksponerer 500+ AI-modeller gennem én OpenAI-lignende REST-grænseflade og samlet fakturering. I praksis lader den dig kalde modeller fra flere leverandører (OpenAI, Anthropic, Google/Gemini-varianter, billed-/lydmodeller m.fl.) via de samme https://api.cometapi.com/v1-endepunkter og en enkelt API-nøgle (format sk-xxxxx). CometAPI understøtter standard OpenAI-lignende endepunkter som /v1/chat/completions, /v1/embeddings osv., hvilket gør det let at tilpasse værktøjer, der allerede understøtter OpenAI-kompatible API’er.

Hvorfor integrere AnythingLLM med CometAPI?

Tre praktiske grunde:

- Modelvalg og leverandørfleksibilitet: AnythingLLM kan bruge “any OpenAI-compatible”-LLM via sin Generic OpenAI-wrapper. Hvis du peger den wrapper mod CometAPI, får du øjeblikkelig adgang til hundredvis af modeller uden at ændre AnythingLLM’s UI eller flows.

- Omkostnings-/driftsoptimering: Med CometAPI kan du skifte modeller (eller nedskalere til billigere) centralt for at styre omkostninger og holde samlet fakturering i stedet for at jonglere med flere leverandørnøgler.

- Hurtigere eksperimentering: Du kan A/B-teste forskellige modeller (fx

gpt-4o,gpt-4.5, Claude-varianter eller open source multimodale modeller) via det samme AnythingLLM-UI — nyttigt for agenter, RAG-svar, opsummering og multimodale opgaver.

Hvilket miljø og hvilke betingelser skal du forberede før integrationen

System- og softwarekrav (overordnet)

- Desktop eller server, der kører AnythingLLM (Windows, macOS, Linux) — desktop-installation eller selvhostet instance. Bekræft, at du er på en nyere build, der eksponerer LLM Preferences / AI Providers-indstillingerne.

- CometAPI-konto og en API-nøgle (

sk-xxxxx-stil hemmelighed). Du bruger denne i AnythingLLM’s Generic OpenAI-udbyder. - Netværksforbindelse fra din maskine til

https://api.cometapi.com(ingen firewall, der blokerer udgående HTTPS). - Valgfrit men anbefalet: et moderne Python- eller Node-miljø til test (Python 3.10+ eller Node 18+), curl og en HTTP-klient (Postman / HTTPie) for at sanity-tjekke CometAPI, før du kobler det på AnythingLLM.

AnythingLLM-specifikke forudsætninger

Generic OpenAI-LLM-udbyderen er den anbefalede vej for endepunkter, der mimer OpenAI’s API-overflade. AnythingLLM’s dokumentation advarer om, at denne udbyder er udviklerfokuseret, og at du bør forstå de input, du angiver. Hvis du bruger streaming, eller dit endepunkt ikke understøtter streaming, har AnythingLLM en indstilling til at deaktivere streaming for Generic OpenAI.

Sikkerheds- og drifts-tjekliste

- Behandl CometAPI-nøglen som enhver anden hemmelighed — commit den ikke i repoer; opbevar den i OS-nøgleringe eller miljøvariabler, hvor det er muligt.

- Hvis du planlægger at bruge følsomme dokumenter i RAG, så sørg for, at endpunktets fortrolighedsgarantier opfylder dine compliancebehov (tjek CometAPI’s docs/vilkår).

- Beslut maks. tokens og kontekstvinduesgrænser for at undgå løbske regninger.

Hvordan konfigurerer du AnythingLLM til at bruge CometAPI (trin for trin)?

Nedenfor er en konkret trinfølge — efterfulgt af eksempel-miljøvariabler og kodestumper til at teste forbindelsen, inden du gemmer indstillingerne i AnythingLLM’s UI.

Trin 1 — Få din CometAPI-nøgle

- Registrér dig eller log ind hos CometAPI.

- Navigér til “API Keys” og generér en nøgle — du får en streng, der ligner

sk-xxxxx. Hold den hemmelig.

Trin 2 — Verificér, at CometAPI virker med en hurtig forespørgsel

Brug curl eller Python til at kalde et simpelt chat completion-endepunkt for at bekræfte forbindelsen.

Curl-eksempel

curl -X POST "https://api.cometapi.com/v1/chat/completions" \

-H "Authorization: Bearer sk-xxxxx" \

-H "Content-Type: application/json" \

-d '{

"model": "gpt-4o",

"messages": ,

"max_tokens": 50

}'

Hvis dette returnerer 200 og et JSON-svar med et choices-array, fungerer din nøgle og dit netværk. (CometAPI’s docs viser OpenAI-lignende overflade og endepunkter).

Python-eksempel (requests)

import requests

url = "https://api.cometapi.com/v1/chat/completions"

headers = {"Authorization": "Bearer sk-xxxxx", "Content-Type": "application/json"}

payload = {

"model": "gpt-4o",

"messages": ,

"max_tokens": 64

}

r = requests.post(url, json=payload, headers=headers, timeout=15)

print(r.status_code, r.json())

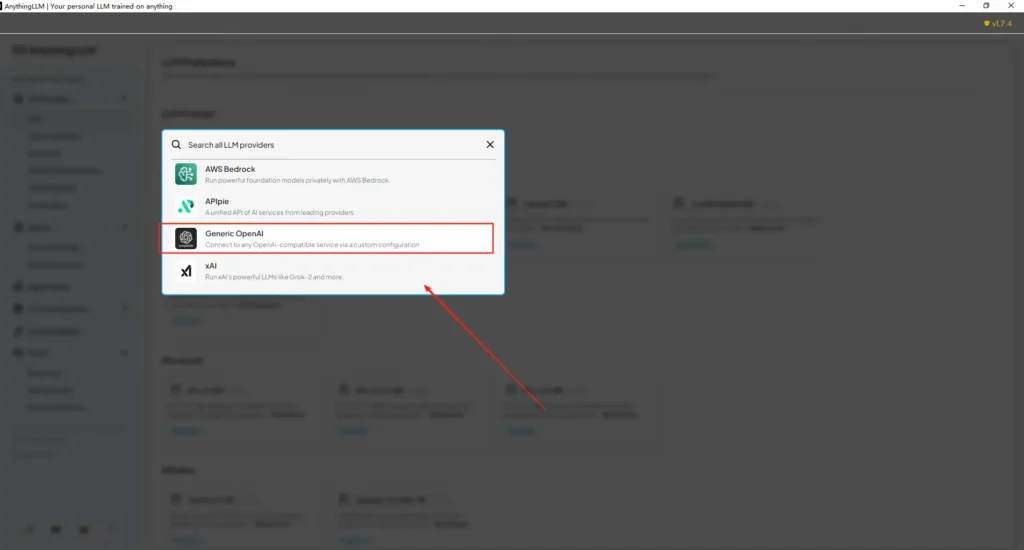

Trin 3 — Konfigurer AnythingLLM (UI)

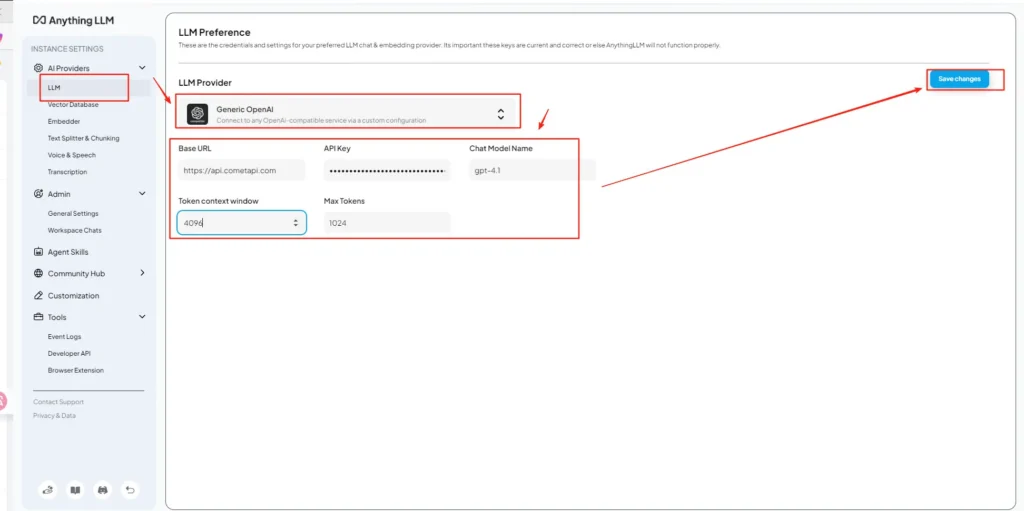

Åbn AnythingLLM → Settings → AI Providers → LLM Preferences (eller tilsvarende sti i din version). Brug Generic OpenAI-udbyderen og udfyld felter som følger:

API Configuration (example)

• Gå ind i AnythingLLM-indstillingsmenuen, find LLM Preferences under AI Providers.

• Vælg Generic OpenAI som modeludbyder, indtasthttps://api.cometapi.com/v1i URL-feltet.

• Indsætsk-xxxxxfra CometAPI i feltet til API-nøgle. Udfyld Token context window og Max Tokens i henhold til den konkrete model. Du kan også tilpasse modelnavne på denne side, fx tilføje modellengpt-4o.

Trin 4 — Angiv modelnavne og token-grænser

På samme indstillingsskærm kan du tilføje eller tilpasse modelnavne nøjagtigt som CometAPI offentliggør dem (fx gpt-4o, minimax-m2, kimi-k2-thinking), så AnythingLLM’s UI kan præsentere disse modeller for brugerne. CometAPI offentliggør modelstrenge for hver leverandør.

Trin 5 — Test i AnythingLLM

Start en ny chat eller brug et eksisterende arbejdsområde, vælg Generic OpenAI-udbyderen (hvis du har flere udbydere), vælg et af de CometAPI-modelnavne, du tilføjede, og kør en simpel prompt. Hvis du får sammenhængende svar, er integrationen på plads.

Hvordan AnythingLLM bruger disse indstillinger internt

AnythingLLM’s Generic OpenAI-wrapper konstruerer OpenAI-lignende forespørgsler (/v1/chat/completions, /v1/embeddings), så når du først peger base-URL’en og angiver CometAPI-nøglen, vil AnythingLLM rute chats, agentkald og embedding-forespørgsler gennem CometAPI transparent. Hvis du bruger AnythingLLM-agenter ( @agent-flows), arver de samme udbyder.

Hvad er best practices og mulige faldgruber?

Bedste praksis

- Brug model-passende kontekstindstillinger: Match AnythingLLM’s Token Context Window og Max Tokens til den model, du vælger på CometAPI. Mismatch fører til uventet trunkering eller fejl.

- Sikr dine API-nøgler: Opbevar CometAPI-nøgler i miljøvariabler og/eller Kubernetes/secret manager; læg dem aldrig i git. AnythingLLM lagrer nøgler lokalt, hvis du indtaster dem i UI’et — behandl værtens lagring som følsom.

- Start med billigere/mindre modeller til eksperimenter: Brug CometAPI til at prøve billigere modeller til udvikling, og reserver premium-modeller til produktion. CometAPI reklamerer eksplicit med omkostningsskift og samlet fakturering.

- Overvåg forbrug og sæt alarmer: CometAPI har forbrugsdashboards — sæt budgetter/alarmer for at undgå overraskende regninger.

- Test agenter og værktøjer isoleret: AnythingLLM-agenter kan udløse handlinger; test dem med sikre prompts og på staging-instancer først.

Almindelige faldgruber

- UI vs

.env-konflikter: Ved selvhosting kan UI-indstillinger overskrive.env-ændringer (og omvendt). Tjek den genererede/app/server/.env, hvis tingene nulstilles efter restart. Community-issues rapportererLLM_PROVIDER-resets. - Modelnavne, der ikke matcher: Brug af et modelnavn, der ikke er tilgængeligt på CometAPI, giver en 400/404 fra gatewayen. Bekræft altid tilgængelige modeller på CometAPI’s modelliste.

- Token-grænser og streaming: Hvis du har brug for streaming-svar, så verificér, at den valgte CometAPI-model understøtter streaming (og at din AnythingLLM-UI-version understøtter det). Nogle udbydere har forskellige streaming-semantikker.

Hvilke virkelige anvendelser åbner denne integration for?

Retrieval-Augmented Generation (RAG)

Brug AnythingLLM’s dokumentloadere + vektordatabase med CometAPI-LLM’er til at generere kontekstbevidste svar. Du kan eksperimentere med billig embedding + dyr chatmodel eller holde alting på CometAPI for samlet fakturering. AnythingLLM’s RAG-flows er en primær indbygget funktion.

Agent-automatisering

AnythingLLM understøtter @agent-workflows (browse sider, kalde værktøjer, køre automations). At rute agenters LLM-kald gennem CometAPI giver dig frit valg af modeller til kontrol-/fortolkningsskridt uden at ændre agentkode.

A/B-test på tværs af modeller og omkostningsoptimering

Skift model pr. arbejdsområde eller feature (fx gpt-4o til produktion, gpt-4o-mini til udvikling). CometAPI gør modelswap trivialt og centraliserer omkostninger.

Multimodale pipelines

CometAPI tilbyder billede-, lyd- og specialiserede modeller. AnythingLLM’s multimodale understøttelse (via udbydere) plus CometAPI’s modeller muliggør billedtekstning, multimodal opsummering eller lydtransskription via den samme grænseflade.

Konklusion

CometAPI positionerer sig fortsat som en multemodel-gateway (500+ modeller, OpenAI-lignende API) — hvilket gør den til en naturlig partner for apps som AnythingLLM, der allerede understøtter en Generic OpenAI-udbyder. Tilsvarende gør AnythingLLM’s generiske udbyder og de seneste konfigurationsmuligheder det enkelt at forbinde til sådanne gateways. Denne konvergens forenkler eksperimentering og produktionsmigrering i slutningen af 2025.

How to get started with Comet API

CometAPI er en samlet API-platform, der aggregerer over 500 AI-modeller fra førende udbydere — såsom OpenAI’s GPT-serie, Google’s Gemini, Anthropic’s Claude, Midjourney, Suno og flere — i en enkelt, udviklervenlig grænseflade. Ved at tilbyde konsistent autentificering, request-formatering og response-håndtering forenkler CometAPI integrationen af AI-kapabiliteter i dine applikationer markant. Uanset om du bygger chatbots, billedgeneratorer, musikkomponister eller datadrevne analysepipelines, lader CometAPI dig iterere hurtigere, styre omkostninger og forblive leverandør-agnostisk — samtidig med at du udnytter de nyeste gennembrud i AI-økosystemet.

To begin, explore the model capabilities ofCometAPI i Playground og konsulter API-guiden for detaljerede instruktioner. Før adgang, skal du sikre, at du er logget ind på CometAPI og har fået API-nøglen. CometAPI tilbyder en pris langt under den officielle pris for at hjælpe dig med at integrere.

Ready to Go?→ Sign up for CometAPI today!

If you want to know more tips, guides and news on AI follow us on VK, X and Discord!