Den 5. feb. 2026 lancerede Anthropic Claude Opus 4.6, den nyeste flagskibsmodel i Claude-familien. Opus 4.6 fordobler fokus på langsigtet vidensarbejde og agent-baserede software-workflows: den leveres med et beta-1,000,000 token kontekstvindue, forfinet multi-agent-koordinering kaldet Agent Teams og et adaptivt ræsonneringssystem (Adaptive Thinking), styret af en effort-kontrol. Modellen er tilgængelig via Claude Developer Platform og tredjeparts aggregator-API’er (for eksempel CometAPI) og præsenteres som en drop-in-opgradering for mange Claude-brugstilfælde.

Hvad er Claude Opus 4.6

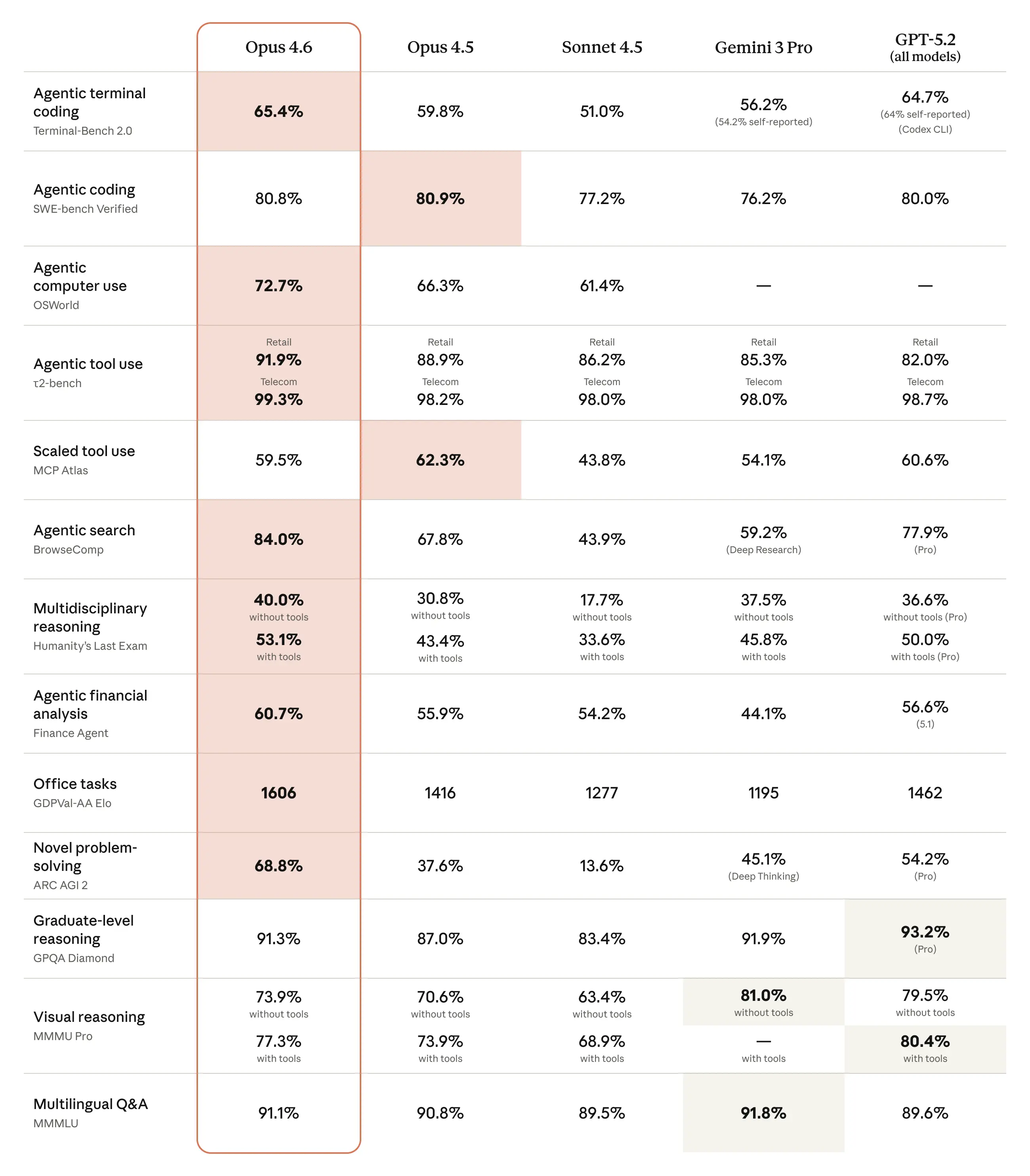

Claude Opus 4.6 er den nyeste Opus-klasse-model fra Anthropic og positioneres som deres mest kapable model til dato inden for kodning, agent-baserede workflows og lang-kontekst-ræsonnering. Udgivelsen prioriterer langvarige “agentiske” opgaver (tænk iscenesatte kode-migrationer, refaktorering på tværs af mange filer eller koordinerede forskningsagenter), tung dokumentbehandling og virksomheds-integrationer. Anthropic beskriver Opus 4.6 som en næsten drop-in-opgradering fra 4.5, men med flere adfærds- og kapabilitetsændringer, der er vigtige for implementører.

Centrale funktioner i Claude Opus 4.6, du bør kende med det samme

- 1M token kontekstvindue (beta): Opus 4.6 introducerer et meget stort kontekstvindue (Anthropic tilbyder det i beta), som gør det muligt for modellen at se og ræsonnere over ekstremt store dokumenter eller hele kodebaser i én session. Det gør opgaver som refaktorering af hele repositories, lange juridiske gennemgange og syntese på tværs af flere dokumenter langt mere praktiske.

- Agent Teams: Opus 4.6 udvider agent-kapabiliteter ved at muliggøre koordinerede grupper af agenter (Agent Teams) — flere Claude-agenter, der arbejder parallelt på forskellige delopgaver og deler tilstand. Dette er designet til at lade systemer dekomponere svære problemer (f.eks. én agent til testoprettelse, en anden til refaktorering, en tredje til QA) og koordinere deres output.

- Adaptive Thinking (effort levels): I stedet for en binær “thinking”-tilstand eksponerer Opus 4.6 flere effort-niveauer (f.eks. low/medium/high/max), der afvejer latenstid og omkostning mod dybere ræsonnering og mere overlagt tænkning. Anthropic eksponerer også kontrolmekanismer som context compaction til effektiv håndtering af lange samtaler.

- 128K output-token-budget: Opus 4.6 fordobler det tidligere maksimale output-budget (64K → 128K), så modellen kan levere længere, vedvarende output uden afkortning — nyttigt til rapporter i flere dele eller kodegenerering, der spænder over mange filer. Streaming anbefales til så store output.

Andre praktiske forbedringer omfatter bedre kode- og debug-færdigheder samt tilstand-/prioritetsindstillinger designet til enterprise- og integrationsworkflows (Copilot-integration udrulles allerede steder som GitHub Copilot).

Hvorfor disse funktioner betyder noget (kort overblik)

- 1M token-vinduet reducerer behovet for gentagne retrieval-cyklusser eller at sammenføje mange dokumenter i flere kald — du kan holde mere kontekst i ét kald, hvilket forenkler applikationslogik for mange videnstunge workflows.

- Agent Teams ændrer arkitekturen: i stedet for en enkelt monolitisk assistent designer du små specialiserede agenter, der samarbejder — nemmere parallelisering, klarere ansvarsområder og potentielt bedre pålidelighed i komplekse opgaver.

- Adaptive Thinking giver dig forudsigelige knapper til at afveje tid kontra kvalitet. Det er afgørende for produktionssystemer, hvor latenstid, determinisme og omkostning er begrænsninger.

Sådan kalder du Claude Opus 4.6 via CometAPI — trin for trin

Brug af CometAPI til at kalde Opus 4.6

Mange teams foretrækker en samlet multi-model gateway (når du vil normalisere klientkode på tværs af leverandører). CometAPI er en sådan udbyder, der eksponerer mange leverandørmodeller via en enkelt OpenAI-kompatibel overflade; og Anthropics beskedformat er også tilgængeligt (når du har brug for Anthropics API-specifikke kompressionsmuligheder og vil bruge Claude Code via CometAPI). Eksemplerne nedenfor viser mønstre til produktion: autentificering, valg af model, aktivering af lang kontekst, streaming og omkostningskontrol. (Juster navne og headers, så de matcher udbyderens modelregister, hvis Comet ændrer modelidentifikatorer.)

Kom godt i gang (tjekliste for udviklere)

- registrér dig hos CometAPI, skaf en

COMET_API_KEY, og sæt klientensbase_urltilhttps://api.cometapi.com/v1(Comet tilbyder OpenAI-kompatible klienter og eksempler). CometAPI-konsollen viser tilgængelige modeller og eventuelle leverandørspecifikke flag, du kan sende videre. - Beslut kapabilitetsindstillinger på forhånd:

thinking: {type: "adaptive"},output_config.effort-niveau,max_tokens(output-budget), streaming til store output, og om context compaction ønskes.

Claude API (pseudokode i Python-stil):

import anthropic

import os

# Get your CometAPI key from https://api.cometapi.com/console/token, and paste it here

COMETAPI_KEY = os.environ.get("COMETAPI_KEY") or "<YOUR_COMETAPI_KEY>"

BASE_URL = "https://api.cometapi.com"

client = anthropic.Anthropic(

base_url=BASE_URL,

api_key=COMETAPI_KEY,

)

message = client.messages.create(

model="claude-opus-4-6",

max_tokens=1024,

messages=[{"role": "user", "content": "Hello, Claude"}],

)

print(message.content[0].text)

Via CometAPI (OpenAI-kompatibelt shim-eksempel):

# Example using an OpenAI-like client pointed at CometAPI

from openai import OpenAI # or compatible client

client = OpenAI(api_key="COMET_KEY", base_url="https://api.cometapi.com/v1")

resp = client.responses.create(

model="claude-opus-4-6",

reasoning={"type":"adaptive"}, # if shim supports same param name

output_config={"effort":"medium"},

messages=[{"role":"user","content":"Generate a migration plan for this monorepo."}]

)

print(resp.output_text)

Bemærk: parameternavne i CometAPI-wrappere varierer efter SDK. CometAPI dokumenterer en enkel integrationsmodel og understøtter ofte

model="claude-opus-4-6"; se CometAPI-dokumentationen for præcis feltmapping og eventuelle nødvendige justeringer af request-strukturen.

Bedste praksis og brug

Agent Teams: designmønstre og en kort opskrift

Hvornår du skal bruge Agent Teams: store refaktoreringer af kodebaser, flertrins dokumentbehandling og workflows, der naturligt kan opdeles til separate specialagenter (f.eks. arkitekt, implementør, reviewer).

Simpelt Agent Teams-mønster:

- Orkestrator-agenten modtager den overordnede opgave og splitter den i delopgaver.

- Arbejdsagenter (hver en Claude-instans) startes med fokuserede prompts og eksplicitte succeskriterier.

- Parallelt arbejde: agenterne kører parallelt i uafhængige kontekster; resultater returneres til orkestratoren.

- Flet & review: orkestratoren komprimerer output, kører en syntesepas og en afsluttende sikkerheds-/review-kontrol (brug

effort=maxtil sidste pas om nødvendigt).

Praktiske tips:

- Giv hver underagent en streng systemprompt og afgrænsede

max_tokensfor at undgå løbske omkostninger. - Brug CometAPI eller et orkestreringsframework til at håndtere parallelle kald og retries.

- Brug context compaction til orkestratorens historik, så du kan bevare beslutninger uden at betale for fuld ordret gengivelse af historikken.

Kontekststyring: håndtering af store input og 1M token-vinduet

- Foretræk struktureret ingestion: giv dokumenter som segmenterede enheder (dokumentmetadata + indholdsblokke). Behold ankerpunkter (dokumenttitler, indeks) og bed modellen citere kilder efter indeks. Dette er mere robust end at indsætte rå filer.

- Brug context compaction (hvor tilgængeligt) til lange interaktive sessioner: lad modellen opsummere ældre ture, så du ikke udtømmer token-budgettet, samtidig med at vigtige fakta bevares. Anthropic tilbyder compaction som en beta-funktion.

- Hvis du har brug for deterministisk recall, gem kanoniske artefakter i din egen DB og referér dem via ID i stedet for at skubbe hele filer ind i hver request. Brug modellen til at opsummere eller udtrække kun de dele, du behøver til et givent trin.

Omkostninger, latenstid og kvalitet — brug af effort og andre knapper

- Effort: den mest effektive kontrol til at balancere omkostning vs. kapabilitet. Start med

mediumi produktionssystemer, der kræver effektivitet; brughighellermaxtil kritiske audits, endelige reviews eller komplekse synteseopgaver.lower nyttig til rutinemæssig retrieval eller korte Q&A. Mange teams rapporterer markante besparelser ved at brugemediumsom standard og kun hæveeffort, når det er påkrævet. - Batch og cache: brug prompt-caching til gentagne spørgsmål og batch-behandling til mange små, lignende opgaver for at reducere omkostningen ved genindtagelse af tokens. Anthropics platform og tredjepartsudbydere understøtter prompt-caching/batch-tilstande.

- Streaming & chunkede output: når du beder om meget store output (lang kodegenerering, bogudkast), brug streaming for at reducere memory-tryk og muliggøre tidlig accept/afbrydelse.

Afsluttende tanker — hvor Opus 4.6 ændrer udviklerens regnestykke

Opus 4.6 er et tydeligt skridt mod at bygge store, robuste, agent-baserede workflows uden at skulle sy mange korte requests sammen. 1M token-vinduet og Agent Teams låser op for nye klasser af applikationer (automatisering af store kodebaser, lange juridiske/finansielle gennemgange, multi-dokument forskningsassistenter), men de flytter også designfokus fra prompt-engineering-mikrooptimeringer til systemdesign: hvordan du lagrer artefakter, orkestrerer specialister, måler og begrænser omkostninger samt overvåger agentadfærd.

Udviklere kan få adgang til Opus 4.6 via CometAPI nu. For at komme i gang kan du udforske modellens kapabiliteter i Playground og konsultere API-guiden for detaljerede instruktioner. Før adgang, sørg venligst for, at du er logget ind på CometAPI og har fået din API-nøgle. CometAPI tilbyder en pris, der er langt lavere end den officielle pris, for at hjælpe dig med integrationen.

Klar til at komme i gang?→ Tilmeld dig openclaw i dag

Hvis du vil have flere tips, guides og nyheder om AI, så følg os på VK, X og Discord!

.png&w=3840&q=75)