MiniMax-M2.5 er en ny, produktivitetsfokuseret stor sprogmodel fra MiniMax, som er optimeret til kodning, agent-baseret værktøjsbrug og kontorarbejdsgange. Du kan kalde den via den native MiniMax-platform eller via API-aggregatorer som CometAPI. Du behøver kun at skaffe CometAPI API-nøglen for at bruge API'et, da Minimax-M2.5 også understøtter chatformatet.

Hvad er MiniMax-M2.5?

MiniMax-M2.5 er den seneste større modeludgivelse fra MiniMax: en evolution af M2-familien, som virksomheden positionerer som en generel, agent-kapabel model med særligt stærk ydeevne i kodegenerering, værktøjsbrug og flertrins ræsonnement. M2.5-familien blev annonceret som en udgivelse i februar 2026 og omfatter både standard M2.5 og “highspeed”-varianter, der er optimeret til lavere latenstid, mens de bevarer de samme kernekapabiliteter. M2.5-familien forbedrede benchmark-scorer i softwareingeniør-evalueringer og bedre adfærd ved interaktion med eksterne værktøjer (søgning, agenter osv.).

Leverandøren positionerer M2.5 som et skridt op fra tidligere M2.x-udgivelser med stærkere ræsonnement, bedre kodegenerering og forbedret pålidelighed for værktøjskald. MiniMax’s offentlige udgivelsesnoter for begyndelsen af februar 2026 fremhævede M2.5 som en milepæl: forfinet instruktionstuning, stærkere forståelse af kode og målbare gevinster på flere kodefokuserede benchmarks. Udgivelsen omfatter:

- En standard M2.5-model (med vægt på nøjagtighed og ræsonnement).

- En M2.5-highspeed-variant med lavere latenstid til interaktive udvikler-workflows.

- Eksplicit vejledning og faktureringsmuligheder for en “Coding Plan” til intensiv kodegenerering.

Vigtige tekniske hovedpunkter

- Arkitektur: MoE (stort samlet antal parametre med et langt mindre aktivt sæt under inferens), hvilket giver et omkostnings-/ydelsesmæssigt sweet spot til tunge opgaver.

- Styrker: førende kodningsydelse, multi-turn-ræsonnement, håndtering af lange kontekster og integrationer med agenter/værktøjer.

- Varianter: MiniMax udgiver varianter (fx

MiniMax-M2.5ogM2.5-highspeed) tunet til gennemløb vs. latenstid.

Hvorfor det er vigtigt i dag: mange teams, der bygger udviklerværktøjer, programmeringsassistenter og agentiske automatiseringer, værdsætter en model, der kan ræsonnere over flere omgange, kalde værktøjer sikkert og generere kode i høj kvalitet. M2.5 — i kraft af arkitektur og træningsvalg — markedsføres eksplicit til netop de scenarier.

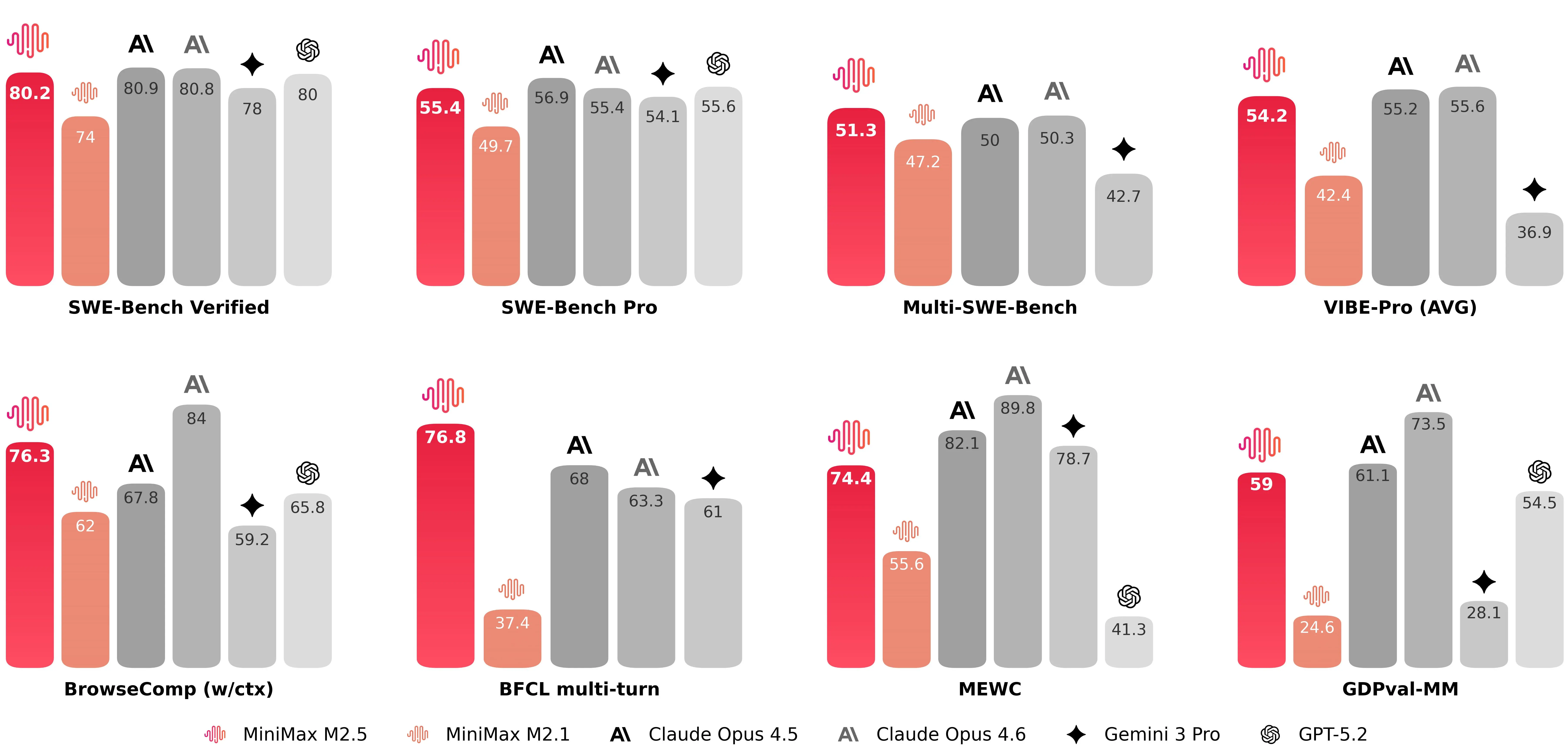

Benchmarking af MiniMax-M2.5

Hvor M2.5 placerer sig på kodningsspecifikke benchmarks

MiniMax-M2.5 scorer 80,2% på SWE-Bench Verified, sammen med stærke resultater på multitask-kodning og browsing-forstærkede benchmarks (mærkbare tal udgivet af virksomheden inkluderer 51,3% på Multi-SWE-Bench og 76,3% på BrowseComp, når konteksthåndtering er aktiveret). Disse tal placerer M2.5 blandt de højest præsterende offentligt tilgængelige modeller for kodegenerering og problemløsning ved lancering. MiniMax-M2.5’s lancering bekræfter, at M2.5 konkurrerer med topniveauet af kodningsmodeller.

For udviklere er fordelene to-delte:

- Højere førstegangs-succesrate: færre runder med rettelser, mindre menneskelig fejlfinding og lavere “babysitting”-overhead for autonome kodeagenter.

- Bedre full-stack-dækning: M2.5 beskrives som understøttende for full-stack-workflows på tværs af desktop-apps, mobil og krydsplatform-værktøjskæder, hvilket betyder, at den sigter mod at generere ikke blot snippets, men sammenhængende løsninger på tværs af flere filer samt build-scripts.

Bygget til agent-baserede arbejdsprocesser

M2.5 beskrives som “nativt designet til Agent-scenarier.” Praktisk betyder det, at arkitekturen og træningsregimet prioriterer:

- Nøjagtighed i værktøjskald: at udsende API-kald eller køre shell/SQL-kommandoer med korrekt syntaks og parametre.

- Kontekstskift og hukommelse: at fortsætte en afbrudt flertrins-operation uden at miste tidligere beregnet tilstand.

- Filhåndtering: at producere og redigere almindelige kontorformater programmæssigt (fx generere en PowerPoint og derefter revidere den baseret på en opfølgende anmodning).

Søgning og browsing-udvidelse

Når M2.5 parres med browsing- eller hentningslag, rapporterer MiniMax markant forbedrede scorer på browsing-benchmarks, som afspejler stærkere ydeevne i at integrere ekstern information og henvisninger i output. Det gør M2.5 velegnet til værktøjer, der skal hente opdateret indhold, krydstjekke API-resultater eller udvide kodegenerering med data fra den virkelige verden (fx hente de nyeste SDK-dokumenter og bruge dem korrekt under kodegenereringen). Disse kapabiliteter er vigtige for teams, der bygger “agentiske” funktioner som automatiseret QA, CI-værktøjskæder eller dokumentdrevne assistenter.

Hvordan kan jeg bruge MiniMax-2.5 API (via CometAPI)?

CometAPI er en API-aggregationsplatform, der eksponerer hundredvis af modeller via en enkelt, OpenAI-kompatibel REST-grænseflade. Fordi CometAPI’s grænseflade spejler OpenAI’s chat-/completions-endepunkter, kan du ofte genbruge eksisterende OpenAI-stil-klienter ved at skifte api_base og API-nøgle. Hvis du foretrækker ikke at integrere direkte med MiniMax’s platform (af grunde som samlet fakturering, A/B-test på tværs af modeller eller leverandørabstraktion), kan du kalde MiniMax-M2.5 via CometAPI’s “chat”-grænseflade. CometAPI-platformen tilbyder et konsistent anmodningsformat, et SDK og en web-playground — og den eksponerer pr.-modellens navne og parametre (så du vælger den præcise provider-/modelstreng ved kald).

Nedenfor er en kort, praktisk guide til at kalde MiniMax-M2.5 via CometAPI, med eksempler i curl og Python.

Hvad er de grundlæggende trin for at komme i gang?

- Opret en CometAPI-konto og få en API-nøgle. (CometAPI stiller en playground og SDK’er til rådighed for at teste modeller.)

- Tjek CometAPI’s modelliste eller CometAPI’s playground for at finde det præcise modelnavn for MiniMax-M2.5.

- Foretag en autentificeret POST-anmodning med

model-parameteren sat til den valgte MiniMax-model og en payload, der følger CometAPI’s chat-/completions-skema. - Justér parametre (temperature, max_tokens, system-meddelelser, streaming) efter din workflow.

Godkendelse og endpoint-grundlag

- Basis-URL:

https://api.cometapi.com/v1(OpenAI-stil-stier som/chat/completionser understøttet). - Header:

Authorization: Bearer YOUR_COMETAPI_KEY - Content-Type:

application/json - Model-felt: brug den nøjagtige modelstreng fra CometAPI’s modelkatalog (eksempler:

"minimax-m2.5")

Eksempel 1 — Hurtig curl (REST, OpenAI-stil)

// Replace $COMETAPI_KEY with your CometAPI key

curl -s -X POST "https://api.cometapi.com/v1/chat/completions" \

-H "Authorization: Bearer $COMETAPI_KEY" \

-H "Content-Type: application/json" \

-d '{

"model": "minimax-m2.5",

"messages": [

{"role":"system","content":"You are a concise, safety-conscious coding assistant."},

{"role":"user","content":"Refactor this synchronous Python function to async and add basic error handling:\n\n```\ndef fetch(user_id):\n resp = http_get(f\"https://api.example.com/users/{user_id}\")\n return resp.json()\n```"}

],

"max_tokens": 800,

"temperature": 0.0,

"stream": false

}'

Bemærkninger:

- Brug modelstrengen præcis som vist i CometAPI’s katalog; s.

stream: trueunderstøttes for streaming-outputs (håndter server-sent events eller opsplittede svar, hvis du vil have delvise tokens).

Eksempel 2 — Python (requests) for en chat-completion

import os, requests

COMET_KEY = os.environ.get("COMETAPI_KEY") # recommended

URL = "https://api.cometapi.com/v1/chat/completions"

headers = {

"Authorization": f"Bearer {COMET_KEY}",

"Content-Type": "application/json",

}

payload = {

"model": "minimax-m2.5", # or "minimax/minimax-m2.5" — verify Comet's model page

"messages": [

{"role": "system", "content": "You are a helpful engineer who returns clear, tested code."},

{"role": "user", "content": "Write a pytest for the following function that asserts edge cases..."}

],

"temperature": 0.1,

"max_tokens": 1000,

}

r = requests.post(URL, json=payload, headers=headers, timeout=120)

r.raise_for_status()

out = r.json()

print(out["choices"][0]["message"]["content"])

Eksempel 3 — Brug af litellm / CometAPI-integration (Python-bekvemmelighedslag)

CometAPI understøttes af flere community-SDK’er og adaptere. LiteLLM-dokumentationen viser et kompakt flow, hvor du sætter COMETAPI_KEY og kalder modellen ved navn. Det er godt til prototyper:

import os

from litellm import completion

os.environ["COMETAPI_KEY"] = "your_cometapi_key_here"

messages = [{"role":"user", "content":"Explain async/await in Python in 3 bullets."}]

resp = completion(model="minimax-m2.5", messages=messages)

print(resp.choices[0].message.content)

Litellm-/Comet-integrationer tilbyder nyttige værktøjer (streaming, async, eksplicit api_key-parameter), der afspejler mange eksisterende OpenAI SDK-mønstre.

Hvordan bør du designe prompts og systemmeddelelser til M2.5

Vær eksplicit om rolle og begrænsninger

Giv M2.5 en tydelig systemrolle, når du beder om kode. Eksempel:

{"role": "system","content": "You are MiniMax M2.5, an assistant specialized in robust, readable, and well-documented code. Use Python 3.11 conventions, include type hints, and provide brief unit tests."}

Brug trinopdeling til komplekse problemer

Når du beder M2.5 om at implementere komplekse funktioner, brug en kort opdeling:

- Bed om et designoverblik.

- Bed om grænsefladesignaturer.

- Bed om implementering og tests.

Dette reducerer risikoen for hallucinationer og giver modulære, gennemskuelige outputs.

Temperature, max_tokens og sikkerhed

- Til deterministisk kode: sæt

temperaturetæt på 0,0. - Til eksplorativt design:

temperaturepå 0,2–0,5 kan frembringe kreative tilgange. - Hold

max_tokensgenerøs til store refaktoreringer eller lange test-suiter.

Bed om enhedstests og begrundelse

Når du beder om kode, så bed også om enhedstests og en kort forklaring af algoritmen. Det hjælper dig med at opdage subtile fejl og få kørbare artefakter i første forsøg.

Langvarig inferens og tilstandssporing

M2.5-modellen har en fremragende mekanisme til tilstandssporing, der effektivt sikrer kontinuitet og retning i tankegangen over lange tidssekvenser ved at fokusere på et begrænset antal mål ad gangen frem for at behandle alt parallelt. M2.5 er udstyret med kontekstbevidst funktionalitet, hvilket muliggør effektiv opgaveløsning og optimeret konteksthåndtering.

Praktiske M2.5-brugstips til produktion

MiniMax-M2.5 er tunet til flertrins-værktøjer og kode. Nedenfor er praktiske, erfaringsbaserede tips til at få de bedste resultater i produktion.

Prompt-engineering og systemmeddelelser

- Brug eksplicitte systemmeddelelser for rolle og begrænsninger. Til kodeopgaver, inkluder påkrævet runtime/test-frameworks (fx “Returner en pytest kompatibel med Python 3.11”).

- Lever kontekst: til agentiske eller flertrinsjobs, inkluder trinmetadata og værktøjsbeskrivelser som struktureret JSON eller punktlister. M2.5 reagerer godt på strukturerede inputs, fordi den er optimeret til værktøjsbrug.

Funktions-/værktøjskald

- Hvis du bruger CometAPI som gateway til værktøjskald, skal du sikre, at dine ekstra felter (fx

function_calli OpenAI-stil) matcher CometAPI’s/modelens forventninger. Bekræft modelunderstøttelse på Comets modelside, da værktøjssemantik kan variere efter udbyder. - For robust orkestrering, opdel store opgaver i mindre kald og oprethold deterministiske checkpoints. M2.5 er stærk til at følge flertrins-instruktioner, men du får den mest pålidelige adfærd ved at validere efter hvert trin.

Temperature, max_tokens og omkostningskontrol

- Til kodegenerering eller refaktorering: sæt

temperaturelavt (0,0–0,2) og brugmax_tokenstilpasset den forventede outputstørrelse. - Til eksplorative prompts: hæv

temperature, men hold øje med øget token-forbrug. Når du router via CometAPI, sammenlign udbyderpriser og fallback-regler — CometAPI viser token-prissætning pr. modelinstans i deres katalog.

Kontekstvindue og lange dokumenter

- M2.5-varianter understøtter ofte lange kontekster (tjek modelspecifikationen for kontekstlængde). For meget lange dokumenter, opdel og opsummer — og giv derefter sammendragene plus relevante uddrag, i stedet for at sende hele filer i én anmodning.

Sikkerhed, skadeligt indhold og afhjælpning af hallucinationer

- Brug værn: systemmeddelelser, eksterne validatorer og test-suiter (fx enhedstests for genereret kode) reducerer risiko.

- Validér eksterne referencer: hvis modellen citerer fakta eller kode fra nettet, verificér programmæssigt, før du stoler på eller leverer resultaterne.

Hvilke almindelige faldgruber findes der, og hvordan undgår man dem

Faldgrube: At stole for meget på et enkelt modeloutput

Afhjælpning: Kør tests, statiske checks, og for kritisk logik, anmod om flere uafhængige completions og sammenlign. CometAPI tillader skift mellem flere modeller, og du kan til enhver tid skifte mellem dem ved hjælp af OpenAI’s chatformat.

Faldgrube: Brug af høj temperature til produktionskode

Afhjælpning: Hold temperature lav; hvis du har brug for kreative alternativer, anmod om flere variationer med lav temperatur, eller bed modellen forklare forskellene.

Faldgrube: Ignorere modelversionering

Afhjælpning: Spor modelnavne og provider-strenge i dine udrulningsmanifester. Når du skifter fra MiniMax-M2.5 til MiniMax-M2.5-highspeed eller til en anden udbyder, behandl det som en release-ændring og kør regressionstests.

Endelige anbefalinger og realistiske forventninger

MiniMax-M2.5 er et bemærkelsesværdigt skridt fremad for kodecentriske, agentiske LLM’er — den lover stærk kodegenerering, fleromgangs-ræsonnement og værktøjssikker adfærd. Hvis dit teams prioriteter er at bygge robuste udviklerværktøjer, agentrammer eller kodeassistenter, fortjener M2.5 en plads i din sammenligningsmatrix. Brug af CometAPI som en samlet gateway kan accelerere eksperimenter og lade dig skifte udbydere eller A/B-modeller uden at ændre hele din integration.

Nogle pragmatiske pointer:

- Prototyp hurtigt ved hjælp af CometAPI’s playground, og lås derefter modelidentifikatorer fast i kode.

- Brug lav temperatur, bed om tests og forklaringer, og kør altid automatiseret validering.

- Behandl modellen som en stærk medudvikler — ikke en ufejlbarlig: anvend menneskelig review, CI-pipelines og telemetri.

Udviklere kan få adgang til MInimax-M2.5 via CometAPI nu. For at begynde, udforsk modellens kapabiliteter i Playground og se API-guide for detaljerede instruktioner. Før adgang skal du sikre, at du er logget ind på CometAPI og har fået API-nøglen. CometAPI tilbyder en pris, der er langt lavere end den officielle pris, for at hjælpe dig med at integrere.

Ready to Go?→ Sign up fo M2.5 today !

Hvis du vil have flere tips, guider og nyheder om AI, så følg os på VK, X og Discord!