Hvad er GPT-5.2 API

GPT-5.2 API er det samme som GPT-5.2 Thinking i ChatGPT. GPT-5.2 Thinking er mellemniveau-varianten af OpenAI’s GPT-5.2-familie, designet til dybere arbejde: multitrins ræsonnering, sammenfatning af lange dokumenter, generering af kvalitetskode og professionelt vidensarbejde, hvor nøjagtighed og anvendelig struktur betyder mere end rå gennemløb. I API'et er den eksponeret som modellen gpt-5.2 (Responses API / Chat Completions), og den ligger mellem den Instant-variant med lav latenstid og den variant med højere kvalitet men højere pris, Pro.

Vigtigste funktioner

- Meget lang kontekst og komprimering: 400K effektivt vindue og komprimeringsværktøjer til at håndtere relevans på tværs af lange samtaler og dokumenter.

- Konfigurerbar ræsonneringsindsats:

none | medium | high | xhigh(xhigh aktiverer maksimal intern beregning for krævende ræsonnering).xhigher tilgængelig for Thinking/Pro-varianter. - Stærkere værktøjs- og funktionsunderstøttelse: førsteklasses værktøjskald, grammatikker (CFG/Lark) til at begrænse strukturerede outputs, og forbedrede agentiske adfærdsmønstre, der forenkler kompleks flertrinsautomatisering.

- Multimodal forståelse: rigere billede + tekstforståelse og integration i flertrinsopgaver.

- Forbedret sikkerhed / håndtering af følsomt indhold: målrettede indgreb for at reducere uønskede svar i områder som selvskade og andre følsomme kontekster.

Tekniske kapaciteter og specifikationer (udviklerperspektiv)

- API-endpoints og model-ID'er:

gpt-5.2for Thinking (Responses API),gpt-5.2-chat-latestfor chat/instant-arbejdsgange oggpt-5.2-profor Pro-niveauet; tilgængelig via Responses API og Chat Completions hvor angivet. - Ræsonneringstokens og indsatsstyring: API'et understøtter eksplicitte parametre til at allokere beregningskapacitet (ræsonneringsindsats) pr. anmodning; højere indsats øger latenstid og omkostning, men forbedrer outputkvaliteten for komplekse opgaver.

- Strukturerede outputværktøjer: understøttelse af grammatikker (Lark / CFG) til at begrænse modellens output til en DSL eller nøjagtig syntaks (nyttigt til SQL, JSON, DSL-generering).

- Parallelt værktøjskald og agentisk koordinering: forbedret parallelisme og renere orkestrering af værktøjer reducerer behovet for omfattende systemprompter og multi-agent-støttestrukturer.

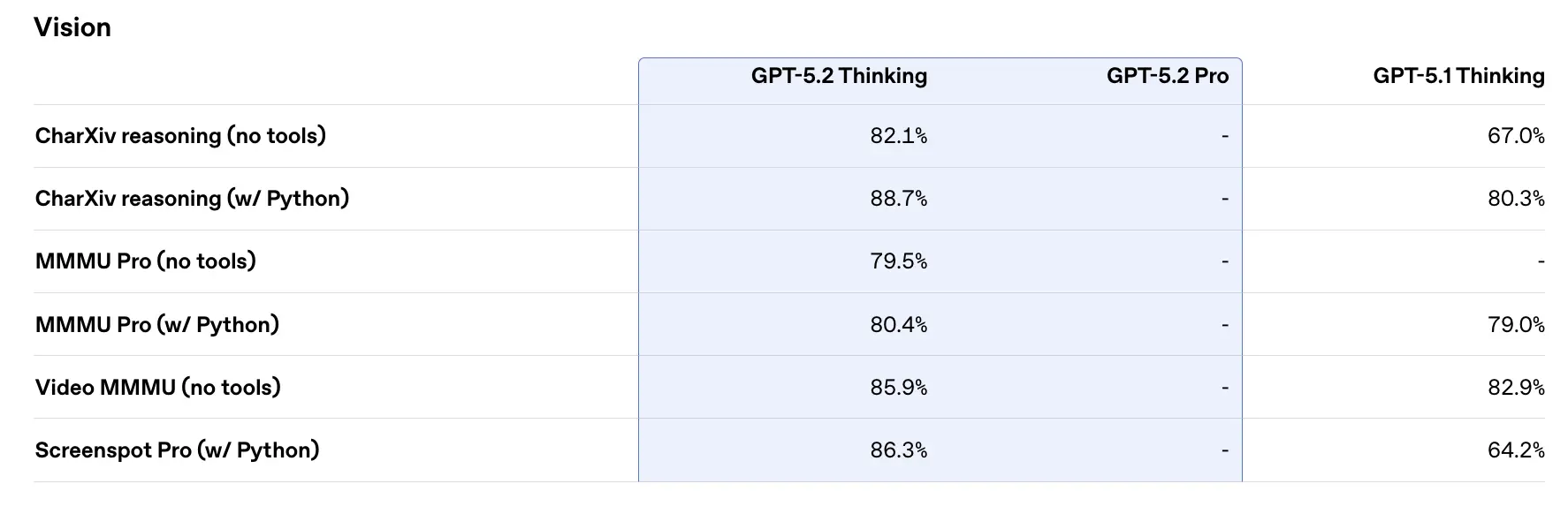

Benchmark-ydeevne og støttedata

OpenAI har publiceret en række interne og eksterne benchmarkresultater for GPT-5.2. Udvalgte højdepunkter (OpenAI’s rapporterede tal):

- GDPval (44 occupations, knowledge work) — GPT-5.2 Thinking "slår eller matcher førende brancheprofessionelle i 70.9% af sammenligningerne"; OpenAI rapporterer, at outputs blev produceret med >11× hastigheden og <1% af omkostningen i forhold til ekspertprofessionelle på deres GDPval-opgaver (hastigheds- og omkostningsestimater er historisk baserede). Disse opgaver omfatter regnearksmodeller, præsentationer og korte videoer.

- SWE-Bench Pro (coding) — GPT-5.2 Thinking opnår ≈55.6% på SWE-Bench Pro og ~80% på SWE-Bench Verified (kun Python) ifølge OpenAI, hvilket etablerer en ny state-of-the-art for kodegenerering/ingeniørevaluering i deres tests. Dette omsættes til mere pålidelig debugging og end-to-end-rettelser i praksis, ifølge OpenAI’s eksempler.

- GPQA Diamond (graduate-level science Q&A) — GPT-5.2 Pro: 93.2%, GPT-5.2 Thinking: 92.4% på GPQA Diamond (ingen værktøjer, maksimal ræsonnering).

- ARC-AGI series — På ARC-AGI-2 (en sværere benchmark for flydende ræsonnering) scorede GPT-5.2 Thinking 52.9% og GPT-5.2 Pro 54.2% (OpenAI siger, at dette er nye state-of-the-art-mærker for chain-of-thought-stil-modeller).

- Long-context (OpenAI MRCRv2) — GPT-5.2 Thinking viser nær-100% nøjagtighed på 4-needle MRCR-varianten ud til 256k tokens og væsentligt forbedrede resultater vs GPT-5.1 på tværs af long-context-indstillinger. (OpenAI publicerede MRCRv2-diagrammer og -tabeller.)

Sammenligning med samtidige

- vs Google Gemini 3 (Gemini 3 Pro / Deep Think): Gemini 3 Pro er blevet offentliggjort med et ~1,048,576 (≈1M) token kontekstvindue og brede multimodale input (tekst, billede, lyd, video, PDF'er) samt stærke agentiske integrationer via Vertex AI / AI Studio. På papiret er Gemini 3's større kontekstvindue en differentieringsfaktor for ekstremt store enkelt-session-arbejdsbelastninger; kompromiser omfatter værktøjsflade og økosystemtilpasning.

- vs Anthropic Claude Opus 4.5: Anthropic’s Opus 4.5 lægger vægt på enterprise-kodning/agent-arbejdsgange og rapporterer stærke SWE-bench-resultater og robusthed for lange agentiske sessioner; Anthropic positionerer Opus til automatisering og kodegenerering med et 200k kontekstvindue og specialiserede agent-/Excel-integrationer. Opus 4.5 er en stærk konkurrent inden for enterprise-automatisering og kodeopgaver.

Praktisk konklusion: GPT-5.2 sigter mod et afbalanceret sæt forbedringer (400k kontekst, høje token-outputs, forbedret ræsonnering/kodning). Gemini 3 sigter mod de absolut største enkelt-session-kontekster (≈1M), mens Claude Opus fokuserer på enterprise-engineering og agentisk robusthed. Vælg ved at matche kontekststørrelse, modalitetsbehov, funktions-/værktøjspasform og kompromiser mellem omkostning/latenstid.

Sådan får du adgang til og bruger GPT-5.2 API

Trin 1: Registrer dig for API-nøgle

Log ind på cometapi.com. Hvis du ikke er bruger hos os endnu, registrer dig først. Log ind på din CometAPI console. Hent API-adgangsnøglen til grænsefladen. Klik på “Add Token” ved API token i det personlige center, få token-nøglen: sk-xxxxx og indsend.

Trin 2: Send anmodninger til GPT-5.2 API

Vælg “gpt-5.2”-endpointet for at sende API-anmodningen og angiv anmodningskroppen. Anmodningsmetoden og anmodningskroppen fås fra vores websteds API-dokumentation. Vores websted tilbyder også Apifox-test for din bekvemmelighed. Erstat <YOUR_API_KEY> med din faktiske CometAPI-nøgle fra din konto. Udviklere kalder disse via Responses API / Chat endpoints.

Indsæt dit spørgsmål eller din anmodning i content-feltet—det er dette, modellen vil svare på . Behandl API-svaret for at få det genererede svar.

Trin 3: Hent og verificer resultater

Behandl API-svaret for at få det genererede svar. Efter behandling svarer API'et med opgavestatus og outputdata.

Se også Gemini 3 Pro Preview API