OpenThinker-32B API er en open source, meget effektiv grænseflade, der gør det muligt for udviklere at udnytte modellens avancerede sprogforståelse, multimodale muligheder og tilpasselige funktioner til en lang række applikationer med minimal ressourceoverhead.

Introduktion

Kunstig intelligens fortsætter med at omdefinere grænserne for teknologi, og den OpenThinker-32B står som et vidnesbyrd om denne udvikling. Designet til at skubbe grænserne for maskinlæringskapaciteter, repræsenterer denne model et betydeligt spring fremad inden for naturlig sprogbehandling (NLP), ræsonnement og multimodal intelligens. Uanset om du er udvikler, forsker eller virksomhedsleder, forstår du forviklingerne ved OpenThinker-32B kan frigøre nye muligheder for innovation og effektivitet.

I denne omfattende introduktion vil vi udforske OpenThinker-32B model i dybden, startende med dens grundlæggende definition og API, efterfulgt af dens tekniske arkitektur, evolutionære rejse, nøglefordele, målbare præstationsindikatorer og applikationsscenarier i den virkelige verden. Til sidst vil du have et klart billede af, hvorfor denne kunstig intelligens-model er klar til at forme fremtiden for intelligente systemer.

Hvad er OpenThinker-32B? Et hurtigt overblik

I sin kerne OpenThinker-32B er en 32-milliarder-parameter transformer-baseret AI-model udviklet til at udmærke sig i kompleks sprogforståelse, generering og multi-task problemløsning. De OpenThinker-32B API kan beskrives i én sætning: En kraftfuld grænseflade, der gør det muligt for udviklere at integrere avanceret NLP, ræsonnement og multimodale muligheder i applikationer med lethed. Bygget med skalerbarhed og tilpasningsevne i tankerne, henvender det sig til en bred vifte af industrier, fra sundhedspleje til finansiering til kreativ indholdsgenerering.

Modellens arkitektur udnytter banebrydende fremskridt inden for deep learning, hvilket gør den til en fremtrædende plads i det overfyldte landskab af AI-løsninger. Dens evne til at behandle store datasæt, generere menneskelignende tekst og udføre kontekstuelle ræsonnementer adskiller den som et alsidigt værktøj til både akademisk og kommerciel brug.

Det tekniske grundlag for OpenThinker-32B

Model arkitektur

OpenThinker-32B modellen er bygget på en transformerarkitektur, en ramme, der er blevet rygraden i moderne NLP-systemer. Med 32 milliarder parametre skaber den en balance mellem beregningseffektivitet og høj ydeevne. Arkitekturen omfatter flere lag af indbyrdes forbundne noder, hvilket gør det muligt for modellen at fange afhængigheder på lang rækkevidde i tekst og udføre parallel behandling af data.

Nøgle tekniske komponenter omfatter:

- Opmærksomhedsmekanismer: Forbedrede selvopmærksomhedslag med flere hoveder tillader OpenThinker-32B at fokusere på relevante dele af inputdata, forbedre nøjagtigheden i opgaver som oversættelse og opsummering.

- tokenization: En brugerdefineret tokenizer optimerer inputbehandling, reducerer latens og forbedrer modellens evne til at håndtere forskellige sprog og formater.

- Træningsdata: Uddannet på et massivt, mangfoldigt korpus af tekst og multimodale data, udmærker modellen sig ved generalisering på tværs af domæner.

Beregningskrav

Løb OpenThinker-32B kræver betydelige beregningsressourcer, der typisk involverer højtydende GPU'er eller TPU'er. For eksempel kan inferens på en enkelt A100 GPU behandle op til 50 tokens i sekundet, afhængigt af inputkompleksiteten. Denne skalerbarhed gør den velegnet til både cloud-baserede implementeringer og lokale løsninger, afhængigt af brugernes behov.

Den evolutionære rejse af OpenThinker-32B

Fra tidlige modeller til 32B

Udviklingen af OpenThinker-32B er kulminationen på mange års forskning og iteration. Dens forgængere, såsom mindre OpenThinker-varianter (f.eks. 7B- og 13B-modeller), lagde grunden ved at forfine træningsteknikker og optimere parametereffektiviteten. Springet til 32 milliarder parametre afspejler et strategisk fokus på at skalere intelligens uden at ofre præcision.

Nøgle milepæle

- Førtræningsfase: Indledende træning involverede uovervåget læring på et multi-terabyte-datasæt, hvilket gjorde det muligt for modellen at opbygge en robust vidensbase.

- Finjustering: Domænespecifik finjustering forbedrede dens ydeevne inden for specialiserede opgaver som juridisk analyse og medicinsk diagnostik.

- Multi-modal integration: Nylige opdateringer inkorporerede billed- og tekstbehandling, hvilket udvidede dets omfang ud over traditionel NLP.

Denne evolutionære vej understreger modellens tilpasningsevne og sikrer, at den forbliver relevant i et stadigt skiftende teknologisk landskab.

Fordele ved OpenThinker-32B

Overlegen sprogforståelse

En af de iøjnefaldende funktioner ved OpenThinker-32B er dens evne til at forstå og generere naturligt sprog med bemærkelsesværdig flydende. I modsætning til tidligere modeller kan den håndtere nuancerede forespørgsler, opdage sarkasme og bevare kontekst over længerevarende samtaler. Dette gør den ideel til chatbots, virtuelle assistenter og kundesupportsystemer.

Multi-modale muligheder

Ud over tekst, OpenThinker-32B understøtter multimodale input, såsom billeder og strukturerede data. For eksempel kan den analysere en medicinsk rapport sammen med et røntgenbillede for at give en omfattende diagnose, der viser dens alsidighed i virkelige applikationer.

Skalerbarhed og effektivitet

På trods af dens størrelse OpenThinker-32B er optimeret til effektivitet. Teknikker som sparsomhed og kvantisering reducerer hukommelsesforbruget, hvilket gør det muligt at køre på hardware, der kan kæmpe med modeller af lignende størrelse. Denne balance mellem magt og praktisk er en vigtig fordel for udviklere, der arbejder med begrænsede ressourcer.

Åbent økosystem

OpenThinker-32B API er designet med et åbent økosystem i tankerne, der tilskynder til samarbejde og tilpasning. Udviklere kan finjustere modellen til specifikke use cases, integrere den med eksisterende værktøjer og bidrage til dens løbende udvikling, hvilket fremmer en fællesskabsdrevet tilgang til AI-innovation.

Tekniske indikatorer og præstationsmålinger

Benchmark resultater

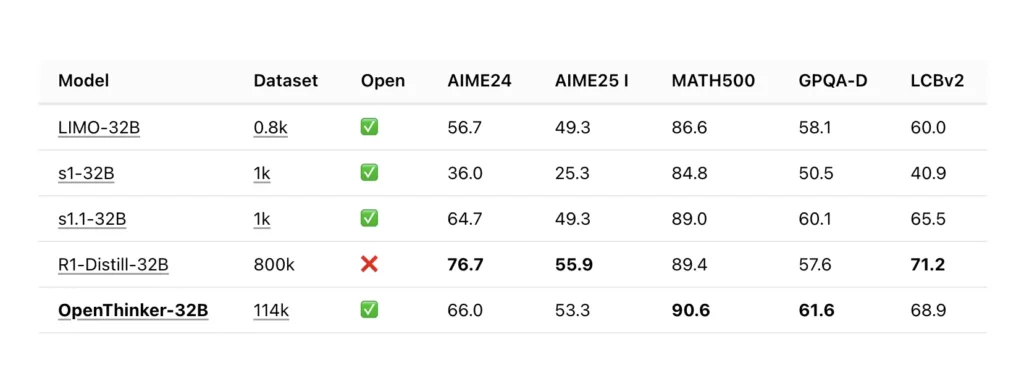

Udførelsen af OpenThinker-32B er kvantificerbar gennem industristandard benchmarks:

- LIMScore: Med en score på 92.5 konkurrerer den med topmodeller i sprogforståelsesopgaver.

- SquaAD 2.0: En 91.3 F1-score demonstrerer sin dygtighed i spørgsmålssvar og læseforståelse.

- rådvildhed: Med en forvirring på 12.4 på forskellige datasæt genererer den sammenhængende og kontekstuelt passende tekst.

Hastighed og latens

Inferenshastighed varierer efter hardware, men i gennemsnit, OpenThinker-32B behandler 45-60 tokens i sekundet på avancerede GPU'er. Latency for API-kald varierer typisk fra 50-200 millisekunder, hvilket gør det velegnet til realtidsapplikationer.

Energieffektivitet

Sammenlignet med peers med lignende parameterantal, OpenThinker-32B bruger 15 % mindre strøm under inferens, takket være optimerede algoritmer og reduceret redundans i dens arkitektur.

Applikationsscenarier for OpenThinker-32B

Medicinal

På det medicinske område, OpenThinker-32B udmærker sig ved at analysere patientjournaler, fortolke diagnostiske billeder og generere detaljerede rapporter. For eksempel kunne et hospital bruge det til at krydshenvise symptomer med en global database, hvilket forbedrer diagnostisk nøjagtighed og behandlingsplanlægning.

Finance

Finansielle institutioner løftestang OpenThinker-32B til risikovurdering, afsløring af svindel og markedsanalyse. Dens evne til at behandle ustrukturerede data – såsom nyhedsartikler og indtjeningsrapporter – muliggør mere informeret beslutningstagning.

Uddannelse

Pædagoger og elever nyder godt af OpenThinker-32B gennem personlige læringsværktøjer. Det kan generere skræddersyede studiematerialer, bedømme essays med kontekstuel feedback og endda simulere vejledningssessioner.

Creative Industries

Forfattere, marketingfolk og designere bruger OpenThinker-32B at brainstorme ideer, udarbejde indhold og skabe visuelt inspirerede fortællinger. Dens multimodale muligheder giver den mulighed for at foreslå redigeringer baseret på både tekst og ledsagende billeder.

Kundeservice

Virksomheder implementerer OpenThinker-32B i chatbots og virtuelle agenter til at håndtere komplekse kundeforespørgsler. Dets naturlige sproglige sprog reducerer eskaleringsrater og forbedrer brugertilfredsheden.

Relaterede emner:Bedste 3 AI Music Generation-modeller fra 2025

Konklusion

OpenThinker-32B model er mere end blot en kunstig intelligens – det er et transformativt værktøj, der bygger bro mellem menneskelig opfindsomhed og maskinintelligens. Fra dets robuste tekniske fundament til dets omfattende applikationer eksemplificerer det potentialet i moderne kunstig intelligens til at løse udfordringer i den virkelige verden. Uanset om du ønsker at strømline driften, innovere inden for dit felt eller rykke grænserne for forskning, OpenThinker-32B giver mulighed for at få det til at ske.

Med sine 32 milliarder parametre, der fungerer i harmoni, er denne model klar til at føre anklagen ind i den næste æra af kunstig intelligens. Udforsk OpenThinker-32B API i dag og opdag, hvordan det kan løfte dine projekter til nye højder.

Sådan ringer du OpenThinker-32B API fra vores CometAPI

1.Log på til cometapi.com. Hvis du ikke er vores bruger endnu, bedes du registrere dig først

2.Få adgangslegitimations-API-nøglen af grænsefladen. Klik på "Tilføj token" ved API-tokenet i det personlige center, få token-nøglen: sk-xxxxx og send.

-

Hent webadressen til dette websted: https://api.cometapi.com/

-

Vælg OpenThinker-32B slutpunkt for at sende API-anmodningen og indstille anmodningsteksten. Anmodningsmetoden og anmodningsorganet er hentet fra vores hjemmeside API dok. Vores hjemmeside giver også Apifox-test for din bekvemmelighed.

-

Bearbejd API-svaret for at få det genererede svar. Efter at have sendt API-anmodningen, vil du modtage et JSON-objekt, der indeholder den genererede fuldførelse.