Qwen-billede er en billedgenerering og billedredigering fundament model i Qwen-familien designet til tekstgengivelse med høj kvalitet, præcis redigeringog generel tekst-til-billede-generering. Den er designet til at udføre tekstbevidst generation, tosproget tekstgengivelse (især stærk i kinesisk og engelsk), og Finkornet redigering i kontekstMeddelelsen understreger en kombineret forstå + generere designfilosofi (billedforståelsesopgaver og generative opgaver trænet i en samlet pipeline).

Nøglefunktioner

- Native/højkvalitets tekstgengivelse i billeder — udmærker sig ved at producere læselig, semantisk præcis tekst i genererede billeder (plakater, emballage, skærmbilleder) — et område, som mange tidligere billedmodeller kæmpede med.

- Højtydende multimodal output — producerer fotorealistiske og stiliserede billeder med gode detaljer og sprogbevidst layout.

- Stiloverførsel og detaljeforbedring — kan anvende ensartede kunstneriske stilarter eller forbedre lokale detaljer, samtidig med at sammenhængen i scenen bevares.

Tekniske detaljer — hvordan Qwen-Image fungerer

Arkitektur og komponenter (nøgleord: MMDiT, Qwen2.5-VL). Modellen bruger en MMDiT-baseret diffusionstransformator til billedsyntese kombineret med en visuel-sprog-encoder (Qwen2.5-VL) til at fortolke prompter og visuel kontekst. Denne adskillelse gør det muligt for modellen at behandle semantisk vejledning og pixeludseende forskelligt, hvilket forbedrer tekstnøjagtigheden og redigeringskonsistensen. Det officielle repository og den tekniske rapport bemærker en 20B-parameter-rygrad for den primære T2I-model.

Træningspipeline (nøgleord: pensumlæring, datapipeline). For at løse gengivelsen af vanskelig tekst bruger Qwen-Image en progressiv læseplanDet starter med enklere ikke-tekstbilleder og trænes gradvist på mere komplekse tekstrige eksempler op til input på afsnitsniveau. Teamet konstruerede en omfattende pipeline, der inkluderer storstilet indsamling, omhyggelig filtrering, syntetisk forstørrelse og balancering for at sikre, at modellen ser mange realistiske tekst-/fotokompositioner under træningen. Denne strategiske læseplan er en nøgleårsag til, at modellen udmærker sig ved flersproget tekstgengivelse.

Redigeringsmekanisme (nøgleord: dobbeltkodning, VAE + VL-encoder). Til redigering, systemet fremfører det originale billede to gange: én gang ind i Qwen2.5-VL-encoderen for semantisk kontrol og én gang ind i en VAE-encoder til information om rekonstruktivt udseendeDesignet med dobbelt kodning gør det muligt for redigeringsmodulet at bevare identitet og visuel nøjagtighed, samtidig med at det tillader semantiske ændringer — for eksempel at erstatte et objekt eller ændre tekstindhold uden at forringe uafhængige områder.

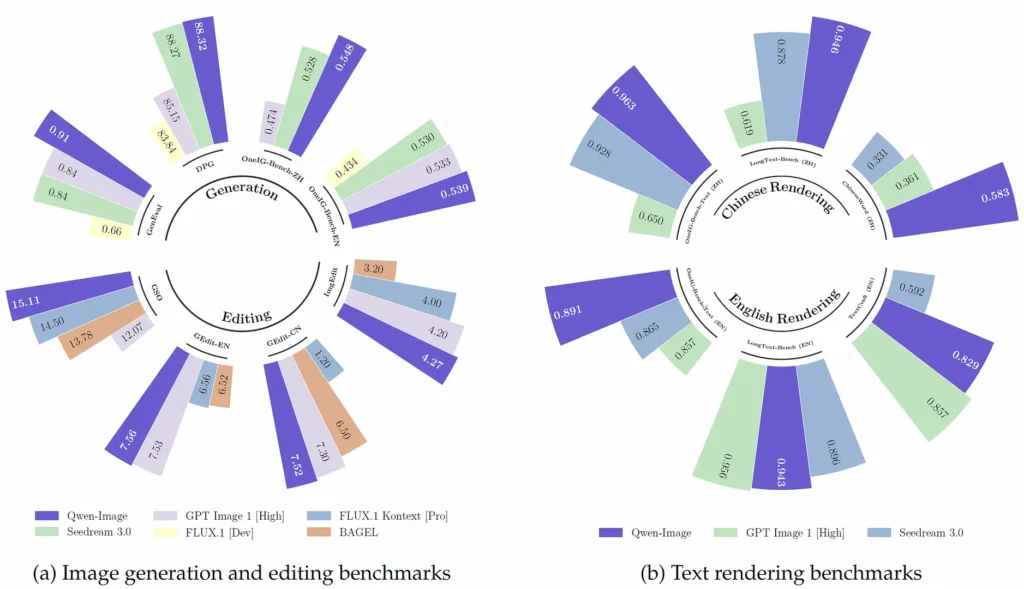

Benchmark ydeevne

Qwen-Image opnår SOTA- eller nær-SOTA-ydeevne på tværs af flere offentlige benchmarks for både generering og redigering, med særligt stærke resultater i tekstgengivelsesopgaver og kompositionsbenchmarks i den virkelige verden (f.eks. T2I-CoreBench og kuraterede billedredigeringspakker).

Hvordan Qwen-Image klarer sig i forhold til andre førende modeller

Relative styrker: tekstgengivelse og tosproget tekstnøjagtighed er modellens karakteristiske fordele i forhold til mange generative konkurrenter (f.eks. DALL·E 3, SDXL, Midjourney), som ofte er stærkere i rent kunstnerisk komposition eller stilistisk diversitet, men svagere ved tæt flerlinjet tekstlayout eller kinesisk tekstlayout. Flere sammenligninger med andre fællesskaber og modelforfatternes benchmarktabeller understøtter denne karakterisering.

Relative afvejninger: Sammenlignet med lukkede, kraftigt afstemte kommercielle systemer kan Qwen-Image kræve efterbehandling eller prompt/adapter-tuning for at opnå identisk realisme i visse sammenhænge (buet overfladevridning, fotorealistisk komposition), ifølge uafhængige tests. For brugere, der prioriterer skabelondesign, emballagemockups eller tosprogede tekstlayouts, Qwen-Image har en tendens til at være at foretrække.

Typiske og værdifulde anvendelsesscenarier

- Emballage- og produktmodeller: præcis tekst og layout med flere linjer til etiketter og emballageforsøg.

- Reklame- og designudkast: hurtig prototyping, hvor tekstnøjagtighed er vigtig (plakater, bannere).

- Dokumenteret billedgenerering: generere billeder, der skal indeholde læsbart indhold (menuer, skilte, grænseflader).

- Billedredigeringspipelines: Målrettede redigeringer (tekstudskiftning, tilføjelse/fjernelse af objekter) bevarelse af stil og perspektiv.

Sådan kalder du qwen-image API fra CometAPI

qwen-image API-priser i CometAPI, 20 % rabat på den officielle pris:

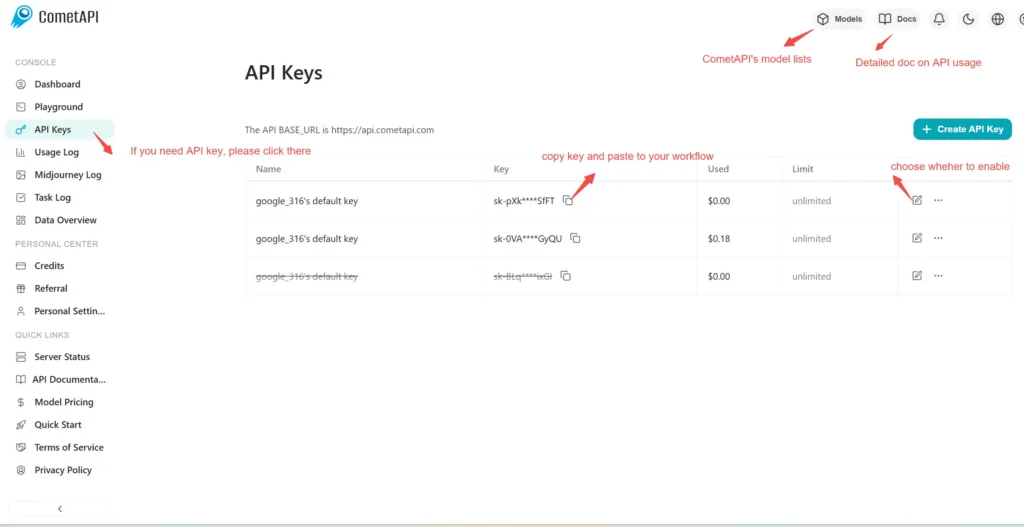

Påkrævede trin

- Log ind på cometapi.com. Hvis du ikke er vores bruger endnu, bedes du registrere dig først.

- Log ind på din CometAPI-konsol.

- Få adgangslegitimations-API-nøglen til grænsefladen. Klik på "Tilføj token" ved API-tokenet i det personlige center, få token-nøglen: sk-xxxxx og send.

Brug metoden

- Vælg "qwen-image"-slutpunktet for at sende API-anmodningen, og angiv anmodningsteksten. Anmodningsmetoden og anmodningsteksten kan hentes fra vores hjemmesides API-dokumentation. Vores hjemmeside tilbyder også en Apifox-test for din bekvemmelighed.

- Erstatte med din faktiske CometAPI-nøgle fra din konto.

- Indsæt dit spørgsmål eller din anmodning i indholdsfeltet – det er det, modellen vil reagere på.

- . Behandle API-svaret for at få det genererede svar.

CometAPI leverer en fuldt kompatibel REST API – til problemfri migrering. Vigtige detaljer til billedgenerering:

- Basis URL: https://api.cometapi.com/v1/images/generations

- Modelnavne: qwen-billede

- Godkendelse:

Bearer YOUR_CometAPI_API_KEYheader - Indholdstype:

application/json.

Modellen “qwen-image” kræver ikke parameteren “n” og kan kun udsende ét billede.