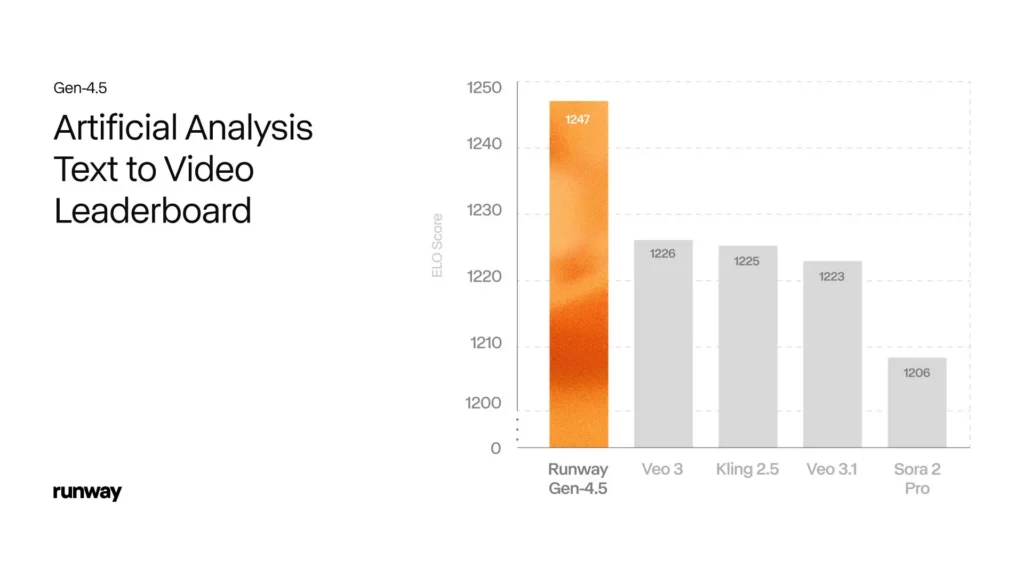

Runway Gen-4.5 er virksomhedens nyeste flagskibsmodel inden for tekst-til-video, der blev annonceret den 1. december 2025. Den er positioneret som en trinvis, men meningsfuld udvikling i forhold til Gen-4-familien med fokuserede forbedringer i bevægelseskvalitet, hurtig overholdelse og tidsmæssig/fysisk realisme – præcis de områder, der historisk set adskilte "god" AI-video fra "troværdig" AI-video. Runway Gen-4.5 fører den nuværende rangliste over tekst-til-video inden for kunstig analyse (1,247 Elo-point) og er indstillet til filmiske, kontrollerbare output – samtidig med at den stadig har typiske generative AI-begrænsninger såsom artefakter med små detaljer og lejlighedsvise årsagsfejl.

Nedenfor er et dybdegående, praktisk og (hvor det er muligt) evidensbaseret kig på, hvad Gen-4.5 er, hvad der er nyt i forhold til Gen-4, hvordan det klarer sig i forhold til konkurrenter som Googles Veo (3.1) og OpenAIs Sora 2, præstationssignaler og benchmark-påstande fra den virkelige verden, samt en åben diskussion af begrænsninger, risici og bedste praksis.

Hvad er landingsbane Gen-4.5?

Runway Gen-4.5 er den nyeste tekst-til-video-genereringsmodel fra Runway, udgivet som en iterativ, men betydelig opgradering af virksomhedens Gen-4-linje. Runway positionerer Gen-4.5 som en "ny grænse" for videogenerering og fremhæver tre primære forbedringer i forhold til tidligere udgivelser: markant forbedret fysisk nøjagtighed (objekter, der bærer realistisk vægt og momentum), stærkere hurtig vedhæftning (det, du beder om, er mere pålideligt, hvad du får) og højere visuel troskab på tværs af bevægelse og tid (detaljer som hår, stofvævning og overfladespejling forbliver sammenhængende på tværs af billeder). Gen-4.5 ligger i øjeblikket øverst på uafhængige, menneskebedømte ranglister, der bruges til tekst-til-video-benchmarking.

Hvor kom Runway Gen-4.5 fra, og hvorfor er det vigtigt?

Runways videomodeller har udviklet sig hurtigt fra Gen-1 via Gen-3/Alpha til Gen-4; Gen-4.5 præsenteres som en konsolidering og optimering af arkitektoniske opgraderinger, strategier for dataforberedelse og teknikker til eftertræning, der har til formål at maksimere dynamik, tidsmæssig konsistens og kontrollerbarhed. For skabere og produktionsteams sigter disse forbedringer mod at gøre AI-genererede klip funktionelt nyttige i prævisualisering, reklame-/marketingindhold og produktion af korte narrativer ved at reducere den "kladde"-følelse, som tidligere tekst-til-video-modeller ofte udviste.

4 hovedtræk ved Runway Gen-4.5

1) Forbedret fysisk realisme og bevægelsesdynamik

Runway Gen-4.5 lægger vægt på en mere jævn og fysisk plausibel bevægelse. Gen-4.5 fokuserer på realistisk objektbevægelse - vægt, inerti, væsker, stof og fysisk plausible kollisioner - hvilket producerer sekvenser, hvor interaktioner ser mindre "svævende" og mere jordnære ud. I demoer og min test demonstrerer modellen forbedrede objektbaner, realisme i kamerabevægelser og færre "svævende" artefakter, der plagede tidligere videomodeller. Dette er en af de vigtigste opgraderinger sammenlignet med Gen-4.

2) Visuel kvalitet og stilkontrol

Runway Gen-4.5 udvider Runways kontroltilstande (tekst-til-video, billede-til-video, video-til-video, keyframes) og forbedrer fotorealistisk gengivelse, stilisering og filmisk komposition. Runway hævder, at Gen-4.5 kan generere fotorealistiske klip, der er vanskelige at skelne fra rigtige optagelser i korte sekvenser, især når de kombineres med et godt referencebillede eller keyframes.

3) Bedre hurtig overholdelse og bevidsthed om sammensætningen.

Modellen viser forbedret nøjagtighed, når prompter inkluderer flere aktører, kameraretninger eller begrænsninger for kontinuitet på tværs af scener; den overholder instruktioner mere pålideligt sammenlignet med tidligere generationer og har højere nøjagtighed i at følge beskrivende prompter, hvilket fører til færre hallucinerede eller irrelevante elementer på tværs af et klip.

4) Højere visuel detaljegrad og tidsmæssig stabilitet.

Overfladetekstur, hår/filamentkontinuitet og ensartet belysning på tværs af billeder er mærkbart forbedret. Karakterer og objekter er mindre tilbøjelige til at ændre udseende midt i klip. Runway hævder, at disse forbedringer blev opnået, samtidig med at Gen-4's latensprofil blev bevaret. En af de mere produktionsorienterede fremskridt er modellens forbedrede håndtering af karakterernes ansigtsudtryk og implicitte følelser på tværs af optagelser. Selvom Runway Gen-4.5 ikke er en erstatning for trænede skuespillere, bevarer den bedre følelsesmæssig kontinuitet (en karakters udtryk fortsætter f.eks. gennem en kamerabevægelse) og kan generere plausible præstationssignaler fra kompakte direktiver som "ængsteligt smil, kigger væk, trækker vejret skarpt".

Hvordan klarer Runway Gen-4.5 sig i benchmarks og rigtige tests?

Runway rapporterer en Elo-score på 1,247 på Artificial Analysis tekst-til-video-ranglisten (fra annonceringen) — hvilket placerer Gen-4.5 øverst på den pågældende benchmark på rapporteringstidspunktet. Benchmarks som disse bruger parvise menneskelige eller automatiserede præferencevurderinger på tværs af mange modeloutput;

Praktisk ydeevne (hvad brugerne kan forvente)

- Kliplængder og opløsning: Gen-4.5 er i øjeblikket optimeret til korte filmklip (single-shot output typisk 4-20 sekunder ved HD/1080p). Runway lagde vægt på at levere højere kvalitet uden at øge latens sammenlignet med Gen-4.

- Renderingstider og omkostninger: Runways budskab er, at omkostninger/latenstider er sammenlignelige med Gen-4 på tværs af abonnementsniveauer; reelle tider vil variere med valgt opløsning, kvalitetsindstilling og købelastning.

Hvordan adskiller Runway Gen-4.5 sig fra Gen-4?

Gen-4 etablerede Runways produktionsintentioner: ensartede karakterer, kontroltilstande fra billede til video (billede→video, keyframing, video→video) og en vægtning af brugerarbejdsgange. Gen-4.5 bevarer dette fundament, men skubber verdensmodellering (fysik, bevægelse) og hurtig overholdelse yderligere uden at gå på kompromis med gennemløbshastigheden. I praksis kan Gen-4 stadig være fremragende til hurtige, stildrevne opgaver og lettere budgetter; Gen-4.5 er opgraderingsvejen, når du har brug for mere troværdig dynamik og finjusteret kontrol.

Hvad der ændrede sig teknisk (overordnet)

Runway Gen-4.5 fremstilles som en udvikling snarere end en komplet arkitektonisk omskrivning. Runways materialer viser, at modellen drager fordel af forbedret dataeffektivitet før træning og teknikker efter træning (f.eks. målrettet finjustering og tidsmæssig regularisering). I praksis betyder det bedre vægt-/bevægelsesmodellering, mere sammenhængende multielementscener og forbedret fastholdelse af højfrekvente detaljer (hår, stofvævning) på tværs af billeder.

Praktiske forskelle, som skabere vil bemærke

- Bedre fysisk adfærd: Objekter adlyder den opfattede masse, og væsker/fluider opfører sig mere plausibelt.

- Færre identitetsbrud: Det er mindre sandsynligt, at karakterer og objekter ændrer udseende midt i et klip.

- Samme hastighed, højere kvalitet: Runway angiver, at ydeevnen (latenstiden) er sammenlignelig med Gen-4, mens kvaliteten stiger. Det gør Gen 4.5 attraktiv for produktionsteams, der ikke kan acceptere store renderingsforsinkelser.

Hvornår skal man vælge Gen-4 vs. Gen 4.5

- Brug gen-4 når du har brug for et billigere og hurtigt proof-of-concept, eller når eksisterende rørledninger/kontroller allerede er indstillet til den pågældende motor.

- Brug gen-4.5 når du har brug for forbedret realisme, komplekse interaktioner med flere objekter eller output i produktionsklassen, hvor bevægelsesfysik og hurtig nøjagtighed er vigtige (f.eks. produktvisualiseringer, VFX-prævisualisering, karakterdrevne kortfilm).

Kompatibilitet med Gen-4-kontroller. Alle de redigeringstilstande, som Runway understøtter (billede→video, keyframes, video→video, skuespillerreferencer), bliver inkluderet i Gen-4.5, så skabere kan genbruge velkendte kontroller med bedre resultater.

Hvordan klarer Gen-4.5 sig i forhold til Veo 3.1 og Sora 2?

Hvordan er den sammenlignet med Googles Veo 3.1?

Veo 3.1 er Googles high-fidelity tekst-til-video-familie (Veo 3 → 3.1-opdateringer). Modellen roses for filmisk tekstur, stærk stilgengivelse og stram farve-/lyskontrol. Uafhængige sammenligninger indikerer, at Veo 3.1 udmærker sig ved stemnings- og stiliserede scener og er bredt tilgængelig via Googles API'er, men den kan have problemer med multi-objektfysik og langtrækkende tidsmæssig kohærens sammenlignet med de allerbedste specialiserede konkurrenter. Tidlige blindtests og brugeranmeldelser tyder på, at Runway Gen-4.5 trækker foran i bevægelsessandsynlighed og hurtig overholdelse af fysiktunge prompts, mens Veo ofte vinder på stiliserede, maleriske eller filmiske enkeltscenetests.

Hvor Veo har tendens til at føreLydkvalitet og strukturerede narrative funktioner (Flow/Veo Studio) og tæt integration i Googles økosystem (Gemini API/Vertex AI).

Hvor Gen-4.5 har tendens til at føre henBlinde menneskelige præferencetests for visuel realisme, hurtig overholdelse og kompleks bevægelsesadfærd (ifølge Video Arena-rangeringer citeret af Runway). I adskillige offentlige blinde sammenligninger har Gen-4.5 en smal føring i Elo-scoring over Veo-varianter, selvom marginen og betydningen varierer afhængigt af indholdstype.

Hvordan er det sammenlignet med OpenAIs Sora 2?

Sora 2 (OpenAI) lægger vægt på fysisk nøjagtighed, synkroniseret lyd (inklusive dialog og lydeffekter) og kontrollerbarhed. Sora 2 klarer sig ofte godt til at lave sammenhængende animerede scener med narrative signaler på højt niveau og i arbejdsgange, hvor lyd og dialog er vigtige dele af genereringsprocessen.

Hvor Sora 2 har tendens til at føre hen: integreret lydgenerering og multimodal synkronisering i visse omgivelser; har en tendens til at producere meget atmosfæriske, fortællende klip.

Hvor Gen-4.5 har tendens til at føre henIfølge de uafhængige blinde sammenligninger citeret af Runway, opfattet visuel realisme, hurtig gengivelse og bevægelseskonsistens. Igen afhænger det praktiske valg af dine værdier: Hvis generering af native lyde + integrerede værktøjer er afgørende, kan Sora 2 eller Veo være at foretrække; hvis ren visuel gengivelse til komplekse scener er prioriteten, er Gen-4.5's fordel i blindtesten betydelig.

Praktisk sammenligningstabel (resumé)

| Miljø | Landingsbane Gen-4.5 | Landingsbane Gen-4 (tidligere) | Google Veo 3.1 | OpenAI Sora 2 |

|---|---|---|---|---|

| Frigørelse / Positionering | Dec. 2025 — “Gen-4.5”: stigning i kvalitet og kvalitetskvalitet; top benchmark-score (1,247 Elo) | Tidligere Gen-4: stort skridt mod konsistens og kontrollerbarhed | Veo 3.1: Googles videogenerator; native lyd og hurtig/hurtig kvalitetsmuligheder | Sora 2: OpenAIs flagskibsmodel inden for video+lyd; lægger vægt på fysisk nøjagtighed og synkroniseret lyd |

| Kernestyrker | Bevægelseskvalitet, hurtig gengivelse, filmisk grafik, API-integration | Karakterkontinuitet, konsistens i flere skud, kontrollerbarhed | Hurtige 8s-udgange, native lyd-/dialoggenerering, optimeret til hastighed/UX | Fysik og realisme, synkroniseret lyd/dialog, kontrollerbarhed |

| Outputlængde / formater | Korte filmklip; understøtter billede→video, tekst→video, keyframes osv. | Korte klip; lignende kontroltilstande | 8 sekunders videoer i høj kvalitet, Veo 3.1 Fast-mulighed | 720p/1080p-udgange med lyd, med vægt på kvalitet |

| Indbygget lyd | Ikke den primære overskrift (fokus er visuel kvalitet), men Runway understøtter lydworkflows via værktøjer | Begrænset generering af native lyd | Generering af indbygget lyd (lydeffekter, dialog). Fokus på lydkvalitet. | Synkroniseret lyd og lydeffekter er eksplicitte funktioner. |

| Typiske begrænsninger | Små detaljerede artefakter (ansigter/folkemængder), lejlighedsvise årsags-/tidsfejl | Tidligere artefakter, mere inkonsistens end 4.5 i bevægelser | Kort varighed er en designmæssig afvejning; kvalitet vs. længde | Smalle fejltilstande på komplekse scener; stadig under udvikling |

- Visuel realisme og bevægelseGen-4.5 > Veo 3.1 ≈ Sora 2 (varierer afhængigt af scenen).

- Lyd og indbygget lydVeo 3.1 ≥ Sora 2 > Runway (Runway har workflow-lydværktøjer, men Veo & Sora inkorporerer dybere native lydgenerering i produktiviseringen).

- Kontrol og redigeringRunway (keyframes, billede→video, referencekontinuitet) og Veo (Flow Studio) tilbyder begge stærk kontrol; Sora fokuserer på synkroniserede multimodale kontroller.

- Kort sagt: Sora 2 er stærk på narrativ kontinuitet; Veo 3.1 er stærk på filmisk tekstur; Gen-4.5 er stærk på bevægelsesrealisme og kontrollerbarhed.

Hvilke konkrete begrænsninger og risici er der stadig med Gen-4.5?

Ingen model er perfekt, og Gen-4.5 har kendte begrænsninger og reelle risici, der skal overvejes før implementering.

Tekniske begrænsninger

- Kanttilfældefysik og årsagsfejl: Selvom modellen er blevet meget forbedret, producerer den stadig lejlighedsvise årsagsfejl (for eksempel en effekt, der går forud for dens årsag) og subtile fejl i objektpermanens, når scener bliver meget komplekse. Disse er mindre hyppige, men stadig til stede.

- Langformet kohærens: Ligesom de fleste nuværende tekst-til-video-modeller er Gen-4.5 optimeret til korte klip (sekunder lange). Generering af længere scener eller fulde sekvenser kræver stadig sammensætning, redaktionel indgriben eller hybride arbejdsgange.

- Identitet og konsistens i stor skala: At producere hundredvis af optagelser med præcis den samme karakterskuespil konsekvent er fortsat arbejdskrævende; Gen-4.5 hjælper, men overflødiggør ikke referencedesignsystemer eller centraliserede asset pipelines.

Sikkerhed, misbrug og etiske risici

- Risiko for deepfake / efterligning: Enhver videogenerator med højere kvalitet øger risikoen for realistiske, men vildledende medier. Organisationer bør implementere sikkerhedsforanstaltninger (vandmærkning, indholdspolitikker, identitetsbekræftelsesflow) og overvåge risikoen for misbrug.

- Ophavsret og datasætets oprindelse: Oprindelsen af træningsdata er fortsat et bredere problem i branchen. Skabere og rettighedshavere bør være opmærksomme på, at output kan afspejle lærte mønstre fra ophavsretligt beskyttet materiale, hvilket rejser juridiske og etiske spørgsmål om genbrug i kommercielle sammenhænge.

- Bias og repræsentationsskader: Generative modeller kan reproducere bias, der findes i træningsdata (f.eks. over-/underrepræsentation, stereotype fremstillinger). Grundig testning og strategier til afbødning i processen er stadig nødvendige.

Konklusion — Hvor Gen-4.5 passer ind i det udviklende AI-videolandskab

Runway Gen-4.5 repræsenterer et betydeligt skridt fremad inden for tekst-til-video-realisme og kontrollerbarhed. Det er i øjeblikket højt rangeret på uafhængige blinde præference-ranglister, og Runways produktbudskaber og tidlige rapportering positionerer det som en praktisk opgradering for skabere, der har brug for mere overbevisende bevægelse, bedre prompt-gengivelse og forbedret tidsmæssig sammenhæng uden at gå på kompromis med genereringshastigheden. Samtidig fortsætter konkurrerende systemer fra Google (Veo 3.1) og OpenAI (Sora 2) med at fremme komplementære styrker såsom integreret lyd, produktiserede historie-/fortællingsværktøjer og dybere økosystemintegrationer. Valg af den rigtige platform afhænger stadig af projektet: om du prioriterer visuel realisme, native lyd, platformintegration eller styringskontroller.

Gen-4.5 rulles ud på tværs af abonnementer med sammenlignelige priser som Gen-4.

Udviklere kan få adgang Veo 3.1 , Sora 2 og Landebane/gen4_aleph osv. via CometAPI, den nyeste modelversion opdateres altid med den officielle hjemmeside. For at begynde, udforsk modellens muligheder i Legeplads og konsulter API guide for detaljerede instruktioner. Før du får adgang, skal du sørge for at være logget ind på CometAPI og have fået API-nøglen. CometAPI tilbyde en pris, der er langt lavere end den officielle pris, for at hjælpe dig med at integrere.

Klar til at gå? → Gratis prøveversion af generation 4.5 !

Hvis du vil vide flere tips, guider og nyheder om AI, følg os på VK, X og Discord!