TL;DR: OpenClaws seneste udgivelse tilføjer førsteklasses, fremadkompatibel support til OpenAIs GPT-5.4 og introducerer en “hot-swappable” hukommelsesarkitektur, der lader OpenClaw-agenter skifte, hvilken model og hvilken hukommelsesbutik der er aktiv, under kørsel med minimal forstyrrelse. Det låser op for stor-kontekst-workflows (GPT-5.4’s udvidede kontekstvinduer), on-the-fly modelspecialisering samt omkostnings-/latensoptimeringer for produktionsagenter. Opgraderingen er tilgængelig i OpenClaws releases og ledsagende dokumenter; eksemplerne nedenfor viser praktisk konfiguration, kodeudsnit, benchmarkkontekst og anbefalede best practices.

Hvad OpenClaws opdatering faktisk leverede (kort resume)

Den 9. marts 2026 udgav det open source-agentframework OpenAI-tilknyttede projekt OpenClaw en større kerneudgivelse (2026.3.7), der tilføjer førsteklasses support til GPT-5.4 og en ny “memory hot-swappable”-mekanisme i dets kontekstmaskine. Denne udgivelse gør et bredt anvendt eksperimentelt agentframework til det, maintainerne beskriver som et “Agent Operating System” — med mål om at gøre produktionsklare agent-workflows og modelskift problemfrie for udviklere og teams.

3 praktiske punkter, der betyder noget for agentbyggere:

- Førsteklasses GPT-5.4-support — modelaliaser og leverandørtilknytninger, der lader agenter vælge GPT-5.4 som primær eksekveringsmodel (inklusive kanaloverstyringer og per-agent fastlåsning af model).

- Context Engine & distribueret kanalbinding — forbedringer i, hvordan OpenClaw samler lange kontekstvinduer fra hukommelse, værktøjsoutput og kanalhistorik, så højkapacitetsmodeller får velstrukturerede input.

- Memory hot-swappable-arkitektur — klarere hukommelsesplugin-flader og workflows, så du kan udskifte hukommelses-backends eller opgradere agenter uden at miste “identitet” eller korrumpere vedvarende tilstand (selve hukommelsen forbliver single source of truth). OpenClaws hukommelsesdesign (rene Markdown-filer, indekseret søgning, plugin-baseret hentning) er en del af det, der muliggør sikker hot-swapping.

GPT-5.4 — hvad GPT-5.4 er og benchmark-gennembrud

GPT-5.4 er den seneste OpenAI frontier-modeludgivelse med stærkt fokus på professionel produktivitet (regneark, dokument- og præsentationsredigering, flertrinsræsonnering og værktøjsstyring). Ifølge OpenAI og uafhængig pressedækning lægger udgivelsen vægt på:

- Udvidet kontekst: GPT-5.4 introducerer næste niveau af kontekstvinduer, med eksperimentelle 1M tokens og forbedret håndtering af lang kontekst via Codex/Codex-kompatible endpoints — konfigurationsparametre som model_context_window og model_auto_compact_token_limit eksponeres for udviklere. Det lader dig holde langt større samtalestatus, dokumenter og kodebaser i aktiv kontekst.

- Højere nøjagtighed i regneark og ræsonnering — OpenAI rapporterer en markant forbedring på regnearksmodellering (gennemsnitlige scorer ~87% mod ~68% for GPT-5.2 på deres bank-/analytiker-regnearksbenchmark).

- Forbedringer i nøjagtighed og faktualitet: Tidlige anmeldelser og QA viser ~33% reduktion i hallucinationer og lavere fejlbehæftede outputs relativt til GPT-5.2, med bemærkelsesværdige gevinster i dokumentudarbejdelse og regnearksarbejde. Anmeldere nævnte også en ~18% reduktion i fejlbehæftede svar på visse produktivitetsopgaver.

- Integreret computerbrug og forbedringer fra Codex-linjen — GPT-5.4 inkluderer kapabiliteter arvet fra Codex-linjen, der forbedrer kodegenerering, interaktiv debugging og operationel værktøjsstyring (mus/tastatur/screenshot-automation i nogle demonstrationer). Det gør den bedre til write-run-inspect-patch-cyklussen, der er typisk for agentloops.

Benchmarks og komparativ kontekst (hvad tallene betyder)

- Regnearksmodellering: OpenAIs interne regnearksbenchmark: ~87,3% gennemsnit for GPT-5.4 vs ~68,4% for GPT-5.2. Dette er overskriften, som leverandøren bruger til at vise opgavespecifikke gevinster.

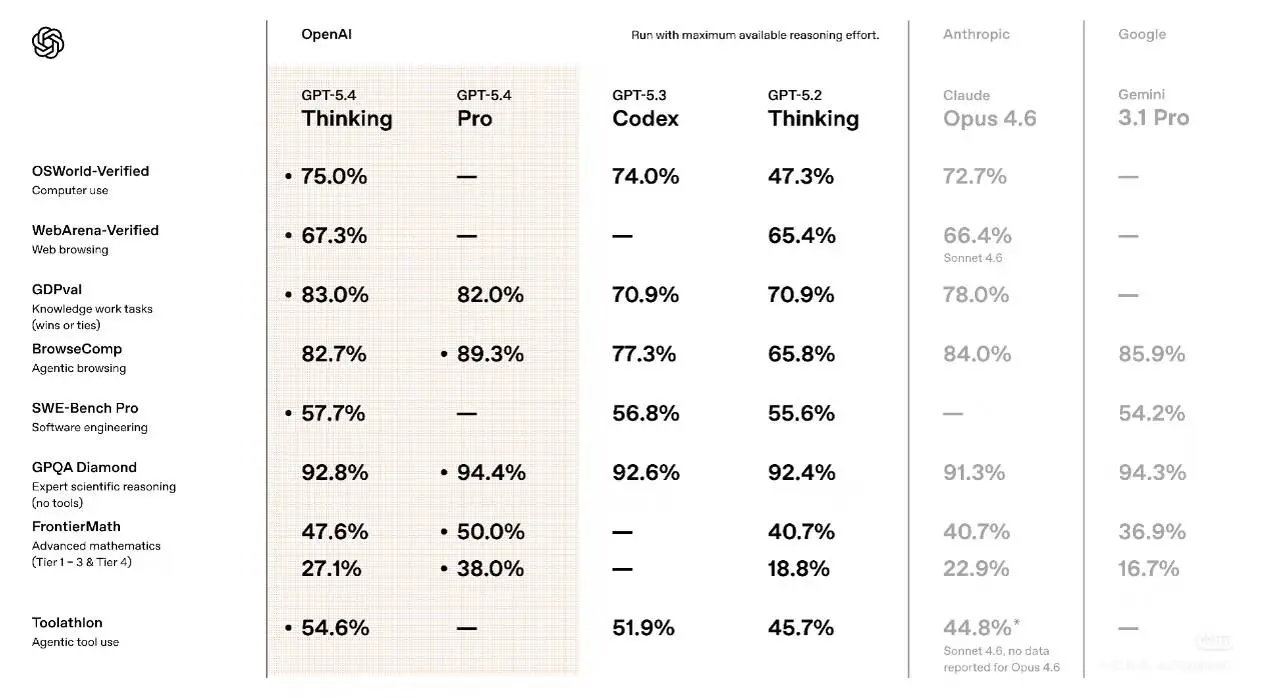

- Computerinteraktion (OSWorld-/agent-lignende tests): Uafhængige testere og community-kørsler viser, at GPT-5.4 forbedrer agentinteraktionsopgaver, der involverer desktop- eller simuleret UI-manipulation, og overgår nogle gange nyere Anthropic-modelvarianter med små marginaler på disse testsuiter (forskellene er meningsfulde for agenter, men ikke nødvendigvis afgørende i alle workloads).

Fortolkning: GPT-5.4 er ikke en “magisk kugle”, der vinder alt. Den har klare styrker i integreret værktøjsbrug, kodeeksekveringsmønstre og regnearksræsonnering — hvilket netop er de workloads, OpenClaw-agenter ofte kører. For agentbyggere er kombinationen af forbedret eksekveringspålidelighed (Codex-linje) + planlæggerkompetence + bedre håndtering af lang kontekst meget relevant.

OpenClaw understøtter GPT-5.4: hvad der ændrede sig, og hvorfor det betyder noget

OpenClaws udgivelse (se projektets releaseside) opdaterer modelresolvers og runtime til at være fremadkompatible med GPT-5.4’s udvidede kontekst og token-grænser og tilføjer “memory hot-swappable”-kapabilitet, så agenter kan skifte hukommelsesbackends eller modeller under kørsel. Det gøres på tre konkrete måder: 1) modelmetadata og resolver-opdateringer til at acceptere de større kontekst- og token-grænser; 2) ændringer i agent-runtime for at orkestrere yndefulde modelskift og cache-warm-up; 3) et hukommelses-API, der tillader flere hukommelseskanaler og hot-switch-triggere.

Version 2026.3.7’s support for GPT-5.4 plus et memory hot-swappable-design giver to praktiske, komplementære fordele:

- Enkel opgraderingssti for modellen. OpenClaw kan nu præsentere GPT-5.4 som et valgbart “runtime” for agenter, så du kan skifte fra ældre GPT-5.x-modeller eller alternative leverandører uden at omarbejde din agentlogik. OpenClaw-opdateringen erklærer eksplicit stabil GPT-5.4-integration i kernen.

- Memory Hot-Swapping. I stedet for at persistere et enkelt lineært hukommelsessnapshot tillader OpenClaws Context Engine, at hukommelsespartitioner frakobles, udskiftes eller migreres under kørsel — f.eks. indsæt et vektor-DB-shard med høj recall til debugging eller skift til en GDPR-sanitiseret hukommelsesvariant til eksterne audits — uden at stoppe agenten. Det sænker forstyrrelsesrisiko i produktion og muliggør use case-specifikke hukommelseskonfigurationer (debugging vs. privatliv vs. performance).

praktiske ydelsesgennembrud og fordele

OpenClaws integration fokuserer på tre praktiske områder, hvor GPT-5.4 excellerer:

- Værktøjsorkestreringsfidelitet. GPT-5.4’s forbedrede interne værktøjssøgning og ræsonnering reducerer værktøjskald-støj (færre redundante værktøjskald og færre retries). Det oversættes til færre API-kald og hurtigere afslutning for komplekse flows. Tidlige rapporter indikerer forbedringer i token- og værktøjskald-effektivitet sammenlignet med ældre GPT-5.x-modeller.

- Længere, rigere konteksthåndtering. OpenClaw-agenter kan nu holde meget større aktive kontekster (inklusive indsatte hukommelsesshards), hvilket gør dem i stand til at håndtere lange samtaler, multifil-projekter og iterativ debugging uden at miste tilstand.

- Mere deterministisk kodeoutput. For workflows, der autogenererer kode (CI-hooks, funktionsstubs, infrastruktur-skabeloner), har GPT-5.4 tendens til at producere mere konsistente og kørbare outputs, hvilket reducerer behovet for menneskelig gennemgang. Uafhængige tests viser bemærkelsesværdige forbedringer i kodekvalitetsmetrikker vs. tidligere GPT-5-modeller.

- Hukommelseskontinuitet — “memory hot-swappable” lader dig erstatte eller udvide hukommelseslagre (lokal cache, vektor-DB, LLM-hukommelse) uden at miste agenttilstand eller kontekst, hvilket muliggør A/B-tests, rullende opgraderinger og failover.

I OOLONG-benchmarktesten opnåede den nye version af OpenClaw, i kombination med lossless-claw-plugin’et, en høj score på 74,8 og efterlod Claude Code (70,3 point) langt bagefter. Især viste OpenClaw stabilitet og nøjagtighed i takt med, at kontekstlængden steg, hvilket fik ingeniørerne, der udførte on-site-testene, til at udbryde, at “det er for konservativt at sige, at det kører godt.”

Sådan konfigurerer og bruger du GPT-5.4 i OpenClaw (trin for trin)

En simpel OpenClaw-arbejdsgang med GPT 5.4:

- En typisk konfiguration er vist nedenfor:

- Brugere sender beskeder via platforme som Discord eller Telegram.

- OpenClaw modtager beskederne gennem sin gateway-server.

- Gatewayen videresender prompts til GPT 5.4 via AI API-udbyderen.

- GPT 5.4 genererer et svar eller udløser en værktøjsaktion.

- OpenClaw sender det endelige resultat tilbage til brugeren.

Nedenfor er pragmatiske, copy-paste-klar konfigurationseksempler og workflows til at køre GPT-5.4 i OpenClaw sikkert og reproducerbart. Disse er bevidst konservative: aktivér modellen først i en testagent og instrumentér alt for metrikker og fejl.

Forudsætninger

- OpenClaw opgraderet til udgivelsen, der inkluderer GPT-5.4-mappinger (release notes refereret ovenfor).

- Gyldig OpenAI API-nøgle med adgang til GPT-5.4 (jeg vælger CometAPI-endpoint med billigere pris).

1) Modelvalg og resolver-konfiguration (Json/ YAML / CLI)

Læg dette i ~/.openclaw/openclaw.json (eller flet ind i din eksisterende konfiguration). Justér leverandørnavn og tokenreference efter behov i dit miljø.

</>JSON

{

"agents": {

"defaults": {

"model": {

"primary": "openai/gpt-5.4",

"fallbacks": ["openai/gpt-5.3", "claude/opus-4.6"]

},

"workspace": "~/.openclaw/workspace"

}

},

"models": {

"providers": {

"openai": {

"api_key_env": "ComtAPI_API_KEY",

"base_url": "https://api.cometapi.com/v1"

}

}

},

"plugins": {

"slots": {

"memory": "memory-core"

}

},

"channels": {

"modelByChannel": {

"support-team": "gpt-5.4",

"low-cost-batch": "gpt-5.3"

}

}

}

OpenClaw bruger en modelresolver til at mappe logiske modelnavne (f.eks. openai/gpt-5.4) til endpoints og runtime-konfiguration. Tilføj eller opdatér din resolver-fil (eksempel models.yml):

</> YAML

# models.yml - OpenClaw model resolvers

models:

openai/gpt-5.4:

provider: openai

model_id: gpt-5.4

context_window: 1050000 # forward-compatible 1,050,000 tokens

max_output_tokens: 128000

api_base: "https://api.openai.com/v1"

timeout_seconds: 120

rate_limit_factor: 1.0

Eller sæt den ved kørsel via CLI:

</> Bash

# Switch OpenClaw to use GPT-5.4 for the current agent session

openclaw model set openai/gpt-5.4

Bemærk: The

context_windowandmax

Bemærkninger

- agents.defaults.model.primary vælger standardmodellen. Brug channels.modelByChannel til per-kanal-overstyringer, så du kan dirigere høj-impact-kanaler til GPT-5.4 og mindre krævende kanaler til billigere modeller. Se OpenClaw-dokumentationen om modelvalg for prioriteringssemantik.

- Se CometAPIs modelsiden for specifikke modelnavne. Hvis du ønsker at bruge OpenAI, så erstat URL og API-nøgle med OpenAIs.

- Nøglerne context_window og max_output_tokens afspejler de fremadkompatible ændringer i OpenClaws resolver, så agenten ikke forsøger at bruge forældede Codex-grænser.

2) Sådan aktiverer og tester du “memory hot-swapping”

OpenClaws hukommelsesundersystem er filbaseret (Markdown-filer) plus indekserings-/søgeplugins, så du sikkert kan udskifte backend-plugins (f.eks. SQLite vektor, Milvus eller eksterne hukommelsestjenester) uden at miste de rå hukommelsesfiler.

Et almindeligt mønster:

- Standardisér hukommelsesplacering: brug et git-understøttet workspace: ~/.openclaw/workspace/ hvor MEMORY.md og memory/YYYY-MM-DD.md er autoritative.

- Installér og konfigurer et hukommelsesplugin (eksempel: sqlite-vec), og peg plugins.slots.memory på det i konfigurationen.

- Test migration: tilføj et nyt plugin, kør en skyggeindekseringsjob, sammenlign hentningsresultater, og skift derefter aliaset plugins.slots.memory til det nye plugin, når du er tilfreds.

Eksempel på plugin-alias-skift (bash pseudo-kommandoer):

# install new plugin (example package)pip install openclaw-memory-sqlite-vec# update config safely (backup first)cp ~/.openclaw/openclaw.json ~/.openclaw/openclaw.json.bak# then edit JSON: plugins.slots.memory = "memory-sqlite-vec"# reload gateway (safe restart)systemctl restart openclaw || openclaw gateway restart# run a retrieval consistency check using the test harnessopenclaw test memory_consistency --samples 100

Hvorfor dette er “hot-swappable”: Hukommelsesfilerne forbliver kilden til sandhed. Plugins implementerer indekserings- og hentningslag; at udskifte dem genindekserer, men ændrer ikke de underliggende .md-filer. Det muliggør modelskift uden katastrofal identitetsdrift — agenten læser stadig de samme MEMORIES.

3) Eksempel: lås en individuel agent til GPT-5.4 (per-agent override)

Du kan overstyre modeller per agent; tilføj en agentpost som:

{

"agents": {

"my-analyst-agent": {

"model": {

"primary": "gpt-5.4"

},

"workspace": "~/.openclaw/workspace/analyst"

}

}

}

Hvis community-udgivelsen eller din specifikke OpenClaw-version kræver CLI, kan du også sætte en per-session-model ved kørsel:

# Start a session and switch model for the live session

openclaw session start my-analyst-agent

openclaw session command /model gpt-5.4

Driftstip: Fastlåsning sikrer deterministisk adfærd for den agent, mens du kører A/B-tests på andre.

Hvis du ønsker at bruge OpenAI, så erstat URL og API-nøgle med OpenAIs.

4) Brug af Codex 1M-kontekstindstillinger (API-knobs)

Hvis din OpenClaw-implementering tilgår OpenAI Codex-endpoints direkte, så videregiv kontekstindstillinger:

{ "model": "openai-codex/gpt-5.4", "input": "...", "model_context_window": 1050000, "model_auto_compact_token_limit": 200000}

Forespørgsler, der overskrider standardkontekstvinduer, kan tælle med forskellige forbrugsrater (OpenAI-dokumenter bemærker dobbeltregning for forespørgsler ud over standardvinduer i Codex-preview).

Best practices: maksimering af GPT-5.4’s styrker i OpenClaw

Omkostninger, latenstid og modelmix

- Hybrid modelstrategi: Brug en mindre, billigere model til korte forespørgsler og streambehandling; hot-swap til GPT-5.4 for tung analyse, opsummering og kodegenerering, der kræver lang kontekst. Det reducerer den samlede tokenomkostning samtidig med, at kvaliteten bevares. (Implementér via triggere i hukommelseskonfigurationen ovenfor.)

- Tokenkomprimering og retrieval-augmentation: Brug retrieval-forstærkede pipelines til at begrænse tokens sendt til modellen — gem lange dokumenter i en vektor-DB, hent relevante segmenter, og medtag kun de mest relevante bidder plus en kompakt plan. GPT-5.4’s værktøjssøgning hjælper her ved automatisk at finde nyttige værktøjer eller dokumenter.

- Warm-up og cold start: Efter et modelskift, varm modellen op med en kort kontekstpriming-kørsel for at undgå latenstids-spikes ved første forespørgsel. Forhåndskompilér eventuelle promptskabeloner og rehydrer kritiske hukommelseskanaler. OpenClaws rullende strategi (se konfiguration) understøtter pre-warming.

Pålidelighed og sikkerhed

- Yndefuld fallback: Implementér timeouts og fallback-planer (f.eks. nedgradering til et cachet svar fra en tidligere session) for at håndtere API-rate limits eller kvotefejl.

- Sikkerhedslag: Vedligehold politikfiltre og et verifikationstrin, når outputs påvirker beslutninger. GPT-5.4 reducerer hallucinationer statistisk, men verifikation er stadig vigtigt ved højrisikoopgaver.

Evaluering og overvågning

- Reproducer dine benchmarks: Kør head-to-head-tests for dine workloads (kodefuldførelse, multifil-refaktorering, regnearksanalyse) med en standardrubrik. Offentlige rapporter indikerer styrker i regneark- og produktivitetsopgaver — valider med dine data.

- Telemetri: Overvåg tokenforbrug, modellatenstid, hyppighed af hukommelsesskift og svarkvalitet (menneskelige vurderinger/automatiske tests). Brug telemetrien til at forfine swap-tærskler.

Eksempel : Code review-agent, der hot-swapper

Mål: Kør en rutinemæssig lint + unittests-opsummering ved push (billig model) og eskalér til GPT-5.4 for multifil-refaktoringsforslag, når tests fejler, eller diff overstiger 10 filer.

Flow (højt niveau):

- Pre-commit-trigger kører local/fast-small-coder for at generere lint-opsummering.

- Hvis test_failures > 0 eller diff_files > 10, udløs hot_swap til openai/gpt-5.4. Promovér longterm_vector, der indeholder repo-historik.

- Kør GPT-5.4-prompt med hele fejlslagne stack traces + relevante kildefiler hentet ind i konteksten. Generér refaktor-patch og ændringer til unittests.

- Menneskelig reviewer bedømmer output; feedback opdaterer hukommelsen.

Prompt-skelet (sendt til GPT-5.4 efter hentning og komprimering):

You are a senior reviewer. The repository has 12 changed files. Tests failed with stack traces below. Relevant files (retrieved): <file snippets>. Provide:1) concise summary of root cause (3 bullets),2) a minimal patch (diff) to fix,3) test changes needed,4) risk assessment and roll-back plan.

Denne use case illustrerer, hvorfor stor kontekst + memory hot-swap er værdifuldt: du kan bringe hele den fejlede trace og flere filer ind i modellen på én gang. Implementér swap-triggere konservativt for at styre omkostninger.

Til sidst: hvem bør adoptere GPT-5.4 i OpenClaw (og hvornår)

- Adopter nu hvis dine agenter udfører flertrins kode-/værktøjsopgaver, tung regnearksautomatisering eller kompleks dokumentredigering, hvor iterative write-run-inspect-cyklusser dominerer udviklertid. Produktivitets- og pålidelighedsgevinsterne er mest synlige her.

- Adopter med omtanke hvis du driver omkostningsfølsomme højvolumen-chatkanaler, hvor enklere ræsonnering er tilstrækkelig; brug routing for at bevare omkostningseffektivitet.

- Antag ikke ét models dominans: benchmark på dine data. GPT-5.4 er en stærk kandidat til agent-workloads, men modelvalg skal være evidensbaseret.

Udviklere kan få adgang til GPT-5.4 via CometAPI nu. For at komme i gang, udforsk modellens kapabiliteter i Playground og konsulter Openclaw integration guide for detaljerede instruktioner. Inden adgang skal du sikre, at du er logget ind på CometAPI og har fået API-nøglen. CometAPI tilbyder en pris, der er langt lavere end den officielle pris, for at hjælpe dig med at integrere.

Klar til at komme i gang?→ Tilmeld dig OpenClaw i dag!

Hvis du vil have flere tips, vejledninger og nyheder om AI, så følg os på VK, X og Discord!