Den 19.–20. november 2025 lancerede OpenAI to beslægtede, men forskellige opgraderinger: GPT-5.1-Codex-Max, en ny agentisk kodningsmodel til Codex, der lægger vægt på langtidskodning, tokeneffektivitet og “compaction” for at opretholde multi-vindue-sessioner; og GPT-5.1 Pro, en opdateret ChatGPT-model i Pro-laget, tunet til klarere og mere kapable svar i komplekst, professionelt arbejde.

What is GPT-5.1-Codex-Max and what problem is it trying to solve?

GPT-5.1-Codex-Max er en specialiseret Codex-model fra OpenAI, tunet til kode-workflows, der kræver vedvarende, langhorizon-ræsonnering og -eksekvering. Hvor almindelige modeller kan snuble over ekstremt lange kontekster — for eksempel refaktorering på tværs af flere filer, komplekse agentloops eller vedvarende CI/CD-opgaver — er Codex-Max designet til automatisk at komprimere og håndtere sessionsstate på tværs af flere kontekstvinduer, så den kan fortsætte med at arbejde sammenhængende, når et enkelt projekt spænder over mange tusinder (eller flere) tokens. OpenAI positionerer Codex-Max som det næste skridt i at gøre kodekapable agenter reelt nyttige til længerevarende ingeniørarbejde.

What is GPT-5.1-Codex-Max and what problem is it trying to solve?

GPT-5.1-Codex-Max er en specialiseret Codex-model fra OpenAI, tunet til kode-workflows, der kræver vedvarende, langhorizon-ræsonnering og -eksekvering. Hvor almindelige modeller kan snuble over ekstremt lange kontekster — for eksempel refaktorering på tværs af flere filer, komplekse agentloops eller vedvarende CI/CD-opgaver — er Codex-Max designet til at automatisk komprimere og håndtere sessionsstate på tværs af flere kontekstvinduer, så den kan fortsætte med at arbejde sammenhængende, når et enkelt projekt spænder over mange tusinder (eller flere) tokens.

Den beskrives af OpenAI som “hurtigere, mere intelligent og mere tokeneffektiv i hver fase af udviklingscyklussen,” og er udtrykkeligt tiltænkt at erstatte GPT-5.1-Codex som standardmodellen i Codex-overflader.

Feature snapshot

- Compaction for multi-window continuity: beskærer og bevarer kritisk kontekst for at arbejde sammenhængende over millioner af tokens og timer. 0

- Improved token efficiency compare to GPT-5.1-Codex: op til ~30% færre “thinking tokens” for samme ræsonneringsindsats på nogle kodebenchmarks.

- Long-horizon agentic durability: internt observeret at kunne opretholde multi-time/multi-day agentloops (OpenAI dokumenterede >24-timers interne forløb).

- Platform integrations: tilgængelig i dag i Codex CLI, IDE-udvidelser, cloud og kodereview-værktøjer; API-adgang følger.

- Windows environment support: OpenAI bemærker specifikt, at Windows for første gang understøttes i Codex-workflows, hvilket udvider rækkevidden blandt udviklere i den virkelige verden.

How does it compare to competing products (e.g., GitHub Copilot, other coding AIs)?

GPT-5.1-Codex-Max præsenteres som en mere autonom, langhorizon-samarbejdspartner sammenlignet med pr.-forespørgsel-kompletteringsværktøjer. Mens Copilot og lignende assistenter excellerer i nærtidskompletteringer i editoren, ligger Codex-Max’s styrker i at orkestrere flertrinsopgaver, opretholde sammenhængende tilstand på tværs af sessioner og håndtere workflows, der kræver planlægning, test og iteration. Når det er sagt, vil den bedste tilgang i de fleste teams være hybrid: brug Codex-Max til kompleks automatisering og vedvarende agentopgaver og lettere assistenter til linjeniveau-kompletteringer.

How does GPT-5.1-Codex-Max work?

What is “compaction” and how does it enable long-running work?

En central teknisk avance er compaction—en intern mekanisme, der beskærer sessionshistorik samtidig med at de væsentlige stykker kontekst bevares, så modellen kan fortsætte sammenhængende arbejde på tværs af flere kontekstvinduer. I praksis betyder det, at Codex-sessioner, der nærmer sig deres kontekstgrænse, vil blive kompakteret (ældre eller mindre værdifulde tokens sammenfattet/bevaret), så agenten får et friskt vindue og kan fortsætte med at iterere gentagne gange, indtil opgaven er færdig. OpenAI rapporterer interne forløb, hvor modellen arbejdede på opgaver kontinuerligt i mere end 24 timer.

Adaptive reasoning and token efficiency

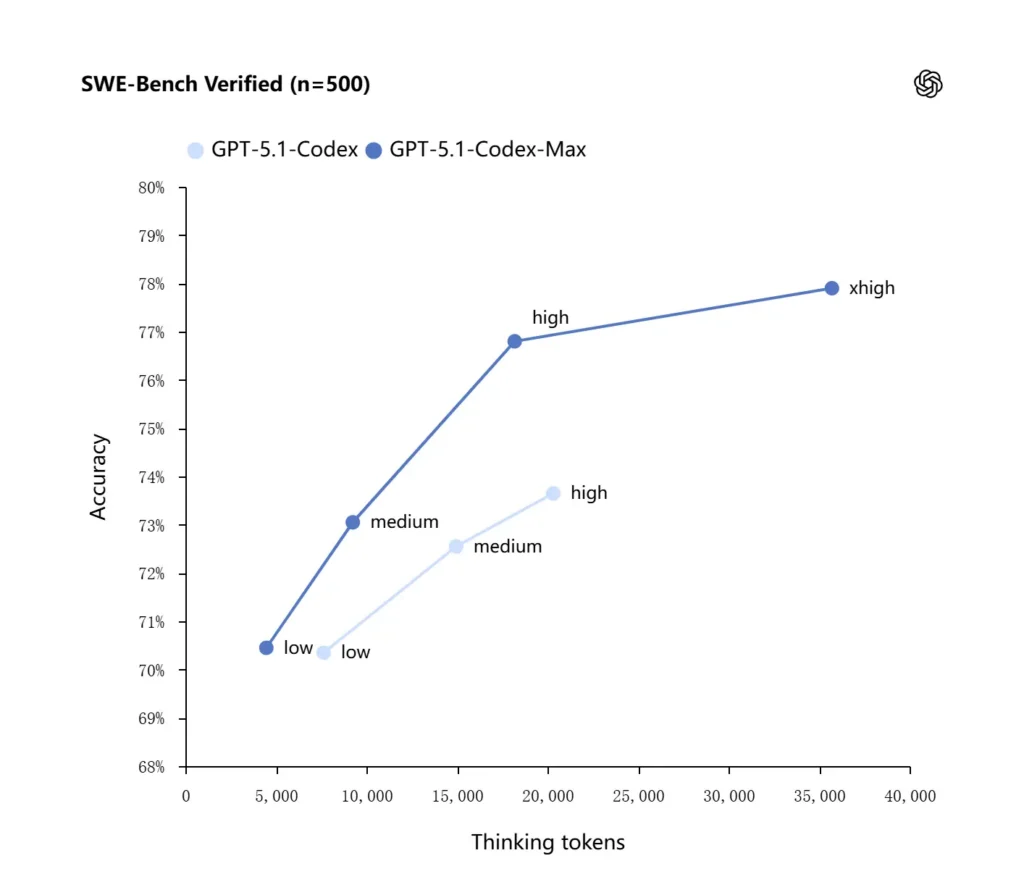

GPT-5.1-Codex-Max anvender forbedrede ræsonneringsstrategier, der gør den mere tokeneffektiv: i OpenAI’s rapporterede interne benchmarks opnår Max-modellen samme eller bedre performance end GPT-5.1-Codex, mens den bruger markant færre “thinking”-tokens—OpenAI angiver omtrent 30% færre thinking-tokens på SWE-bench Verified ved samme ræsonneringsindsats. Modellen introducerer også en “Extra High (xhigh)” ræsonneringsindsats-tilstand til ikke-latenssensitive opgaver, der lader den bruge mere intern ræsonnering for at levere outputs af højere kvalitet.

System integrations and agentic tooling

Codex-Max distribueres inden for Codex-workflows (CLI, IDE-udvidelser, cloud og kodereview-overflader), så den kan interagere med faktiske udviklerværktøjskæder. Tidlige integrationer omfatter Codex CLI og IDE-agenter (VS Code, JetBrains osv.), og API-adgang planlægges at følge. Designmålet er ikke kun smartere kodesyntese, men en AI der kan køre flertrins-workflows: åbne filer, køre tests, rette fejl, refaktorere og køre igen.

How does GPT-5.1-Codex-Max perform on benchmarks and real work?

Sustained reasoning and long-horizon tasks

Evalueringer peger på målbare forbedringer i vedvarende ræsonnering og langhorizon-opgaver:

- OpenAI internal evaluations: Codex-Max kan arbejde på opgaver i “mere end 24 timer” i interne eksperimenter, og at integration af Codex med udviklerværktøjer øgede interne ingeniør-produktivitetsmålinger (fx brug og throughput for pull requests). Dette er OpenAI’s interne påstande og indikerer opgaveniveau-forbedringer i produktiviteten i den virkelige verden.

- Independent evaluations (METR): METR’s uafhængige rapport målte den observerede 50% time horizon (en statistik, der repræsenterer den mediane tid, modellen kan opretholde en lang opgave sammenhængende) for GPT-5.1-Codex-Max til cirka 2 timer og 40 minutter (med et bredt konfidensinterval), op fra GPT-5’s 2 timer og 17 minutter i sammenlignelige målinger — en meningsfuld forbedring i vedvarende sammenhæng.

Code Benchmarks

OpenAI rapporterer forbedrede resultater på frontlinje-kodeevalueringer, især SWE-bench Verified, hvor GPT-5.1-Codex-Max overgår GPT-5.1-Codex med bedre tokeneffektivitet. Selskabet fremhæver, at for samme “medium” ræsonneringsindsats producerer Max-modellen bedre resultater, mens den bruger cirka 30% færre thinking-tokens; for brugere, der tillader længere intern ræsonnering, kan xhigh-tilstanden yderligere løfte svarene på bekostning af latens.

| GPT‑5.1-Codex (high) | GPT‑5.1-Codex-Max (xhigh) | |

| SWE-bench Verified (n=500) | 73.7% | 77.9% |

| SWE-Lancer IC SWE | 66.3% | 79.9% |

| Terminal-Bench 2.0 | 52.8% | 58.1% |

How does GPT-5.1-Codex-Max compare to GPT-5.1-Codex?

Performance and purpose differences

- Scope: GPT-5.1-Codex var en højtydende kodevariant af GPT-5.1-familien; Codex-Max er eksplicit en agentisk, langhorizon-efterfølger, tiltænkt som anbefalet standard i Codex- og Codex-lignende miljøer.

- Token efficiency: Codex-Max viser væsentlige gevinster i tokeneffektivitet (OpenAI’s ~30% færre thinking-tokens) på SWE-bench og i intern brug.

- Context management: Codex-Max introducerer compaction og indbygget multi-vindue-håndtering for at opretholde opgaver, der overstiger et enkelt kontekstvindue; Codex leverede ikke denne kapabilitet i samme skala.

- Tooling readiness: Codex-Max leveres som standard Codex-model på tværs af CLI, IDE og kodereview-overflader, hvilket signalerer en migrering for produktionsklare udvikler-workflows.

When to use which model?

- Use GPT-5.1-Codex til interaktiv kodeassistance, hurtige rettelser, små refaktoreringer og lav-latens brugsscenarier, hvor hele den relevante kontekst let passer i et enkelt vindue.

- Use GPT-5.1-Codex-Max til refaktorering på tværs af flere filer, automatiserede agentiske opgaver, der kræver mange iterationscyklusser, CI/CD-lignende workflows, eller når du har brug for, at modellen holder et projektperspektiv på tværs af mange interaktioner.

Practical prompt patterns, and examples for best results?

Prompting patterns that work well

- Be explicit about goals and constraints: “Refactor X, preserve public API, keep function names, and ensure tests A,B,C pass.”

- Provide minimal reproducible context: link til den fejlede test, inkluder stacktraces og relevante filuddrag frem for at dumpe hele repositories. Codex-Max vil kompaktere historik efter behov.

- Use stepwise instructions for complex tasks: opdel store opgaver i en sekvens af delopgaver, og lad Codex-Max iterere igennem dem (fx “1) run tests 2) fix top 3 failing tests 3) run linter 4) summarize changes”).

- Ask for explanations and diffs: bed om både patch og en kort begrundelse, så menneskelige reviewere hurtigt kan vurdere sikkerhed og intention.

Example prompt templates

Refactor task

“Refactor the

payment/module to extract payment processing intopayment/processor.py. Keep public function signatures stable for existing callers. Create unit tests forprocess_payment()that cover success, network failure, and invalid card. Run the test suite and return failing tests and a patch in unified diff format.”

Bugfix + test

“A test

tests/test_user_auth.py::test_token_refreshfails with traceback . Investigate root cause, propose a fix with minimal changes, and add a unit test to prevent regression. Apply patch and run tests.”

Iterative PR generation

“Implement feature X: add endpoint

POST /api/exportwhich streams export results and is authenticated. Create the endpoint, add docs, create tests, and open a PR with summary and checklist of manual items.”

For most of these, start with medium effort; switch to xhigh when you need the model to do deep reasoning across many files and multiple test iterations.

How do you access GPT-5.1-Codex-Max

Where it’s available today

OpenAI har integreret GPT-5.1-Codex-Max i Codex-værktøjer i dag: Codex CLI, IDE-udvidelser, cloud og kodereview-flows bruger Codex-Max som standard (du kan vælge Codex-Mini). API-tilgængelighed er ved at blive forberedt; GitHub Copilot har offentlige previews, der inkluderer GPT-5.1- og Codex-seriemodeller.

Udviklere kan få adgang til GPT-5.1-Codex-Max og GPT-5.1-Codex API via CometAPI. For at komme i gang, udforsk modelkapabiliteterne i CometAPI i Playground og konsulter API-guiden for detaljerede instruktioner. Før adgang skal du sikre, at du er logget ind på CometAPI og har fået en API-nøgle. CometAPI tilbyder en pris langt lavere end den officielle pris for at hjælpe dig med at integrere.

Klar til at gå i gang?→ Tilmeld dig CometAPI i dag !

Hvis du vil have flere tips, guider og nyheder om AI, så følg os på VK, X og Discord!

Quick start (practical step-by-step)

- Make sure you have access: bekræft, at din ChatGPT/Codex-produktplan (Plus, Pro, Business, Edu, Enterprise) eller din developer-API-plan understøtter GPT-5.1/Codex-familien.

- Install Codex CLI or IDE extension: hvis du vil køre kodeopgaver lokalt, skal du installere Codex CLI eller Codex IDE-udvidelsen til VS Code / JetBrains / Xcode efter behov. Værktøjerne vil som standard bruge GPT-5.1-Codex-Max i understøttede opsætninger.

- Choose reasoning effort: start med medium indsats til de fleste opgaver. Til dyb debugging, komplekse refaktoreringer, eller når du vil have modellen til at tænke mere, og du ikke bekymrer dig om svartid, skift til high eller xhigh. Til små hurtige rettelser er low passende.

- Provide repository context: giv modellen et klart udgangspunkt — en repo-URL eller et sæt filer og en kort instruktion (fx “refactor the payment module to use async I/O and add unit tests, keep function-level contracts”). Codex-Max vil kompaktere historik, når den nærmer sig kontekstgrænser, og fortsætte jobbet.

- Iterate with tests: efter at modellen producerer patches, skal du køre test-suiter og give fejl tilbage som en del af den løbende session. Kompaktion og multi-vindue-kontinuitet lader Codex-Max bevare vigtig kontekst om fejlede tests og iterere.

Conclusion:

GPT-5.1-Codex-Max repræsenterer et betydeligt skridt mod agentiske kodeassistenter, der kan opretholde komplekse, langvarige ingeniøropgaver med forbedret effektivitet og ræsonnering. De tekniske fremskridt (compaction, ræsonneringsindsats-tilstande, Windows-miljøtræning) gør den særdeles velegnet til moderne ingeniørorganisationer — forudsat at teams parrer modellen med konservative operationelle kontroller, tydelige human-in-the-loop-politikker og robust monitorering. For teams, der indfører den omhyggeligt, har Codex-Max potentialet til at ændre, hvordan software designes, testes og vedligeholdes — ved at omdanne repetitivt ingeniør-slid til et samarbejde med højere værdi mellem mennesker og modeller.