DeepSeek har lanceret DeepSeek V3.2 som efterfølger til sin V3.x-serie samt en tilhørende variant, DeepSeek-V3.2-Speciale, som virksomheden positionerer som en højtydende, reasoning-first udgave til brug med agenter/værktøjer. V3.2 bygger på eksperimentelt arbejde (V3.2-Exp) og introducerer højere ræsonneringskapacitet, en Speciale-udgave optimeret til “guld-niveau” i matematik/konkurrenceprogrammering og det, som DeepSeek beskriver som et dual-tilstandssystem af typen “thinking + tool” i sin første af slagsen, der tæt integrerer intern trinvis ræsonnering med eksterne værktøjskald og agent-workflows.

Hvad er DeepSeek V3.2 — og hvordan adskiller V3.2-Speciale sig?

DeepSeek-V3.2 er den officielle efterfølger til DeepSeeks eksperimentelle V3.2-Exp-gren. Den beskrives af DeepSeek som en “reasoning-first” modelfamilie bygget til agenter, dvs. modeller, der ikke kun er tunet til naturlig samtalekvalitet, men specifikt til flertrinsinferens, værktøjskald og pålidelig chain-of-thought-lignende ræsonnering, når de opererer i miljøer, der omfatter eksterne værktøjer (API'er, kodeeksekvering, datakonnektorer).

Hvad er DeepSeek-V3.2 (base)

- Positioneret som mainstream-produktions-efterfølgeren til den eksperimentelle V3.2-Exp-linje; tiltænkt bred tilgængelighed via DeepSeeks app/web/API.

- Bevarer en balance mellem beregningseffektivitet og robust ræsonnering til agentopgaver.

Hvad er DeepSeek-V3.2-Speciale

DeepSeek-V3.2-Speciale er en variant, som DeepSeek markedsfører som en mere kapabel “Special Edition” tunet til konkurrence-niveau ræsonnering, avanceret matematik og agentperformance. Markedsført som en højkapacitetsvariant, der “skubber til grænserne for ræsonneringsevner.” DeepSeek udstiller i øjeblikket Speciale som en API-only model med midlertidig adgangsrouting; tidlige benchmarks antyder, at den er positioneret til at konkurrere med high-end lukkede modeller i ræsonnerings- og kodebenchmarks.

Hvilken arv og hvilke ingeniørvalg førte til V3.2?

V3.2 arver en udviklingslinje af iterativt ingeniørarbejde, som DeepSeek offentliggjorde gennem 2025: V3 → V3.1 (Terminus) → V3.2-Exp (et eksperimentelt trin) → V3.2 → V3.2-Speciale. Den eksperimentelle V3.2-Exp introducerede DeepSeek Sparse Attention (DSA) — en finkornet sparse attention-mekanisme, der sigter mod at sænke hukommelses- og beregningsomkostninger for meget lange kontekster, samtidig med at outputkvaliteten bevares. Denne DSA-forskning og omkostningsreduktionen fungerede som et teknisk trin på vejen til den officielle V3.2-familie.

Hvad er nyt i den officielle DeepSeek 3.2?

1) Forbedret ræsonneringsevne — hvordan er ræsonneringen forbedret?

DeepSeek markedsfører V3.2 som “reasoning-first.” Det betyder, at arkitektur og finjustering fokuserer på pålideligt at udføre flertrinsinferens, opretholde interne tanke-kæder og understøtte den slags struktureret overvejelse, som agenter har brug for til at bruge eksterne værktøjer korrekt.

Konkret omfatter forbedringerne:

- Træning og RLHF (eller lignende alignment-procedurer) tunet til at fremme eksplicit trinvis problemløsning og stabile mellemtrin (nyttigt til matematisk ræsonnering, flertrins kodegenerering og logikopgaver).

- Arkitektur- og tabsfunktionsvalg, der bevarer længere kontekstvinduer og gør det muligt for modellen at referere til tidligere ræsonneringstrin med høj fidelitet.

- Praktiske tilstande (se “dual-mode” nedenfor), der lader den samme model operere enten i en hurtigere “chat”-tilstand eller i en deliberativ “thinking”-tilstand, hvor den bevidst arbejder gennem mellemtrin før handling.

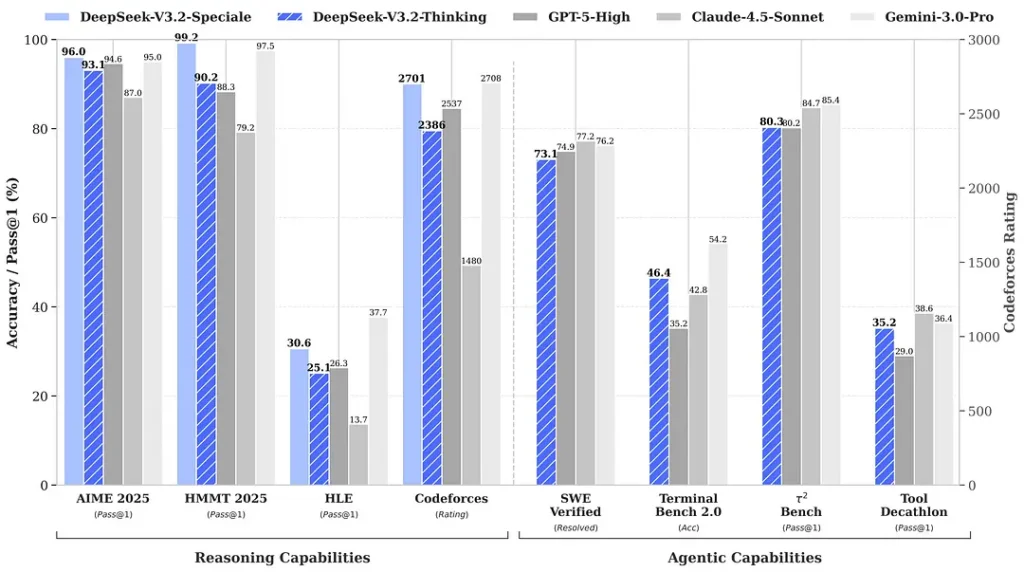

Benchmarks citeret omkring lanceringen hævder markante gevinster i matematik- og ræsonneringssuite; uafhængige tidlige community-benchmarks rapporterer også imponerende resultater på konkurrencemæssige evalueringssæt:

2) Gennembrudspræstation i Special Edition — hvor meget bedre?

DeepSeek-V3.2-Speciale hævdes at levere et løft i ræsonneringsnøjagtighed og agentorkestrering sammenlignet med standard V3.2. Udbyderen indrammer Speciale som et performance-niveau målrettet tunge ræsonneringsarbejdsbelastninger og udfordrende agentopgaver; den er i øjeblikket kun tilgængelig via API og tilbydes som et midlertidigt, mere kapabelt endepunkt (DeepSeek har angivet, at Speciale-tilgængeligheden i første omgang vil være begrænset). Speciale-versionen integrerer den tidligere matematiske model DeepSeek-Math-V2; den kan bevise matematiske teoremer og verificere logisk ræsonnering på egen hånd; den har opnået bemærkelsesværdige resultater i flere verdensklasse-konkurrencer:

- 🥇 IMO (International Mathematical Olympiad) Guldmedalje

- 🥇 CMO (Chinese Mathematical Olympiad) Guldmedalje

- 🥈 ICPC (International Computer Programming Contest) Andenplads (Human Contest)

- 🥉 IOI (International Olympiad in Informatics) Tiendeplads (Human Contest)

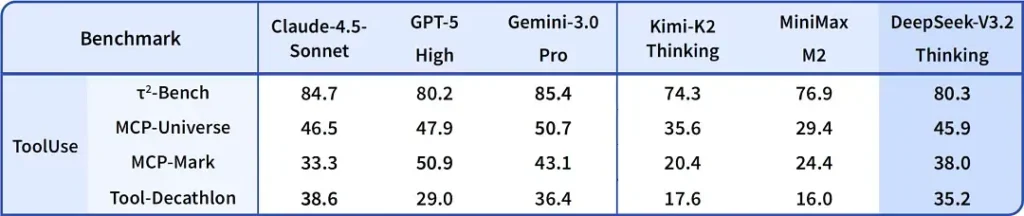

| Benchmark | GPT-5 High | Gemini-3.0 Pro | Kimi-K2 Thinking | DeepSeek-V3.2 Thinking | DeepSeek-V3.2 Speciale |

|---|---|---|---|---|---|

| AIME 2025 | 94.6 (13k) | 95.0 (15k) | 94.5 (24k) | 93.1 (16k) | 96.0 (23k) |

| HMMT Feb 2025 | 88.3 (16k) | 97.5 (16k) | 89.4 (31k) | 92.5 (19k) | 99.2 (27k) |

| HMMT Nov 2025 | 89.2 (20k) | 93.3 (15k) | 89.2 (29k) | 90.2 (18k) | 94.4 (25k) |

| IMOAnswerBench | 76.0 (31k) | 83.3 (18k) | 78.6 (37k) | 78.3 (27k) | 84.5 (45k) |

| LiveCodeBench | 84.5 (13k) | 90.7 (13k) | 82.6 (29k) | 83.3 (16k) | 88.7 (27k) |

| CodeForces | 2537 (29k) | 2708 (22k) | — | 2386 (42k) | 2701 (77k) |

| GPQA Diamond | 85.7 (8k) | 91.9 (8k) | 84.5 (12k) | 82.4 (7k) | 85.7 (16k) |

| HLE | 26.3 (15k) | 37.7 (15k) | 23.9 (24k) | 25.1 (21k) | 30.6 (35k) |

3) Første implementering nogensinde af et dual-tilstand “thinking + tool”-system

En af de mest praktisk interessante påstande i V3.2 er et dual-mode workflow, der adskiller (og lader dig vælge mellem) hurtig samtaledrift og en langsommere, deliberativ “thinking”-tilstand, der er tæt integreret med værktøjsbrug.

- “Chat / hurtig”-tilstand: Designet til lav latenstid, brugerrettet chat med korte svar og færre interne ræsonneringsspor — velegnet til uformel hjælp, korte spørgsmål/svar og hastighedsfølsomme applikationer.

- “Thinking / reasoner”-tilstand: Optimeret til grundig chain-of-thought, trinvis planlægning og orkestrering af eksterne værktøjer (API'er, databaseforespørgsler, kodeeksekvering). Når modellen kører i thinking-tilstand, producerer den mere eksplicitte mellemtrin, som kan inspiceres eller bruges til at drive sikre, korrekte værktøjskald i agentsystemer.

Dette mønster (et to-tilstandsdesign) var til stede i tidligere eksperimentelle grene, og DeepSeek har integreret det dybere i V3.2 og Speciale — Speciale understøtter i øjeblikket udelukkende thinking-tilstand (derfor API-gatingen). Muligheden for at skifte mellem hastighed og overvejelse er værdifuld for ingeniørarbejde, fordi den lader udviklere vælge den rigtige afvejning mellem latenstid og pålidelighed, når de bygger agenter, der skal interagere med virkelige systemer.

Hvorfor det er bemærkelsesværdigt: Mange moderne systemer tilbyder enten en stærk chain-of-thought-model (til at forklare ræsonnering) eller et separat lag til agent-/værktøjsorkestrering. DeepSeeks indramning antyder en tættere kobling — modellen kan “tænke” og derefter deterministisk kalde værktøjer, bruge værktøjsresponser til at informere efterfølgende tænkning — hvilket er mere sømløst for udviklere, der bygger autonome agenter.

Hvor får man DeepSeek v3.2

Kort svar — du kan få DeepSeek v3.2 på flere måder afhængigt af dine behov:

- Officiel web/app (brug online) — prøv DeepSeeks webgrænseflade eller mobilapp for at bruge V3.2 interaktivt.

- API-adgang — DeepSeek udstiller V3.2 via deres API (docs inkluderer modelnavne/base_url og priser). Tilmeld dig for en API-nøgle og kald v3.2-endpointet.

- Downloadbare/åbne weights (Hugging Face) — modellen (V3.2/V3.2-Exp varianter) er publiceret på Hugging Face og kan downloades (open-weight). Brug

huggingface-hubellertransformerstil at hente filerne. - CometAPI — En AI API-aggregationsplatform, der tilbyder hostede endpoints for V3.2-Exp. Prisen er lavere end den officielle pris.

Et par praktiske bemærkninger:

- Hvis du vil have weights til lokal kørsel, gå til modellens Hugging Face-side (accepter evt. licens/adgangsbetingelser dér) og brug

huggingface-cliellertransformerstil at downloade; GitHub-repoet viser typisk de præcise kommandoer. - Hvis du vil have produktionsbrug via API, så følg platforme som CometAPIs API-dokumentation for endpoint-navne og korrekt

base_urlfor V3.2-varianten.

DeepSeek-V3.2-Speciale:* Kun åben til forskningsbrug, understøtter “Thinking Mode”-dialog, men understøtter ikke værktøjskald.

- Maksimalt output kan nå 128K tokens (ultralang tænke-kæde).

- I øjeblikket gratis at teste indtil 15. december 2025.

Afsluttende tanker

DeepSeek-V3.2 repræsenterer et meningsfuldt skridt i modningen af ræsonneringscentrerede modeller. Kombinationen af forbedret flertrinsræsonnering, specialiserede højtydende udgaver (Speciale) og en produktionsklar integration af “thinking + tool” er bemærkelsesværdig for alle, der bygger avancerede agenter, kodeassistenter eller forskningsworkflows, som skal sammenflette overvejelse med eksterne handlinger.

Udviklere kan få adgang til DeepSeek V3.2 via CometAPI. For at begynde kan du udforske CometAPIs modelkapabiliteter i Playground og konsultere API-guiden for detaljerede instruktioner. Før adgang skal du sikre, at du er logget ind på CometAPI og har fået en API-nøgle. CometAPI tilbyder en pris, der er langt lavere end den officielle pris for at hjælpe dig med at integrere.

Klar til at gå i gang?→ Tilmeld dig CometAPI i dag!

Hvis du vil have flere tips, guides og nyheder om AI, så følg os på VK, X og Discord!