Den 28. juli 2025 lancerede den Beijing-baserede startup Zhipu AI officielt sin GLM‑4.5-serie af open source‑sprogmodeller i stor skala, hvilket markerer dens hidtil mest kraftfulde udgivelse og retter sig mod avancerede intelligente agent‑applikationer. Meddelelsen—fremsat via et live online‑arrangement i kølvandet på World Artificial Intelligence Conference (WAIC)—fremviste to varianter: den fuldskalerede GLM‑4.5 med i alt 355 milliarder parametre (32 milliarder aktive) og den mere kompakte GLM‑4.5‑Air med 106 milliarder samlede parametre (12 milliarder aktive). Begge modeller anvender en hybrid “tænkende” og “ikke‑tænkende” ræsonnementsarkitektur, der er designet til at balancere dyb inferens med hurtig respons, og tilbyder et kontekstvindue på 128,000 tokens til omfattende samtale- og opgaveorienterede anvendelser.

Lanceringen af GLM‑4.5 finder sted midt i et tiltagende hjemligt AI‑kapløb. Ifølge Kinas statslige Xinhua News Agency har kinesiske udviklere pr. juli 2025 frigivet 1.509 store sprogmodeller, hvilket leder det globale samletal på 3.755 modeller—et klart vidnesbyrd om omfanget og hastigheden af Kinas ekspanderende AI‑økosystem.

Open‑source‑licensering af GLM‑4.5

I et tydeligt brud med lukkede, proprietære paradigmer frigiver Z.ai GLM‑4.5 under en MIT‑lignende, fuldt reviderbar open source‑licens, som giver virksomheder fuld transparens i modelvægte og træningskode. Organisationer kan implementere GLM‑4.5 on‑premise, finjustere den på proprietære datasæt eller integrere den via selvhostede inferenstjenester og dermed undgå leverandørlåsning og uigennemsigtige API‑prismodeller.

Tilgængeligheden af både GLM‑4.5 til generelle agentiske opgaver og GLM‑4.5‑Air, en letvægtsvariant optimeret til miljøer med færre ressourcer, sikrer et bredt spektrum af anvendelser—fra storskala datacenter‑implementeringer til inferensscenarier på edge‑enheder.

Strategisk positionerer Zhipus open source‑tilgang virksomheden over for lukkede vestlige aktører som OpenAI. Ved at demokratisere adgangen til en GPT‑4‑sammenlignelig model under MIT‑licens sigter Zhipu mod at dyrke et robust community af downstream‑udviklere og sætte tekniske benchmarks for agentiske AI‑kapabiliteter. Brancheobservatører bemærker, at dette skridt følger en bredere tendens blandt Kinas “AI Tigers”, herunder Moonshot AI og Step AI, som også har open‑sourcet store modeller for at accelerere innovationscykler.

Ydelsesbenchmarks og sammenlignende analyse

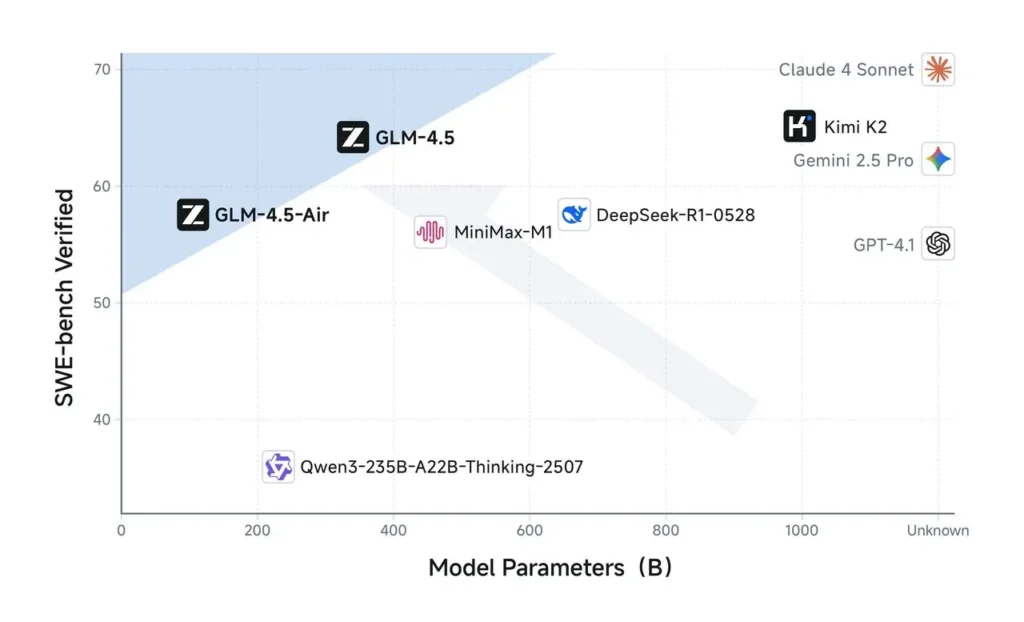

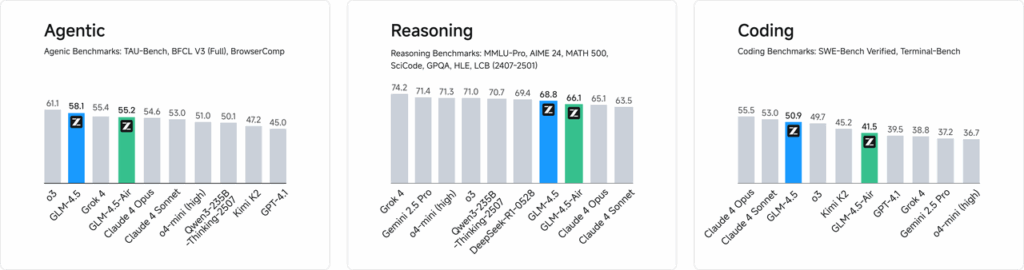

Foreløbige benchmarks fra Zhipu AI viser, at GLM‑4.5 opnår en samlet score på 63.2 på tværs af 12 industristandard‑evalueringssuiter—hvilket placerer den som nummer tre blandt både open source‑ og proprietære modeller—mens den strømlinede GLM‑4.5‑Air scorer 59.8 og balancerer effektivitet med høj nøjagtighed. Interne kodevurderinger viser desuden, at GLM‑4.5 overgår store rivaler med en sejrsrate på 53.9 procent mod Kimi K2 og en succesrate på 80.8 procent mod Qwen3‑Coder på tværs af 52 forskellige programmeringsopgaver.

Demonstrationer under live‑arrangementet understregede GLM‑4.5’s agentiske kapaciteter: Modellen udførte autonomt webresearch—indhentede og syntetiserede information fra flere kilder—og interagerede med simulerede sociale medier‑ og udviklingsmiljøer for at generere opslag, køre kodestumper og manipulere brugergrænsefladeelementer i realtid. Interesserede brugere kan straks afprøve den fuldskalerede model gratis via Zhipus Qingyan‑portal og CometAPI‑platformen, mens udviklere kan få adgang til API‑endpoints på CometAPIs BigModel‑tjeneste eller downloade de komplette modelvægte fra Hugging Face og ModelScope under en MIT‑licens.

Omkostningseffektivitet er en hjørnesten i Z.ai’s strategi. Trænet på et korpus på 15 billioner tokens udnytter GLM‑4.5 optimerede inferensstier til at levere et gennemløb på 100–200 tokens i sekundet—op til otte gange hurtigere end sammenlignelige indenlandske rivaler—til en annonceret pris på blot $0.11 pr. million tokens, hvilket underbyder modeller som DeepSeek‑R1 og Alibabas nyeste udgivelser. Under den permissive MIT‑licens er alle modelvægte, kode og dokumentation frit tilgængelige via Hugging Face med det formål at fremme et levende udvikler‑ og forskningscommunity på verdensplan.

“GLM‑4.5 indkapsler vores forpligtelse til at demokratisere adgangen til førsteklasses AI‑teknologi,” sagde Zhang Peng, CEO for Z.ai, i et interview med CNBC. “Ved at open source’e en model, der excellerer i ræsonnement, kodning og agentiske funktioner, sætter vi organisationer af enhver størrelse i stand til at innovere uden begrænsningerne ved proprietære API’er eller prohibitive omkostninger.”

Kom godt i gang

CometAPI er en samlet API‑platform, der samler over 500 AI‑modeller fra førende udbydere—såsom OpenAI’s GPT‑serie, Google’s Gemini, Anthropic’s Claude, Midjourney, Suno og flere—i et enkelt, udviklervenligt interface. Ved at tilbyde konsistent autentificering, anmodningsformattering og responshåndtering forenkler CometAPI dramatisk integrationen af AI‑kapabiliteter i dine applikationer. Uanset om du bygger chatbots, billedgeneratorer, musikgeneratorer eller datadrevne analysepipelines, lader CometAPI dig iterere hurtigere, kontrollere omkostninger og forblive leverandøruafhængig—samtidig med at du udnytter de seneste gennembrud på tværs af AI‑økosystemet.

Udviklere kan få adgang til GLM‑4.5‑API via CometAPI, de nyeste Claude‑modelversioner, der er opført, er pr. artikelens publiceringsdato. For at komme i gang kan du udforske modellens kapabiliteter i Playground og konsultere API‑guiden for detaljerede instruktioner. Inden adgang skal du sikre, at du er logget ind på CometAPI og har fået din API‑nøgle. CometAPI tilbyder en pris, der er langt lavere end den officielle pris, for at hjælpe dig med integrationen.