Die KI-Abteilung von Alibaba Cloud ist offiziell gestartet Qwen‑VLo, die neueste Version der multimodalen Qwen-Modellreihe, stellt einen bedeutenden Fortschritt bei den vereinheitlichten Bild- und Sprachfunktionen dar. Qwen-VLo wurde am 28. Juni 2025 angekündigt und bietet sowohl Verständnis- als auch Generierungsfunktionen und geht damit weit über seine Vorgänger hinaus. Es umfasst die Erstellung und Bearbeitung hochauflösender Bilder mithilfe natürlicher Sprachanweisungen und visueller Eingaben.

Aufbauend auf früheren Versionen wie Qwen-VL und Qwen2.5-VL stellt Qwen-VLo ein laut Alibaba „umfassendes Upgrade“ der multimodalen KI dar. Während sich Qwen-VL primär auf die Interpretation visueller Informationen konzentrierte und Qwen2.5-VL das Verständnis von Langzeitkontexten verbesserte, integriert Qwen-VLo diese Stärken in einem einzigen Framework, das bidirektionale Vision-Language-Aufgaben bewältigt. Es ermöglicht offene Anweisungen, unterstützt mehrere Sprachen – darunter Chinesisch und Englisch – und verfeinert seine Ergebnisse, um denen menschlicher Künstler ebenbürtig zu sein.

Hauptfunktionen

Progressive Bilderzeugung

Qwen-VLo erstellt Bilder schrittweise – von links nach rechts und von oben nach unten – und verfeinert den vorhergesagten Inhalt iterativ, um Konsistenz und visuelle Harmonie zu gewährleisten. Dieser Mechanismus verbessert sowohl die Effizienz der Generierung als auch die Benutzerkontrolle über den kreativen Prozess.

Unterstützung dynamischer Auflösung

Durch dynamisches Auflösungstraining kann das Modell beliebige Ein-/Ausgabeauflösungen und Seitenverhältnisse verarbeiten. Benutzer können Inhalte erstellen, die auf unterschiedliche Szenarien zugeschnitten sind – wie Webbanner, Social-Media-Cover oder hochauflösende Poster – ohne an feste Formate gebunden zu sein.

Offene Anweisungsbearbeitung

Mithilfe natürlicher Sprachbefehle kann Qwen VLo erweiterte Bearbeitungen wie Stilübertragungen („Van-Gogh-Stil anwenden“), zusammengesetzte Transformationen („Sonnenhimmel hinzufügen“) und vielfältige Modifikationen mit nur einer Anweisung durchführen. Es unterstützt außerdem das Extrahieren und Bearbeiten traditioneller visueller Signale wie Tiefenkarten, Segmentierungsmasken und Kantenumrisse.

Mehrsprachige Interaktion

Das Modell akzeptiert Befehle in mehreren Sprachen – derzeit werden Chinesisch und Englisch unterstützt – und bedient so eine globale Benutzerbasis und baut Sprachbarrieren in kreativen Arbeitsabläufen ab.

Verfügbarkeit und Zugriff

Qwen‑VLo ist derzeit verfügbar in Vorschau über die Qwen-Chat-Plattform unter chat.qwen.aiAlibaba Cloud weist darauf hin, dass es bei der Generierung in der Vorabversion gelegentlich zu Inkonsistenzen oder sachlichen Ungenauigkeiten kommen kann. Das Entwicklungsteam arbeitet aktiv daran, diese Einschränkungen vor einer breiteren Einführung zu beheben.

Im Hintergrund haben die KI-Ingenieure von Alibaba Qwen-VLo für den Einsatz in Cloud- und Edge-Umgebungen optimiert. Durch die Nutzung von Quantisierung mit gemischter Präzision und neuartigen, parametereffizienten Feinabstimmungstechniken gewährleistet das Modell eine hohe Leistung auf kompaktem Rechenraum. Alibaba hat außerdem adaptive Inferenz-Pipelines integriert, um Latenz und Qualität auszugleichen. So kann Qwen-VLo latenzempfindliche Anwendungen – wie interaktive Design-Tools – bedienen und gleichzeitig auf Enterprise-Workloads in der Alibaba Cloud skalieren.

Vergleichen mit Qwen-VL-Plus/Max

| Funktionsdimension | Qwen-VL-Plus/Max | Qwen VLo |

|---|---|---|

| Bildverständnis | Grundlegende Klassifizierung, Beschreibung | Multidimensionale Strukturerkennung, verbessertes Kontextverständnis |

| Bilderzeugung | Eingeschränkte Stilunterstützung | Hohe Präzision, progressive Generation, starke Stilkontrollfunktionen |

| Multitasking-Fähigkeit | Erfordert aufgabenspezifische Eingaben | Einheitliches Multitasking, unterstützt komplexe Sprachanweisungen |

| Mehrsprachige Interaktion | Begrenzte Unterstützung | Native Unterstützung für Chinesisch und Englisch, reibungslosere natürliche Sprachsteuerung |

| Fähigkeit zur Detailerhaltung | Möglicher Detailverlust bei der Generierung | Genaue Identifizierung und Rekonstruktion von Schlüsselstrukturen und Semantik |

Erste Schritte

CometAPI ist eine einheitliche API-Plattform, die über 500 KI-Modelle führender Anbieter – wie die GPT-Reihe von OpenAI, Gemini von Google, Claude von Anthropic, Midjourney, Suno und weitere – in einer einzigen, entwicklerfreundlichen Oberfläche vereint. Durch konsistente Authentifizierung, Anforderungsformatierung und Antwortverarbeitung vereinfacht CometAPI die Integration von KI-Funktionen in Ihre Anwendungen erheblich. Ob Sie Chatbots, Bildgeneratoren, Musikkomponisten oder datengesteuerte Analyse-Pipelines entwickeln – CometAPI ermöglicht Ihnen schnellere Iterationen, Kostenkontrolle und Herstellerunabhängigkeit – und gleichzeitig die neuesten Erkenntnisse des KI-Ökosystems zu nutzen.

Erkunden Sie zunächst die Fähigkeiten der Modelle in der Spielplatz und konsultieren Sie die API-Leitfaden Für detaillierte Anweisungen. Stellen Sie vor dem Zugriff sicher, dass Sie sich bei CometAPI angemeldet und den API-Schlüssel erhalten haben.

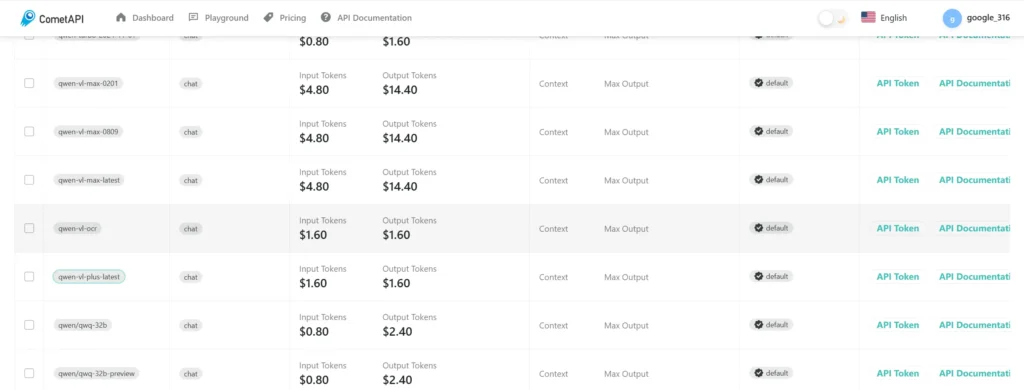

Die neueste Integration Qwen‑VLo API wird bald auf CometAPI erscheinen, also bleiben Sie dran! Während wir den Upload des Qwen‑VLo-Modells abschließen, erkunden Sie unsere anderen Modelle auf der Modelle-Seite oder probieren Sie sie im KI-Spielplatz. Qwens neuestes Modell in CometAPI ist Qwen 3 API(qwen3-235b-a22b;qwen3-30b-a3b;qwen3-8b) and qwen-vl-plus-latest.