Der Forschungszweig von ByteDance Samen ist gestartet Seed3D 1.0, ein hochpräzises 3D-Basismodell mit Einzelbild, das simulationsbereite Netze, PBR-Materialien und ausgerichtete Texturen erzeugt – Assets, die direkt in Physik-Engines und Robotersimulatoren integriert werden können. Die Version soll eine schmerzhafte Lücke schließen: skalierbare Inhaltserstellung (vielfältige visuelle Inhalte) versus die für verkörperte KI und Simulatortraining erforderliche physikalische Genauigkeit.

Was ist ByteDance Seed3D 1.0?

Seed3D 1.0 ist ein 3D-Basismodell, das entwickelt wurde, um ein einzelnes RGB-Bild eines Objekts oder einer Umgebung in eine simulationsbereit 3D-Asset-Bundle – typischerweise ein explizites, wasserdichtes Mesh, zugehörige UV-abgebildete Texture-Maps und Materialparameter für Physically Based Rendering (PBR). Das Modell ist nicht nur darauf ausgelegt, optisch originalgetreue Geometrie und Texturen zu erzeugen, sondern auch Assets zu generieren, die nur minimal nachbearbeitet werden müssen, bevor sie in Simulatoren wie Isaac Sim, Unity oder Unreal Engine für Robotik, Training oder die Generierung virtueller Welten verwendet werden können.

Wichtige Designziele auf hoher Ebene:

- Einzelbildeingabe: Keine Hardware zur Erfassung mehrerer Ansichten oder zum Scannen mehr erforderlich.

- Simulationsbereitschaft: Stellen Sie sicher, dass Topologie, Maßstab und PBR-Materialien für die physikalische Simulation geeignet sind.

- Skalierbarkeit der Szene: ermöglichen das automatische Zusammensetzen generierter Objekte zu zusammenhängenden Szenen.

- Integration: minimale Anpassung an gängige Physik-Engines und Laufzeit-Pipelines.

Welche Funktionen bietet Seed3D 1.0?

Hochpräzise Geometrie (wasserdichte Netze)

Seed3D produziert geschlossene, vielfältige Geometrie Entwickelt für präzises Kollisionsmanagement und zuverlässige Kontaktphysik. Die Geometriekomponente verwendet einen VAE- und Diffusionstransformator-Hybrid, um detailtreue Netze zu erzeugen, die feine Strukturdetails wie dünne Vorsprünge, Löcher und Text enthalten. Die Netzextraktionspipeline nutzt eine Strategie mit dualen Marching Cubes und hierarchischen Isoflächen, um hochwertige Oberflächen effizient zu extrahieren. ()

Fotorealistische Texturen und PBR-Materialien

Die Textur-Pipeline liefert konsistente Albedo-Karten mit mehreren Ansichten und vollständige PBR-Texturen (Albedo, Metall, Rauheit) und kann Texturausgaben mit einer Auflösung von bis zu 4K erzeugen. Diese Karten sind so konzipiert, dass sich die Beleuchtung in Rendering-Engines physikalisch plausibel verhält. Ein UV-Inpainting-Modul vervollständigt verdeckte Bereiche und gewährleistet räumliche Kohärenz im gesamten UV-Atlas.

Simulation und Pipeline-Bereitschaft

Die Ausgaben können in gängige Formate (OBJ/GLB) exportiert werden. Die generierten Assets werden absichtlich simulationsbereit: Sie lassen sich in Physiksimulatoren integrieren, in denen Kollisionsnetze und Reibungs-/Steifigkeitsparameter automatisch abgeleitet oder angepasst werden können, was eine sofortige Verwendung in der Robotik oder in Spiele-Engines ermöglicht. Seed3D demonstriert Workflows, die generierte Assets für Manipulationsexperimente in Isaac Sim platzieren.

Szenengenerierung und faktorisierte Montage

Über einzelne Objekte hinaus verwendet Seed3D einen faktorisierten Ansatz zur Szenengenerierung, bei dem Vision-Layout-Modelle Layoutkarten (Positionen, Maßstäbe, Ausrichtungen) ableiten und Seed3D Objekte entsprechend synthetisiert und platziert, wodurch eine kohärente Szenenkomposition für Innenräume und Stadtlayouts ermöglicht wird.

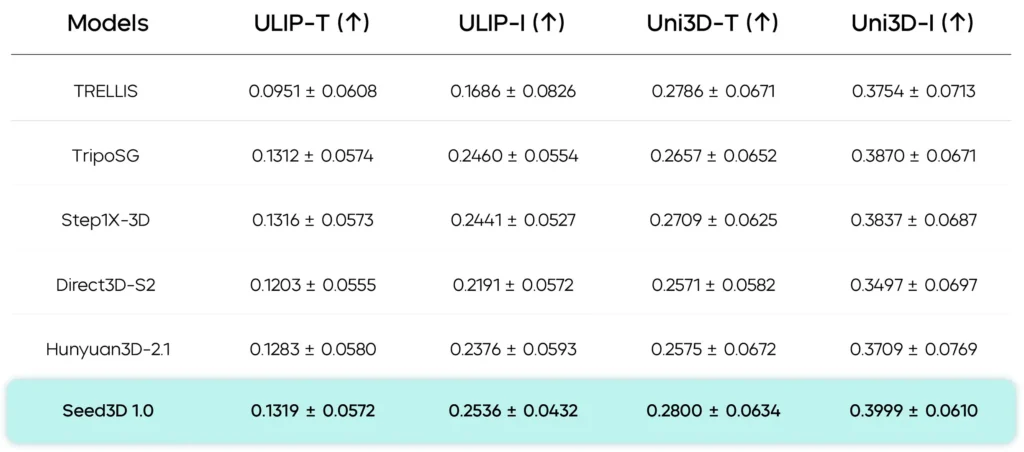

Ergebnis der Leistungsbewertung

Geometriegenerierung

Bei Geometrie-Benchmarks erreicht das 1.5 Milliarden Parameter umfassende Geometriemodell von Seed3D 1.0 (Seed3D-DiT + VAE) eine bessere Strukturgenauigkeit und feinere Details im Vergleich zu mehreren Basismodellen (TRELLIS, TripoSG, Step1X-3D, Direct3D-S2 und großen Modellen wie Hunyuan3D-2.1). Die Architektur von Seed3D – latente Raumdiffusion kombiniert mit sorgfältiger SDF-Dekodierung und hierarchischer Netzextraktion – liefert Netze mit weniger Artefakten und besserer Erhaltung hochfrequenter Geometrie (Text, kleine Vorsprünge).

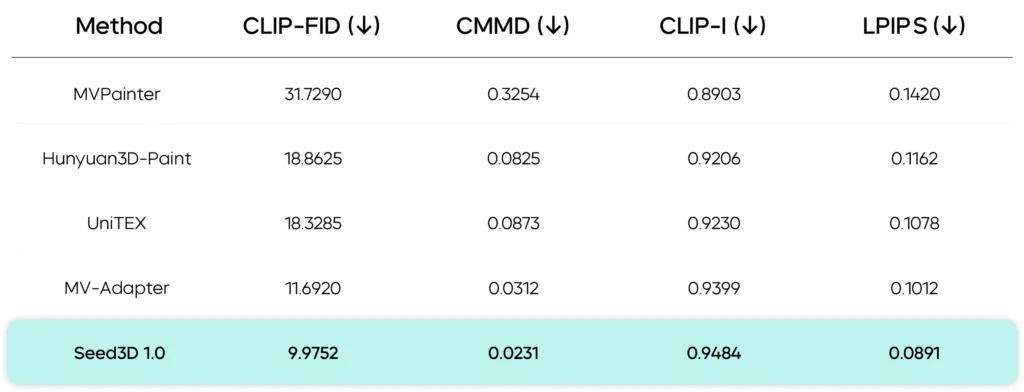

Texturgenerierung

Bei Textur- und Materialschätzungen meldet Seed3D erhebliche Verbesserungen bei der Ausrichtung auf Referenzbilder und beim Materialrealismus. Die Seed3D-PBR-Zerlegung und das Seed3D-UV-Inpainting erzeugen zusammen UV-Atlanten, die hochfrequente Texturdetails bewahren und kohärente PBR-Karten (Albedo, Metall, Rauheit) liefern, die für das physikalische Rendering geeignet sind.

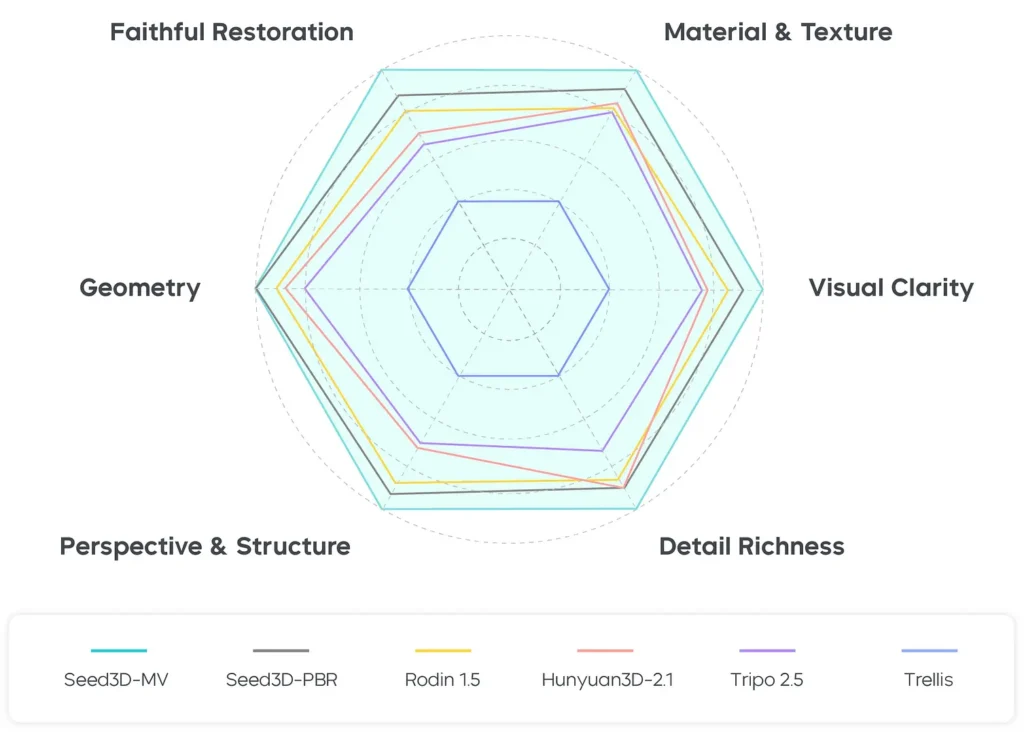

Menschliche Bewertung (Benutzerstudie)

Der Artikel berichtet über eine Nutzerstudie mit 14 menschlichen Bewertern anhand eines Testsets von 43 Bildern. Die Bewerter verglichen verschiedene Methoden in verschiedenen Kategorien wie visuelle Klarheit, originalgetreue Wiederherstellung, geometrische Genauigkeit, Perspektive und Struktur, Material- und Texturrealismus sowie Detailreichtum. Seed3D 1.0 erhielt in diesen Kategorien durchweg höhere subjektive Bewertungen, mit den deutlichsten Vorteilen bei Geometrie und Materialqualität. Die Studie bestätigt die quantitativen Benchmarks und zeigt, dass sich der wahrgenommene Realismus und die Simulationseignung im Vergleich zu den Basiswerten verbessert haben.

Wie funktioniert Seed3D 1.0 (Architektur und Pipeline)?

Seed3D 1.0 ist als Mehrkomponentensystem konzipiert, das erlernte latente Geometriedarstellungen, transformatorbasierte Rauschunterdrückung im latenten Raum sowie Multi-View- und Texturvervollständigungsmodule kombiniert. Das Design ist bewusst modular, sodass jede Komponente unabhängig optimiert und aktualisiert werden kann.

Hauptkomponenten

Seed3D-VAE (latenter Geometrie-Encoder/Decoder): Erlernt eine kompakte latente Darstellung für 3D-Geometrie (z. B. TSDF/Mesh Latent). Der VAE wird trainiert, hochauflösende, wasserdichte Geometrie aus komprimierten latenten Codes zu rekonstruieren. Dies stellt einen effizienten Engpass für die Generierungsphase dar.

Seed3D-DiT (Diffusionstransformator für Geometrie): Ein gleichgerichteter Fluss-/Rauschunterdrückungstransformator (DiT-ähnlich), der im latenten Raum der erlernten Geometrie arbeitet. Basierend auf einer Referenzbildeinbettung entrauscht er latente Token iterativ in eine latente Geometrie, die der VAE in ein explizites Netz dekodiert.

Seed3D-MV (Multi-View-Synthese) und Seed3D-UV (Texturvervollständigung): Nachdem die anfängliche Geometrie erstellt wurde, synthetisiert das System mehrere Ansichten, um die Mehrdeutigkeit der Okklusion zu reduzieren, und vervollständigt dann UV-Karten über ein Inpainting-/UV-Verbesserungsmodul, um vollständige, kohärente Texturen zu erzeugen.

Seed3D-PBR (Materialzerlegung): Zerlegt generierte Texturen in PBR-Maps (Metallizität, Rauheit, Normal Maps usw.), sodass physikalisch plausible Schattierungen und Kontaktreaktionen in der Simulation erhalten bleiben.

Vision-Language-Modell zur Szenenfaktorisierung: Zur Szenengenerierung nutzt die Pipeline VLMs, um Objekte zu erkennen, räumliche Beziehungen vorherzusagen und Layoutkarten (Position, Maßstab, Orientierung) zu erstellen. Einzelne Objekte werden generiert und anschließend entsprechend der Layoutkarte zu einer Szene zusammengesetzt. ()

Inferenzfluss auf hoher Ebene

- Eingabe: einzelnes RGB-Bild → Bildcodierer extrahiert visuelle Einbettung.

- Geometriegenerierung: Seed3D-DiT, abhängig von der Einbettung, entrauscht latente Geometrie → Seed3D-VAE dekodiert das Netz (wasserdicht).

- Multi-View-Synthese: Generieren Sie synthetische Ansichten aus dem Mesh + Render-Pipeline zur Texturvervollständigung.

- UV und Textur: Seed3D-UV übermalt Okklusionen und erstellt vollständige UV-Karten → Seed3D-PBR zerlegt Texturen in Materialkarten.

- Export: Erstellen Sie .obj/.gltf mit Texturen und Materialkarten, bereit für Physik-Engines (Kollisionsnetze, Maßstabsschätzung durch VLM).

Szenengenerierung

Seed3D generiert nicht nur einzelne Objekte, sondern generiert automatisch komplette Szenen.

Generierungsprozess:

- Eingabe: Ein Bild, das mehrere Objekte enthält;

- Das VLM-Modell identifiziert die Objekte und räumlichen Beziehungen im Bild.

- Seed3D generiert die Geometrie und Textur für jedes Objekt;

- Abschließend wird die räumliche Anordnung zu einer vollständigen 3D-Szene zusammengefügt.

Was sind die Einschränkungen und offenen Herausforderungen?

Seed3D 1.0 ist ein wichtiger Schritt, es bleiben jedoch mehrere Einschränkungen bestehen – sowohl inhärent bei der Einzelbildgenerierung als auch spezifisch für Simulationskontexte:

- Mehrdeutigkeit einer einzelnen Ansicht: Aus einer einzigen Ansicht auf die verdeckte Geometrie und die exakte Topologie zu schließen, ist grundsätzlich falsch; Vorhersagen und erlernte Statistiken helfen, aber bei stark verdeckten Bereichen bleiben Fehler bestehen.

- Physikalische Korrektheit im Maßstab: Während Anlagen nach vielen praktischen Maßstäben „simulationsbereit“ sind, erfordern die detaillierte Schätzung von Masse/Trägheit und die Gelenkdynamik für komplexe Gelenksysteme noch immer eine domänenspezifische Abstimmung.

- Seltene Materialien und Mikrostruktur: Stark spiegelnde, durchscheinende oder anisotrope Materialien (z. B. gebürstete Metalle, Stoffe mit Untergrundstreuung) lassen sich aus einem einzelnen Bild schwieriger genau reproduzieren.

- Datenverzerrungen: Trainingsdatenquellen beeinflussen, was das Modell gut erfasst – ungewöhnliche Objekte oder kulturspezifische Artefakte werden möglicherweise schlecht reproduziert.

- Geistiges Eigentum und Ethik: Wie bei allen generativen Systemen müssen Urheber und Organisationen bei der Konvertierung urheberrechtlich geschützter Bilder in 3D-Assets geistiges Eigentum und Herkunft berücksichtigen.

Anwendungsszenario

Seed3D ist explizit positioniert für verkörperte KI und Simulation Anwendungsfälle, aber die Auswirkungen erstrecken sich über mehrere Branchen:

- Robotik- und RL-Training: Schnelle Inhaltsgenerierung für Manipulationsbenchmarks, Schulungslehrpläne und domänenrandomisierte Datensätze für die Übertragung von der Simulation in die reale Welt. Die physikalische Vorbereitung der Assets reduziert die Reibungsverluste bei der Vorverarbeitung.

- Spieleentwicklung und XR: beschleunigte Asset-Erstellung für Prototypen, Hintergrundrequisiten oder ganze Szenen; die PBR-Workflows und 4K-Texturen sind besonders nützlich für High-Fidelity-Erlebnisse.

- Virtuelle Produktion und Visualisierung: Schnelle Erstellung von Requisiten und Umgebungselementen für die Konzeption oder Vorvisualisierung.

- Pipelines zur Inhaltserstellung: Designer können viel schneller von 2D-Referenzen (Fotos, Kunst) zu 3D-Prototypen iterieren, was hybride Mensch-KI-Workflows ermöglicht, bei denen Künstler die Ergebnisse verfeinern. ()

- Forschung: Groß angelegte Generierung diverser 3D-Trainingsdaten für Vision-Language-Action-Modelle und andere multimodale Forschung. Das Papier stellt Seed3D ausdrücklich als Werkzeug zur Weiterentwicklung der Forschung im Bereich Weltsimulatoren und verkörperter Intelligenz dar.

Seed3D kann ein einzelnes Foto in ein detailliertes 3D-Objekt umwandeln, das für die Simulation und interaktive Nutzung geeignet ist, was den Zugang zur Erstellung hochwertiger 3D-Inhalte erweitert.

Fazit

Seed3D 1.0 von ByteDance stellt einen bedeutenden Schritt in Richtung skalierbare, simulationsfähige 3D-Generierung aus einfachen 2D-Eingaben. Durch die Kombination einer fokussierten Geometrie-Pipeline (VAE + DiT), robuster Textur-/PBR-Schätzung und UV-Vervollständigung erzeugt das System Assets, die sowohl fotorealistisch als auch sofort in Physiksimulatoren einsetzbar sind – eine Kombination, die einen anhaltenden Engpass in der Forschung zu verkörperter KI und vielen angewandten Pipelines behebt. Die berichtete SOTA-Leistung des Modells (Geometrie & Textur) und die positiven Ergebnisse der menschlichen Bewertung machen es zu einem starken Neuzugang in der sich schnell entwickelnden 3D-generativen Landschaft.

Erste Schritte

CometAPI ist eine einheitliche API-Plattform, die über 500 KI-Modelle führender Anbieter – wie die GPT-Reihe von OpenAI, Gemini von Google, Claude von Anthropic, Midjourney, Suno und weitere – in einer einzigen, entwicklerfreundlichen Oberfläche vereint. Durch konsistente Authentifizierung, Anforderungsformatierung und Antwortverarbeitung vereinfacht CometAPI die Integration von KI-Funktionen in Ihre Anwendungen erheblich. Ob Sie Chatbots, Bildgeneratoren, Musikkomponisten oder datengesteuerte Analyse-Pipelines entwickeln – CometAPI ermöglicht Ihnen schnellere Iterationen, Kostenkontrolle und Herstellerunabhängigkeit – und gleichzeitig die neuesten Erkenntnisse des KI-Ökosystems zu nutzen.

Entwickler können auf 3D-Modelle und andere Modelle von ByteDance zugreifen, wie z. B. Seedream 4.0 API über CometAPI, die neuste Modellversion wird immer mit der offiziellen Website aktualisiert. Erkunden Sie zunächst die Fähigkeiten des Modells in der Spielplatz und konsultieren Sie die API-Leitfaden Für detaillierte Anweisungen. Stellen Sie vor dem Zugriff sicher, dass Sie sich bei CometAPI angemeldet und den API-Schlüssel erhalten haben. CometAPI bieten einen Preis weit unter dem offiziellen Preis an, um Ihnen bei der Integration zu helfen.

Bereit loszulegen? → Melden Sie sich noch heute für CometAPI an !

Wenn Sie weitere Tipps, Anleitungen und Neuigkeiten zu KI erfahren möchten, folgen Sie uns auf VK, X kombiniert mit einem nachhaltigen Materialprofil. Discord!