DeepSeek hat V4 offiziell als Open-Source-Modellfamilie in der Vorschau vorgestellt – und die Schlagzeile lautet nicht einfach „noch ein weiteres Modell-Update“. Das Unternehmen positioniert V4 als langkontextfähiges, agentenfreundliches System für reale Workloads: dokumentenlastige Analysen, Coding-Assistenten, Such-Agenten und mehrstufige Automatisierung. Der Release ist auf Web, App und API live, und die V4-Reihe führt ein kosteneffizientes Kontextfenster mit 1 Mio. Token in allen offiziellen Diensten ein.

Besonders bemerkenswert ist die Kombination aus Skalierung und Effizienz. DeepSeek gibt an, dass V4-Pro 1,6T Gesamtparameter mit 49B aktiven hat, während V4-Flash 284B Gesamtparameter mit 13B aktiven besitzt. Im technischen Bericht heißt es zudem, dass die V4-Architektur hybride Attention, MoE-Routing und Post-Training nutzt, um agentisches Verhalten zu verbessern, während die Rechenlast bei ultralangen Kontexten reduziert wird.

Was ist DeepSeek V4?

DeepSeek-V4 ist die neueste Vorschau-Flaggschifffamilie des Unternehmens, und der Release umfasst zwei öffentliche Varianten: V4-Pro und V4-Flash. DeepSeek beschreibt V4-Pro als das stärkere Modell für Weltwissen, Mathematik, MINT, Coding und agentisches Codieren, während V4-Flash die reaktionsschnellere, kosteneffiziente Option ist, die dennoch einen Großteil der Reasoning-Qualität und Langkontext-Fähigkeit bewahrt. V4-Pro führt aktuelle Open-Modelle beim agentischen Codieren und Weltwissen an, während V4-Flash auf Geschwindigkeit und wirtschaftliche Bereitstellung ausgelegt ist.

V4 verwendet eine hybride Attention-Architektur, die Compressed Sparse Attention (CSA) und Heavily Compressed Attention (HCA) kombiniert, plus Manifold-Constrained Hyper-Connections und den Muon-Optimizer. Das Unternehmen sagt außerdem, die Modelle seien auf mehr als 32T Tokens vortrainiert worden und dass V4-Pro bei 1M Kontext nur 27% der Single-Token-Inferenz-FLOPs und 10% des KV-Cache im Vergleich zu DeepSeek-V3.2 benötigt. Diese Effizienz ist die eigentliche Schlagzeile hinter dem Release.

DeepSeek-V4-Pro vs DeepSeek-V4-Flash

DeepSeek-V4-Pro

V4-Pro ist das Flaggschiffmodell für Nutzer, denen Qualität am wichtigsten ist. DeepSeek-V4-Pro liefert stärkere agentische Coding-Leistung, reichhaltigeres Weltwissen und erstklassiges Reasoning und führt aktuelle Open-Modelle an, während es laut Launch-Seite beim Weltwissen nur hinter Gemini-3.1-Pro zurückliegt. Im technischen Bericht ist V4-Pro das größere Modell der Familie, und DeepSeek-V4-Pro ist über dieselben OpenAI-kompatiblen und Anthropic-kompatiblen Schnittstellen verfügbar wie V4-Flash.

DeepSeek-V4-Flash

V4-Flash ist das Modell mit Fokus auf Effizienz; seine Reasoning-Fähigkeiten kommen V4-Pro nahe, und es performt bei einfachen Agentenaufgaben auf Augenhöhe mit V4-Pro, nutzt dabei jedoch weniger Parameter und bietet schnellere Antwortzeiten. Es unterstützt sowohl Denk- als auch Nicht-Denk-Modi, mit derselben 1M-Kontextlänge und denselben Kernfunktionen wie Pro – jedoch zu deutlich geringeren Kosten.

Welches sollten Sie wählen?

Verwenden Sie V4-Pro, wenn die Aufgabe risikobehaftet, wissensintensiv oder schwer zu verifizieren ist: Enterprise Research, komplexes Coding, mehrstufige Entscheidungsunterstützung oder Aufgaben, bei denen Sie die bestmögliche Antwort wünschen. Verwenden Sie V4-Flash, wenn Durchsatz, Latenz oder Token-Kosten wichtiger sind als die letzten Punkte an Benchmark-Performance. Diese Wahl entspricht der offiziellen Positionierung und den berichteten Benchmark-Abständen zwischen den beiden Modellen.

| Item | DeepSeek-V4-Flash | DeepSeek-V4-Pro |

|---|---|---|

| Total parameters | 284B | 1.6T |

| Active parameters | 13B | 49B |

| Context length | 1M | 1M |

| Reasoning modes | Nicht-Denk + Denk | Nicht-Denk + Denk |

| Best fit | Schnelle Inferenz, Hochdurchsatz-Apps, kostensensitive Agenten | Höchstleistungsfähiges Reasoning, schwierigere Coding- und Wissensaufgaben |

| Official API pricing | Cache-Hit $0.028 / Cache-Miss $0.14 / Ausgabe $0.28 pro 1M Token | Cache-Hit $0.145 / Cache-Miss $1.74 / Ausgabe $3.48 pro 1M Token |

| Max output | 384K | 384K |

CometAPI bietet Zugriff auf Deepseek v4 Pro und V4 Flash — 20% günstiger als offiziell — sowie nahtloses Umschalten zwischen 500+ Modellen (GPT-5.4, Gemini 3.1, etc.) über einen einzigen OpenAI-kompatiblen oder Anthropic-Messages-Endpunkt.

Performance-Benchmark

DeepSeek-V3.2 vs V4-Flash vs V4-Pro

In der Basismodell-Vergleichstabelle übertreffen V4-Flash und V4-Pro beide DeepSeek-V3.2 in zentralen Benchmarks, wobei V4-Pro meist die Führung übernimmt. Beispielsweise listet der Bericht folgende Werte: AGIEval 82.6 / 83.1 vs 80.1 bei V3.2; MMLU 88.7 / 90.1 vs 87.8; MMLU-Pro 68.3 / 73.5 vs 65.5; HumanEval 69.5 / 76.8 vs 62.8; und LongBench-V2 44.7 / 51.5 vs 40.2 für V3.2, wobei die mittlere Zahl V4-Flash und die letzte V4-Pro ist.

| Benchmark | DeepSeek-V3.2-Base | DeepSeek-V4-Flash-Base | DeepSeek-V4-Pro-Base |

|---|---|---|---|

| AGIEval (EM) | 80.1 | 82.6 | 83.1 |

| MMLU (EM) | 87.8 | 88.7 | 90.1 |

| MMLU-Pro (EM) | 65.5 | 68.3 | 73.5 |

| HumanEval (Pass@1) | 62.8 | 69.5 | 76.8 |

| LongBench-V2 (EM) | 40.2 | 44.7 | 51.5 |

Quelle: DeepSeek-V4 Technical Report, Tabelle 1.

Das Muster ist klar: Flash verkleinert den Abstand zu Pro, aber Pro bleibt das stärkere allgemeine Modell. Dadurch wird V4-Flash zur praktikablen Standardeinstellung für viele Produktionssysteme, während V4-Pro das Modell der Wahl ist, wenn Antwortqualität wichtiger ist als Kosten oder Latenz.

Vergleiche mit westlichen Modellen: Wo V4 einzuordnen ist

In einer manuellen Evaluation zu chinesischen White-Collar-Aufgaben heißt es im Bericht, DeepSeek-V4-Pro-Max habe Claude Opus 4.6-Max mit einer 63% Nicht-Verlust-Rate übertroffen. DeepSeek-V4-Pro „übertrifft Claude Sonnet 4.5 deutlich“ und nähert sich Claude Opus 4.5 in einem F&E-Coding-Benchmark.

| Evaluation area | DeepSeek result | Western model comparison | What it suggests |

|---|---|---|---|

| Chinese white-collar tasks | V4-Pro-Max, 63% Nicht-Verlust-Rate | vs Claude Opus 4.6-Max | Starke Performance in praxisnahen Business-Aufgaben |

| R&D coding benchmark | V4-Pro-Max Pass-Rate 67 | vs Claude Sonnet 4.5 bei 47; Opus 4.5 bei 70; Opus 4.6 Thinking bei 80 | Wettbewerbsfähig mit führenden Frontier-Modellen, besonders gegenüber Sonnet-Tier-Systemen |

Es ist nicht „in jedem Aspekt die Nummer eins“, aber bereits auf einem Niveau, das „ernsthaft evaluiert werden muss“.

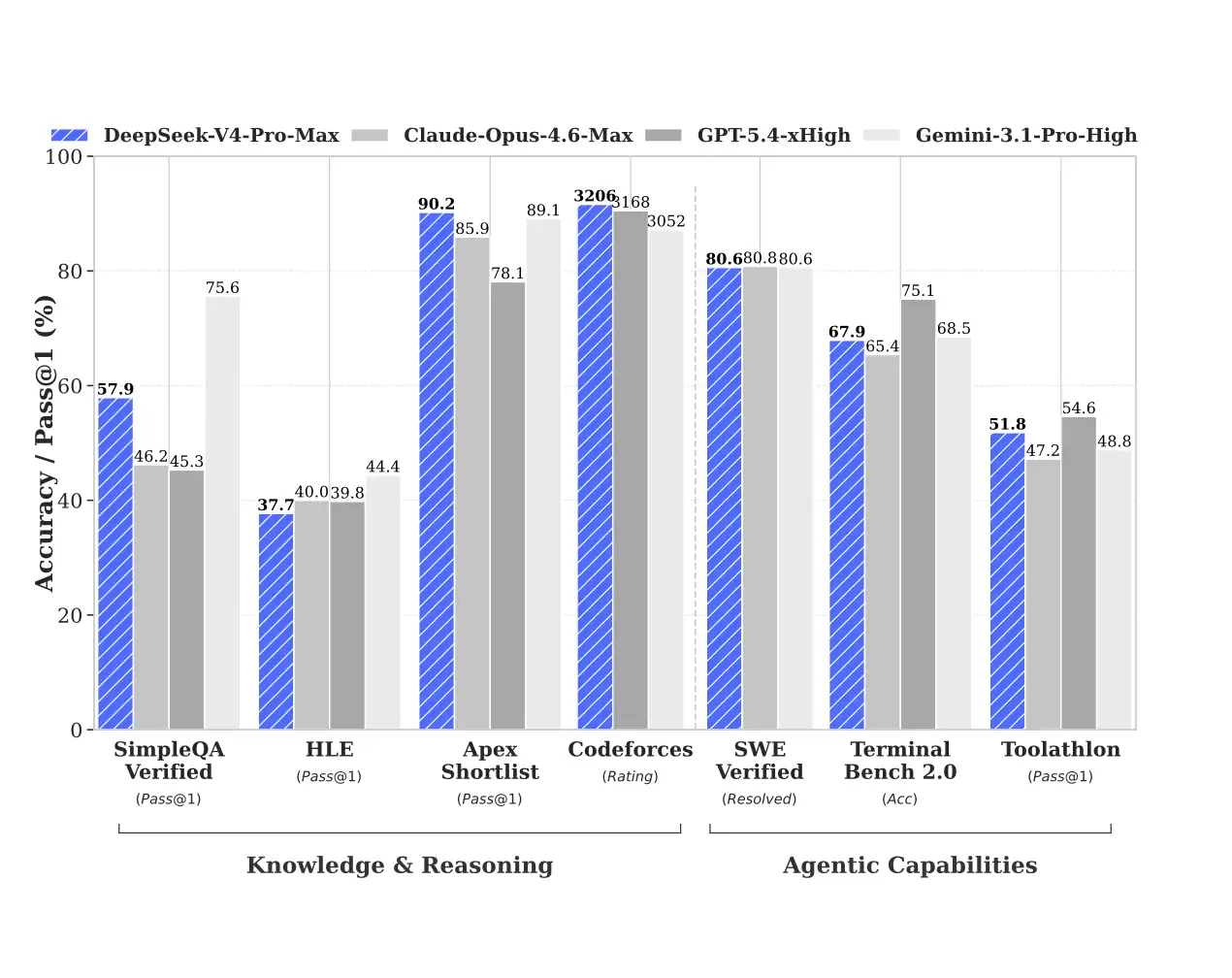

Der technische Bericht von DeepSeek vergleicht V4-Pro-Max in derselben Tabelle mit Claude Opus 4.6 Max, GPT-5.4 xHigh und Gemini 3.1 Pro High. Die Ergebnisse sind nicht eindimensional: Westliche Closed-Source-Modelle sind in einigen Wissens- und Inferenzaspekten weiterhin stark; allerdings hat V4-Pro-Max eine sehr starke Präsenz in Code, langen Kontexten und einigen Agentenaufgaben. Mit anderen Worten: Es ist nicht länger eine eindimensionale Erzählung „heimischer Alternativen“, sondern hat die Phase erreicht, in der es um die Frage geht, „welches passt besser zu Ihrem Szenario“.

In Bezug auf Wissen und Reasoning liegt es auf Augenhöhe mit Opus 4.6 Max, GPT-5.4 xHigh und Gemini 3.1 Pro High. In agentischen Fähigkeiten liegt es leicht zurück, der Unterschied ist jedoch nicht groß.

DeepSeek-V4-Pro-Max ist in codeorientierten und Langkontext-Szenarien hoch wettbewerbsfähig, während westliche Modelle in mehreren reinen Reasoning- und Wissensbenchmarks weiterhin äußerst stark aussehen. So ist der Release zu lesen: DeepSeek V4 gehört klar zur technologischen Spitze, doch Benchmark-Führungen bleiben aufgabenabhängig.

Wie man auf DeepSeek V4 zugreift

1) Offizielle Web- und App-Nutzung

DeepSeek sagt, dass die V4 Preview ab sofort auf Web, App und API verfügbar ist. Für normale Nutzer ist der einfachste Weg weiterhin die offizielle Chat-Oberfläche, in der auf das Modell über den Expert Mode oder Instant Mode zugegriffen werden kann.

2) Nutzung der API

Ich empfehle CometAPI nachdrücklich für den Zugriff auf DeepSeek V4, da es den besten Preis und Aggregationsvorteile bietet.

Die Modellnamen sind:

deepseek-v4-flashdeepseek-v4-pro

DeepSeek sagt außerdem, dass die Legacy-Namen

deepseek-chatunddeepseek-reasonerausgemustert werden und derzeit auf Nicht-Denk- bzw. Denk-Modus von V4-Flash abgebildet sind – bis 2026-07-24. Das ist wichtig für Migrationsplanungen, wenn Sie ältere Integrationen bereits in Produktion haben.

- Registrieren Sie sich bei CometAPI und holen Sie sich Ihren API-Schlüssel.

- Verwenden Sie das Standard-OpenAI-Python-SDK (oder jeden kompatiblen Client) mit einer benutzerdefinierten Basis-URL:

Hier ein schlankes Beispiel im offiziellen OpenAI-kompatiblen Format:

import os

from openai import OpenAIclient = OpenAI(

api_key=os.environ["cometapi_API_KEY"],

base_url="https://api.cometapi.com"

)response = client.chat.completions.create(

model="deepseek-v4-pro",

messages=[

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": "Summarize the benefits of million-token context."}

],

extra_body={"thinking": {"type": "enabled"}},

reasoning_effort="high"

)print(response.choices[0].message.content)

Dieses Anfrage-Muster folgt der Schnellstart-Anleitung: Basis-URL setzen, deepseek-v4-pro oder deepseek-v4-flash wählen und den Denkmodus aktivieren, wenn tieferes Reasoning benötigt wird.

DeepSeek V4 effektiv nutzen

Für Langdokument-Workflows ist es am wirkungsvollsten, den Kontext sauber und strukturiert zu halten. V4s 1M-Token-Fenster ist ein großer Vorteil, aber das Modell performt am besten, wenn die Eingabe in Abschnitte, Quellzitate, Aufgabenanweisungen und explizite Ausgabevorgaben organisiert ist. Das ist der natürlichste Weg, die beworbene Langkontext-Fähigkeit von DeepSeek auszunutzen.

Für Code- und Agenten-Workflows starten Sie mit V4-Flash für schnelle Iterationen und wechseln dann zu V4-Pro für den finalen Lauf oder die schwierigsten Schritte. Dieser Ansatz entspricht der offiziellen Positionierung: Flash ist die effiziente Option, Pro das stärkere Modell, und beide teilen sich dieselbe API-Oberfläche und Kontextlänge.

Fazit

DeepSeek-V4 ist bemerkenswert, weil es vier Dinge kombiniert, die der Markt gleichzeitig fordert: langen Kontext, starkes Reasoning, offene Verfügbarkeit und aggressive Preise. Die eigentliche Geschichte ist nicht, dass DeepSeek ein weiteres Modell veröffentlicht hat, sondern dass das Unternehmen versucht, KI der technologischen Spitze wirtschaftlich in der Produktion nutzbar zu machen. Für Teams, die evaluieren, wo sie ihren nächsten KI-Einsatz platzieren, ist das ein Signal, das man testen – nicht ignorieren – sollte.

Für Teams, die mit mehreren Anbietern bauen, ist dies genau die Art von Release, die sich für Benchmarks im eigenen Stack lohnt. CometAPI kann die praktische Schicht sein, um DeepSeek-V4 neben anderen Frontier-Modellen zu vergleichen, ohne dass Ihr Produktteam die Integration jedes Mal neu aufbauen muss, wenn sich der Markt verschiebt.