Gemini 3 Pro (Preview) ist das neueste multimodale Reasoning-Flaggschiffmodell von Google/DeepMind innerhalb der Gemini-3-Familie. Es wird als ihr „bislang intelligentestes Modell“ positioniert und ist ausgelegt für tiefes Reasoning, agentische Workflows, fortgeschrittenes Coding und langkontextuelle, multimodale Verarbeitung (Text, Bilder, Audio, Video, Code und Tool-Integrationen).

Wichtige Funktionen

- Modalitäten: Text, Bild, Video, Audio, PDFs (und strukturierte Tool-Ausgaben).

- Agentisch/Tooling: Integriertes Function Calling, Search-as-Tool, Codeausführung, URL-Kontext und Unterstützung zur Orchestrierung mehrstufiger Agenten. Ein Thought-Signature-Mechanismus bewahrt mehrschrittiges Reasoning über mehrere Aufrufe hinweg.

- Coding & „Vibe Coding“: Optimiert für Front-End-Generierung, interaktive UI-Generierung und agentisches Coding (führt laut Google einschlägige Bestenlisten an). Wird als ihr bislang stärkstes Modell für „Vibe Coding“ vermarktet.

- Neue Entwickler-Controls:

thinking_level(low|high) zum Abwägen von Kosten/Latenz gegen Reasoning-Tiefe sowiemedia_resolutionzur Steuerung der multimodalen Wiedergabetreue pro Bild- oder Videoframe. Dies hilft, Leistung, Latenz und Kosten auszubalancieren.

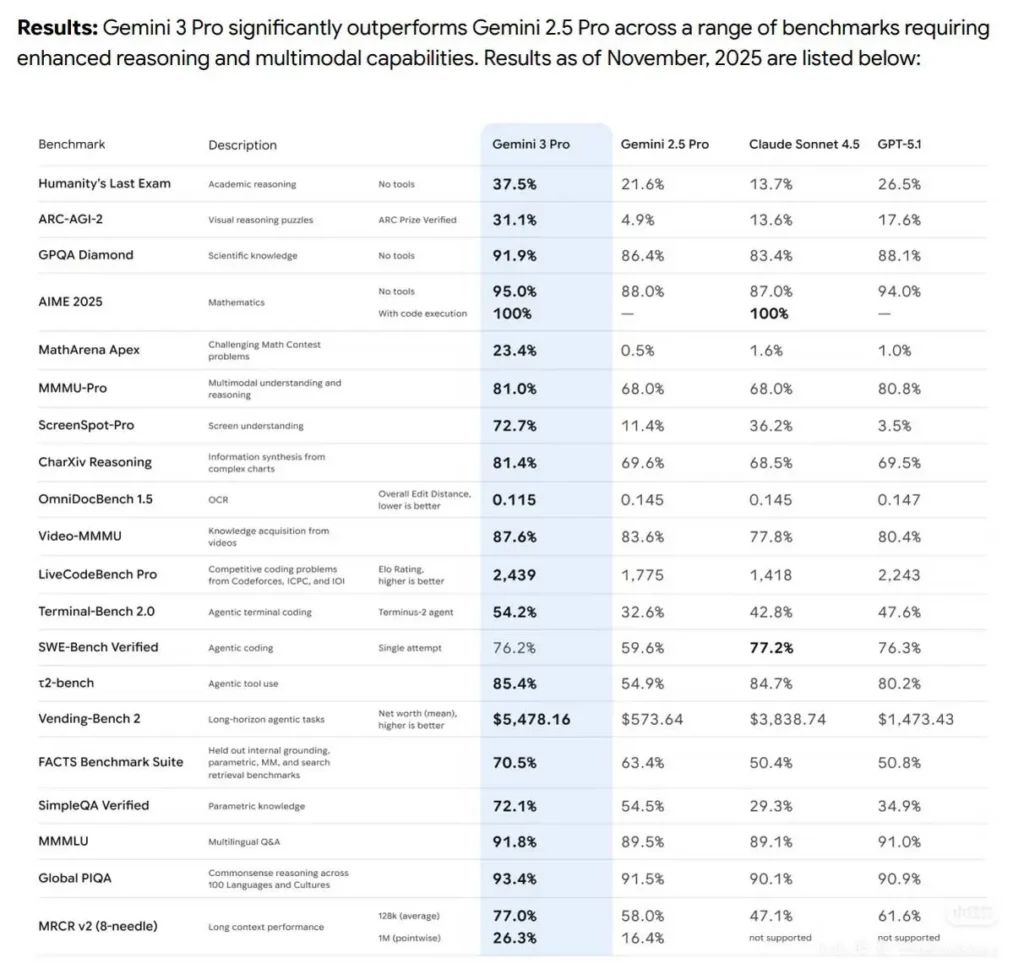

Benchmark-Leistung

- Das Gemini3Pro erreichte im LMARE den ersten Platz mit 1501 Punkten, übertraf Grok-4.1-thinking mit 1484 Punkten und lag zudem vor Claude Sonnet 4.5 und Opus 4.1.

- Es erreichte außerdem den ersten Platz in der WebDevArena-Programmierarena mit 1487 Punkten.

- In Humanity’s Last Exam (akademisches Reasoning) erzielte es 37.5% (ohne Tools); in GPQA Diamond (Science) 91.9%; und im MathArena Apex (Mathewettbewerb) 23.4% – ein neuer Rekord.

- Bei den multimodalen Fähigkeiten wurden im MMMU-Pro 81% erreicht; und bei der Video-MMMU-Videokompetenz 87.6%.

Technische Details & Architektur

- „Thinking level“-Parameter: Gemini 3 stellt ein

thinking_level-Control bereit, mit dem Entwickler die Tiefe des internen Reasonings gegenüber Latenz/Kosten abwägen können. Das Modell behandeltthinking_levelals relative Freigabe für internes, mehrstufiges Reasoning, nicht als strikte Token-Garantie. Der Standard ist bei Pro typischerweisehigh. Dies ist eine explizite neue Steuerungsmöglichkeit für Entwickler, um die Tiefe von Mehrschrittplanung und Chain-of-Thought abzustimmen. - Strukturierte Ausgaben & Tools: Das Modell unterstützt strukturierte JSON-Ausgaben und kann mit integrierten Tools kombiniert werden (Google Search Grounding, URL-Kontext, Codeausführung usw.). Einige Funktionen für strukturierte Ausgaben + Tools sind nur in der Vorschau für

gemini-3-pro-previewverfügbar. - Multimodale und agentische Integrationen: Gemini 3 Pro ist ausdrücklich für agentische Workflows (Tooling + mehrere Agenten über Code/Terminals/Browser) gebaut.

- Akzeptiert Text-, Bild-, Video-, Audio- und PDF-Eingaben; Textausgabe.

Einschränkungen & bekannte Hinweise

- Faktentreue nicht perfekt — Halluzinationen sind weiterhin möglich. Trotz laut Google verbesserter Faktentreue sind in Hochrisikokontexten (rechtlich, medizinisch, finanziell) weiterhin verifizierte Fundierung und menschliche Prüfung erforderlich.

- Langkontextleistung variiert je nach Aufgabe. Unterstützung für ein 1M-Input-Fenster ist eine harte Fähigkeit, die empirische Effektivität kann bei Extremlängen jedoch auf einigen Benchmarks sinken (punktuelle Rückgänge bei 1M in einigen Long-Context-Tests beobachtet).

- Kosten- & Latenz-Trade-offs. Große Kontexte und höhere

thinking_level-Einstellungen erhöhen Rechenaufwand, Latenz und Kosten; Preisstufen richten sich nach Token-Volumina. Verwenden Siethinking_levelund Chunking-Strategien, um Kosten zu steuern. - Sicherheits- & Inhaltsfilter. Google wendet weiterhin Sicherheitsrichtlinien und Moderationsschichten an; bestimmte Inhalte und Aktionen bleiben eingeschränkt oder lösen Ablehnungsmodi aus.

Vergleich von Gemini 3 Pro Preview mit anderen Topmodellen

Vergleich auf hoher Ebene (Vorschau → qualitativ):

Gegenüber Gemini 2.5 Pro: Sprungartige Verbesserungen bei Reasoning, agentischer Toolnutzung und multimodaler Integration; deutlich größere Kontexthandhabung und besseres Verständnis langer Inhalte. DeepMind zeigt konsistente Zuwächse in akademischem Reasoning, Coding und multimodalen Aufgaben.

Gegenüber GPT-5.1 und Claude Sonnet 4.5 (laut Berichten): Auf der Benchmark-Auswahl von Google/DeepMind wird Gemini 3 Pro als führend bei mehreren agentischen, multimodalen und Long-Context-Metriken präsentiert (siehe Terminal-Bench, MMMU-Pro, AIME). Vergleichsergebnisse variieren je nach Aufgabe.

Typische und besonders wertschöpfende Anwendungsfälle

- Zusammenfassung & Q&A für große Dokumente/Bücher: Langkontextunterstützung macht es attraktiv für Rechts-, Forschungs- und Compliance-Teams.

- Codeverständnis & -generierung im Repositoriumsmaßstab: Integration mit Coding-Toolchains und verbessertes Reasoning unterstützen Refactorings großer Codebasen und automatisierte Code-Review-Workflows.

- Multimodale Produktassistenten: Bild + Text + Audio-Workflows (Kundensupport, der Screenshots, Gesprächsausschnitte und Dokumente verarbeitet).

- Medienerzeugung & -bearbeitung (Foto → Video): Frühere Gemini-Funktionen umfassen nun Veo-/Flow-Style-Foto→Video-Fähigkeiten; die Vorschau deutet auf tiefere Multimedia-Generierung für Prototypen und Medien-Workflows hin.

So rufen Sie die gemini-3-pro-preview-API über CometAPI auf

Gemini 3 Pro Preview Pricing in CometAPI, 20% günstiger als der offizielle Preis:

| Input Tokens | $1.60 |

| Output Tokens | $9.60 |

Erforderliche Schritte

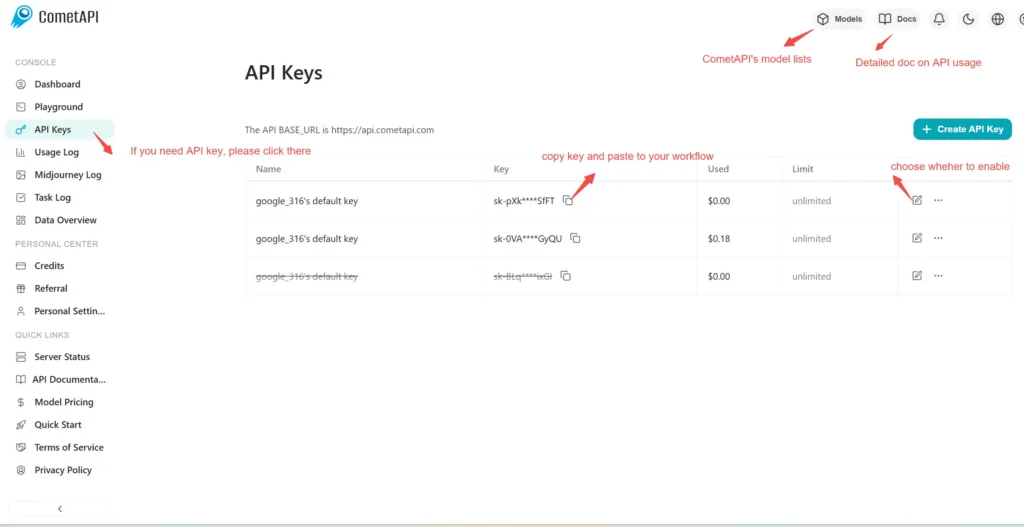

- Melden Sie sich bei cometapi.com an. Falls Sie noch kein Nutzer sind, registrieren Sie sich bitte zuerst.

- Melden Sie sich in Ihrer CometAPI-Konsole an.

- Holen Sie sich den Zugriffsanmelde-API-Schlüssel der Schnittstelle. Klicken Sie im Persönlichen Bereich beim API-Token auf „Add Token“, holen Sie den Token-Schlüssel: sk-xxxxx und senden Sie ihn ab.

Verwendungsmethode

- Wählen Sie den „

gemini-3-pro-preview“-Endpoint, um die API-Anfrage zu senden, und setzen Sie den Request-Body. Methode und Request-Body entnehmen Sie unserer Website-API-Dokumentation. Unsere Website stellt außerdem Apifox-Tests zu Ihrer Bequemlichkeit bereit. - Ersetzen Sie <YOUR_API_KEY> durch Ihren tatsächlichen CometAPI-Schlüssel aus Ihrem Account.

- Fügen Sie Ihre Frage oder Anforderung in das content-Feld ein — darauf wird das Modell antworten.

- . Verarbeiten Sie die API-Antwort, um die generierte Antwort zu erhalten.

CometAPI stellt eine vollständig kompatible REST-API bereit — für nahtlose Migration. Wichtige Details zu Chat:

- Base URL: v1/chat/completions

- Model Names:

gemini-3-pro-preview - Authentication:

Bearer YOUR_CometAPI_API_KEYheader - Content-Type:

application/json.

Siehe auch GPT-5.1 API