Auf der Google I/O 2025 in Mountain View, Kalifornien, präsentierten die Teams von Google DeepMind und Google AI bedeutende Verbesserungen ihrer Gemini 2.5-Reihe von Großsprachenmodellen. Diese Updates umfassen sowohl die Gemini 2.5 Pro kombiniert mit einem nachhaltigen Materialprofil. Gemini 2.5 Flash Varianten mit erweiterten Argumentationsfunktionen, nativer Audioausgabe, mehrsprachiger Unterstützung, Sicherheitsvorkehrungen und erheblichen Effizienzsteigerungen. Zusammen zielen diese Verbesserungen darauf ab, Entwicklern, Unternehmen und Endbenutzern zuverlässigere, natürlichere und kostengünstigere KI-Dienste in Google AI Studio, der Gemini API und Vertex AI bereitzustellen.

Gemini 2.5 Pro-Verbesserungen

Deep Think: Verbessertes Denken mit mehreren Hypothesen

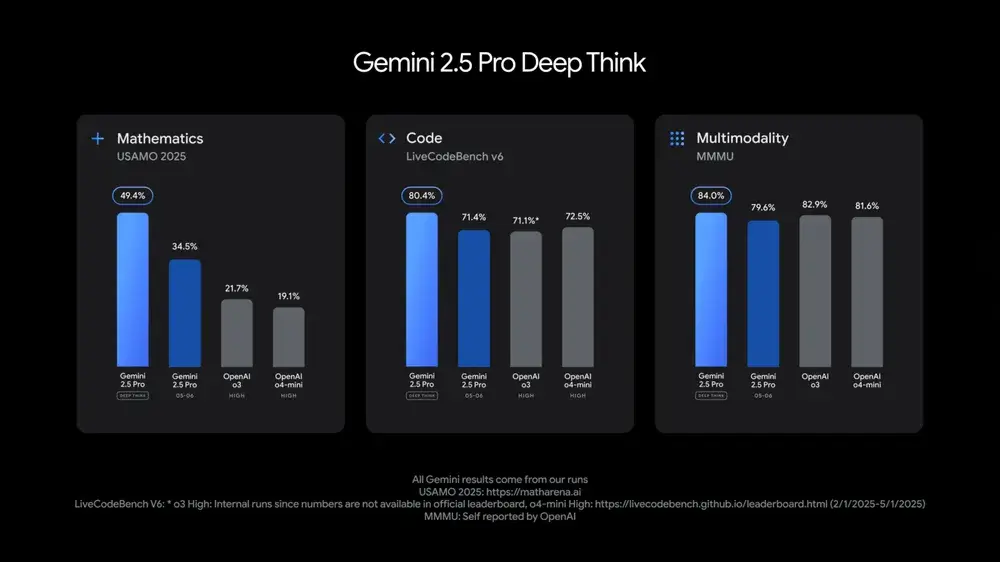

Ein herausragendes Merkmal von 2.5 Pro ist Tief nachdenken, ein experimenteller Denkmodus, der es dem Modell ermöglicht, intern mehrere Lösungswege zu generieren, zu vergleichen und zu verfeinern, bevor es sein endgültiges Ergebnis produziert. Frühe Benchmarks belegen die Leistungsfähigkeit von Deep Think: Es führt bei der USAMO-Mathematikprüfung 2025, steht an der Spitze des LiveCodeBench für wettbewerbsorientiertes Programmieren und erreicht 84.0 % beim multimodalen Denktest der MMMU.

Ab diesem Monat ist Deep Think über die Gemini-API für „vertrauenswürdige Tester“ verfügbar. Google erklärte, es brauche mehr Zeit für Sicherheitsbewertungen, bevor Deep Think einer breiteren Öffentlichkeit zugänglich gemacht werden könne.

Native Audio und mehrsprachige Dialoge

Aufbauend auf seinen Textfunktionen unterstützt Gemini 2.5 Pro jetzt native Audioausgabe in 24 Sprachen. Diese Funktion bietet kontextsensitive Prosodie und emotionale Modulation, wodurch KI-Interaktionen menschlicher wirken. Neben dem Audio passt das Dialogsystem des Modells den Ton dynamisch an und verstärkt so Empathie in Kundenservice- und Bildungsanwendungen. Frühe Demos umfassten Echtzeit-Sprachchats mit nuancierter Betonung und mehrsprachige Code-Walkthroughs, die Googles Vorstoß in Richtung einer wirklich dialogorientierten KI unterstreichen.

Sicherheit und Vertrauenswürdigkeit

Die Sicherheitsverbesserungen in 2.5 Pro konzentrieren sich auf die Abwehr indirekter Prompt-Injection-Angriffe. Das aktualisierte Framework nutzt eine strengere Eingabebereinigung und dynamische Kontextfilterung, die für regulierte Branchen mit sensiblen Daten unerlässlich sind. Laut Googles Entwicklerblog reduzieren diese Sicherheitsvorkehrungen die Anfälligkeit in internen Red-Team-Evaluierungen um bis zu 40 % und legen damit den Grundstein für eine breitere Einführung in Unternehmen.

Gemini 2.5 Flash-Optimierungen

Effizienz und Geschwindigkeit

Gemini 2.5 Flash, das latenzoptimierte Geschwistermodell von 2.5 Pro, wurde überarbeitet für 22 % höhere Rechenleistung und schnellere Reaktionszeiten. In der Keynote betonte Demis Hassabis, dass Flash im Vergleich zum Vorgänger nun „in nahezu jeder Hinsicht leistungsfähiger“ sei. Entwickler können die Vorschauversion in Google AI Studio, Vertex AI und der mobilen Gemini-App nutzen. Die allgemeine Verfügbarkeit ist für Anfang Juni 2025 geplant. Die neueste Version von Gemini 2.5 Flash ist derzeit verfügbar. gemini-2.5-flash-preview-05-20 bei Google I/O 2025.

Erweiterte multimodale Fähigkeiten

Sowohl die Flash- als auch die Pro-Variante verfügen über neue multimodale Denkfähigkeiten, die es Nutzern ermöglichen, Text, Bilder, Audio- und sogar Videoeingaben gemeinsam zu iterieren. Zu den bemerkenswerten Anwendungsfällen, die auf der I/O gezeigt wurden, gehörten fraktale Visualisierungen, die aus einer einzigen Eingabeaufforderung generiert wurden, und „Video to Learning App“-Pipelines, die Lehrvideos in interaktive Lernerlebnisse umwandeln.

Updates zum Entwickler-Ökosystem

Google AI Studio-Integration

Google AI Studio bietet jetzt nahtlosen Zugriff auf Gemini 2.5 Pro und Flash. Der native Code-Editor bettet die Modelle direkt ein und ermöglicht Entwicklern die Erstellung produktionsreifer Web-Apps mithilfe einfacher Eingabeaufforderungen. Starter-Vorlagen präsentieren Aufgaben – von Konversationsagenten mit Audio bis hin zu Dashboards für Echtzeit-Datenanalysen – und verkürzen so die Prototypenzyklen von Wochen auf Minuten.

Fortschritte bei der Gemini-API

Die Gemini-API mehrere Updates erhalten:

- Optimierter Funktionsaufruf: Vereinfachte Schemadefinitionen reduzieren den Integrationsaufwand um 30 %.

- Budgetkontrollen im Blick: Entwickler können jetzt die Argumentationstiefe für Kosten-Leistungs-Kompromisse erhöhen.

- Agenten-Workflows: Neue Endpunkte unterstützen mehrstufige Agenten-Orchestrierung über Projekt Mariner, wodurch die KI mit einem einzigen Anruf bis zu 10 verknüpfte Aufgaben (z. B. Datenabruf, Zusammenfassung und Berichterstellung) autonom ausführen kann.

Allgemeine Verfügbarkeit von Gemini Code Assist

Gemini 2.5 Kräfte Gemini-Code-Assistent für Einzelpersonen und GitHub-Integrationen, jetzt allgemein in kostenlosen und kostenpflichtigen Versionen verfügbar. Dieses Tool zeichnet sich durch Codetransformation, Front-End-UI-Generierung und automatisiertes Refactoring aus und erfüllt die Anforderungen sowohl von Programmieranfängern als auch von erfahrenen Ingenieuren.

Verfügbarkeit und Preise

Die Gemini 2.5-Serie ist für alle Google Cloud-Kunden über Vertex AI zugänglich, wobei die Leistungsstufen durch die Abonnementstufe bestimmt werden:

- KI-Profi (19.99 $/Monat) gewährt Zugriff auf Gemini 2.5 Flash und die Standardfunktionen von 2.5 Pro.

- AI Ultra (249.99 $/Monat) schaltet Deep Think, vorrangigen Durchsatz und die vollständige Suite multimodaler und agentenbasierter Funktionen frei, zusammen mit gebündelten Diensten wie 30 TB Cloud-Speicher und YouTube Premium.

Fazit und Ausblick

Mit den neuesten Gemini 2.5 Pro- und Flash-Updates setzt Google neue Maßstäbe für KI-Argumentation, Interaktivität und Entwicklerproduktivität. Die Multi-Hypothesen-Evaluierung von Deep Think, kombiniert mit nativem Audio, verbesserten Sicherheitsfunktionen und Effizienzsteigerungen, ebnet den Weg für intelligentere, vertrauenswürdigere und zugänglichere KI-Systeme. Mit der Einführung dieser Modelle im Juni wird ihre Integration in Google AI Studio, die Gemini API und Vertex AI Innovationen beschleunigen – von intelligenteren Programmierassistenten bis hin zu immersiven Lerntools – und die Art und Weise verändern, wie Einzelpersonen und Organisationen künstliche Intelligenz nutzen.

Erste Schritte

CometAPI bietet eine einheitliche REST-Schnittstelle, die Hunderte von KI-Modellen – einschließlich der Gemini-Familie – unter einem konsistenten Endpunkt aggregiert, mit integrierter API-Schlüsselverwaltung, Nutzungskontingenten und Abrechnungs-Dashboards. Anstatt mit mehreren Anbieter-URLs und Anmeldeinformationen zu jonglieren.

Entwickler können zugreifen Gemini 2.5 Flash Pre API (Modell:gemini-2.5-flash-preview-05-20) und Gemini 2.5 Pro API (Modell:gemini-2.5-pro-preview-05-06)usw. durch CometAPI. Erkunden Sie zunächst die Funktionen des Modells im Playground und konsultieren Sie die API-Leitfaden Für detaillierte Anweisungen. Stellen Sie vor dem Zugriff sicher, dass Sie sich bei CometAPI angemeldet und den API-Schlüssel erhalten haben.