Google DeepMind hat Gemma 4 am 2. April 2026 offiziell veröffentlicht und damit einen wichtigen Meilenstein für Open-Source-KI gesetzt. Diese Modellfamilie liefert Intelligenz auf Frontier‑Niveau pro Parameter und basiert auf derselben Forschung und Technologie, die Gemini 3 antreibt. Anders als frühere Gemma‑Versionen mit maßgeschneiderten Lizenzen wird Gemma 4 unter der vollständig permissiven Apache‑2.0‑Lizenz ausgeliefert, die uneingeschränkte kommerzielle Nutzung, Modifikation und Weiterverbreitung ermöglicht.

Gemma 4 zeichnet sich durch seine multimodalen Fähigkeiten aus (Text + Bild‑Eingaben in allen Größen sowie Audio bei Edge‑Modellen), native Unterstützung für fortgeschrittenes Reasoning und agentische Workflows, lange Kontextfenster von bis zu 256K Token und Optimierung für alles von Smartphones und Raspberry Pi bis hin zu High‑End‑GPUs. Es unterstützt über 140 Sprachen und legt besonderen Wert auf Effizienz, um leistungsstarke KI auf Endverbraucher‑ und Edge‑Hardware ohne Cloud‑Abhängigkeit zugänglich zu machen.

CometAPI bietet hervorragende APIs für Open‑Source‑ und Closed‑Source‑Modelle.

What Is Gemma 4?

Gemma 4 ist die neueste Familie offener, multimodaler Large Language Models (LLMs) von Google DeepMind, speziell entwickelt für fortgeschrittenes Reasoning, agentische KI‑Workflows und effiziente On‑Device‑Bereitstellung. Es maximiert die „Intelligenz pro Parameter“, indem es Erkenntnisse aus der proprietären Gemini‑3‑Forschung nutzt, und bleibt dennoch vollständig open‑weight und Open‑Source.

Wesentliche Fortschritte gegenüber früheren Gemma‑Modellen:

- Native Multimodalität: Text + Bildverständnis (alle Modelle) mit Audio‑Support bei kleineren Edge‑Varianten.

- Konfigurierbarer Denkmodus: Schritt‑für‑Schritt‑Reasoning mit strukturiertem <|think|>-Output.

- Native Funktionsaufrufe und Tool‑Nutzung: Ideal für autonome Agenten.

- Erweiterter Kontext: Bis zu 256K Token bei größeren Modellen.

- Hybride Aufmerksamkeitsarchitektur: Kombiniert lokale Sliding‑Window‑ mit globaler Attention für Effizienz und Langkontext‑Performance.

- Per‑Layer Embeddings (PLE) in kleineren Modellen und gemeinsam genutzter KV‑Cache zur Speicherersparnis.

- Breite Mehrsprachigkeit: Vortrainiert auf Daten in 140+ Sprachen mit Sensibilität für kulturelle Nuancen.

Veröffentlicht unter Apache 2.0, entfernt Gemma 4 die bisherigen Lizenzbeschränkungen, die die Einführung in Unternehmen hemmen konnten. Entwickler können nun ohne Reibungsverluste feinabstimmen, bereitstellen und kommerzialisieren – und positionieren es als direkten Wettbewerber zu vollständig offenen Ökosystemen wie Llama und Qwen.

Gemma 4 zielt auf diverse Hardware: Edge‑Geräte (Telefone, IoT, Raspberry Pi, Jetson Nano) für latenzarme Offline‑KI sowie Workstations/GPUs für leistungsstarke lokale Server. Dieses „Local‑First“-Design priorisiert Datenschutz, Kosteneinsparungen und Inferenz ohne Latenz.

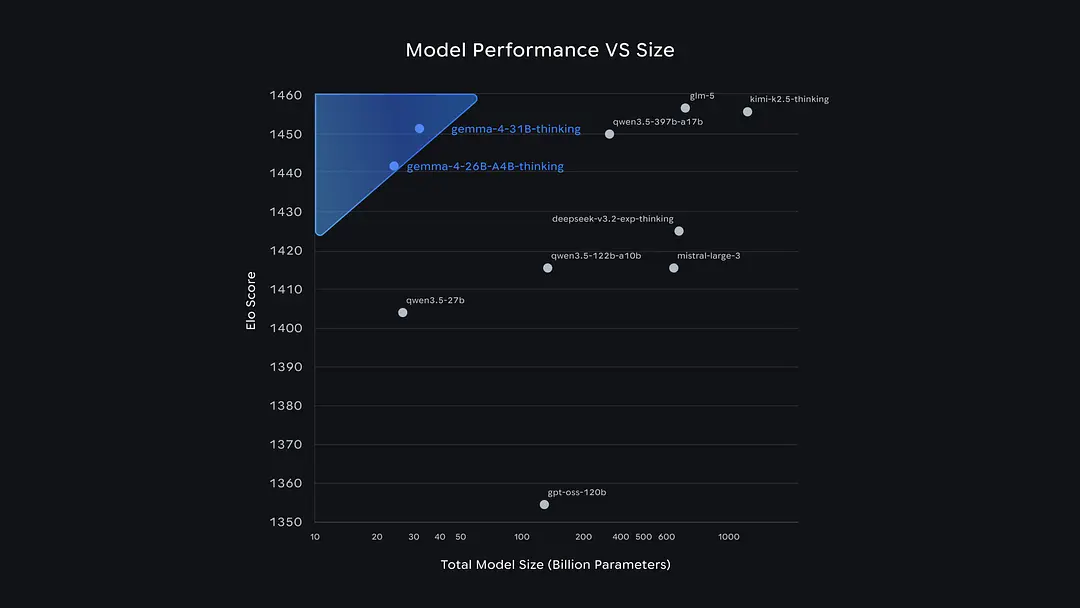

Die Open‑Source‑Modelle, die es auf dem Arena‑Leaderboard übertreffen, stammen hauptsächlich von Teams aus China. Gemma 4 unterscheidet sich nicht stark von Qwen 3.5 und GLM‑5, aber es unterscheidet sich deutlich von OpenAIs GPT‑OSS‑120B.

Entwickler finden jetzt GLM-5, Qwen 3.5 usw. auf CometAPI.

The Four Versions of Gemma 4

Google hat Gemma 4 in vier sorgfältig optimierten Größen veröffentlicht, die jeweils Leistung, Effizienz und Einsatzszenarien ausbalancieren. Zwei verwenden dichte Architekturen mit innovativen Per‑Layer Embeddings (PLE) für Edge‑Effizienz; eines ist ein Mixture‑of‑Experts (MoE) für hohe Leistung bei geringen aktiven Parametern; und eines ist ein dichtes Flaggschiff.

| Modell | Architektur | Gesamtparameter | Aktive Parameter (MoE) | Effektive Parameter | Kontextlänge | Modalitäten | Zielhardware |

|---|---|---|---|---|---|---|---|

| Gemma 4 E2B | Dense + PLE | ~5.1B (inkl. Embeddings) | N/A | 2.3B | 128K | Text, Bild, Audio | Smartphones, Raspberry Pi, Edge‑IoT |

| Gemma 4 E4B | Dense + PLE | ~8B (inkl. Embeddings) | N/A | 4.5B | 128K | Text, Bild, Audio | Mobilgeräte, leichte GPUs, Jetson |

| Gemma 4 26B A4B | MoE (8 aktiv / 128 total + 1 shared) | 25.2B | 3.8B–4B | N/A | 256K | Text, Bild | Workstations, Consumer‑GPUs, lokale Server |

| Gemma 4 31B | Dense | 30.7B | N/A | N/A | 256K | Text, Bild | High‑End‑GPUs (passt auf einzelne H100/A100 in FP16) |

Gemma 4 E2B und E4B (Edge‑optimiert): Nutzen PLE, um pro Schicht Spezialisierung bei minimalem Parameter‑Overhead zu ermöglichen. Ideal für batteriebetriebene oder speicherbeschränkte Geräte. Der Audio‑Encoder (USM‑Style‑Conformer, ~300M Parameter) ermöglicht Speech‑to‑Text und Übersetzung.

Gemma 4 26B A4B (MoE): Aktiviert während der Inferenz nur ~4B Parameter, trotz einer Gesamtgröße von 25B+. Liefert nahezu 31B‑Leistung bei drastisch geringeren Rechenkosten – perfekt für kosteneffiziente Skalierung.

Gemma 4 31B (Dense): Das Flaggschiff für maximale Fähigkeiten. Passt in voller Präzision auf eine einzelne 80‑GB‑GPU und zählt zu den besten offenen Modellen in Leaderboards.

Alle Modelle beinhalten Instruction‑tuned („-it“)-Varianten, optimiert für Chat, Reasoning und Tool‑Nutzung, plus vortrainierte Basisversionen für Fine‑Tuning. Die beiden großen Modelle verfolgen unterschiedliche Ansätze: Das dichte 31B‑Modell strebt höchste Qualität an und dient als beste Grundlage für Fine‑Tuning; das 26B‑MoE‑Modell priorisiert Geschwindigkeit, aktiviert während der Inferenz nur 3,8 Milliarden Parameter und generiert dadurch Wörter deutlich schneller, bei leicht geringerer Gesamtqualität.

Die beiden kleineren Modelle, E2B und E4B, sind speziell für Mobiltelefone und IoT‑Geräte konzipiert: Sie können vollständig offline laufen und sparen Speicher sowie Energie. Zudem besitzen diese kleineren Modelle eine Fähigkeit, die den größeren fehlt: native Audio‑Eingabe, die direkte Spracherkennung ermöglicht.

Core Capabilities of Gemma 4

Gemma 4 überzeugt in Bereichen, die für reale KI‑Anwendungen am wichtigsten sind:

1. Fortgeschrittenes Reasoning & Denkmodus

Konfigurierbares Schritt‑für‑Schritt‑Reasoning via System‑Prompts oder enable_thinking=True. Gibt strukturierte <|think|>-Tags gefolgt von finalen Antworten aus. Verbessert die Leistung bei komplexen Aufgaben drastisch – ohne zusätzliches Fine‑Tuning.

2. Multimodales Verständnis

- Vision: Objekterkennung (JSON‑Bounding‑Boxes), OCR (mehrsprachig), Dokument/PDF‑Parsing, Diagrammverständnis, UI‑Verständnis, Handschriftenerkennung und Verarbeitung variabler Auflösungen (Token‑Budget: 70–1120 Token).

- Video: Bis zu 60 Sekunden (1 fps Frame‑Verarbeitung).

- Audio (nur E2B/E4B): Automatische Spracherkennung (ASR) und Speech‑to‑Text‑Übersetzung (max. 30 s).

- Verschachtelte Eingaben: Text, Bilder und Audio in beliebiger Reihenfolge mischen.

3. Agentische Workflows & Funktionsaufrufe

Native Tool‑Nutzung ermöglicht autonome Agenten für mehrstufige Planung, API‑Aufrufe, App‑Navigation und Aufgabenabschluss. Stark auf τ2‑bench (agentische Tool‑Nutzung).

4. Coding & Entwickler‑Tools

Hervorragende Code‑Generierung, -Vervollständigung, -Debugging und Repository‑Ebene‑Verständnis. Unterstützt JSON‑strukturierte Ausgaben für nahtlose Integration. Erzielt 80,0 % (31B) auf LiveCodeBench v6 und positioniert sich als Local‑First‑KI‑Programmierassistent für Offline‑Entwicklungsszenarien.

5. Langer Kontext & Mehrsprachigkeit

Bewältigt 128K–256K Token zuverlässig (getestet auf MRCR Needle‑in‑a‑Haystack). Vortrainiert auf diversen Daten bis zum Cutoff Januar 2025, mit starker cross‑lingualer Leistung. Das ist nicht nur mehrsprachige Übersetzung; es ist nativ trainiert und deckt über 140 Sprachen ab.

Benchmark Data: Gemma 4 Performance Breakdown

Gemma 4 setzt neue Maßstäbe für offene Modelle. Die 31B‑ und 26B‑Varianten liefern Scores, die zuvor viel größeren proprietären Systemen vorbehalten waren, während Edge‑Modelle den größeren Vorgänger Gemma 3 übertreffen.

Vollständige Benchmark‑Ergebnisse (Instruction‑tuned Modelle)

| Benchmark | Kategorie | Gemma 4 31B | Gemma 4 26B A4B | Gemma 4 E4B | Gemma 4 E2B | Gemma 3 27B (ohne Denkmodus) |

|---|---|---|---|---|---|---|

| MMLU Pro | Reasoning & Wissen | 85.2% | 82.6% | 69.4% | 60.0% | 67.6% |

| AIME 2026 (ohne Tools) | Mathematik | 89.2% | 88.3% | 42.5% | 37.5% | 20.8% |

| GPQA Diamond | Graduiertenniveau‑Wiss. | 84.3% | 82.3% | 58.6% | 43.4% | 42.4% |

| Tau2 (Durchschnitt) | Agentische Tool‑Nutzung | 76.9% | 68.2% | 42.2% | 24.5% | 16.2% |

| LiveCodeBench v6 | Programmierung | 80.0% | 77.1% | 52.0% | 44.0% | 29.1% |

| Codeforces ELO | Wettbewerbsprogramm. | 2150 | 1718 | 940 | 633 | 110 |

| MMMU Pro | Multimodales Reasoning | 76.9% | 73.8% | 52.6% | 44.2% | 49.7% |

| MATH‑Vision | Mathe + Vision | 85.6% | 82.4% | 59.5% | 52.4% | 46.0% |

| MRCR v2 (8‑needle, 128K) | Langer Kontext | 66.4% | 44.1% | 25.4% | 19.1% | 13.5% |

Zentrale Erkenntnisse:

- Riesiger Sprung gegenüber Gemma 3: Das 31B‑Modell verbessert AIME‑Mathe von 20.8% auf 89.2% und LiveCodeBench von 29.1% auf 80.0%.

- MoE‑Effizienz: 26B A4B erreicht nahezu 31B, nutzt dabei während der Inferenz aber deutlich weniger Rechenleistung.

- Edge‑Dominanz: E4B und E2B übertreffen Gemma 3 27B in vielen Metriken, obwohl sie 6–10x kleiner sind.

- Leaderboard‑Platzierungen: 31B erzielt ~1452 auf Arena AI (Text); 26B A4B ~1441. Die 26B‑Variante übertrifft Berichten zufolge deutlich größere Modelle wie Qwen 3.5 397B in Nutzerpräferenz und Programmierung.

Vision‑ und Audio‑Benchmarks bestätigen starke multimodale Leistung out‑of‑the‑box ohne spezialisiertes Fine‑Tuning.

Ecosystem and Tool Support

Gemma 4 profitiert von einer sofortigen, breiten Ökosystem‑Integration:

- Hugging Face: Day‑one‑Support mit

transformers,pipeline("any-to-any"), GGUF, ONNX und multimodalen Prozessoren. - Lokale Laufzeiten: Ollama, Llama.cpp (LM Studio, Jan), MLX (Apple Silicon mit TurboQuant), Mistral.rs (Rust), Transformers.js (WebGPU‑Inferenz im Browser).

- Fine‑Tuning: TRL, Unsloth, PEFT, Vertex AI sowie vollständige Unterstützung multimodaler Datensätze.

- Hardware‑Optimierung: NVIDIA RTX/DGX Spark/Jetson (via TensorRT‑LLM), Google AI Edge‑Tools und On‑Device‑Bereitstellung auf Android/iOS.

- Agenten‑Frameworks: OpenClaw, Hermes, Pi sowie CARLA‑Simulationstests.

- Cloud/Studio: Google AI Studio für schnelles Testen; Kaggle Models zum Download.

Dieses Ökosystem macht Gemma 4 in wenigen Minuten auf Laptops, Servern oder Edge‑Geräten einsatzbereit.

Einschränkungen & Sicherheit:

- Cutoff der Trainingsdaten: Januar 2025 (ohne Tools kein Echtzeitwissen).

- Audio auf Sprache beschränkt (keine Musik); Video auf 60 s begrenzt.

- Halluzinationsrisiko bleibt – nutzen Sie den Denkmodus und Verifikation.

- Sicherheit: Strenge Filterung und Bewertungen gemäß den Google AI Principles; Entwickler sollten anwendungsspezifische Schutzmechanismen ergänzen.

Why Gemma 4 Matters in 2026

Gemma 4 demokratisiert Frontier‑KI. Durch die Kombination aus multimodaler Intelligenz, agentischen Fähigkeiten und Apache‑2.0‑Freiheit mit hardware‑agnostischer Effizienz ermöglicht es Entwicklern und Unternehmen, sichere, private und kosteneffiziente KI‑Lösungen in großem Maßstab zu erstellen. Der Durchbruch bei „Intelligenz pro Parameter“ – besonders sichtbar in Edge‑Modellen, die die Flaggschiffe von gestern übertreffen – signalisiert den Übergang zu wirklich allgegenwärtiger KI.

Ob ein 2B‑Modell auf einem Telefon oder ein 31B‑Kraftpaket lokal betrieben wird: Gemma 4 zeigt, dass Open‑Source‑KI in der praktischen Nutzbarkeit zu geschlossenen Alternativen aufgeschlossen hat (und sie in vielen Fällen übertrifft).