Die gpt-5.1-chat-latest API ist die von OpenAI. GPT-5.1 Instant Das ist die Variante mit niedriger Latenz aus der neu veröffentlichten GPT-5.1-Familie (angekündigt am 12. November 2025). Sie wurde entwickelt, um das am häufigsten verwendete ChatGPT-Erlebnis mit schnellerem Gesprächswechsel, wärmeren Standard-Konversationstönen, verbesserter Befolgung von Anweisungen und einer integrierten Funktion zu bieten. adaptives Denken Die Fähigkeit, zu entscheiden, wann sofort geantwortet werden soll und wann zusätzliche Rechenleistung aufgewendet werden soll, um komplexere Anfragen zu „durchdenken“.

Grundlegende Informationen und Funktionen

- Wärmerer, gesprächigerer Standardton und erweiterte Ton-/Personalisierungsvoreinstellungen, die den Benutzerpräferenzen entsprechen (Beispiele: Professionell, Freundlich, Offen, Schrullig, Effizient, Nerdig, Zynisch).

- Adaptives Denken: Das Modell entscheidet, wann zusätzliche Denkprozesse vor der Beantwortung notwendig sind; Instant zielt darauf ab, die meisten alltäglichen Anfragen schnell zu beantworten und dabei gegebenenfalls zusätzlichen Aufwand zu betreiben.

- Verbesserte Befolgung von Anweisungen (weniger Missverständnisse bei mehrstufigen Anweisungen) und generell reduzierter Fachjargon für ein besseres Verständnis durch den Benutzer (insbesondere in der Variante „Denken“).

- Entwickelt Echtzeit-UX: Streaming-Antworten, geringe Token-Roundtrip-Latenz, nützlich für Sprachassistenten, Live-Transkription und hochgradig interaktive Konversations-Apps.

Technische Details (für Entwickler)

- API-Modellbezeichner: OpenAI wird Instant in der API unter der Chat-Style-Kennung bereitstellen.

gpt-5.1-chat-latest(Sofort) undgpt-5.1Für Denkprozesse (gemäß den Versionshinweisen von OpenAI). Verwenden Sie den Responses-API-Endpunkt für optimale Effizienz. - Response-API & Parameter: Die GPT-5-Familie (einschließlich 5.1) wird am besten über die neuere Version verwendet. Rücklaufrate API. Typische Optionen, die Sie übergeben, sind Modellname, Eingaben/Nachrichten und optionale Steuerungsparameter wie z. B.

verbosity/reasoning(Aufwand) Diese Parameter legen fest, wie viel internes Denken das Modell vor einer Antwort anwendet (vorausgesetzt, die Plattform verwendet dieselben Parameterkonventionen wie GPT-5). Für hochinteraktive Anwendungen sollten Streaming-Antworten aktiviert werden. - Adaptives Denkverhalten: Instant ist auf schnelle Antworten ausgelegt, hat aber Lichtadaptives Denken—Es wird bei anspruchsvolleren Aufgaben (Mathematik, Programmierung, mehrstufiges logisches Denken) etwas mehr Rechenleistung einsetzen, um Fehler zu reduzieren und gleichzeitig die durchschnittliche Latenzzeit niedrig zu halten. GPT-5.1 Thinking wird mehr Rechenleistung für schwierigere Probleme und weniger für triviale verwenden.

Benchmark- und Sicherheitsleistung

GPT-5.1 Instant ist darauf ausgelegt, schnelle Reaktionszeiten zu gewährleisten und gleichzeitig die Ergebnisse in Mathematik und Programmierung zu verbessern (AIME 2025, Codeforces-Verbesserungen wurden von OpenAI besonders hervorgehoben).

OpenAI veröffentlichte a GPT-5.1 Systemkarten-Nachtrag mit produktionsbezogenen Benchmark-Kennzahlen und gezielten Sicherheitsbewertungen. Kennzahlen (Produktionsbenchmarks, höher = besser, not_unsafe metrisch):

- Illegal / gewaltlos (nicht unsicher) — gpt-5.1-instant: 0.853.

- Persönliche Daten - gpt-5.1-instant: 1.000 (perfekt in diesem Benchmark).

- Belästigung - gpt-5.1-instant: 0.836.

- Psychische Gesundheit (neue Bewertung) - gpt-5.1-instant: 0.883.

- StrongReject (Jailbreak-Robustheit, nicht_unsicher) - gpt-5.1-instant: 0.976 (zeigt im Vergleich zu älteren Instant Checkpoints eine hohe Robustheit gegenüber Angriffen durch Angreifer).

Typische und empfohlene Anwendungsfälle für GPT-5.1 Instant

- Chatbots und dialogbasierte Benutzeroberflächen — Kundensupport-Chat, Verkaufsassistenten und Produktleitfäden, bei denen geringe Latenz den Gesprächsfluss aufrechterhält.

- Sprachassistenten / Streaming-Antworten — Streaming von Teilausgaben an eine Benutzeroberfläche oder eine TTS-Engine für Interaktionen im Subsekundenbereich.

- Zusammenfassen, Umformulieren, Verfassen von Nachrichten — schnelle Transformationen, die von einem wärmeren, benutzerfreundlicheren Ton profitieren.

- Hilfe beim einfachen Codieren und Inline-Debugging — für schnelle Code-Schnipsel und Vorschläge; Thinking für detailliertere Fehleranalysen verwenden. (Testen Sie es in Ihrer Codebasis.)

- Agenten-Frontends und abfrageerweiterte Workflows — wenn schnelle Reaktionen in Kombination mit gelegentlichen, tiefergehenden Analysen/Toolaufrufen gewünscht sind. Nutzen Sie das adaptive Analyseverhalten, um Kosten und Komplexität in Einklang zu bringen.

Vergleich mit anderen Modellen

- GPT-5.1 vs GPT-5: GPT-5.1 ist ein optimiertes Upgrade – mit wärmerem Standardton, verbesserter Befolgung von Anweisungen und adaptivem Denken. OpenAI positioniert Version 5.1 als deutlich überlegen in den anvisierten Bereichen, behält GPT-5 aber aus Gründen der Übergangs- und Kompatibilitätssicherheit in einem separaten Menü bei.

- GPT-5.1 vs. GPT-4.1 / GPT-4.5 / GPT-4o: Die GPT-5-Familie zielt weiterhin auf eine höhere Leistung beim logischen Denken und Codieren ab als die GPT-4.x-Serie; GPT-4.1 bleibt für sehr lange Kontexte oder kostensensible Anwendungen relevant. Experten heben den Vorsprung von GPT-5/5.1 bei anspruchsvollen Mathematik- und Codierungs-Benchmarks hervor, die genauen Vorteile pro Aufgabe hängen jedoch vom jeweiligen Benchmark ab.

- GPT-5.1 gegen Claude / Gemini / andere Rivalen: Erste Kommentare beschreiben GPT-5.1 als Reaktion auf Nutzerfeedback (Persönlichkeit + Fähigkeiten). Konkurrenzprodukte (Anthropics Claude Sonnet-Serie, Googles Gemini 3 Pro, Baidus ERNIE-Varianten) betonen andere Prioritäten (Sicherheit an erster Stelle, Multimodalität, große Kontexte). Für technische Anwender empfiehlt sich eine Bewertung hinsichtlich Kosten, Latenz und Sicherheitsverhalten in Bezug auf die jeweiligen Arbeitslasten (Eingabeaufforderungen + Tool-Aufrufe + Domänendaten).

Wie man die GPT-5.1 Instant API von CometAPI aus aufruft

GPT-5.1 Instant API-Preise in CometAPI, 20 % Rabatt auf den offiziellen Preis:

| Eingabetoken | $1.00 |

| Ausgabetoken | $8.00 |

Erforderliche Schritte

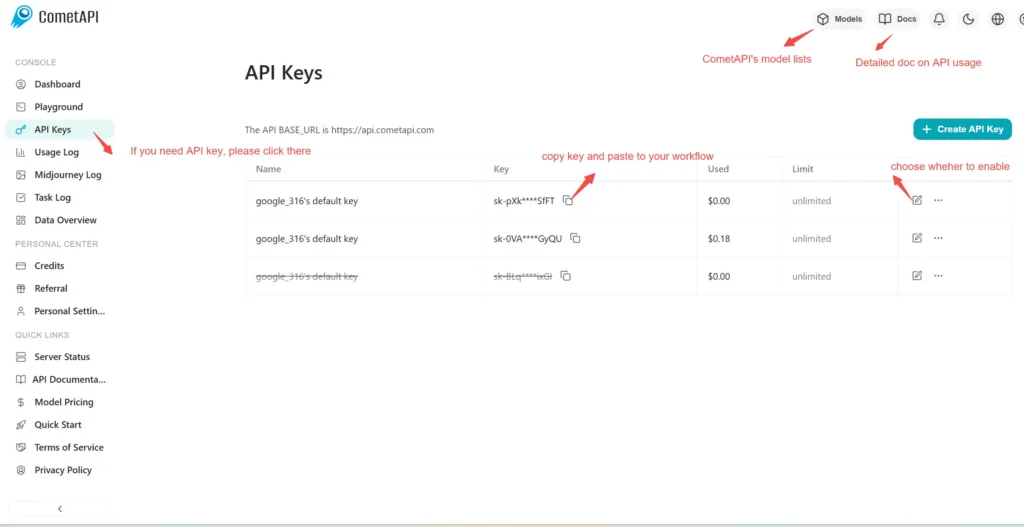

- Einloggen in cometapi.com. Wenn Sie noch kein Benutzer bei uns sind, registrieren Sie sich bitte zuerst.

- Melden Sie sich in Ihrem CometAPI-Konsole.

- Holen Sie sich den API-Schlüssel für die Zugangsdaten der Schnittstelle. Klicken Sie im persönlichen Bereich beim API-Token auf „Token hinzufügen“, holen Sie sich den Token-Schlüssel: sk-xxxxx und senden Sie ihn ab.

Methode verwenden

- Wählen Sie das "

gpt-5.1-chat-latest”-Endpunkt, um die API-Anfrage zu senden und den Anfragetext festzulegen. Die Anfragemethode und der Anfragetext stammen aus der API-Dokumentation unserer Website. Unsere Website bietet außerdem einen Apifox-Test für Ihre Bequemlichkeit. - Ersetzen mit Ihrem aktuellen CometAPI-Schlüssel aus Ihrem Konto.

- Geben Sie Ihre Frage oder Anfrage in das Inhaltsfeld ein – das Modell antwortet darauf.

- . Verarbeiten Sie die API-Antwort, um die generierte Antwort zu erhalten.

CometAPI bietet eine vollständig kompatible REST-API für eine nahtlose Migration. Wichtige Details zu Chat:

- Basis-URL: https://api.cometapi.com/v1/chat/completions

- Modellnamen:

gpt-5.1-chat-latest - Authentifizierung:

Bearer YOUR_CometAPI_API_KEYKopfzeile - Content-Type:

application/json.

Siehe auch Sora 2 API