GPT-5 Pro ist OpenAIs Top-Tier-GPT-5-Variante, entwickelt für erweiterte Argumentation, Verbesserungen der Codequalität und Workflows mit höheren AnforderungenEs steht an der Spitze der GPT-5-Familie (die auch die Modi „Standard“ und „Denken“ umfasst) und ist für Entwickler und Organisationen geeignet, die die stärkste Einzelabfrage-Argumentation und Aufgabenleistung benötigen, die in der GPT-5-Reihe verfügbar ist.

Hauptfunktionen (allgemein)

- Erweiterte Argumentation: entwickelt, um längere Gedankenketten und robustere Schritt-für-Schritt-Lösungen für komplexe Aufgaben zu produzieren.

- Verbesserte Anweisungsbefolgung: Beachtet Benutzerbeschränkungen besser und erzeugt konsistente Ausgaben über Eingabeaufforderungen hinweg.

- Tool- und Agentenintegration: entwickelt, um Tools zuverlässig aufzurufen (Browser, Codeausführung, Dateizugriff usw.) und mehrstufige Aktionen zu orchestrieren. Bessere Integration mit Funktionsaufrufen, Python/Tools und Agenten-Frameworks für mehrstufige Workflows.

- Multimodale Eingaben: unterstützt umfangreichere Eingabetypen, die in der gesamten GPT-5-Familie verwendet werden (Text + Bilder und verbessertes kreuzmodales Denken).

- Unternehmensbereitschaft: richtet sich an Produktionskunden, die geringere Fehlerraten und ein vorhersehbares Tool-Aufrufverhalten benötigen.

Technische Details (Architektur & Schulung)

- Gedankenkettentraining und RL-Ausrichtung: Das Trainingsprogramm von GPT-5 legt ausdrücklich Wert auf das Denken im Ketten-Stil und das bestärkende Lernen durch menschliches Feedback (RLHF/RL), um die schrittweise Problemlösung und -ausrichtung zu verbessern.

- Inferenzstrategien: Die Pro Die Ebene scheint ausgefeiltere Inferenzzeitprozesse (z. B. längere interne Beratung, Ensemble- oder Stichprobenstrategien) zu nutzen, um die Antwortqualität für hochwertige Abfragen zu verbessern.

- Effizienzkompromisse: Es weist auf eine Mischung aus Expertenansatz und Inferenzmoduswechsel hin (einfacher für triviale Abfragen, rechenintensiver für „denkende“ Abfragen).

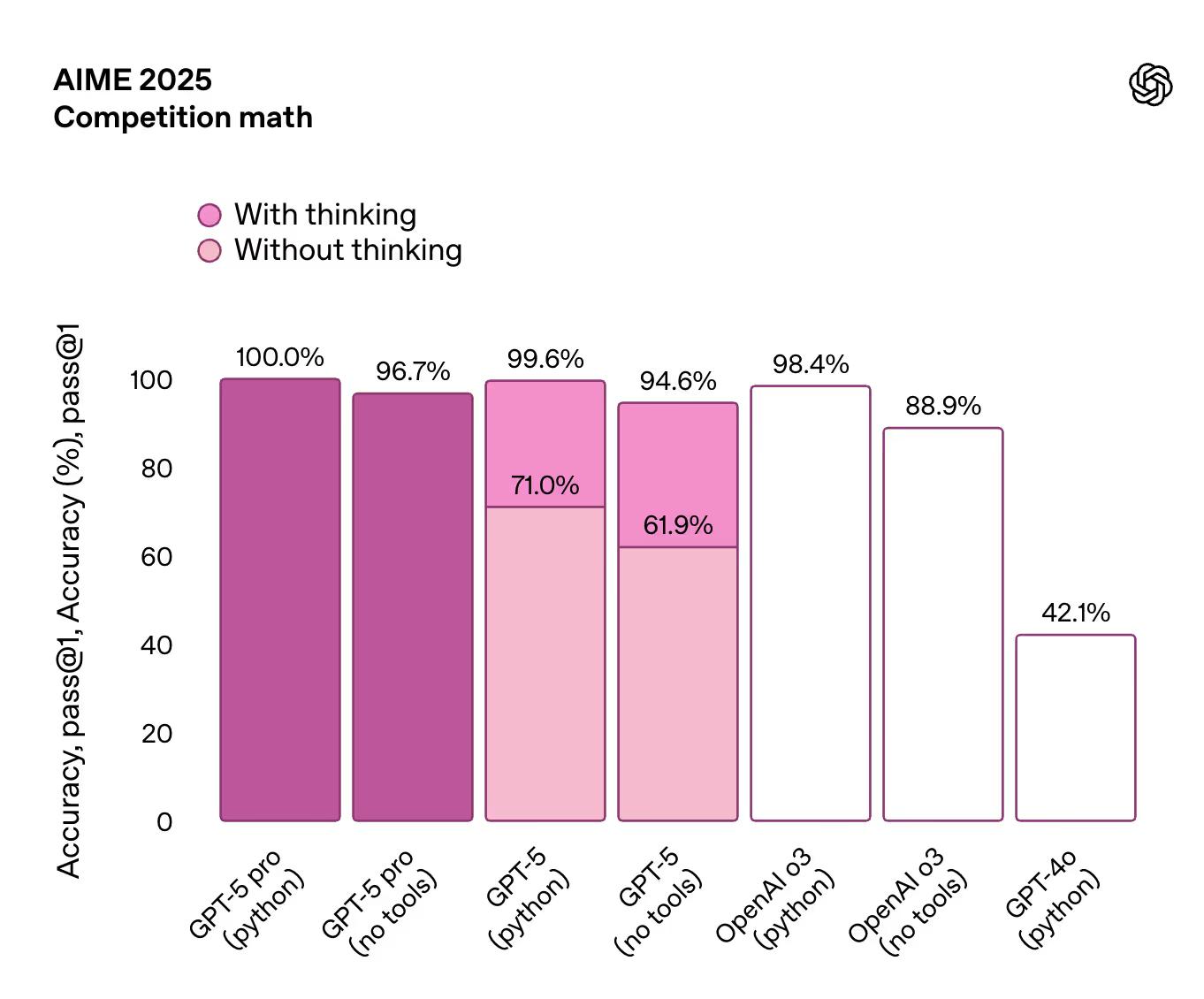

Benchmark-Leistung

Bei den Denkfähigkeiten schauen wir uns normalerweise den GPQA Diamond-Benchmark an:

GPT-5 Pro (mit Python-Tools) erzielt die höchste Punktzahl bei 89.4% bei naturwissenschaftlichen Fragen auf Doktorandenniveau, etwas besser als die Variante ohne Tools.

Die letzte Prüfung der Menschheit:

Unabhängige Benchmark-Berichte zeigen GPT-5 Pro (mit Python/Tools) Erreichen von Bestnoten in bestimmten anspruchsvollen naturwissenschaftlichen und logisch denkenden Fächern (Beispiel: ~ 89.4% bei einem naturwissenschaftlichen Fragensatz auf PhD-Niveau in einer Analyse) und übertraf GPT-4o und frühere Varianten bei Tests zum fortgeschrittenen Denkvermögen. Diese Ergebnisse variieren je nach Benchmark und je nachdem, ob die Verwendung von Tools erlaubt ist.

Sachlichkeit & Sicherheit: OpenAI erklärte, dass die Antworten von GPT-5 wesentlich niedrigere faktische Fehlerraten aufweisen – zum Beispiel berichteten Reduktionen von etwa ~45 % weniger wahrscheinlich sachliche Fehler enthalten als GPT-4o in ihrem öffentlichen Material.

Einschränkungen und bekannte Fehlermodi

- Benchmark-Varianz und Aufgabensensitivität: Pro liegt bei vielen technischen und logisch denkenden Benchmarks vorn, die Ergebnisse können jedoch je nach Konfiguration stark variieren, was zu Bedenken hinsichtlich einer Überanpassung an Benchmarks führt.

- Variable Gesprächsflüssigkeit: einige Rezensenten berichteten von Sprödigkeit im Multi-Turn-Chat oder einer geringeren Kontinuität der Konversation im Vergleich zu anderen chatzentrierten Varianten.

- Höhere Kosten und Latenz: Die parallele Testzeitberechnung von Pro erhöht die Kosten pro Anruf und kann im Vergleich zu leichteren GPT-5-Profilen zu längeren Latenzen führen.

Hochwertige Anwendungsfälle

Stichwort: komplexes Denken, Codegenerierung, Forschungsunterstützung, hochwertige Automatisierung, Fragen und Antworten von Experten.

GPT-5 Pro eignet sich am besten für Anwendungen, die starkes Single-Turn-Argumentation und hochwertige Codeausgabe, Zum Beispiel:

- Softwareentwicklung: Fehlerbehebung, Codebearbeitungen mehrerer Dateien und komplexe Refactorings.

- Forschung & Analytik: schnelle Synthese von technischem Material und Hypothesengenerierung, wo es auf Präzision ankommt.

- Unternehmensautomatisierung: Unterstützung kritischer Entscheidungen (Zusammenfassung rechtlicher/rechtlich angrenzender Bereiche, technische Due Diligence), bei der eine verbesserte Argumentation die nachgelagerte manuelle Arbeit reduziert.

- Hochwertige Inhaltserstellung: strukturierte Berichte, ausgefeilte technische Dokumentation und mehrstufige Pipelines, die von der höheren Wiedergabetreue von Pro profitieren.

Für kostengünstigere oder Konversationsaufgaben sind möglicherweise die Standardmodi GPT-5 oder Thinking vorzuziehen.

Vergleich des GPT-5 Pro mit anderen Modellen

- GPT-5 Pro vs. GPT-5 (Standard/Denken): Pro priorisiert maximale Argumentationsqualität und übertrifft Standard/Thinking bei ausgewählten Codierungs- und Argumentationsbenchmarks normalerweise auf Kosten der Rechenleistung/Kosten.

- GPT-5 Pro vs. o3/4o: Bei technischen Benchmarks wie SWE-Bench Verified und ausgewählten Codierungssuiten soll GPT-5 (Pro/High) in vielen Fällen o3 und GPT-4o übertreffen. Die Gewinne sind jedoch aufgabenabhängig und manchmal inkrementell, nicht gleichmäßig transformierend.

- GPT-5 Pro vs. Agenten-/Tool-Setups: Einige agentenbasierte Systeme, die mehrere kleinere Modelle orchestrieren, können bei bestimmten mehrstufigen Arbeitsabläufen mit größeren Einzelmodellantworten mithalten oder diese sogar übertreffen. Die integrierte Rechenleistung von GPT-5 Pro für paralleles Denken vereinfacht jedoch häufig die Ergonomie einzelner Anrufe und reduziert den Orchestrierungsaufwand.

Wie man anruft GPT-5 Pro API von CometAPI

Modellversion: gpt-5-pro / gpt-5-pro-2025-10-06

gpt-5-pro API-Preise in CometAPI, 20 % Rabatt auf den offiziellen Preis:

| Eingabetoken | $12.00 |

| Ausgabetoken | $96.00 |

Erforderliche Schritte

- Einloggen in cometapi.comWenn Sie noch nicht unser Benutzer sind, registrieren Sie sich bitte zuerst

- Holen Sie sich den API-Schlüssel für die Zugangsdaten der Schnittstelle. Klicken Sie im persönlichen Bereich beim API-Token auf „Token hinzufügen“, holen Sie sich den Token-Schlüssel: sk-xxxxx und senden Sie ihn ab.

- Holen Sie sich die URL dieser Site: https://api.cometapi.com/

Methode verwenden

- Wählen Sie das "

gpt-5-pro / gpt-5-pro-2025-10-06”-Endpunkt, um die API-Anfrage zu senden und den Anfragetext festzulegen. Die Anfragemethode und der Anfragetext stammen aus der API-Dokumentation unserer Website. Unsere Website bietet außerdem einen Apifox-Test für Ihre Bequemlichkeit. - Ersetzen mit Ihrem aktuellen CometAPI-Schlüssel aus Ihrem Konto.

- Geben Sie Ihre Frage oder Anfrage in das Inhaltsfeld ein – das Modell antwortet darauf.

- . Verarbeiten Sie die API-Antwort, um die generierte Antwort zu erhalten.

CometAPI bietet eine vollständig kompatible REST-API – für eine nahtlose Migration. Wichtige Details:

- Basis-URL: https://api.cometapi.com/v1/responses

- Modellnamen:

gpt-5-pro / gpt-5-pro-2025-10-06 - Authentifizierung:

Bearer YOUR_CometAPI_API_KEYKopfzeile - Content-Type:

application/json.

curl --location --request POST 'https://api.cometapi.com/v1/responses' \

--header 'Authorization: sk-' \

--header 'Content-Type: application/json' \

--header 'Accept: /' \

--header 'Host: api.cometapi.com' \

--header 'Connection: keep-alive' \

--data-raw '{

"model": "gpt-5-pro",

"stream": true,

"messages": [

{

"role": "user",

"content": "Generate a cute kitten sitting on a cloud, cartoon style"

}

]

}

Siehe auch GPT-5-API