Grok 3 und o3 repräsentieren die neuesten Entwicklungen in der Großsprachenmodellierung aus zwei der aktuell am stärksten beobachteten KI-Labore. Da xAI und OpenAI um die Vorherrschaft in den Bereichen Schlussfolgerung, Multimodalität und praktische Auswirkungen wetteifern, ist das Verständnis der Unterschiede zwischen Grok 3 und o3 für Entwickler, Forscher und Unternehmen, die eine Einführung in Erwägung ziehen, von entscheidender Bedeutung. Dieser ausführliche Vergleich untersucht ihre Ursprünge, architektonischen Innovationen, Benchmark-Leistungen, praktischen Anwendungen und Wertversprechen und hilft Ihnen zu bestimmen, welches Modell am besten zu Ihren Zielen passt.

Was sind die Ursprünge und Veröffentlichungszeitpläne von Grok 3 und o3?

Das Verständnis der Entstehung und der Visionen hinter Grok 3 und o3 schafft die Grundlage für die Einschätzung, wie jedes Modell in der KI-Landschaft positioniert wurde.

Was ist Grok 3

Die Grok-Serie von xAI begann als ungeschützter, regelarmer Chatbot auf X (ehemals Twitter). Grok 2.0 führte die FLUX.1-Integration ein, doch Grok 3 markiert einen Wendepunkt: Es wird explizit als „Age of Reasoning Agents“ vermarktet und bietet tiefgreifende Fachkompetenz in den Bereichen Finanzen, Programmierung und juristische Textextraktion. Elon Musks Vision setzt auf offene Debatten und weniger inhaltliche Einschränkungen, wodurch Grok 3 bei Bedarf kontroverse oder ungefilterte Erkenntnisse generieren kann. Der „Big Brain“-Modus nutzt zusätzliche Rechendurchgänge und ahmt so menschliches Denken nach, und eine neue DeepSearch-Engine durchsucht Echtzeit-Web- und X-Daten nach detailliertem Kontext.

Die Grok-Serie von xAI wurde entwickelt, um über Konversationsagenten hinaus in den Bereich des autonomen Denkens vorzudringen. Grok 3, das am 19. Februar 2025 als Betaversion vorgestellt wurde, wurde als „unser bisher fortschrittlichstes Modell“ beworben. Es kombiniert überlegene Denkmodule mit umfangreichem vortrainiertem Wissen, um tiefere, kontextbezogene Dialoge und Aufgaben zu unterstützen. Elon Musk betonte, dass Grok 3 „alle aktuellen KI-Konkurrenten übertrifft“, darunter GPT-4o, Gemini und Anthropics Claude, und bezeichnete es als direkte Herausforderung für die Angebote von OpenAI.

Was ist o3

Die o-Serie von OpenAI geht auf frühe Experimente zurück, bei denen Denkschritte vor der Generierung von Antworten verkettet wurden. Am 16. April 2025 veröffentlichte OpenAI offiziell o3 zusammen mit o4-mini und betonte dabei die Fähigkeit des Systems, „länger nachzudenken, bevor man antwortet“ und externe Tools und APIs handlungsorientiert aufzurufen – Fähigkeiten, die für komplexe, multimodale Arbeitsabläufe entscheidend sind. Sam Altman lobte o3 für seine „Intelligenz auf Genieniveau“ und signalisierte damit Vertrauen in die Fähigkeit des Modells, Aufgaben zu bewältigen, die traditionell menschlichen Experten vorbehalten waren.

Die O-Serie von OpenAI entwickelte sich aus der Einführung privater Denkketten durch O1 Ende 2024. Die Architektur von O3 behält die Transformer-Grundlagen bei, plant aber Inferenzschritte ein, die intern „denken“, bevor Antworten ausgegeben werden. In frühen Zugriffsrunden von Dezember 2024 bis Januar 2025 wurde Feedback von Sicherheitsforschern eingeholt und die Parameter optimiert, um Latenz und Argumentationsgenauigkeit in Einklang zu bringen. O3-mini, das auf kostensensitive Anwendungen ausgerichtet ist, hält ähnliche Latenzziele wie O1-mini ein und verbessert gleichzeitig die STEM-Fähigkeiten. O3 selbst, das Pro- und Enterprise-Nutzern vorbehalten ist, erhöht die Inferenzzeit für komplexe Aufgaben und verkörpert OpenAIs inkrementelles, aber sicherheitsbewusstes Entwicklungsethos.

Wie unterscheiden sich ihre Modellarchitekturen und Trainingsstrategien?

Obwohl beide Modelle auf Transformatorgrundlagen aufbauen, unterscheiden sie sich in Maßstab, Argumentationsmechanismen und multimodalen Integrationen.

Kernarchitektur

- Grok 3: Behält ein groß angelegtes Transformer-Backbone bei, ergänzt durch maßgeschneiderte Reasoning-Schichten, die für die explizite Sequenzierung von Inferenzschritten konzipiert sind. Diese Architektur zielt darauf ab, menschliche Denkprozesse im Maschinenmaßstab abzubilden.

- o3: Implementiert ein „agentisches“ Argumentationsparadigma, bei dem das Modell den Rechenaufwand dynamisch auf mehrere Durchläufe – niedrig, mittel oder hoch – verteilt, um den Kompromiss zwischen Antwortlatenz und Analysetiefe zu optimieren.

Trainingsdaten und -skala

- Grok 3: Laut xAI wurde Grok 3 über mehrere Wochen auf etwa 200,000 GPUs trainiert und umfasste eine Mischung aus Text im Webmaßstab, Code-Repositories und kuratierten Multimedia-Datensätzen, um sowohl sprachliches als auch visuelles Verständnis zu ermöglichen.

- o3: Das Training von o3 basiert auf dem umfangreichen Korpus an Web- und lizenzierten Datensätzen von OpenAI und beinhaltete auch verstärktes Lernen durch menschliches Feedback (RLHF), das speziell auf anspruchsvolle logische Denkaufgaben abgestimmt ist. Obwohl OpenAI keine Angaben zur GPU-Anzahl gemacht hat, betonen die Versionshinweise die effiziente Skalierung zur Unterstützung einer API-Ebene für Forscher und Unternehmenskunden.

Multimodale Fähigkeiten

- Grok 3: Die Betaversion kündigte Funktionen zur Bildgenerierung und umfassenden Suche an, was darauf schließen lässt, dass xAI ein einheitliches Modell anstrebt, das in der Lage ist, neben Text auch visuelle Inhalte zu verstehen und zu erstellen.

- o3: Unterstützt die vollständige Tool-Integration und ermöglicht nativ verkettete Aufrufe der Bild-, Codeausführungs- und Wissensdatenbank-APIs von OpenAI und bietet so einen modularen Ansatz für Multimodalität anstelle eines monolithischen All-in-One-Modells.

Modellskalierung, Rechenzuweisung und Argumentationsdurchläufe

Grok 3 verspricht „zehnmal mehr Rechenleistung“ als Grok 10 und nutzt groß angelegtes Reinforcement Learning, um iterative Fehlerkorrekturen über Sekunden oder Minuten hinweg zu ermöglichen. Die Ergebnisse werden über Consensus_@2 aggregiert, um die Genauigkeit zu verbessern. Dieser Ansatz ähnelt Ensemble-Methoden: Es werden 64 mögliche Antworten generiert und die am häufigsten vorkommenden ausgewählt. O64 hingegen integriert die Denkkette als internen Planungsschritt. Dadurch wird externes Sampling vermieden, die interne Rechenleistung pro Token erhöht und die Argumentationstiefe von O3 dynamisch angepasst: Einfachere Abfragen erfordern weniger Denkschritte, während komplexe Eingabeaufforderungen längere interne Überlegungen auslösen.

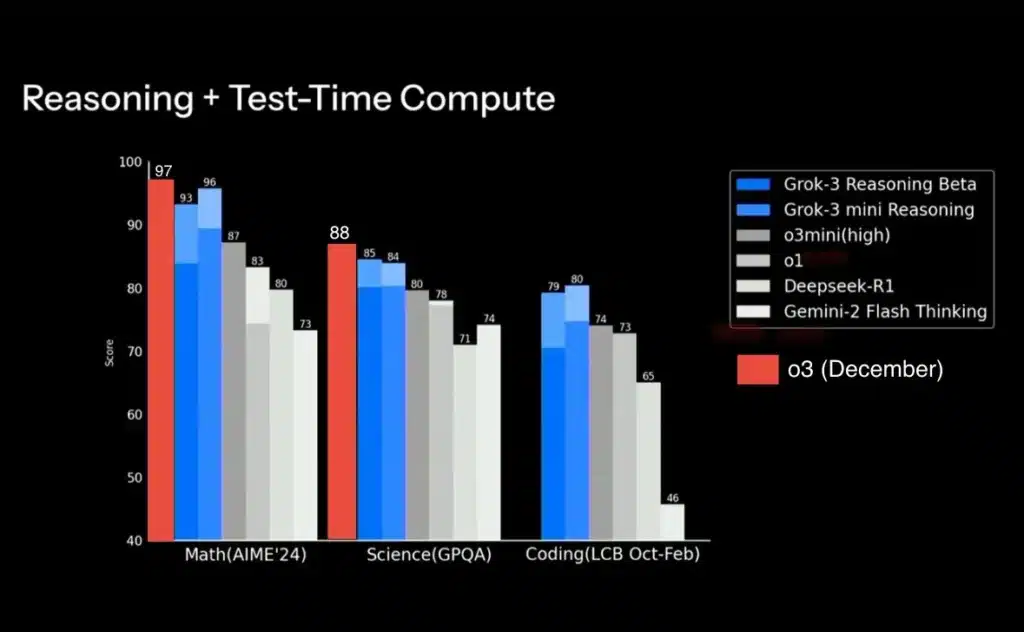

Welches Modell bietet die bessere Benchmark-Leistung?

Akademische und Programmier-Benchmarks

Beim AIME 2025-Test zum mathematischen Denken erreichte die „consensus@3“-Methode von Grok 64 eine Genauigkeit von 89.2 % und lag damit knapp vor O3-mini-high mit 87.3 % in derselben Prüfung. Bei Programmieraufgaben erreichte O3 eine Codeforces-Elo von 2727 und übertraf damit sowohl Grok 3 (geschätzte Elo ~2500) als auch O3-mini (Elo ~2300).

Reale Benutzerpräferenzen und Adversarial-Tests

xAI meldet einen Chatbot Arena Elo von 1402 für Grok 3 – getestet gegen menschliche und KI-Gegner – und übertrifft damit den Wert von Grok 2 (1203) von x.ai. Interne Evaluierungen von OpenAI zeigen, dass O3 in Vergleichsstudien gegenüber O91 eine Nutzerzufriedenheit von 1 % erreicht, mit deutlichen Verbesserungen bei der „Erklärungstiefe“ von OpenAI. Unabhängige Audits haben jedoch die Benchmark-Methodik von xAI in Frage gestellt, da sie die Vorteile der Konsensstichprobenerhebung von Grok 3 ohne vergleichbare Varianten für O3 überbewertet. Dies unterstreicht die Notwendigkeit standardisierter Evaluierungsprotokolle.

In welchen realen Anwendungen zeichnen sich diese Modelle aus?

Über Benchmarks hinaus verdeutlichen reale Aufgaben, wie jedes Modell branchenübergreifend Wert schaffen kann.

Kreative und Forschungs-Workflows

- Grok 3: Erste Rezensenten lobten die „Deep Search“-Funktion, die wissenschaftliche Nischenreferenzen aufdeckt und detaillierte Gliederungen für anspruchsvolle Inhalte wie technische Dokumente und kreative Schreibanregungen generiert. Die integrierte Bildgenerierung ermöglicht darüber hinaus nahtlose Ideenfindungszyklen durch die Kombination von Text und Bildmaterial.

- o3: Entwickler nutzen das Multi-Pass-Reasoning, um Prototypen komplexer Softwaremodule zu erstellen, Codefragmente zu debuggen und Datenvisualisierungen über verkettete Aufrufe zu generieren – und so durchgängige Forschungsabläufe zu optimieren, ohne die API-Umgebung zu verlassen.

Wissenschaftliche und laborbasierte Aufgaben

- Grok 3: Während die Betaversion von xAI noch nicht umfassend im Labor getestet wurde, ist der verbesserte Reasoning-Kern vielversprechend für die Hypothesengenerierung und Literaturrecherche und könnte den Zeitaufwand der Wissenschaftler für das vorläufige Data Mining reduzieren.

- o3: O3 hat sich in der kontrollierten Virologie-Fehlerbehebung bewährt und kann bei der Protokollgestaltung, Fehleranalyse und Dateninterpretation unterstützen und fungiert effektiv als virtueller Laborassistent. Organisationen müssen jedoch strenge Governance-Regeln implementieren, um Biosicherheitsrisiken zu minimieren.

Welche Ökosysteme und Integrationen fördern die Akzeptanz?

Grok 3: X-Integration und Echtzeit-Einblicke

Grok 3 ist eng mit den Premium+- und SuperGrok-Versionen von X verknüpft und bietet In-App-Chatbot-Erlebnisse, Vorschauen im Sprachmodus und Enterprise-API-Zugriff über docs.x.ai. DeepSearch und bald auch DeeperSearch ermöglichen es Fachleuten, soziale Stimmungen, Rechtsdokumente oder Finanzdaten in Echtzeit direkt abzufragen, ohne X verlassen zu müssen. Lücken in der Inhaltsmoderation haben jedoch zu Kontroversen geführt, wenn Grok 3 Fehlinformationen oder anstößige Inhalte ausgibt. xAI weist daraufhin, dass künftige Schutzmaßnahmen eingeführt werden müssen.

O3: Plattformübergreifende und entwicklerzentrierte Bereitstellung

OpenAI hat O3 über ChatGPT (Plus, Pro, Enterprise) und API-Endpunkte sowie Integrationen mit Microsoft Azure und GitHub Copilot bereitgestellt. Entwickler nutzen die O3-Denkkette über SDK-Flags und ermöglichen so selektive Reasoning-Durchläufe pro Anwendungsfall. Die kostenlose Verfügbarkeit von O3-mini für alle ChatGPT-Nutzer (mit Ratenlimits) vereinfacht den Zugriff, während Pro-Abonnenten die „hohe“ Reasoning-Stufe freischalten. Datei- und Bild-Uploads erweitern die Anwendbarkeit von O3 für die Dokumentenanalyse und visuelle Frage- und Antwortbearbeitung.

Wie schneiden die Preismodelle im Vergleich ab?

Die modellzentrierte Preisgestaltung von xAI

Die Enterprise-API von Grok 3 wurde im April 3 für 15 US-Dollar pro Million Input-Token und 2025 US-Dollar pro Million Output-Token eingeführt, mit Rabatten bei größeren Mengen. Grok 3 mini wird zu etwa der Hälfte dieser Preise angeboten und ist für Projekte mit geringerem Budget gedacht. X Premium+-Nutzer zahlen 40 US-Dollar pro Monat für vorrangigen Zugriff, während SuperGrok-Abonnenten einen nicht genannten Aufpreis für „unbegrenzte“ Grok-Abfragen zahlen.

Die abgestufte Zugriffsstrategie von OpenAI

OpenAI bündelt O3-mini in den ChatGPT-Tarifen Plus (20 $/Monat) und Pro (30 $/Monat): Plus-Nutzer erhalten mittleres Reasoning-Niveau, Pro schaltet High-Level-Niveau ohne zusätzliche Kosten frei. O3-API-Aufrufe kosten 6 $ pro Million Token – das Doppelte des O1-Tarifs, aber die Hälfte des Ausgabe-Token-Preises von Grok 3. Dies spiegelt OpenAIs Engagement für ein ausgewogenes Verhältnis von Kosten und Leistung wider. Dieser abgestufte Ansatz vereinfacht die Budgetierung für Startups und Forscher, allerdings auf Kosten der feingranularen Kontrolle über die Reasoning-Ebenen, die xAI bietet.

Grok 3 vs. O3: Welches sollten Sie wählen?

Leistungsvergleich: Geschwindigkeit, Skalierbarkeit und Zuverlässigkeit

| Leistungsmessung | o3 | Grok 3 |

|---|---|---|

| Reaktionszeit | Durchschnittlich 120 ms unter Last | Durchschnittlich 90 ms unter Last |

| Skalierbarkeit | Horizontale Skalierung mit Kubernetes | Vertikale Skalierung mit optimiertem Caching |

| Zuverlässigkeit der Betriebszeit | 99.95% SLA | 99.9% SLA |

| Durchsatz (Anfragen/Sek.) | 5000+ | 4500+ |

| Latenz der Datenverarbeitung | 150 ms (Batch-Modus) | 80 ms (Echtzeit-Streaming) |

Die Auswahl zwischen Grok 3 und o3 hängt von spezifischen Anforderungen, strategischen Prioritäten und der Risikotoleranz ab.

Anwendungsfallorientierte Empfehlungen

- Für tiefgehende Recherche und multimodale Kreativität: Die integrierten Bild- und Tiefensuchfunktionen von Grok 3 machen es ideal für Content-Agenturen, Designstudios und akademische Einrichtungen, die einen All-in-One-Skizzenblock für Ideenfindung und Prototyping suchen.

- Für Enterprise-Workflows und Toolchains: Die Agenten-Tool-Integration und der sofortige API-Zugriff von o3 eignen sich für Softwareteams, Finanzanalysten und wissenschaftliche Labore, die eine modulare, zuverlässige Erweiterung innerhalb bestehender Pipelines benötigen.

Verwenden Sie Grok 3 und O3 in CometAPI

CometAPI bieten einen Preis weit unter dem offiziellen Preis an, um Ihnen bei der Integration zu helfen O3 API (Modellname: o3/ o3-2025-04-16) und Grok 3 API (Modellname: grok-3;grok-3-latest;), und Sie erhalten 1 $ auf Ihr Konto, nachdem Sie sich registriert und angemeldet haben! Willkommen bei der Registrierung und beim Ausprobieren von CometAPI.

Erkunden Sie zunächst die Funktionen des Modells im Playground und konsultieren Sie die API-Leitfaden Detaillierte Anweisungen finden Sie unter „Verifizierung der Organisation“. Beachten Sie, dass Entwickler vor der Verwendung des Modells möglicherweise ihre Organisation überprüfen müssen.

Die Preise in CometAPI sind wie folgt strukturiert:

| Kategorie | O3 API | Grok 3 |

| API-Preise | o3/ o3-2025-04-16 Eingabe-Token: 8 $ / M Token Ausgabe-Token: 32 $/M Token | grok-3;grok-3-latest Eingabe-Token: 1.6 $ / M Token Ausgabe-Token: 6.4 $ / M Token grok-3-fast Eingabe-Token: 4 $ / M Token Ausgabe-Token: 20 $ / M Token |

Fazit

Grok 3 und O3 verkörpern die aktuelle Grenze des KI-Denkens. Grok 3 setzt auf reine Rechenleistung, offene Integration mit sozialen Medien und ungefilterte Ergebnisse und spricht damit Power-User und Unternehmen an, die Echtzeit-Einblicke suchen. O3 hingegen verkörpert einen maßvollen Ansatz für integrierte Denkprozesse, breite Plattformunterstützung und gestaffelte Preise, die eine breite Akzeptanz fördern. Letztendlich hängt die Wahl von den Projektanforderungen ab: Grok 3 zeichnet sich durch dynamische, datenreiche Umgebungen aus, während O3 Konsistenz, Sicherheit und ein ausgereiftes Ökosystem bietet. Da sowohl xAI als auch OpenAI ihre Modelle verfeinern, können Anwender kontinuierliche Fortschritte bei Genauigkeit, Effizienz und Multimodalität erwarten, die die nächste Generation von KI-Assistenten prägen.