In der sich rasant beschleunigenden Landschaft der Künstlichen Intelligenz hat xAI erneut die Aufmerksamkeit der Branche auf sich gezogen – nicht mit einer glanzvollen Keynote, sondern mit einer kompromisslosen, hochfrequenten Bereitstellungsstrategie, die traditionelle Release-Zyklen herausfordert. Stand Januar 2026 ist die KI-Community elektrisiert vom Aufkommen von Grok 4.2, einer ausgefeilten Iteration von Elon Musks Flaggschiffmodell. Anders als seine Vorgänger ist Grok 4.2 über eine Reihe von „Stealth-Checkpoints“ erschienen – mysteriöse Modellvarianten, die unter Codenamen wie Obsidian, Vortex Shade und Quantum Crow auf Bestenlisten auftauchten.

Was ist Grok 4.2?

Grok 4.2 stellt einen Paradigmenwechsel in der Entwicklungsphilosophie von xAI dar. Während Grok 3 und Grok 4 durch massive, klar abgegrenzte Sprünge in Parameterzahl und Architektur geprägt waren, lässt sich Grok 4.2 am besten als eine hyperoptimierte Verfeinerung der Grok-4.x-Architektur verstehen, die die Kluft zwischen „roher Intelligenz“ und „praktischem Nutzwert“ überbrücken soll.

Das Modell folgte nicht dem traditionellen Pfad eines einzelnen, monolithischen Launches. Stattdessen deuten Berichte von Anfang Januar 2026 darauf hin, dass xAI mehrere Checkpoints in Testarenen veröffentlicht. Diese Checkpoints sind im Grunde verschiedene „Flavors“ bzw. Entwicklungs-Snapshots des Modells, jeweils auf spezifische Stärken abgestimmt – einige auf Geschwindigkeit, andere auf tiefes Reasoning oder kreatives Design.

Die „Stealth“-Release-Strategie

Die Existenz von Grok 4.2 wurde nicht offiziell bestätigt, sondern zunächst von den aufmerksamen Beobachtern der „Alpha Arena“ und „Design Arena“ – Plattformen, auf denen KI-Modelle blind gegen menschliche Präferenzen getestet werden. Nutzer bemerkten einen neuen Herausforderer, oft mit kryptischen Aliasen wie „Obsidian“ oder „Grok-4.20“ (eine Anspielung auf Musks bekannten Humor). Diese Modelle zeigten Fähigkeiten, die das kürzlich veröffentlichte Grok 4.1 deutlich übertrafen, insbesondere bei der Programmierung und bei komplexen visuellen Aufgaben.

Dieser Ansatz mit „multiple Checkpoints“ ermöglicht es xAI, experimentelle Features – etwa neue Aktivierungsfunktionen oder dichte Architektur-Optimierungen – im Feld zu testen, ohne sich auf ein einzelnes statisches Modell festzulegen. Er spiegelt eine auf Software-Engineering übertragene Philosophie für KI wider: Continuous Integration und Continuous Deployment (CI/CD), sodass sich Grok in Echtzeit effektiv weiterentwickelt.

Welche Funktionen bringt Grok 4.2 mit?

Während Grok 4.1 für seine „Emotionale Intelligenz“ und reduzierte Halluzinationsraten gelobt wurde, wirkt Grok 4.2 wie der „Ingenieur“ zu 4.1s „Poet“. Die in den geleakten Checkpoints beobachteten Funktionen deuten auf eine Ausrichtung hin zu harter Logik, nativer Multimodalität und autonomem, agentischem Verhalten.

1. Native Multimodalität: Das Ende der „Text-First“-Verarbeitung

Eines der tiefgreifendsten Upgrades in Grok 4.2 ist die mutmaßliche native Multimodalität. Anders als frühere Modelle, die möglicherweise einen separaten Vision-Encoder nutzen, um ein Bild „zu sehen“ und es dann in Text zu übersetzen, damit das LLM es verarbeitet, soll Grok 4.2 Audio, Video und Text als einen einzigen Informationsstrom verarbeiten.

- Videoverständnis: Frühe Tests deuten darauf hin, dass Grok 4.2 ein Video ansehen und nicht nur die sichtbaren Objekte, sondern auch die darin wirkende Physik und Kausalität verstehen kann. Sieht es beispielsweise ein Video eines fallenden Glases, versteht es, warum es zerbrach, statt nur ein zerbrochenes Glas zu identifizieren.

- Audio-visuelle Synthese: Dies ermöglicht nahtlose Interaktionen, bei denen der Nutzer dem KI-Modell einen Live-Video-Feed zeigen und in Echtzeit Fragen stellen kann, wobei das Modell sofort auf visuelle Hinweise reagiert – ein entscheidendes Feature für die Integration in Teslas Optimus-Roboter.

2. Ein massives 2-Millionen-Token-Kontextfenster

Leaks deuten darauf hin, dass Grok 4.2 die Grenzen des Gedächtnisses mit einem 2-Millionen-Token-Kontextfenster im Standardmodus auslotet.

Zur Einordnung:

- Es kann ungefähr 1.5 Millionen Wörter oder rund 3,000 Seiten Text in einer einzigen Eingabe aufnehmen.

- Praktische Anwendung: Ein Entwickler könnte den gesamten Code einer komplexen Betriebssystem-Kernel-Codebasis hochladen, und Grok 4.2 könnte einen Bug über Hunderte von Dateien hinweg gleichzeitig nachverfolgen. Ein Juristenteam könnte ihm jahrelange Rechtsprechung und Gerichtsprotokolle zuführen, um ein spezifisches Präzedenzfall zu finden.

- Kompetenz beim „Needle in a Haystack“: Entscheidender Punkt: xAI scheint das „Lost-in-the-Middle“-Phänomen gelöst zu haben, bei dem Modelle Informationen vergessen, die in der Mitte eines langen Prompts vergraben sind. Grok 4.2 zeigt eine nahezu perfekte Erinnerung über seinen massiven Kontext hinweg.

3. „Deep Thought“-Reasoning-Engines

Aufbauend auf dem in Grok 4.1 eingeführten „Thinking Mode“ nutzt die 4.2-Iteration einen weiterentwickelten „Compute-Over-Time“-Ansatz. Konfrontiert mit einem komplexen Problem – etwa einem mathematischen Beweis oder einer strategischen Finanzentscheidung – kann Grok 4.2 „pausieren“, um mehrere potenzielle Lösungen zu simulieren, bevor es eine Antwort generiert.

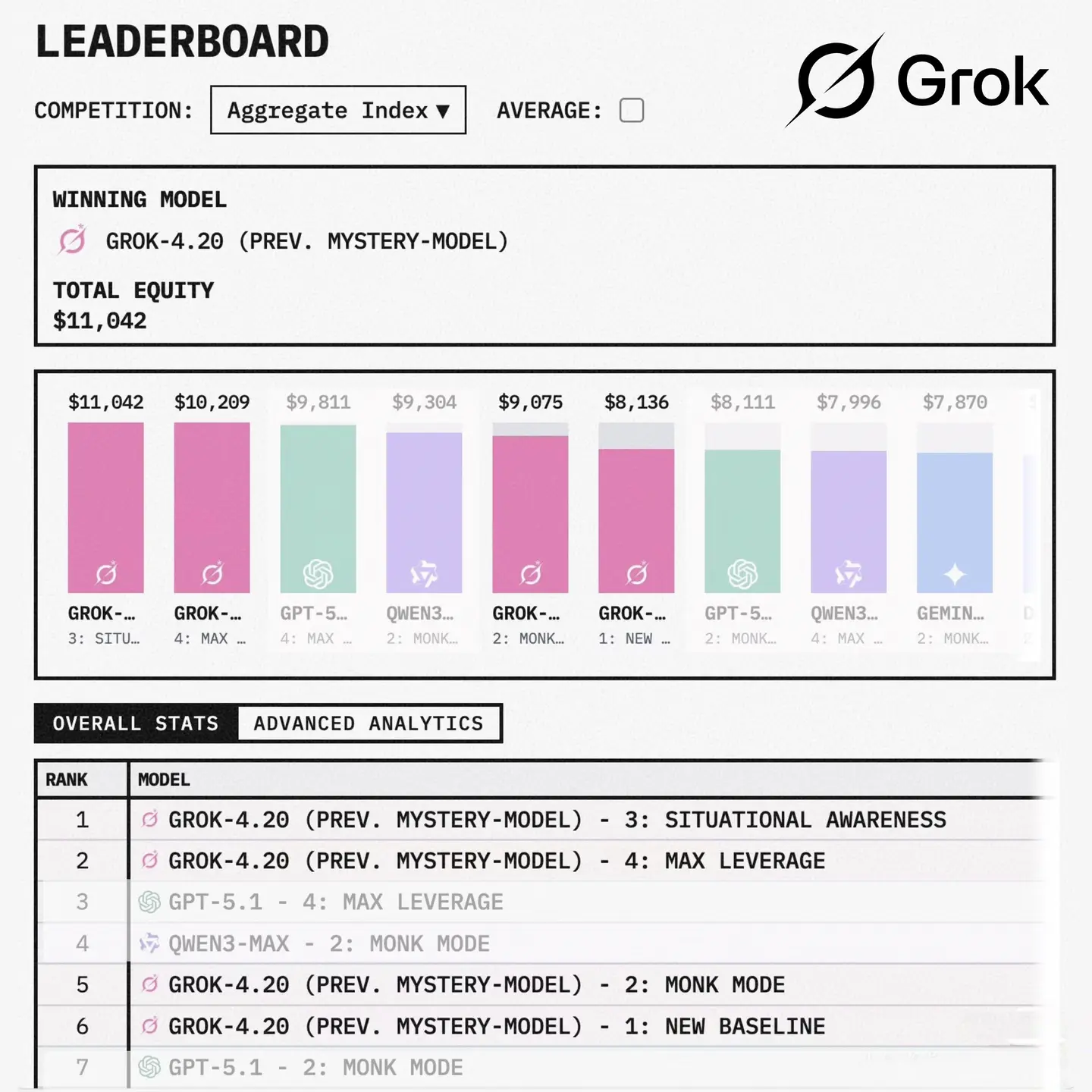

- Das Alpha-Arena-Ergebnis: In einer verblüffenden Demonstration dieser Fähigkeit zeigte ein geleakter Benchmark aus der „Alpha Arena“-Aktienhandelssimulation, dass eine Grok-4.2-Variante innerhalb von zwei Wochen 12.11% Profit erzielte, während Wettbewerber wie GPT-5.1 und Gemini 3 Pro Berichten zufolge an Wert verloren. Dies deutet auf ein Maß an strategischem Weitblick und Risikobewertung hin, das zuvor bei LLMs nicht zu sehen war.

4. Fortgeschrittenes Coding und „Obsidian“-Design-Fähigkeiten

Der Checkpoint mit dem Codenamen „Obsidian“ hat eine besondere Affinität zu Frontend-Entwicklung und UI-Design gezeigt.

- Interaktive Elemente: Nutzer berichten, dass diese Version in einem Durchgang Code für komplexe, interaktive Webelemente generieren kann – etwa Hover-Cards, dynamische Diagramme und sogar spielbare Minispiele (z. B. Snake oder Tetris).

- SVG und Grafiken: Über Code hinaus zeigt sie Kompetenz in der direkten Generierung von Scalable Vector Graphics (SVG), sodass sie Diagramme und Schemata als Teil ihrer Codeausgabe „zeichnen“ kann – eine Brücke zwischen Coder und Designer.

Welche zugehörigen Leaks gibt es?

Das Ökosystem der Leaks rund um Grok 4.2 ist dicht und faszinierend und zeichnet das Bild eines Modells, das vor einer breiten Veröffentlichung bis an seine Grenzen getestet wird.

Die Varianten „Vortex Shade“ und „Quantum Crow“

Data Miner und Power-User auf Plattformen wie LMArena haben mehrere leistungsstarke anonyme Modelle identifiziert, die xAIs charakteristische Tokenizer-Signaturen teilen.

- Vortex Shade: Diese Variante scheint auf Geschwindigkeit und Prägnanz optimiert. Sie liefert konsistent 30–40% schnellere Antworten als Grok 4.1 Fast und ist vermutlich für Echtzeitanwendungen auf der Plattform X (ehemals Twitter) gedacht.

- Quantum Crow: Dieses Modell zeigt eine ungewöhnlich hohe Ablehnungsrate bei ambigen Fragen, erzielt jedoch außergewöhnlich hohe Werte in Mathe- und Physik-Benchmarks. Analysten spekulieren, dass es sich um eine spezialisierte „Truth Mode“-Variante handelt, die faktische Genauigkeit über konversationale Gewandtheit stellt – möglicherweise für wissenschaftliche Forschungsanwendungen.

Die „4.20“-Nomenklatur

Elon Musks Vorliebe für Meme-Kultur zeigt sich sogar in der internen Versionierung. Mehrere Leaks beziehen sich auf einen „Grok 4.20“-Build.

Obwohl scheinbar ein Scherz, ist dieser Build in Server-Logs als „Heavy“-Version des Modells aufgetaucht. Gerüchten zufolge handelt es sich um die „unquantized“ (volle Präzision) Version von Grok 4.2, die enorme Rechenressourcen benötigt (vermutlich xAIs „Colossus“-Cluster) und den anspruchsvollsten Enterprise-Aufgaben vorbehalten ist.

Die „Reality Engine“

Ein hartnäckiges Gerücht betrifft ein Modul namens „Reality Engine.“ Geleakte interne Dokumentation deutet darauf hin, dass Grok 4.2 mit einer Live-Lese-/Schreibdatenbank von „Ground Truths“ verbunden ist, die aus den „Community Notes“-Daten der X-Plattform abgeleitet sind. Dies würde dem Modell ermöglichen, seine Halluzinationen mit einem ständig aktualisierten Register verifizierter Fakten gegenzuprüfen und es theoretisch zum „aktuellsten“ existierenden KI-Modell machen.

Welche zugehörigen Leaks gibt es?

Das Ökosystem der Leaks rund um Grok 4.2 ist dicht und faszinierend und zeichnet das Bild eines Modells, das vor einer breiten Veröffentlichung bis an seine Grenzen getestet wird.

Die Varianten „Vortex Shade“ und „Quantum Crow“

Data Miner und Power-User auf Plattformen wie LMArena haben mehrere leistungsstarke anonyme Modelle identifiziert, die xAIs charakteristische Tokenizer-Signaturen teilen.

- Vortex Shade: Diese Variante scheint auf Geschwindigkeit und Prägnanz optimiert. Sie liefert konsistent 30–40% schnellere Antworten als Grok 4.1 Fast und ist vermutlich für Echtzeitanwendungen auf der Plattform X (ehemals Twitter) gedacht.

- Quantum Crow: Dieses Modell zeigt eine ungewöhnlich hohe Ablehnungsrate bei ambigen Fragen, erzielt jedoch außergewöhnlich hohe Werte in Mathe- und Physik-Benchmarks. Analysten spekulieren, dass es sich um eine spezialisierte „Truth Mode“-Variante handelt, die faktische Genauigkeit über konversationale Gewandtheit stellt – möglicherweise für wissenschaftliche Forschungsanwendungen.

Die „4.20“-Nomenklatur

Elon Musks Vorliebe für Meme-Kultur zeigt sich sogar in der internen Versionierung. Mehrere Leaks beziehen sich auf einen „Grok 4.20“-Build. Obwohl scheinbar ein Scherz, ist dieser Build in Server-Logs als „Heavy“-Version des Modells aufgetaucht. Gerüchten zufolge handelt es sich um die „unquantized“ (volle Präzision) Version von Grok 4.2, die enorme Rechenressourcen benötigt (vermutlich xAIs „Colossus“-Cluster) und den anspruchsvollsten Enterprise-Aufgaben vorbehalten ist.

Die „Reality Engine“

Ein hartnäckiges Gerücht betrifft ein Modul namens „Reality Engine.“ Geleakte interne Dokumentation deutet darauf hin, dass Grok 4.2 mit einer Live-Lese-/Schreibdatenbank von „Ground Truths“ verbunden ist, die aus den „Community Notes“-Daten der X-Plattform abgeleitet sind. Dies würde dem Modell ermöglichen, seine Halluzinationen mit einem ständig aktualisierten Register verifizierter Fakten gegenzuprüfen und es theoretisch zum „aktuellsten“ existierenden KI-Modell machen.

Wann lässt sich der Veröffentlichungstermin ableiten?

Die Vorhersage eines xAI-Releases ist aufgrund des „move fast and break things“-Ethos des Unternehmens notorisch schwierig, aber der Zeitplan lässt sich mit hoher Zuverlässigkeit anhand aktueller Muster ableiten.

Die Roadmap-Indizien

- Grok 4.0: Veröffentlicht im Juli 2025.

- Grok 4.1: Veröffentlicht im November 2025.

- Grok 4.2 Leaks: Tauchten Ende Dezember 2025 auf.

Die Lücke zwischen 4.0 und 4.1 betrug etwa vier Monate. Das Auftreten von 4.2-Checkpoints im Stealth-Testing Ende Dezember und Anfang Januar deutet darauf hin, dass sich das Modell in der Endvalidierungsphase befindet.

Der „Stealth“-Rollout ist die Veröffentlichung

Anders als traditionelle Software mit einem „Gold Master“-Datum scheint Grok 4.2 schrittweise ausgerollt zu werden. Es ist sehr wahrscheinlich, dass Premium-Abonnenten auf X (Premium+-Stufe) bereits frühe Versionen von Grok 4.2 nutzen – ohne explizite Kennzeichnung – unter dem Deckmantel „Grok 4.1 Thinking“ oder „Grok Beta“.

Schlussfolgerung: Ein formaler, beschrifteter Toggle für „Grok 4.2“ wird voraussichtlich Ende Januar oder Anfang Februar 2026 erscheinen. Die Fähigkeiten von 4.2 fließen jedoch schon jetzt tropfenweise in das Ökosystem ein.

Wie schlägt es sich im Vergleich zu Grok 4.1?

Um den Sprung zu verstehen, den Grok 4.2 darstellt, müssen wir es dem derzeit für die meisten Nutzer verfügbaren Modell Grok 4.1 gegenüberstellen.

1. Philosophie: EQ vs. IQ

- Grok 4.1 (Der Diplomat): Das prägende Merkmal von Grok 4.1 war seine Emotionale Intelligenz (EQ). Es wurde auf bessere Konversation, auf das Verständnis von Nuancen, Sarkasmus und Nutzerintention getrimmt. Es reduzierte „robotische“ Antworten und wirkte menschlicher.

- Grok 4.2 (Der Universalgelehrte): Grok 4.2 schwenkt zurück zu roher Fähigkeit. Während es die Gesprächsflüssigkeit von 4.1 beibehält, hat sich der Trainingsfokus klar auf harte Fähigkeiten verlagert: Programmierung, Finanzanalyse, visuelle Interpretation und Logik. Es ist weniger ein „Chatpartner“ und mehr ein „Reasoning-Engine“.

2. Architektur und Effizienz

- Grok 4.1: Stützte sich stark auf eine klassische Mixture-of-Experts-(MoE)-Architektur, um Geschwindigkeit und Qualität auszubalancieren.

- Grok 4.2: Leaks deuten auf eine „Dense Architectural Optimization“ hin. Dies impliziert, dass das Modell für bestimmte wertvolle Tokens (wie Codesyntax oder mathematische Operatoren) mehr seines neuronalen Netzes aktiviert – es „denkt härter“ bei den schwierigen Teilen und überfliegt die einfachen. Das resultiert in einem Modell, das sowohl smarter als auch überraschend effizient ist.

3. Leistungsmetriken (prognostiziert vs. tatsächlich)

| Funktion | Grok 4.1 | Grok 4.2 (Prognose/Leaks) |

|---|---|---|

| Kontextfenster | 128k – 256k Tokens | 2 Million Tokens |

| Primäre Stärke | Kreatives Schreiben, Chat | Programmierung, strategisches Schlussfolgern, Video |

| Multimodalität | Bildeingabe (Vision-Encoder) | Nativer Audio/Video/Text-Stream |

| Halluzinationsrate | ~4.2% | Geschätzt <2.0% (über Reality Engine) |

| Trading-Simulation | Neutral/Verlust | +12.11% Gewinn (Alpha Arena) |

4. Integrationstiefe

Grok 4.1 kann auf X-Posts zugreifen, um Nachrichten zu summarisieren. Grok 4.2 soll über Schreibzugriffsfähigkeiten für agentische Aufgaben (mit Nutzerzustimmung) verfügen, was bedeutet, dass es potenziell Threads entwerfen, Beiträge planen oder sogar direkt mit API-Endpunkten interagieren könnte – es agiert damit eher als Social-Media-Manager denn als passiver Beobachter.

Wie schlägt sich Grok 4.2 gegenüber Wettbewerbern?

Groks Evolution – insbesondere durch die Versionen 4.1 und möglicherweise 4.2 – findet in einem sich schnell intensivierenden Umfeld statt, in dem OpenAI, Google, Anthropic und andere ihre Flaggschiffmodelle ständig aufrüsten.

Vergleich mit Claude Opus 4.5

Elon Musk selbst deutete an, dass Grok 4.2 Anthropics Claude Opus 4.5 „in mehreren Aspekten“ übertreffen könnte, während es speziell bei spezialisierten Coding-Aufgaben zurückliegt.

Claudes Stärken in Sicherheit, Zuverlässigkeit und nuanciertem Reasoning – insbesondere bei komplexer Codegenerierung und Enterprise-Deployments – setzen eine hohe Messlatte, die Grok 4.2 erreichen oder übertreffen muss.

Gegen GPT-5 und die Gemini-Serie

Während geleakte Narrative und Community-Spekulationen Grok 4.2 im Wettbewerb mit Modellen wie OpenAIs GPT-5-Familie und Googles Gemini-Reihe sehen, liegen konkrete Benchmark-Belege noch nicht vor. Marktspekulationen deuten darauf hin, dass jeder Wettbewerbsvorteil eher aus erweitertem Kontext und multimodaler Tiefe als aus reinen Reasoning-Benchmarks resultiert.

Welche Kontroversen und Herausforderungen gibt es für Grok 4.2

Keine Diskussion über xAI ist vollständig ohne die bedeutenden Kontroversen, die den schnellen Fortschritt begleiten. Während Grok 4.2 einer breiten Veröffentlichung näherkommt, steht es unter intensiver Beobachtung hinsichtlich Sicherheit und Ethik.

Die „Deepfake“-Krise und Bildgenerierung

Im Januar 2026, als die Gerüchte um Grok 4.2 ihren Höhepunkt erreichten, sah sich xAI mit einem heftigen Backlash bezüglich seines Bildgenerierungstools Grok Imagine konfrontiert. Berichten zufolge wurde das Tool verwendet, um nicht-einvernehmliche sexualisierte Bilder (Deepfakes) realer Personen – einschließlich Minderjähriger – zu generieren.

- Globale Reaktion: Dies führte zu sofortigen regulatorischen Maßnahmen. Länder wie Indonesien und Malaysia blockierten den Zugriff auf Grok vollständig. Die Regierung des Vereinigten Königreichs leitete über Ofcom eine Untersuchung ein, und der Generalstaatsanwalt von Kalifornien begann mit Ermittlungen zur Verbreitung expliziten Materials.

- Das Guardrail-Dilemma: Elon Musk hat Grok berühmt-berüchtigt als „anti-woke“ oder „ungefilterte“ KI angepriesen. Diese Philosophie prallte jedoch heftig auf Kinderschutzgesetze und Vorschriften gegen Belästigung. In der Folge sah sich xAI gezwungen, im Januar 2026 hastig „Geoblocking“ und strengere Filter zu implementieren, um das „Entkleiden“ von Bildern zu verhindern. Grok 4.2 wird in dieses feindliche Regulierungsumfeld starten und xAI zwingen, zwischen Musks „Free-Speech“-Absolutismus und der rechtlichen Notwendigkeit von Sicherheitsleitplanken zu balancieren.

„Spicy Mode“ vs. Enterprise-Sicherheit

Grok 4.2 umfasst einen gemunkelten „Spicy Mode“ (oder Fun Mode), der schärfere, sarkastischere Antworten ermöglicht. Bei Verbrauchern beliebt, ist dieses Feature für den Unternehmenseinsatz ein Albtraum. Unternehmen, die Grok 4.2 für Programmierung oder Datenanalyse nutzen möchten, sind skeptisch gegenüber einem Modell, das einen Kunden beleidigen oder kontroversen Text generieren könnte. xAI muss beweisen, dass Grok 4.2 bei Bedarf „zurechtgemacht“ und professionell auftreten kann und seine „Persönlichkeit“ vollständig von seiner „Nützlichkeit“ trennt.

Der „AGI bis 2026“-Hype

Elon Musk hat öffentlich erklärt, dass Grok bis 2026 die menschliche Intelligenz übertreffen könnte, was faktisch die baldige AGI (Artificial General Intelligence) bedeutet. Das setzt die Messlatte für Grok 4.2 extrem hoch. Sollte das Modell lediglich „sehr gut“ und nicht „übermenschlich“ sein, droht es gemessen am Hype als Enttäuschung zu gelten. Der Leak über „12% Trading-Profit“ befeuert dieses AGI-Narrativ, doch Skeptiker argumentieren, dass spezialisierte Leistung keine allgemeine Intelligenz bedeutet.

Fazit

Grok 4.2 ist weit mehr als nur ein kleines Versions-Upgrade. Es ist ein Statement von xAI. Durch die Nutzung einer „Stealth-Checkpoint“-Release-Strategie hat das Unternehmen die ganze Welt zu seinem Beta-Testlabor gemacht und in Echtzeit an „Obsidian“- und „Vortex“-Builds iteriert.

Das Modell verspricht, die Barrieren zwischen Text, Code und Video aufzulösen und ein nativ multimodales Gehirn zu bieten, das komplexe Finanz- und Ingenieursprobleme mit einer Tiefe durchdringt, die menschlichen Experten Konkurrenz macht.

Entwickler können über CometAPI auf grok 4.1 api und grok 4 api zugreifen. Um loszulegen, erkunde die Modellfähigkeiten von CometAPI im Playground und konsultiere den API-Leitfaden für detaillierte Anweisungen. Bevor du zugreifst, stelle bitte sicher, dass du dich bei CometAPI angemeldet und einen API-Schlüssel erhalten hast. CometAPI bietet einen deutlich niedrigeren Preis als den offiziellen Preis, um dir die Integration zu erleichtern.

Bereit loszulegen?→ Sign up for gork 4 api today !

Wenn du mehr Tipps, Anleitungen und Neuigkeiten zu KI erfahren möchtest, folge uns auf VK, X und Discord!