Qwen2.5-Max stellt einen bedeutenden Fortschritt im Bereich groß angelegter Sprachmodelle dar und zeigt bemerkenswerte Fähigkeiten im Verständnis und in der Generierung natürlicher Sprache. Das vom Qwen-Team entwickelte Modell nutzt modernste Techniken, um in verschiedenen Benchmarks eine überragende Leistung zu erzielen.

Was ist Qwen2.5-Max?

Qwen2.5-Max ist ein hochmodernes, groß angelegtes Sprachmodell, das die Grenzen des Verständnisses und der Generierung natürlicher Sprache erweitert. Entwickelt mit einer Mixture-of-Experts (MoE)-Architektur, skaliert es Berechnungen effizient und bietet gleichzeitig überlegene Leistung in verschiedenen KI-Benchmarks. Das Modell wurde anhand eines umfangreichen Datensatzes von über 20 Billionen Token vortrainiert und gewährleistet so ein breites und tiefes Verständnis mehrerer Sprachen, Themen und Fachdisziplinen.

Hauptmerkmale von Qwen2.5-Max

- Mixture-of-Experts (MoE)-Architektur: Optimiert die Berechnung durch die Auswahl bestimmter Experten pro Abfrage und steigert so die Effizienz.

- Umfangreiches Vortraining: Trainiert anhand eines riesigen Datensatzes für besseres Verständnis und bessere Wissensdarstellung.

- Verbessertes Denken und Verständnis: Übertrifft andere Modelle bei der Lösung mathematischer Probleme, beim logischen Denken und bei Codierungsaufgaben.

- Feinabstimmung mit überwachtem und bestärkendem Lernen: Integriert Reinforcement Learning from Human Feedback (RLHF), um Antworten zu verfeinern und die Benutzerfreundlichkeit zu verbessern.

Wie funktioniert Qwen2.5-Max?

1. Mixture-of-Experts (MoE)-Architektur

Qwen2.5-Max verwendet ein Experten-Mix-System, das für jede Abfrage dynamisch eine Teilmenge neuronaler Expertennetzwerke auswählt. Dieser Ansatz gewährleistet hohe Effizienz und Skalierbarkeit, da nur relevante Experten für bestimmte Aufgaben aktiviert werden. Dies reduziert den Rechenaufwand bei gleichbleibender Genauigkeit.

2. Umfangreiches Vortraining

Das Modell wurde anhand eines vielfältigen Datensatzes trainiert, der verschiedene Bereiche umfasst, darunter Literatur, Programmierung, Wissenschaft und Umgangssprache. Dank dieses umfassenden Trainings kann Qwen2.5-Max Texte mit bemerkenswerter Flüssigkeit und kontextueller Genauigkeit verstehen und generieren.

3. Optimierung des überwachten und verstärkenden Lernens

Nach dem Vortraining wird Qwen2.5-Max mithilfe von menschlich markierten Daten und Reinforcement Learning from Human Feedback (RLHF) feinabgestimmt. Dies verbessert die Anpassung an menschliche Erwartungen und macht es für verschiedene Anwendungen zuverlässiger.

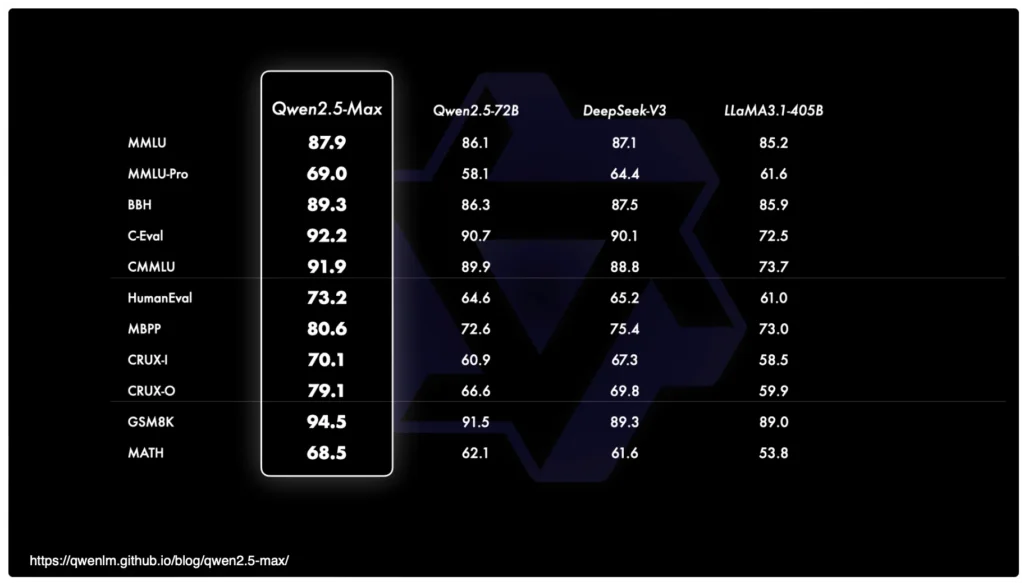

4. Benchmark-Leistung

Qwen2.5-Max hat führende KI-Modelle in mehreren branchenübliche Benchmarks übertroffen:

- Arena-Hard, LiveBench, LiveCodeBench und GPQA-Diamond: Erreicht in diesen KI-Bewertungsplattformen durchweg die Spitzenplätze.

- Mathematik und Programmierung: Nimmt den ersten Platz bei Herausforderungen im Bereich rechnerisches Denken und Codieren ein.

- Komplexe Aufgabenabwicklung: Erreicht den zweiten Platz bei der Bewältigung differenzierter und mehrstufiger Probleme.

So verwenden Sie Qwen2.5-Max

1. Zugriff auf Qwen2.5-Max

Qwen2.5-Max ist über mehrere Zugriffspunkte verfügbar. Nachfolgend finden Sie die detaillierten Schritte für den Zugriff:

Zugriff über die offizielle Website

Der schnellste Weg, Qwen2.5-Max kennenzulernen, ist über die Qwen-Chat Plattform. Dies ist eine webbasierte Schnittstelle, die es Ihnen ermöglicht, direkt in Ihrem Browser mit dem Modell zu interagieren – genau wie Sie ChatGPT in Ihrem Browser verwenden würden.

- Besuchen Sie die offizielle Qwen2.5-Max-Website.

- Registrieren Sie sich oder melden Sie sich mit Ihren Anmeldedaten an.

- Navigieren Sie zum Abschnitt „Erste Schritte“.

- Wählen Sie zwischen kostenlosem Zugriff (sofern verfügbar) oder Abonnements.

- Befolgen Sie die Onboarding-Anleitung, um mit der Verwendung des Modells zu beginnen.

Verwenden der Qwen2.5-Max-API

- Gehen Sie zur offiziellen Qwen-API-Dokumentationsseite.

- Melden Sie sich für einen API-Schlüssel an, indem Sie ein Konto registrieren.

- Melden Sie sich nach der Überprüfung an und rufen Sie Ihre API-Anmeldeinformationen ab.

- Verwenden Sie die API, indem Sie Anfragen mit der richtigen Authentifizierung an die angegebenen Endpunkte senden.

- Integrieren Sie die API mit Python, JavaScript oder einer beliebigen anderen Programmiersprache in Ihre Anwendungen.

Zugriff über Cloud-Plattformen

- Besuchen Sie einen Cloud-Anbieter, der Qwen 2.5-Max hostet, wie etwa Alibaba Cloud oder Hugging Face.

- Erstellen Sie ein Konto, falls Sie noch keins haben.

- Suchen Sie im Abschnitt „KI/ML“ nach „Qwen2.5-Max“.

- Wählen Sie das Modell aus und konfigurieren Sie Ihre Zugriffseinstellungen (Rechenleistung, Speicher usw.).

- Stellen Sie das Modell bereit und beginnen Sie mit der Verwendung über eine interaktive Umgebung oder API-Aufrufe.

Lokale Bereitstellung von Qwen2.5-Max

- Suchen Sie auf GitHub oder der offiziellen Website nach einer Open-Source- oder herunterladbaren Version.

- Stellen Sie sicher, dass Ihr System die Hardwareanforderungen (GPUs, Speicher, Speicherplatz) erfüllt.

- Befolgen Sie die Installationsanweisungen in der Dokumentation.

- Installieren Sie die erforderlichen Abhängigkeiten und konfigurieren Sie die Umgebung.

- Führen Sie das Modell lokal aus und testen Sie seine Funktionen.

Verwenden von CometAPI (KI-Plattformen von Drittanbietern)

CometAPI bietet einen Preis, der weit unter dem offiziellen Preis liegt, um Ihnen bei der Integration der Qwen 2.5 Max API zu helfen, und Sie erhalten nach der Registrierung und Anmeldung 1 $ auf Ihr Konto!

CometAPI bietet Zugriff auf über 500 KI-Modelle, darunter Open-Source- und spezialisierte multimodale Modelle für Chat, Bilder, Code und mehr. Die größte Stärke liegt in der Vereinfachung des traditionell komplexen Prozesses der KI-Integration. Registrieren Sie sich und erleben Sie CometAPI.

- Anmelden zu cometapi.comWenn Sie noch nicht unser Benutzer sind, registrieren Sie sich bitte zuerst

- Holen Sie sich den API-Schlüssel für die Zugangsdaten der Schnittstelle. Klicken Sie im persönlichen Center beim API-Token auf „Token hinzufügen“, holen Sie sich den Token-Schlüssel: sk-xxxxx und senden Sie ihn ab.

- Greifen Sie über die Weboberfläche, API oder Chatbot-Dienste auf Qwen2.5-Max (Modellname: qwen-max) zu.

- Verwenden Sie integrierte Tools, um Text und Code zu generieren oder Daten zu analysieren.

2. Praktische Anwendungen

- Konversations-KI: Wird für Chatbots und virtuelle Assistenten verwendet.

- Code-Unterstützung: Hilft Entwicklern, Code effizient zu generieren und zu debuggen.

- Pädagogische Unterstützung: Verbessert Tutorensysteme mit hochrangigen Argumentationsfähigkeiten.

- Content Creation: Generiert Artikel, Zusammenfassungen und Marketingtexte mit hoher Genauigkeit.

2. Praktische Anwendungen

- Konversations-KI: Wird für Chatbots und virtuelle Assistenten verwendet.

- Code-Unterstützung: Hilft Entwicklern, Code effizient zu generieren und zu debuggen.

- Pädagogische Unterstützung: Verbessert Tutorensysteme mit hochrangigen Argumentationsfähigkeiten.

- Content Creation: Generiert Artikel, Zusammenfassungen und Marketingtexte mit hoher Genauigkeit.

Vergleich mit anderen KI-Modellen

Qwen2.5-Max vs. GPT-4

| Merkmal | Qwen2.5-Max | GPT-4 |

|---|---|---|

| Architektur | Mischung aus Experten | Dichter Transformator |

| Daten vor dem Training | Über 20 Billionen Token | ~13 Billionen Token |

| Wirkungsgrad | Hoch (Aktiviert nur die erforderlichen Experten) | Niedriger (verarbeitet das gesamte Modell) |

| Code-Verständnis | Stark (Spitzenreiter bei Programmier-Benchmarks) | Stark (Leistung gut, aber niedriger als Qwen2.5-Max) |

| Mathematische Begründung | Erweitert | Moderat |

Qwen2.5-Max vs. DeepSeek-V3

| Merkmal | Qwen2.5-Max | DeepSeek-V3 |

|---|---|---|

| Wissensabdeckung | Breit (mehrere Domänen) | Fokussiert (technisch und wissenschaftlich fundiert) |

| Logische Begründung | Hoch | Moderat |

| API-Verfügbarkeit | Ja | Limitiert |

| Modellanpassungsfähigkeit | Feinabgestimmt für vielfältige Anwendungen | Spezialisiert auf weniger Domänen |

Weitere Modelle

Zukunftsaussichten

Qwen2.5-Max wird voraussichtlich durch die Integration multimodaler Funktionen weiterentwickelt, sodass es Bilder, Videos und strukturierte Daten verarbeiten kann. Zukünftige Versionen könnten besseres Echtzeitlernen und eine verbesserte Interaktionssteuerung beinhalten, was es zu einem noch leistungsfähigeren Werkzeug für KI-gesteuerte Lösungen macht.

Fazit

Qwen 2.5-Max stellt einen bedeutenden Fortschritt in der künstlichen Intelligenz dar und übertrifft bestehende Modelle in Schlussfolgerung, Verständnis und Aufgabenausführung. Mit seiner innovativen Mixture-of-Experts-Architektur, umfassendem Training und überlegener Benchmark-Performance ist es bereit, Anwendungen branchenübergreifend zu revolutionieren – von der Softwareentwicklung bis hin zu Kundensupport und Schulung. Da sich KI weiterentwickelt, ist Qwen 2.5-Max bestens positioniert, um bei der Bereitstellung innovativer KI-gestützter Lösungen eine Vorreiterrolle einzunehmen.