GPT-5.5 Instant ist OpenAIs neuestes Upgrade für die alltägliche Intelligenz, die ChatGPT antreibt. Veröffentlicht am 5. Mai 2026, ersetzt es GPT-5.3 Instant als Standardmodell für Hunderte Millionen Nutzer. Es liefert intelligentere, genauere Antworten mit deutlich weniger Halluzinationen und bewahrt dabei die niedrige Latenz, die Nutzer vom „Instant“-Erlebnis erwarten.

Für Entwickler, Unternehmer, SaaS-Erbauer und Enterprise-Teams eröffnet dieses Modell-Upgrade neue Möglichkeiten für zuverlässige KI-Integration, ohne Geschwindigkeit zu opfern oder die Kosten explodieren zu lassen. Dieser umfassende Leitfaden deckt alles ab – vom schnellen ChatGPT-Zugang bis hin zur produktionsreifen API-Nutzung – mit praxisnahen Beispielen und Optimierungsstrategien.

Was ist GPT-5.5 Instant und warum es wichtig ist

GPT-5.5 Instant ist die schnelle, effiziente Variante, optimiert für tägliche Interaktionen, suchergänzte Antworten, Bildanalyse und personalisierten Kontextabruf. Es treibt das standardmäßige ChatGPT-Erlebnis an und liefert messbare Verbesserungen gegenüber seinem Vorgänger.

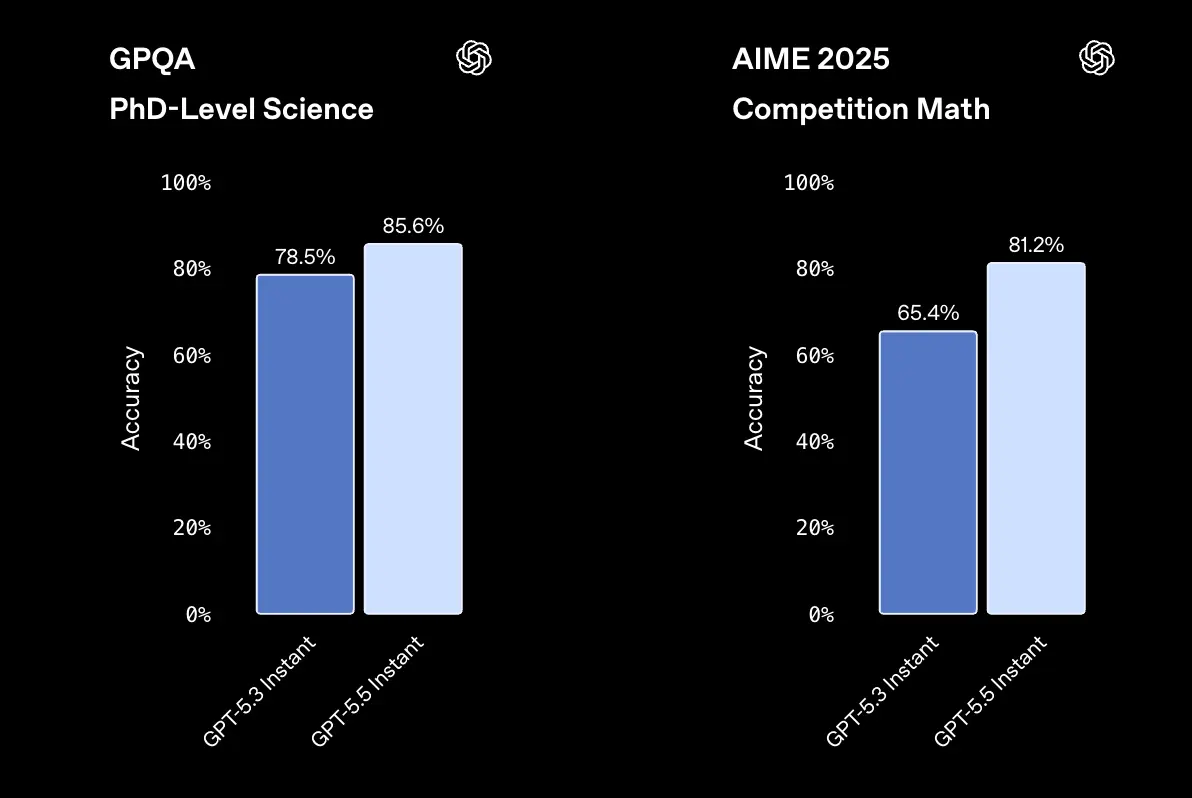

Schlüsselverbesserungen (gestützt durch OpenAI-Evaluierungen):

- GPT-5.5 Instant erzeugte 52.5% weniger halluzinierte Aussagen als GPT-5.3 Instant bei risikoreichen Prompts

- 37.3% weniger ungenaue Aussagen in anspruchsvollen Konversationen.

- Stärkere Leistung bei Foto-/Bildanalyse, MINT-Fragen und beim Erkennen, wann eine Websuche sinnvoll ist.

- Kürzere, natürlichere und persönlichere Antworten mit besserem Kontextmanagement aus vergangenen Chats, Dateien und verbundenem Gmail.

Im Gegensatz zum schwergewichtigeren GPT-5.5 (Thinking/Pro-Varianten), das für tiefes Reasoning und komplexe agentische Aufgaben ausgelegt ist, priorisiert GPT-5.5 Instant Geschwindigkeit und Zuverlässigkeit für den allgemeinen Einsatz und bietet dennoch erhebliche Fähigkeitsgewinne.

GPT-5.5 Instant vs. GPT-5.5 vs. frühere Modelle: Vergleichstabelle

| Feature/Model | GPT-5.5 Instant (Default) | GPT-5.5 (Full/Thinking) | GPT-5.3 Instant (Previous) |

|---|---|---|---|

| Primary Strength | Geschwindigkeit + Zuverlässigkeit | Tiefes Schlussfolgern & Agenten | Allgemeine Nutzung |

| Latency | Am niedrigsten | Höher | Niedrig |

| Hallucination Reduction | 52.5% weniger (bei risikoreichen Prompts) | Am höchsten | Ausgangswert |

| Personalization | Exzellent (Memory-Suche) | Stark | Gut |

| Image/STEM Performance | Deutlich verbessert | Überragend | Gut |

| API Pricing (approx.) | Wettbewerbsfähig über Anbieter | $5/$30 per M tokens | Geringer |

| Best For | Chat, schnelle Aufgaben, Apps | Komplexe Workflows | Legacy |

Wann Sie Instant wählen sollten: Alltagsanwendungen, Kundensupport-Bots, Inhaltserstellung und latenzsensitive Oberflächen.

Im Wesentlichen teilen sich GPT-5.5 Instant und GPT-5.5 Thinking dieselbe zugrunde liegende Architektur. Der Unterschied liegt in der Tiefe des Reasonings, nicht im Wissensstand. Zahlende Nutzer können GPT-5.5 Thinking verwenden, während kostenlose Nutzer ein begrenztes Kontingent von GPT-5.5 Instant auf ChatGPT nutzen können.

Weitere Informationen finden Sie in der GPT-5.5-Übersicht und der Funktionsweise.

Wie Sie GPT-5.5 Instant in ChatGPT nutzen

Wenn Sie ChatGPT direkt verwenden, ist GPT-5.5 Instant der Standard für alle eingeloggten Nutzer. OpenAI gibt an, dass es an alle ChatGPT-Nutzer ausgerollt wird und GPT-5.3 Instant als Standardmodell ersetzt. Das bedeutet, dass viele Nutzer nichts manuell umstellen müssen, um vom neuen Instant-Erlebnis zu profitieren.

Für zahlende Nutzer bietet ChatGPT einen Modellwahlschalter, mit dem sich GPT-5.5 Instant oder GPT-5.5 Thinking manuell auswählen lassen (für zahlende Nutzer bleibt GPT‑5.3 Instant drei Monate verfügbar). Laut Help Center von OpenAI haben Plus-, Pro- und Business-Nutzer Zugriff auf den Wahlschalter, während GPT-5.5 Pro den Tarifen Pro, Business, Enterprise und Edu vorbehalten ist.

Kostenlose Nutzer können GPT-5.5 in ChatGPT weiterhin verwenden, es gelten jedoch Nutzungslimits. OpenAI gibt an, dass Free-Konten bis zu 10 Nachrichten mit GPT-5.5 alle 5 Stunden senden können, während Plus- und Go-Nutzer bis zu 160 Nachrichten alle 3 Stunden senden können. Nach Erreichen des Limits wechseln Unterhaltungen zur GPT-5.5 Mini-Version, bis das Limit zurückgesetzt wird. Pro- und Business-Teams werden nicht zurückgestuft und können GPT-5.5 weiter nutzen.

Wenn Sie die Pro- oder Enterprise-Edition verwenden und die Leistung von Instant und Thinking in einer realen Aufgabe vergleichen möchten, öffnen Sie zwei Tabs nebeneinander, pinnen Sie je einen Tab für jedes Modell und geben Sie die gleichen Prompts ein. Der Unterschied ist besonders deutlich bei Aufgaben mit implizitem mehrstufigem Reasoning, da Thinking verschiedene Denkpfade erkundet, bevor es antwortet. Für Alltagsgespräche ist Instant bei den ersten Antworten schneller.

Praktischer ChatGPT-Zugriffsablauf

Für die meisten Nutzer ist der Ablauf einfach:

- Bei ChatGPT anmelden.

- Das standardmäßige Instant-Erlebnis verwenden.

- In kostenpflichtigen Tarifen den Modellwahlschalter öffnen, um GPT-5.5 Instant manuell auszuwählen.

- Nur dann zu GPT-5.5 Thinking wechseln, wenn die Aufgabe wirklich tieferes Reasoning erfordert.

Das ist der nutzerseitige Weg. Für Produktteams stellt sich jedoch die Frage, wie sich die gleiche Qualität in der eigenen Anwendung operationalisieren lässt. Hier kommt der API-Weg ins Spiel.

Erweiterte Funktionen

- Memory und Personalisierung: Das Modell zieht intelligent Informationen aus dem Gesprächsverlauf, hochgeladenen Dateien und Gmail (falls verbunden) heran. Es entscheidet, wann Personalisierung Mehrwert bietet.

- Bildanalyse: Laden Sie Fotos hoch für verbesserte visuelle Schlussfolgerungen.

- Websucheintegration: Automatisch, wenn aktuelle Informationen benötigt werden.

Profi-Tipp: Starten Sie neue Chats für das sauberste Standarderlebnis. Verwenden Sie benutzerdefinierte Anweisungen in den Einstellungen für konsistenten Ton und Kontext über Sitzungen hinweg.

Wie Sie GPT-5.5 Instant per API zugreifen und nutzen

Der direkte OpenAI-API-Zugriff verwendet Modellaliase wie chat-latest. chat-latest verweist auf das neueste Instant-Modell, das derzeit in ChatGPT verwendet wird. Viele Teams bevorzugen einheitliche Anbieter wie CometAPI für geringere Kosten, höhere Ratenlimits und eine vereinfachte Integration über mehrere Modelle.

In der API werden GPT-5.5 Instant und GPT-5.5 Thinking zu einem einzigen Modellbezeichner zusammengefasst: gpt-5.5. Es gibt keinen separaten gpt-5.5-instant-Endpunkt. Stattdessen steuern Sie die Reasoning-Tiefe mit dem Parameter reasoning_effort, der minimal, low, medium oder high akzeptiert. reasoning_effort: "minimal" kommt dem Instant-Erlebnis in ChatGPT in der API am nächsten.

GPT-5.5 wird über zwei Endpunkte bereitgestellt:

- Responses API (

/v1/responses): der empfohlene Endpunkt für neue Builds, mit erstklassiger Unterstützung für Tools, strukturierten Output und Streaming. - Chat Completions API (

/v1/chat/completions): der Legacy-Endpunkt, zur Abwärtskompatibilität beibehalten.

Schritt-für-Schritt-API-Setup mit CometAPI (für die meisten Teams empfohlen)

1. Registrieren und API-Schlüssel abrufen

- Besuchen Sie CometAPI.com und erstellen Sie ein Konto.

- Navigieren Sie zur Konsole/zum Dashboard, um einen API-Schlüssel zu generieren (beginnt mit

sk-).

2. Einfaches Integrationsbeispiel (Python)

from openai import OpenAI

import os

client = OpenAI(

api_key=os.getenv("COMETAPI_KEY"), # Your CometAPI key

base_url="https://api.cometapi.com/v1"

)

response = client.chat.completions.create(

model="gpt-5.5", # or specific alias

messages=[

{"role": "system", "content": "You are a helpful, concise assistant."},

{"role": "user", "content": "Explain how GPT-5.5 Instant improves factuality."}

],

temperature=0.7,

max_tokens=500

)

print(response.choices[0].message.content)

3. Streaming-Response für bessere UX

stream = client.chat.completions.create(

model="gpt-5.5",

messages=[...],

stream=True

)

for chunk in stream:

if chunk.choices[0].delta.content is not None:

print(chunk.choices[0].delta.content, end="")

JavaScript-, cURL- und andere Sprachbeispiele folgen ähnlichen OpenAI-SDK-Kompatibilitätsmustern.

Wichtige API-Parameter für GPT-5.5 Instant

- temperature: 0.0–1.0 (niedriger für faktenorientierte Aufgaben).

- reasoning_effort (falls in Varianten unterstützt): low/medium für Balance.

- tools/function calling: Voll unterstützt für agentische Workflows.

- Vision: Bild-URLs oder Base64 für multimodale Prompts übergeben.

Bewährte Verfahren für bessere Ergebnisse

GPT-5.5 ist kein Modell nach dem Motto „vage Prompt schreiben und hoffen“. Outcome-first-Prompting wird ausdrücklich empfohlen: Definieren Sie das erwartete Ergebnis, Erfolgskriterien, Constraints, Nebenwirkungen und die Output-Form. Die Dokumentation rät außerdem, schrittweise Prozessanweisungen zu reduzieren, es sei denn, der Weg selbst ist Teil der Produktanforderung. In der Praxis heißt das: Beschreiben Sie das Ziel, nicht jeden einzelnen Schritt.

Strukturierte Ausgaben sind ein weiterer wichtiger Hebel. OpenAI empfiehlt, strukturierte Ausgaben zu verwenden, statt das Schema im Prompt zu beschreiben – insbesondere für produktionsreife Systeme, die automatische Validierung und verlässlichere Downstream-Parser benötigen. Für SaaS-Produkte ist das relevant, weil Ihre App umso weniger Zeit mit dem Bereinigen von Modelloutput verbringt, je stabiler Ihre UX wird.

Prompting-Checkliste für GPT-5.5 Instant

Schreiben Sie Prompts, die:

- das Ziel klar benennen.

- Akzeptanzkriterien definieren.

- das erforderliche Format erwähnen.

- unnötige Anweisungen begrenzen.

- Raum lassen, damit das Modell den besten Weg wählt.

Anleitung zur Reasoning-Aufwandsstufe

OpenAI sagt, medium sei die standardmäßige und empfohlene ausgewogene Einstellung, low könne für viele Workloads gut funktionieren, none sei für latenzkritische Aufgaben, die kein Reasoning benötigen, und high bzw. xhigh sollten den Aufgaben vorbehalten sein, bei denen Evaluierungen einen messbaren Qualitätsgewinn zeigen. Dieser Hinweis ist wichtig: Mehr Reasoning ist nicht automatisch besser – besonders, wenn die Aufgabe schwache Abbruchkriterien hat oder zu viel offenen Toolzugriff erlaubt.

Ein nützliches Produktionsmuster

Für Kundensupport, interne Wissensassistenten und Workflow-Automatisierung ist ein starkes Setup:

- Responses API für Gesprächszustand

- Structured Outputs für vorhersagbares Parsen

- Reasoning-Aufwand je nach Use Case eingestellt

- Prompt Caching für wiederkehrende Präfixe

- Gehostete Tools, wo sie in den Workflow passen

In dieser Kombination wirkt GPT-5.5 weniger wie ein Chatmodell und mehr wie eine Produktions-Engine.

Kostenoptimierungsstrategien

- Häufige Prompts/Antworten cachen.

- Strukturierte Ausgaben (JSON-Modus) für zuverlässiges Parsen verwenden.

- Tokenverbrauch überwachen und Aufwandsstufen klug wählen.

- Einfache Anfragen an leichtere Modelle routen und bei Bedarf an Instant/GPT-5.5 eskalieren.

Schritt-für-Schritt-Implementierungsbeispiele

1) ChatGPT-Workflow

Die einfachste Nutzung von GPT-5.5 Instant ist direkt in ChatGPT. Melden Sie sich an, lassen Sie das standardmäßige Instant-Erlebnis Routineaufgaben übernehmen und wechseln Sie in den kostenpflichtigen Stufen zum Modellwahlschalter, wenn Sie GPT-5.5 Instant oder GPT-5.5 Thinking manuell auswählen möchten. OpenAI sagt, das Standard-„Instant“-Erlebnis sei bereits auf informationssuchende Fragen, Schritt-für-Schritt-Anleitungen, technische Texte und Übersetzungen abgestimmt.

Das ist die richtige Option für Gründer, Operator und Produktmanager, die schnelle Antworten brauchen, ohne Code zu shippen. Es ist auch der beste Ort, um zu benchmarken, ob sich Ton und Faktentreue von GPT-5.5 in Ihren typischen Workflows verbessern, bevor Sie in Integrationen investieren.

2) Direkter API-Workflow

Für die Produktentwicklung nutzen Sie den API-Weg. Laut OpenAI-Dokumentation sollten Sie den Model-Slug auf gpt-5.5 aktualisieren, die Responses API für Reasoning und Tool-Einsatz verwenden und reasoning.effort gezielt setzen. Die Doku hebt außerdem Prompt Caching, strukturierte Ausgaben und Multi-Turn-Handling als Kernelemente einer guten Integration hervor.

Eine praktische Implementierungssequenz sieht so aus:

- Mit einer frischen Prompt-Baseline starten.

- Das Modell auf

gpt-5.5setzen. - Die Responses API verwenden.

- Strukturierte Ausgaben hinzufügen, wenn die App maschinenlesbare Antworten benötigt.

reasoning.effortnach Latenz- und Qualitätszielen justieren.- End-to-End-Verhalten vor dem Rollout benchmarken.

3) Einheitlicher Gateway-Workflow mit CometAPI

CometAPI positioniert sich als einheitliche, OpenAI-ähnliche API-Aggregationsplattform mit Zugriff auf mehr als 500 KI-Modelle über eine einzige Schnittstelle, einen einzigen API-Schlüssel und nutzungsabhängige Abrechnung. Es betont geringere Integrationshürden, eine Anmeldeinformation und die Fähigkeit, Modelle zu wechseln, ohne erneute Authentifizierung oder größeren Migrationsaufwand.

Für Teams, die Multi-Model-Produkte bauen, ist das relevant. Statt den Stack an einen Anbieterpfad zu binden, ermöglicht der Gateway-Ansatz, die Request-Verarbeitung zu standardisieren, Anbietertests zu vereinfachen und den Wartungsaufwand durch modell-spezifische SDK-Zersplitterung zu reduzieren.

CometAPI Vorteile: Deutlich niedrigere Preise (z. B. ~20% Rabatt gegenüber offiziell), ein API-Schlüssel für 500+ Modelle, großzügige Ratenlimits und eine Playground-Umgebung zum Testen. Das ist ideal für Startups, die KI-Features skalieren wollen, ohne sofort hohe OpenAI-Rechnungen zu bezahlen.

Wenn Sie Näheres zu den Preisänderungen von GPT-5.5 wissen möchten, finden Sie hier eine detaillierte Analyse der GPT-5.5-Preisaufschlüsselungen.

FAQ

1. Wie greife ich in ChatGPT auf GPT-5.5 Instant zu?

GPT-5.5 Instant ist der Standard für alle eingeloggten Nutzer, und in kostenpflichtigen Stufen können Sie GPT-5.5 Instant oder GPT-5.5 Thinking über den Modellwahlschalter manuell auswählen.

2. Ist GPT-5.5 Instant in der API verfügbar?

OpenAI sagt, dass GPT-5.5 Instant in der API als chat-latest ausgerollt wird, während die API-Modell-Dokumentation gpt-5.5 als entwicklerseitigen Slug verwendet.

3. Was ist der Unterschied zwischen GPT-5.5 Instant und GPT-5.5 Thinking?

GPT-5.5 Instant ist die schnelle, latenzarme Standardeinstellung für den täglichen Einsatz und ChatGPT. GPT-5.5 (und Pro)-Varianten bieten tieferes Reasoning für komplexe, mehrstufige Aufgaben bei höherer Latenz und Kosten. OpenAI sagt, dass Thinking frühere Schritte besser nachverfolgt und eventuell eine kurze Einleitung zeigt, bevor das Reasoning beginnt.

4. Welche API sollte ich mit GPT-5.5 verwenden?

OpenAI empfiehlt die Responses API für Reasoning, Toolaufrufe und Multi-Turn-Anwendungsfälle.

5. Mit welcher Reasoning-Einstellung sollte ich beginnen?

OpenAI empfiehlt, mit medium zu starten, dann low für latenzsensitive Workloads zu testen oder high und xhigh nur dann zu nutzen, wenn Evaluierungen einen messbaren Qualitätsgewinn zeigen.

6. Kann GPT-5.5 tool-lastige Workflows bewältigen?

Ja. OpenAI sagt, GPT-5.5 sei besonders nützlich bei großen Toolflächen, mehrstufigen Service-Workflows und lang laufenden Agentenaufgaben, mit höherer Präzision in Toolauswahl und Argumentnutzung.

7. Warum sollte ein Team CometAPI statt Direktzugang nutzen?

CometAPI positioniert sich als OpenAI-ähnliches, einheitliches Gateway mit einem API-Schlüssel, Zugriff auf 500+ Modelle und geringerer Integrationsfriktion beim Wechsel zwischen Anbietern.

Fazit und nächste Schritte

GPT-5.5 Instant setzt neue Maßstäbe für zugängliche, zuverlässige KI. Ob Sie ChatGPT-Workflows verbessern oder die nächste Generation KI-gestützter Produkte bauen – die Beherrschung von Zugriff und Nutzung ist entscheidend.

Bereit zur Integration? Jetzt mit CometAPI starten für den sofortigen Zugriff auf GPT-5.5 Instant und die gesamte GPT-5.5-Familie zu wettbewerbsfähigen Preisen. Kostenlos registrieren, den Playground erkunden und in Minuten mit vertrauter OpenAI-SDK-Kompatibilität deployen.