Anthropic hat Claude Opus 4.5 Ende November 2025 als ein leistungsfähigeres, effizienteres Modell der Opus-Klasse veröffentlicht, ausgerichtet auf professionelles Software Engineering, agentische Workflows und Aufgaben mit langem Zeithorizont. Es ist über die Entwicklerplattform von Anthropic sowie über CometAPI verfügbar und führt neue API-Steuerungen (insbesondere den Effort-Parameter), verbesserte Computer-Use-Tools, Extended Thinking sowie Token-Effizienzverbesserungen ein, die in Produktionsumgebungen entscheidend sind.

Im Folgenden finden Sie eine praxisorientierte, professionelle Anleitung: Was sich geändert hat, wie Sie Zugriff erhalten, wie Sie die neuen Steuerungen verwenden (effort, Extended Thinking, Tool Use, Files/Computer Use), Hinweise zu Kosten & Optimierung, Sicherheits-/Governance-Aspekte sowie Integrationsmuster aus der Praxis.

Was genau ist Claude Opus 4.5 und warum ist es wichtig?

Claude Opus 4.5 ist das neueste Mitglied der Opus-Modellfamilie von Anthropic (veröffentlicht am 24.–25. November 2025), das auf maximale Reasoning- und Coding-Fähigkeiten abzielt, dabei die Token-Effizienz verbessert und neue API-Steuerungen für die Balance zwischen Kosten und Gründlichkeit bietet. Anthropic positioniert Opus 4.5 als das „intelligenteste Modell“, das es veröffentlicht hat, mit Fokus auf komplexe Software-Engineering-Aufgaben, lang laufende Agenten, Tabellenkalkulations-/Excel-Automatisierung und Aufgaben, die anhaltendes mehrstufiges Denken erfordern.

Was sind die wichtigsten Neuerungen in Opus 4.5?

Anthropic hat Opus 4.5 entwickelt, um die Tiefe des Reasonings und das agentische Verhalten zu verbessern und Entwicklerinnen und Entwicklern gleichzeitig eine bessere Kontrolle über Trade-offs zwischen Kosten und Latenz zu geben. Zu den Highlights gehören:

- Effort-Parameter (Beta): ein erstklassiger API-Regler, der steuert, wie viel „Denkbudget“ Claude für eine Anfrage aufwendet (typisch

low,medium,high). Er beeinflusst Reasoning, Tool Calls und interne „Thinking“-Tokens, sodass Sie Geschwindigkeit vs. Gründlichkeit pro Call abstimmen können, statt das Modell zu wechseln. Dies ist ein zentrales Merkmal von Opus 4.5. - Bessere Agent- und Tool-Orchestrierung: verbesserte Genauigkeit bei der Tool-Auswahl, besser strukturierte Tool Calls und ein robusterer Tool-Result-Workflow für den Bau von Agenten und mehrstufigen Pipelines. Anthropic liefert Dokumentation und SDK-Hinweise für den „Tool Use“-Flow.

- Token-/Kosteneffizienz — Anthropic berichtet von Einsparungen von bis zu ~50 % beim Tokenverbrauch für einige Workflows gegenüber Sonnet 4.5, zudem weniger Fehler bei Tool Calls und weniger Iterationen bei komplexen Engineering-Aufgaben.

- Verbesserte multimodale Fähigkeiten: Umfassende Verbesserungen bei visueller, logischer und mathematischer Leistung.

- Kontextfenster auf 200K Token erweitert und unterstützt damit tiefe, lange Unterhaltungen und die Analyse komplexer Dokumente.

Welche praktischen Fähigkeiten haben sich verbessert?

Leistungsupgrade

- Bessere Agent- und Tool-Orchestrierung: verbesserte Genauigkeit bei der Tool-Auswahl, besser strukturierte Tool Calls und ein robusterer Tool-Result-Workflow für den Bau von Agenten und mehrstufigen Pipelines. Verbesserte Kontexthandhabung, Kompaktionshilfen für lange Agentenläufe und erstklassige Tool-SDKs zum Registrieren und Validieren von Tools machen Opus 4.5 besser geeignet, um Agenten zu bauen, die viele Schritte unbeaufsichtigt ausführen.

- Verbesserte multimodale Fähigkeiten: Umfassende Verbesserungen bei visueller, logischer und mathematischer Leistung.

- Kontextfenster auf 200K Token erweitert und unterstützt damit tiefe, lange Unterhaltungen und die Analyse komplexer Dokumente.

Programmierung und Langzeithorizont-Arbeit

Opus 4.5 bleibt für Coding-Aufgaben benchmarkgetrieben; es reduziert die Anzahl von Iterationen und Tool-Call-Fehlern bei langen Aufträgen (Code-Migration, Refactoring, mehrstufiges Debugging). Frühe Berichte und die Systemkarte von Anthropic vermerken eine verbesserte, anhaltende Leistung auf Engineering-Benchmarks und deutliche Effizienzgewinne in toolgetriebenen Pipelines.

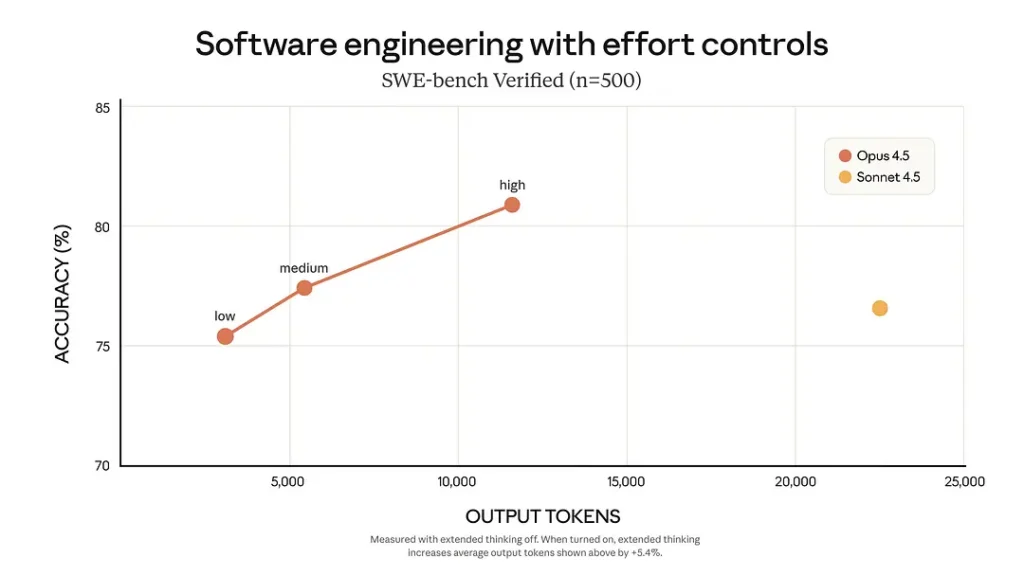

In SWE-bench berichtet Opus 4.5 führende Ergebnisse bei Software-Engineering-Benchmarks (Anthropic nennt 80,9 % auf SWE-bench Verified im Launch-Material), und Kundinnen/Kunden melden Verbesserungen beim Debugging, bei Bearbeitungen über mehrere Dateien und bei Codeaufgaben mit langem Horizont.

Kosten und Effizienz

Anthropic hat Opus 4.5 entwickelt, um die Tiefe des Reasonings und das agentische Verhalten zu verbessern und gleichzeitig eine bessere Kontrolle über Trade-offs zwischen Kosten und Latenz zu geben:

- Preisreduktion im Vergleich zu Opus 4.1: $5 (Input) / $25 (Output) pro Million Token.

- Verbesserter Tokenverbrauch: durchschnittliche Reduktion um 50–75 % bei gleichbleibender Leistung.

- ein erstklassiger API-Regler, der steuert, wie viel „Denkbudget“ Claude für eine Anfrage aufwendet (typisch

low,medium,high). Er beeinflusst Reasoning, Tool Calls und interne „Thinking“-Tokens, sodass Sie Geschwindigkeit vs. Gründlichkeit pro Call abstimmen können, statt das Modell zu wechseln. Dies ist ein zentrales Merkmal von Opus 4.5 (Verglichen mit Sonnet 4.5: Medium Effort → 76 % weniger Token, vergleichbare Leistung; High Effort → 4,3 % Leistungsverbesserung, 48 % weniger Token).

Wie erhalte ich Zugriff auf und nutze die Claude Opus 4.5 API?

Wie erhalte ich Zugriff und Schlüssel?

- Erstellen Sie ein Anthropic-/Claude-Entwicklerkonto. Registrieren Sie sich im Claude/Anthropic-Entwicklerportal und erzeugen Sie einen API-Schlüssel über die Konsole (Organisation-/Admin-Flows existieren für Teams). Die Messages-API ist der primäre Endpunkt für Chat-/Assistant-Interaktionen.

- Cloud-Partner: Opus 4.5 ist ebenfalls über große Cloud-Marktplätze verfügbar, Google Vertex AI, CometAPI (eine Aggregationsplattform für KI-APIs, die ihre eigene Authentifizierung verwendet). In CometAPI können Sie auf die Claude Opus 4.5 API über das Anthropic Messages-Format und das Chat-Format zugreifen.

Wie authentifiziere ich meine Anfragen?

Verwenden Sie Standard-Bearer-Tokens: Fügen Sie jeder API-Anfrage einen Authorization: Bearer $_API_KEY-Header hinzu. Anfragen sind JSON über HTTPS; die Messages-API akzeptiert eine Liste strukturierter Nachrichten (system + user + assistant).

Quickstart — Python (offizielles SDK)

SDK installieren:

pip install anthropic

Minimales Beispiel (synchron):

import os

from anthropic import Anthropic

# expects ANTHROPIC_API_KEY in env

client = Anthropic(api_key=os.environ)

resp = client.messages.create(

model="claude-opus-4-5-20251101",

messages=,

max_tokens=512,

)

print(resp.content.text) # SDK returns structured content blocks

Dieser Aufruf verwendet die kanonische Modellkennung von Opus 4.5. Für providerverwaltete Endpunkte (Vertex, CometAPI, Foundry) folgen Sie der Anbieterdokumentation, um den Client zu konstruieren und die URL und den Schlüssel des Anbieters anzugeben (z. B. https://api.cometapi.com/v1/messages für CometAPI).

Quickstart — Python (CometAPI)

Sie müssen sich bei CometAPI anmelden und einen Schlüssel erhalten.

curl

--location

--request POST 'https://api.cometapi.com/v1/messages' \

--header 'Authorization: Bearer ' \

--header 'Content-Type: application/json' \

--data-raw '{ "model": "claude-opus-4-5-20251101", "max_tokens": 1000, "thinking": { "type": "enabled", "budget_tokens": 1000 }, "messages": }'

Wie verwende ich den neuen Parameter effort und Extended Thinking?

Was ist der Parameter effort und wie lege ich ihn fest?

Der Parameter effort ist eine erstklassige API-Steuerung, die mit Opus 4.5 eingeführt wurde und festlegt, wie viel interne Berechnung und Tokenbudget das Modell für seine Antwort aufwendet. Typische Werte sind low, medium und high. Verwenden Sie ihn, um Latenz und Tokenkosten gegenüber Gründlichkeit auszubalancieren:

low— schnelle, token-effiziente Antworten für hochvolumige Automatisierung und Routineaufgaben.medium— ausgewogene Qualität/Kosten für den Produktionseinsatz.high— tiefe Analysen, mehrstufiges Reasoning oder wenn Genauigkeit am wichtigsten ist.

Anthropic hat effort für Opus 4.5 (Beta) eingeführt. Sie müssen einen Beta-Header einfügen (z. B. effort-2025-11-24) und output_config: { "effort": "low|medium|high" } angeben (siehe Beispiel unten). high ist das Standardverhalten. Das Absenken von effort reduziert Tokenverbrauch und Latenz, kann aber die Gründlichkeit moderat verringern. Nutzen Sie es für Durchsatz- oder latenzkritische Aufgaben.

Beispiel:

# Example using the beta messages API shown in Anthropic docs

from anthropic import Anthropic

import os

client = Anthropic(api_key=os.getenv("ANTHROPIC_API_KEY"))

response = client.beta.messages.create(

model="claude-opus-4-5-20251101",

betas=, # required beta header

messages=,

max_tokens=1500,

output_config={"effort": "medium"} # low | medium | high

)

print(response)

Wann welchen Wert verwenden: low für automatisierte Pipelines (z. B. E-Mail-Kategorisierung), medium für Standard-Assistenten und high für Codegenerierung, tiefgehende Recherche oder risikosensitive Aufgaben. Anthropic hebt diesen Parameter als zentrale Steuergröße von Opus 4.5 hervor.

Im SWE-bench-Test:

- Im Modus Medium Effort: Leistung vergleichbar mit Sonnet 4.5, aber Ausgabentoken um 76 % reduziert;

- Im Modus High Effort: Leistung übertrifft Sonnet 4.5 um ca. 4,3 Prozentpunkte, und Token werden um 48 % reduziert.

Was ist Extended Thinking und wie rufe ich es auf?

Extended Thinking (auch „extended thinking“ oder „thinking blocks“) ermöglicht es dem Modell, Zwischenschritte bzw. schrittweises Reasoning durchzuführen und dabei optional die internen Denkblöcke zu bewahren oder zu summarisieren. Die Messages-API unterstützt dieses Verhalten, und Anthropic hat Steuerungen hinzugefügt, um vorherige Thinking-Blocks zu erhalten, sodass mehrstufige Agenten frühere Überlegungen wiederverwenden können, ohne teure Neuberechnung. Verwenden Sie Extended Thinking, wenn die Aufgabe mehrstufige Planung, Problemlösung mit langem Horizont oder Tool-Orchestrierung erfordert.

Wie integriere ich Tools und baue Agenten mit Opus 4.5?

Eine der großen Stärken von Opus 4.5 ist die verbesserte Tool-Nutzung: Definieren Sie Tools in Ihrem Client, lassen Sie Claude entscheiden, wann sie aufzurufen sind, führen Sie das Tool aus und senden Sie das tool_result zurück — Claude nutzt die Ergebnisse in seiner finalen Antwort. Anthropic stellt Agent-SDKs bereit, mit denen Sie typisierte Toolfunktionen registrieren können (z. B. run_shell, call_api, search_docs), die Claude während des Extended Thinking entdecken und aufrufen kann. Die Plattform wandelt Tooldefinitionen in aufrufbare Funktionen um, die das Modell aufrufen und von denen es Ergebnisse empfangen kann. So bauen Sie agentische Workflows sicher (mit kontrollierten Ein-/Ausgaben).

Nachfolgend ein praxisnahes Muster und ein End-to-End-Python-Beispiel.

Muster für Tool-Nutzung (konzeptionell)

- Client liefert

tools-Metadaten mit Name, Beschreibung und JSON-Schema (input_schema). - Modell gibt einen

tool_use-Block zurück (die strukturierte Anweisung des Modells, ein bestimmtes Tool mit bestimmten Eingaben aufzurufen). Das Feldstop_reasonin der API-Antwort kanntool_usesein. - Client führt das Tool aus (Ihr Code ruft die externe API oder lokale Funktion auf).

- Client sendet eine Folge-Nachricht mit

role:"user"und einemtool_result-Content-Block, der die Toolausgaben enthält. - Modell konsumiert das Tool-Resultat und gibt die finale Antwort oder weitere Tool Calls zurück.

Dieser Ablauf ermöglicht eine sichere Kontrolle auf Client-Seite darüber, was das Modell ausführt (das Modell schlägt Tool-Calls vor; Sie entscheiden über die Ausführung).

End-to-End-Beispiel — Python (einfaches Wetter-Tool)

# 1) Define tools metadata and send initial request

from anthropic import Anthropic

import os, json

client = Anthropic(api_key=os.environ)

tools = [

{

"name": "get_weather",

"description": "Return the current weather for a given city.",

"input_schema": {"type":"object","properties":{"city":{"type":"string"}},"required":}

}

]

resp = client.messages.create(

model="claude-opus-4-5-20251101",

messages=,

tools=tools,

max_tokens=800,

)

# 2) Check if Claude wants a tool call

stop_reason = resp.stop_reason # SDK field

if stop_reason == "tool_use":

# Extract the tool call (format varies by SDK; this is schematic)

tool_call = resp.tool_calls # e.g., {"name":"get_weather", "input":{"city":"Tokyo"}}

tool_name = tool_call

tool_input = tool_call

# 3) Execute the tool client-side (here: stub)

def get_weather(city):

# Replace this stub with a real weather API call

return {"temp_c": 12, "condition": "Partly cloudy"}

tool_result = get_weather(tool_input)

# 4) Send tool_result back to Claude

follow_up = client.messages.create(

model="claude-opus-4-5-20251101",

messages=[

{"role":"user", "content":[{"type":"tool_result",

"tool_use_id": resp.tool_use_id,

"content": json.dumps(tool_result)}]}

],

max_tokens=512,

)

print(follow_up.content.text)

else:

print(resp.content.text)

Wie sollten Sie Agenten für Zuverlässigkeit strukturieren?

- Tool-Eingaben sanitisieren (Prompt-Injection vermeiden).

- Tool-Ausgaben validieren, bevor sie an das Modell zurückgeführt werden (Schemasicherungen).

- Tool-Scope begrenzen (Prinzip der minimalen Rechte).

- Kompaktionshilfen (aus den Anthropic-SDKs) verwenden, um den Kontext bei langen Läufen handhabbar zu halten.

Wie sollte ich Prompts entwerfen und Nachrichten für Opus 4.5 strukturieren?

Welche Nachrichtenrollen und Prefill-Strategien funktionieren am besten?

Verwenden Sie ein Drei-Teile-Muster:

- System (role: system): globale Anweisungen — Ton, Leitplanken, Rolle.

- Assistant (optional): vorbereitete Beispiele oder Priming-Inhalte.

- User (role: user): die unmittelbare Anfrage.

Befüllen Sie die Systemnachricht mit Constraints (Format, Länge, Sicherheitsrichtlinie, JSON-Schema, falls Sie strukturierten Output wünschen). Für Agenten fügen Sie Tool-Spezifikationen und Anwendungsbeispiele hinzu, damit Opus 4.5 diese Tools korrekt aufrufen kann.

Wie nutze ich Kontextkompression und Prompt-Caching, um Token zu sparen?

- Kontextkompression: ältere Teile einer Unterhaltung in prägnante Zusammenfassungen komprimieren, die das Modell weiterverwenden kann. Opus 4.5 unterstützt Automatisierung, um den Kontext zu komprimieren, ohne kritische Denkblöcke zu verlieren.

- Prompt-Caching: Modellantworten für wiederkehrende Prompts cachen (Anthropic stellt Prompt-Caching-Patterns bereit, um Latenz/Kosten zu senken).

Beide Maßnahmen reduzieren den Token-Footprint langer Interaktionen und werden für lang laufende Agenten-Workflows und produktive Assistenten empfohlen.

Fehlerbehandlung und Best Practices

Nachfolgend pragmatische Empfehlungen zu Zuverlässigkeit und Sicherheit für die Produktivintegration mit Opus 4.5.

Zuverlässigkeit & Retries

- Rate Limits (HTTP 429) mit exponentiellem Backoff und Jitter behandeln (Start bei 500–1000 ms).

- Idempotenz: Für nicht-mutierende LLM-Aufrufe können Sie sicher erneut versuchen, aber seien Sie vorsichtig in Workflows, in denen das Modell externe Seiteneffekte auslöst (Tool Calls) — deduplizieren Sie anhand von

tool_use_idoder eigenen Request-IDs. - Streaming-Stabilität: teilweise Streams handhaben und sauber neu verbinden; bei Unterbrechung bevorzugt die gesamte Anfrage erneut senden oder mit Anwendungszustand fortsetzen, um inkonsistente Tool-Interaktionen zu vermeiden.

Sicherheit & Schutz

- Prompt-Injection & Tool-Sicherheit: dem Modell niemals erlauben, beliebige Shell-Kommandos oder Code direkt ohne Validierung auszuführen. Tool-Eingaben stets validieren und Ausgaben sanitisieren. Das Modell schlägt Tool Calls vor; Ihr Code entscheidet über deren Ausführung. Die Systemkarte und Dokumentation von Anthropic beschreiben Alignment-Vorgaben und Sicherheitsniveaus — folgen Sie ihnen in risikoreichen Domänen.

- Datenverarbeitung & Compliance: Behandeln Sie Prompts sowie Tool-Ein-/Ausgaben mit PII oder regulierten Daten entsprechend Ihrer Rechts-/Compliance-Policy. Verwenden Sie Provider-VPC-/Enterprise-Kontrollen, wenn Sie strikte Datenresidenz- oder Audit-Anforderungen haben (Bedrock / Vertex / Foundry bieten Enterprise-Optionen).

Observability & Kostenkontrolle

- Request-/Response-Metadaten loggen (keine rohen sensitiven Inhalte, sofern nicht erlaubt) — Tokenzahlen,

effort-Level, Latenz, Modell-ID und Provider. Diese Metriken sind essenziell für Kostenallokation und Debugging. - Effort zur Kostensteuerung pro Call verwenden:

lowfür Routinezusammenfassungen oder High-QPS-Endpunkte;highfür tiefes Debugging oder Untersuchungen. Qualität vs. Tokenverbrauch monitoren, um für unterschiedliche Endpunkte Defaults festzulegen.

Fazit — Wann (und wie) sollten Sie Opus 4.5 wählen?

Claude Opus 4.5 ist die natürliche Wahl, wenn Ihr Produkt Folgendes benötigt:

- tiefes, mehrstufiges Reasoning (lange Logikketten, Recherche oder Debugging),

- robuste Agent-/Tool-Orchestrierung (komplexe Workflows mit externen APIs) oder

- produktionsreife Codeunterstützung über große Codebasen.

Operativ nutzen Sie effort, um Budgets pro Call zu steuern; verlassen Sie sich auf das Tool-Use-Muster, um Ausführungssicherheit zu bewahren, und wählen Sie einen Cloud-Partner (oder die Anthropic-API direkt) basierend auf Ihren Compliance-Anforderungen. Benchmarken Sie mit Ihrem eigenen Korpus: Anbieterzahlen (SWE-bench etc.) sind nützliche Signale, aber Ihre reale Aufgabe und Ihre Daten bestimmen den ROI. Befolgen Sie zu Ihrer Sicherheit die Systemkarte von Opus 4.5 und setzen Sie Leitplanken um Toolausführung und PII-Verarbeitung.

Entwicklerinnen und Entwickler können auf die Claude Opus 4.5 API über CometAPI zugreifen. Um loszulegen, erkunden Sie die Modellfähigkeiten vonCometAPI im Playground und konsultieren Sie den API-Guide für detaillierte Anweisungen. Bevor Sie zugreifen, stellen Sie sicher, dass Sie sich bei CometAPI angemeldet und den API-Schlüssel erhalten haben. CometAPI bietet einen Preis, der deutlich unter dem offiziellen liegt, um Ihre Integration zu unterstützen.

Bereit loszulegen?→ Jetzt bei CometAPI registrieren!

Wenn Sie weitere Tipps, Anleitungen und Neuigkeiten zu KI erhalten möchten, folgen Sie uns auf VK, X und Discord!