LobeChat und CometAPI sind zwei dynamische Projekte im offenen KI-Ökosystem. Im September 2025 führte LobeChat eine vollständige CometAPI-Provider-Integration ein, die den einfachen Aufruf der einheitlichen, OpenAI-kompatiblen Endpunkte von CometAPI von LobeChat aus ermöglicht. Dieser Artikel erklärt, was LobeChat und CometAPI sind, warum Sie sie integrieren sollten, die schrittweise Integration und Konfiguration (einschließlich einer sofort einsatzbereiten TypeScript-Provider-Basiskonfiguration), Laufzeitbeispiele, konkrete Anwendungsfälle und Produktionstipps zu Kosten, Zuverlässigkeit und Beobachtbarkeit.

Was ist LobeChat und welche Funktionen bietet es?

LobeChat ist ein modernes Open-Source-Chat-Framework für Multi-Provider-LLM-Chat-Anwendungen mit einer ausgefeilten Benutzeroberfläche und Bereitstellungstools. Es unterstützt multimodale Eingaben (Text, Bilder, Audio), Wissensdatenbank-/RAG-Workflows, verzweigte Konversationen und „Chain of Thought“-Visualisierungen sowie ein erweiterbares Provider-/Plugin-System, sodass Sie verschiedene Modell-Backends ohne Neustrukturierung Ihrer App einbinden können. Die Dokumentation und das Repo von LobeChat präsentieren es als produktionsreifes Framework für selbstgehostete und Cloud-Bereitstellungen mit umgebungsgesteuerter Konfiguration und einem Marktplatz für MCP-Integrationen (Model Control Plane) von Drittanbietern.

Die wichtigsten LobeChat-Funktionen auf einen Blick

- Unterstützung mehrerer Anbieter (OpenAI, Anthropic, Google Gemini, Ollama usw.).

- Datei-Upload + Wissensdatenbank für RAG-Workflows (Dokumente, PDFs, Audio).

- Entwicklerfreundliche Konfiguration über Umgebungsvariablen und Einstellungs-URL-Import.

- Erweiterbare Laufzeit: Anbieter werden mit kleinen Adapterlaufzeiten konfiguriert, sodass neue Backends steckbar sind.

Was ist CometAPI?

CometAPI ist eine einheitliche KI-Zugriffsebene, die über 500 Modelle von verschiedenen Anbietern über eine einzige, OpenAI-kompatible API-Oberfläche bereitstellt. Entwickler können Modell-Endpunkte nach Leistung, Kosten oder Leistungsfähigkeit ohne Lock-in auswählen und Abrechnung, Routing und Zugriff zentralisieren. CometAPI bietet einheitliche Endpunkte für Chat/Vervollständigungen und eine API zur Modellliste zum Auffinden verfügbarer Modell-IDs.

Warum CometAPI für Teams attraktiv ist

- Modellauswahl & Portabilität: Wechseln Sie zwischen vielen hochmodernen Modellen, ohne den Integrationscode wesentlich zu ändern.

- OpenAI-kompatible Endpunkte: Viele Client-Bibliotheken und Frameworks, die HTTP-Endpunkte im OpenAI-Stil erwarten, können mit CometAPI arbeiten, indem Basis-URL + Authentifizierung geändert werden. (Praktische Beispiele zeigen

https://api.cometapi.com/v1/als OpenAI-kompatible Oberfläche.) - Entwicklerdokumente und Integrationen: CometAPI veröffentlicht Dokumente und Schritt-für-Schritt-Anleitungen zur Integration mit Tools wie LlamaIndex und anderen Low-Code-Plattformen.

Warum sollten Sie CometAPI in LobeChat integrieren?

Kurze Antwort: Flexibilität, Kostenkontrolle und schneller Zugriff auf neue ModelleLobeChat ist anbieterunabhängig. Durch die Integration von CometAPI kann Ihre LobeChat-Implementierung viele verschiedene Modelle über denselben Codepfad aufrufen – tauschen Sie Modelle hinsichtlich Durchsatz, Latenz, Kosten oder Kapazität aus, ohne Ihre Benutzeroberfläche oder Eingabeaufforderungen zu ändern. Darüber hinaus haben die Community und die Betreuer LobeChat aktiv um CometAPI-Anbieterunterstützung erweitert, was die Integration vereinfacht.

Geschäftliche und technische Vorteile

- Modellvielfalt ohne Code-Fluktuation. Müssen Sie Gemini, Claude oder ein Nischenbildmodell evaluieren? CometAPI kann diese Modell-IDs über eine einzige API bereitstellen. Dies reduziert den Aufwand pro Anbieter in LobeChat.

- Kostenoptimierung. Mit CometAPI können Sie zu günstigeren Modellen weiterleiten oder dynamisch kostengünstigere Anbieter auswählen, wodurch die Kosten pro Gespräch bei Bereitstellungen mit hohem Volumen erheblich gesenkt werden können.

- Einfachere Geheimverwaltung. Ein API-Schlüssel zur Verwaltung in den LobeChat-Einstellungen oder der Docker-Umgebung anstelle mehrerer Anbieterschlüssel. Die LobeChat-Plattform unterstützt bereits die Aktivierung eines Anbieters über

ENABLED_<PROVIDER>und ein Provider-Schlüssel-Umgebungsvariablenmuster, sodass die Integration betrieblich konsistent ist. - Hält die LobeChat-Codebasis minimal: Die Anbieterlogik ist gekapselt und mit Umgebungsvariablen konfiguriert.

Wie richte ich CometAPI in LobeChat ein und integriere es?

Dieser Abschnitt enthält eine praktische Schritt-für-Schritt-Anleitung: Schlüssel abrufen, Umgebungsvariablen festlegen, den Provider zu LobeChat hinzufügen (Beispiel-Providerkonfiguration) und Laufzeitnutzung anzeigen (Chat-Aufruf). Die Beispiele folgen den Providermustern von LobeChat und den OpenAI-kompatiblen Endpunkten von CometAPI.

1) Holen Sie sich ein CometAPI-Konto und einen API-Schlüssel

Melden Sie sich bei CometAPI an und öffnen Sie die API-Konsole. Um ein CometAPI-Konto zu registrieren, benötigen Sie eine E-Mail-Adresse oder melden sich direkt mit Google One-Click an.

Gehen Sie nach Abschluss der Registrierung zum Playground und klicken Sie auf „Neuen geheimen Schlüssel hinzufügen“, um einen neuen API-Schlüssel zu erstellen:

Holen Sie sich einen API-Schlüssel.

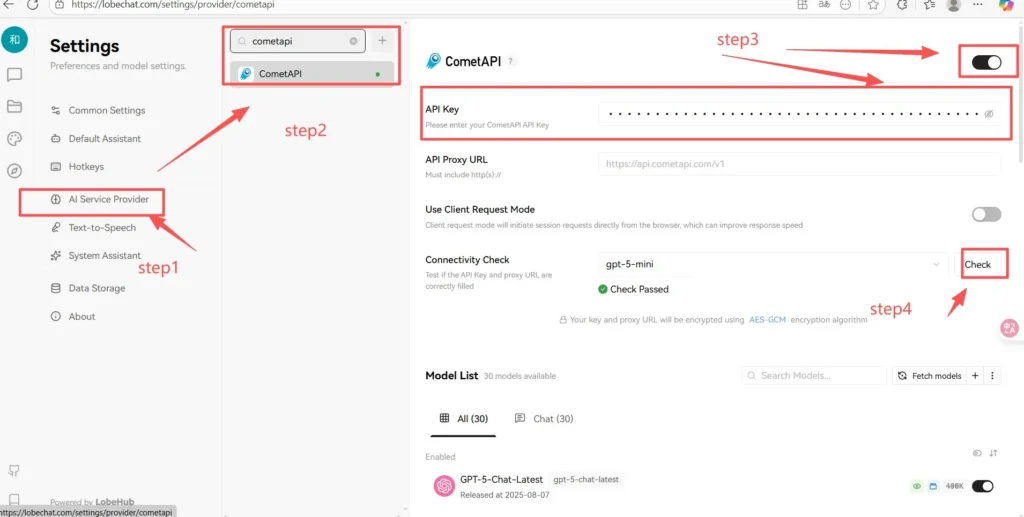

2) Konfigurieren von CometAPI in LobeChat

- Rufen Sie das Lobe-Chat-Einstellungsmenü auf, klicken Sie auf den Avatar und dann auf die Option „Anwendungseinstellungen“.

- Wählen Sie Cometapi als Modellanbieter aus.

- Fügen Sie den sk-xxxxx von cometapi in das API-Schlüsseleingabefeld ein und aktivieren Sie die Schaltfläche. Wählen Sie ein Modell zur Überprüfung aus.

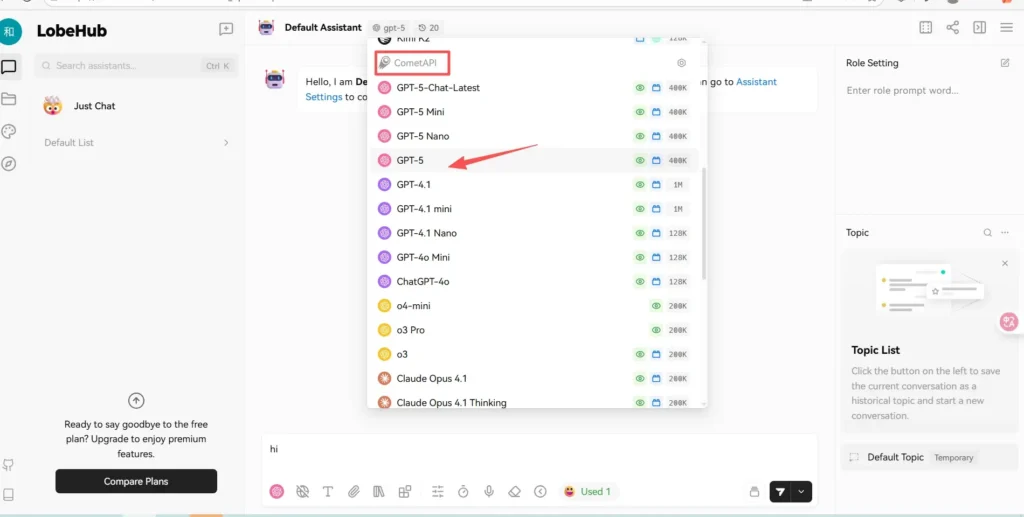

3) Testen des Anrufs

Wählen Sie ein Modell von CometAPI zur Überprüfung aus. Geben Sie einen einfachen Testbefehl im Lobe-Chat ein. Bei erfolgreichem Aufruf erhalten Sie eine entsprechende Antwort. Bei einem Fehler überprüfen Sie die korrekte Konfiguration oder kontaktieren Sie den Cometapi Online-Kundenservice.

Derzeit bietet Cometapi auf Lobechat mehr als 30 aktuelle Modelle von großen Entwicklern (OpenAI, Grok, Claude, Gemini) an.

Wie können Sie die Integration erweitern (erweiterte Verbesserungen)?

Möchten Sie mehr als nur die Grundlagen verstehen? Hier sind die nächsten Schritte, die Ihre Integration von der Funktions- zur Produktionsreife bringen.

Verbesserung 1: Dynamische Modellorchestrierung (Multi-Modell-Agenten)

Erstellen Sie in LobeChat eine Agentenlogik, die Teilaufgaben dynamisch an verschiedene Comet-Modelle verteilt (z. B. ein kleines Einbettungsmodell für den Abruf, ein mittleres Modell für den Entwurf und ein leistungsstarkes Modell für die Zusammenfassung). Nutzen Sie das Funktionsaufruf-/Plugin-System von LobeChat, um den Workflow zu koordinieren und die endgültigen Antworten zu aggregieren.

Verbesserung 2: Zwischenspeichern von Einbettungen und Antworten

Wenn Sie Einbettungen (für RAG) verwenden, berechnen Sie die Einbettungen einmal und speichern Sie sie im Cache, um den Overhead zu reduzieren. Wenn Sie CometAPI für Einbettungen aufrufen, speichern Sie Vektordarstellungen in Ihrer Vektordatenbank und führen Sie nur bei Inhaltsänderungen eine Neuberechnung durch. Dies reduziert Token und Kosten.

Verbesserung 3: Konfiguration und Kontingente pro Mandant

Wenn Sie eine Multi-Tenant-LobeChat-Instanz betreiben, steuern Sie die Limits pro Mandant (Anfragen/Stunde, Modellstufen), indem Sie eine Middleware schreiben, die die Mandanten-ID → Liste der zulässigen Modelle abbildet (unter Verwendung von CometAPI-Modell-IDs). Dies ermöglicht Premium-Stufen mit Zugriff auf bessere Modelle.

Verbesserung 4: Verwenden Sie Modellmetadaten und Integritätsprüfungen

Implementieren Sie Provider-Integritätsprüfungen, die einen einfachen CometAPI-„Model-Ping“ oder einen minimalen Chat-Aufruf aufrufen, um sicherzustellen, dass die Latenz innerhalb der SLAs liegt. Andernfalls werden Fallback-Modelle ordnungsgemäß abgelehnt. Behalten Sie einen Heartbeat-Monitor und zeigen Sie den Provider-Status in der LobeChat-Admin-Benutzeroberfläche an.

Auf welche Fallstricke sollten Sie achten?

- Offenlegung des API-Schlüssels: Speichern Sie CometAPI-Schlüssel niemals im Clientcode. Bewahren Sie sie immer serverseitig auf (Serverebene von LobeChat).

- Modellnamendrift: CometAPI kann Modell-IDs hinzufügen oder verwerfen. Verwenden Sie eine Serverzuordnung und aktualisieren Sie

COMETAPI_MODEL_LISTwenn Sie neue Modelle vorstellen möchten. - Unterschiede im Antwortformat: Obwohl CometAPI auf OpenAI-Kompatibilität abzielt, können einige Modelle oder Metafelder abweichen. Ordnen Sie Antworten immer zu und bereinigen Sie sie, bevor Sie sie den Benutzern anzeigen.

Erste Schritte

CometAPI ist eine einheitliche API-Plattform, die über 500 KI-Modelle führender Anbieter – wie die GPT-Reihe von OpenAI, Gemini von Google, Claude von Anthropic, Midjourney, Suno und weitere – in einer einzigen, entwicklerfreundlichen Oberfläche vereint. Durch konsistente Authentifizierung, Anforderungsformatierung und Antwortverarbeitung vereinfacht CometAPI die Integration von KI-Funktionen in Ihre Anwendungen erheblich. Ob Sie Chatbots, Bildgeneratoren, Musikkomponisten oder datengesteuerte Analyse-Pipelines entwickeln – CometAPI ermöglicht Ihnen schnellere Iterationen, Kostenkontrolle und Herstellerunabhängigkeit – und gleichzeitig die neuesten Erkenntnisse des KI-Ökosystems zu nutzen.

Erkunden Sie zunächst die Möglichkeiten des Modells in der Spielplatz und konsultieren Sie die API-Leitfaden Für detaillierte Anweisungen. Stellen Sie vor dem Zugriff sicher, dass Sie sich bei CometAPI angemeldet und den API-Schlüssel erhalten haben. CometAPI bieten einen Preis weit unter dem offiziellen Preis an, um Ihnen bei der Integration zu helfen.

Bereit loszulegen? → Melden Sie sich noch heute für CometAPI an !

Fazit

Die Integration von CometAPI in LobeChat bietet eine praktische Möglichkeit, Modellvielfalt, Kostenflexibilität und schnelle Experimentiermöglichkeiten zu erreichen und gleichzeitig die ausgefeilten UX- und RAG-Funktionen von LobeChat beizubehalten. Die LobeChat-Community hat bereits erhebliche Anstrengungen unternommen, um CometAPI-Unterstützung (Providerkarte, Modellliste, Laufzeitadapter, Tests und Dokumentation) hinzuzufügen. Diese können Sie direkt nutzen oder als Inspiration für die Implementierung eines benutzerdefinierten Adapters für spezielle Anforderungen verwenden. Die genauesten Integrationsschritte und die neuesten Beispiele finden Sie in der CometAPI-Dokumentation und im LobeChat-Modellanbieter-Dokumente und Repo – die unten aufgeführten Links helfen Ihnen weiter.