MiniMax‑M2.5 ist ein neues, produktivitätsorientiertes großes Sprachmodell von MiniMax, das für Coding, agentischen Tool‑Einsatz und Office‑Workflows optimiert ist. Sie können es über die native MiniMax‑Plattform oder über API‑Aggregatoren wie CometAPI aufrufen. Für die Nutzung der API müssen Sie lediglich den CometAPI‑API‑Key beziehen, da Minimax‑M2.5 auch das Chat‑Format unterstützt.

Was ist MiniMax‑M2.5?

MiniMax‑M2.5 ist die neueste große Modellveröffentlichung von MiniMax: eine Weiterentwicklung der M2‑Familie, die das Unternehmen als Allzweck‑, agentenfähiges Modell positioniert – mit besonders starker Performance bei Code‑Generierung, Tool‑Nutzung und mehrstufigem Reasoning. Die M2.5‑Familie wurde als Veröffentlichung für Februar 2026 angekündigt und umfasst sowohl die Standard‑M2.5‑Variante als auch „highspeed“-Varianten, die auf geringere Latenz bei gleichen Kernfähigkeiten optimiert sind. Die M2.5‑Familie verbesserte Benchmark‑Ergebnisse in Software‑Engineering‑Evaluierungen und das Verhalten bei der Interaktion mit externen Tools (Suche, Agenten usw.).

Der Anbieter positioniert M2.5 als Weiterentwicklung gegenüber früheren M2.x‑Releases mit stärkerem Reasoning, besserer Code‑Generierung und verbesserter Zuverlässigkeit beim Tool‑Aufruf. MiniMax’ öffentliche Release Notes von Anfang Februar 2026 markierten M2.5 als Meilenstein: verfeinertes Instruction Tuning, stärkeres Codeverständnis und messbare Zugewinne auf mehreren codefokussierten Benchmarks. Das Release umfasst:

- Ein Standard‑M2.5‑Modell (mit Schwerpunkt auf Genauigkeit und Schlussfolgerungsvermögen).

- Eine M2.5‑highspeed‑Variante mit geringerer Latenz für interaktive Entwickler‑Workflows.

- Explizite Leitlinien und Abrechnungsoptionen für einen „Coding Plan“, der auf intensive Code‑Generierung ausgelegt ist.

Zentrale technische Highlights

- Architektur: MoE (große Gesamtparameterzahl mit deutlich kleinerem aktivem Satz während der Inferenz), was für anspruchsvolle Aufgaben ein günstiges Kosten/Leistungs‑Verhältnis ermöglicht.

- Stärken: State‑of‑the‑Art‑Coding‑Performance, mehrstufiges Reasoning, Long‑Context‑Verarbeitung sowie Agenten/Tool‑Integrationen.

- Varianten: MiniMax veröffentlicht Varianten (z. B.

MiniMax-M2.5undM2.5-highspeed), die auf Durchsatz vs. Latenz abgestimmt sind.

Warum das heute wichtig ist: Viele Teams, die Entwickler‑Tools, Programmier‑Assistenten und agentische Automatisierungen bauen, schätzen ein Modell, das über mehrere Turns hinweg schlüssig argumentiert, Tools sicher aufruft und hochwertigen Code ausgibt. M2.5 wird – dank Architektur‑ und Trainingsentscheidungen – explizit für diese Szenarien vermarktet.

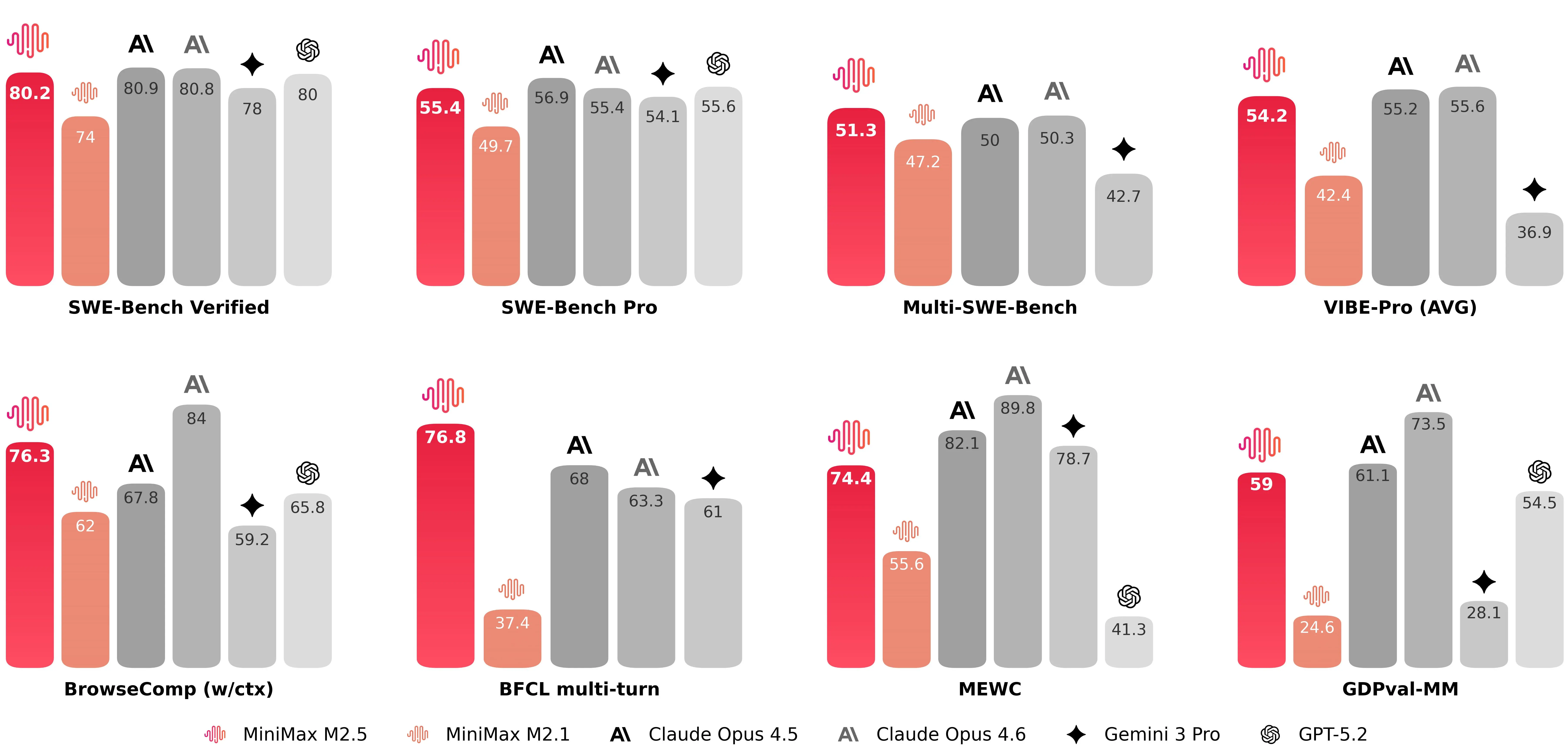

Benchmarking von MiniMax‑M2.5

Einordnung von M2.5 auf coding‑spezifischen Benchmarks

MiniMax‑M2.5 erzielt 80,2 % auf SWE‑Bench Verified, zusammen mit starken Werten auf Multi‑Task‑Coding‑ und Browsing‑augmentierten Benchmarks (vom Unternehmen veröffentlichte Zahlen umfassen 51,3 % auf Multi‑SWE‑Bench und 76,3 % auf BrowseComp bei aktiviertem Kontextmanagement). Diese Werte positionieren M2.5 zum Launch unter den leistungsstärksten öffentlich verfügbaren Modellen für Code‑Generierung und Problemlösung. Der Start von MiniMax‑M2.5 bestätigt, dass M2.5 mit der Top‑Liga der Coding‑Modelle konkurriert.

Für Entwickler ist der Nutzen zweifach:

- Höhere Erfolgsquote beim ersten Durchlauf: weniger Korrekturrunden, weniger manuelles Debugging und geringerer „Babysitting“-Aufwand für autonome Coding‑Agenten.

- Bessere Full‑Stack‑Abdeckung: M2.5 wird als Unterstützung für Full‑Stack‑Workflows über Desktop‑Apps, Mobile und Cross‑Platform‑Toolchains beschrieben – es zielt darauf ab, nicht nur Snippets, sondern kohärente Multi‑File‑Lösungen und Build‑Skripte zu generieren.

Für agentische Workflows gebaut

M2.5 wird als „nativ für Agent‑Szenarien ausgelegt“ beschrieben. Praktisch bedeutet das, dass Architektur und Trainingsregime priorisieren:

- Zuverlässigkeit bei Tool‑Aufrufen: API‑Calls absetzen oder Shell/SQL‑Befehle mit korrekter Syntax und Parametern ausführen.

- Kontextwechsel und Gedächtnis: einen unterbrochenen mehrstufigen Vorgang fortsetzen, ohne zuvor berechneten Zustand zu verlieren.

- Dateiverarbeitung: gängige Office‑Formate programmgesteuert erstellen und bearbeiten (z. B. eine Powerpoint erzeugen und anschließend auf Basis einer Rückfrage überarbeiten).

Suche und Browsing‑Augmentierung

Wenn M2.5 mit Browsing‑ oder Retrieval‑Schichten kombiniert wird, berichtet MiniMax von deutlich verbesserten Scores auf Browsing‑Benchmarks – ein Hinweis auf stärkere Leistungen beim Integrieren externer Informationen und Zitate in Ausgaben. Dadurch eignet sich M2.5 für Tools, die aktuelle Inhalte abrufen, API‑Ergebnisse gegenprüfen oder Code‑Generierung mit Real‑World‑Daten anreichern müssen (z. B. die neuesten SDK‑Docs abrufen und bei der Code‑Generierung korrekt verwenden). Diese Fähigkeiten sind relevant für Teams, die „agentische“ Features wie automatisiertes QA, CI‑Toolchains oder dokumentgetriebene Assistenten bauen.

Wie kann ich die MiniMax‑2.5‑API (über CometAPI) nutzen?

CometAPI ist eine API‑Aggregationsplattform, die Hunderte Modelle über eine einzige, OpenAI‑kompatible REST‑Oberfläche bereitstellt. Da die CometAPI‑Schnittstelle die OpenAI‑Chat/Completions‑Endpunkte spiegelt, können Sie oft bestehende OpenAI‑ähnliche Clients weiterverwenden, indem Sie api_base und den API‑Key umstellen. Wenn Sie nicht direkt mit der MiniMax‑Plattform integrieren möchten (etwa wegen einheitlicher Abrechnung, Multi‑Modell‑A/B‑Tests oder Anbieterabstraktion), können Sie MiniMax‑M2.5 über die „chat“-Oberfläche von CometAPI aufrufen. Die CometAPI‑Plattform stellt ein konsistentes Request‑Format, ein SDK und ein Web‑Playground bereit — und sie führt pro‑Modell Namen und Parameter (Sie wählen beim Aufruf den genauen Provider/Modell‑String).

Unten steht eine kompakte, praxisnahe Anleitung für Aufrufe von MiniMax‑M2.5 über CometAPI, mit Beispielen in curl und Python.

Was sind die grundlegenden Schritte für den Einstieg?

- Erstellen Sie ein CometAPI‑Konto und holen Sie einen API‑Key ein. (CometAPI bietet einen Playground und SDKs, um Modelle zu testen.)

- Prüfen Sie die Modellauswahl von CometAPI oder den CometAPI‑Playground, um den exakten Modellnamen für MiniMax‑M2.5 zu finden.

- Senden Sie eine authentifizierte POST‑Anfrage mit dem

model‑Parameter auf das gewählte MiniMax‑Modell und einer Payload gemäß CometAPIs Chat/Completion‑Schema. - Passen Sie Parameter (temperature, max_tokens, System‑Nachrichten, Streaming) an Ihren Workflow an.

Authentifizierung & Endpunkt‑Grundlagen

- Base URL:

https://api.cometapi.com/v1(OpenAI‑ähnliche Pfade wie/chat/completionswerden unterstützt). - Header:

Authorization: Bearer YOUR_COMETAPI_KEY - Content‑Type:

application/json - Model‑Feld: Verwenden Sie den exakten Modell‑String aus dem Modellkatalog von CometAPI (Beispiele:

"minimax-m2.5"

Beispiel 1 — Schnelles curl (REST, OpenAI‑Style)

# Replace $COMETAPI_KEY with your CometAPI key

curl -s -X POST "https://api.cometapi.com/v1/chat/completions" \

-H "Authorization: Bearer $COMETAPI_KEY" \

-H "Content-Type: application/json" \

-d '{

"model": "minimax-m2.5",

"messages": [

{"role":"system","content":"You are a concise, safety-conscious coding assistant."},

{"role":"user","content":"Refactor this synchronous Python function to async and add basic error handling:\n\n```\ndef fetch(user_id):\n resp = http_get(f\"https://api.example.com/users/{user_id}\")\n return resp.json()\n```"}

],

"max_tokens": 800,

"temperature": 0.0,

"stream": false

}'

Hinweise:

- Verwenden Sie die Modellzeichenfolge genau wie im CometAPI‑Katalog angegeben; s.

stream: truewird für Streaming‑Ausgaben unterstützt (verarbeiten Sie Server‑Sent Events oder gestreamte Antworten, wenn Sie partielle Tokens empfangen möchten).

Beispiel 2 — Python (requests) für eine Chat‑Completion

import os, requests

COMET_KEY = os.environ.get("COMETAPI_KEY") # recommended

URL = "https://api.cometapi.com/v1/chat/completions"

headers = {

"Authorization": f"Bearer {COMET_KEY}",

"Content-Type": "application/json",

}

payload = {

"model": "minimax-m2.5", # or "minimax/minimax-m2.5" — verify Comet's model page

"messages": [

{"role": "system", "content": "You are a helpful engineer who returns clear, tested code."},

{"role": "user", "content": "Write a pytest for the following function that asserts edge cases..."}

],

"temperature": 0.1,

"max_tokens": 1000,

}

r = requests.post(URL, json=payload, headers=headers, timeout=120)

r.raise_for_status()

out = r.json()

print(out["choices"][0]["message"]["content"])

Beispiel 3 — Verwendung von litellm/CometAPI‑Integration (Python‑Komfortschicht)

CometAPI wird von mehreren Community‑SDKs und ‑Adaptern unterstützt. Die liteLLM‑Dokus zeigen einen kompakten Ablauf, bei dem Sie COMETAPI_KEY setzen und das Modell per Name aufrufen. Ideal zum Prototyping:

import os

from litellm import completion

os.environ["COMETAPI_KEY"] = "your_cometapi_key_here"

messages = [{"role":"user", "content":"Explain async/await in Python in 3 bullets."}]

resp = completion(model="minimax-m2.5", messages=messages)

print(resp.choices[0].message.content)

LiteLLM/Comet‑Integrationen bieten nützliche Utilities (Streaming, async, expliziter api_key‑Parameter), die viele bestehende OpenAI‑SDK‑Muster widerspiegeln.

Wie sollten Sie Prompts und Systemmeldungen für M2.5 gestalten

Rolle und Randbedingungen explizit machen

Geben Sie M2.5 beim Anfordern von Code eine klare Systemrolle. Beispiel:

{"role": "system","content": "You are MiniMax M2.5, an assistant specialized in robust, readable, and well-documented code. Use Python 3.11 conventions, include type hints, and provide brief unit tests."}

Schrittweise Zerlegung für komplexe Probleme

Wenn Sie M2.5 mit der Implementierung komplexer Features betrauen, verwenden Sie eine kurze Zerlegung:

- Fordern Sie eine Design‑Skizze an.

- Bitten Sie um Interface‑Signaturen.

- Fordern Sie Implementierung und Tests an.

Das verringert das Halluzinationsrisiko und führt zu modularen, review‑freundlichen Ergebnissen.

Temperatur, max_tokens und Sicherheit

- Für deterministischen Code: setzen Sie

temperaturenahe 0,0. - Für exploratives Design:

temperaturezwischen 0,2–0,5 kann kreative Ansätze hervorbringen. - Halten Sie

max_tokensgroßzügig bemessen für große Refactorings oder lange Test‑Suiten.

Nach Unit‑Tests und Begründung fragen

Wenn Sie Code anfordern, bitten Sie auch um Unit‑Tests und eine kurze Erklärung des Algorithmus. Das hilft, subtile Bugs zu erkennen und beim ersten Durchlauf lauffähige Artefakte zu erhalten.

Long‑Task‑Inference und Zustandsverfolgung

Das M2.5‑Modell verfügt über einen ausgezeichneten Mechanismus zur Zustandsverfolgung, der die Kontinuität und Zielgerichtetheit des Denkprozesses über lange Zeitsequenzen sicherstellt, indem es sich jeweils auf eine begrenzte Zahl von Zielen konzentriert statt alles parallel zu verarbeiten. M2.5 ist kontextsensitiv ausgestattet und ermöglicht effiziente Aufgabenausführung sowie optimiertes Kontextmanagement.

Praktische M2.5‑Tipps für den Produktionseinsatz

MiniMax‑M2.5 ist für mehrstufige Toolings und Code abgestimmt. Im Folgenden finden Sie praxisnahe, erfahrungsbasierte Tipps, um in der Produktion die besten Ergebnisse zu erzielen.

Prompt Engineering & Systemmeldungen

- Verwenden Sie explizite Systemnachrichten zu Rolle und Randbedingungen. Für Code‑Aufgaben nennen Sie die erforderliche Laufzeit/Test‑Frameworks (z. B. „Gib ein mit Python 3.11 kompatibles pytest zurück“).

- Liefern Sie Kontext: Für agentische oder mehrstufige Jobs fügen Sie Schritt‑Metadaten und Tool‑Beschreibungen als strukturiertes JSON oder Aufzählungen bei. M2.5 reagiert gut auf strukturierte Eingaben, da es für die Tool‑Nutzung optimiert ist.

Funktions‑/Tool‑Aufrufe

- Wenn Sie CometAPI als Gateway für Tool‑Calling verwenden, stellen Sie sicher, dass Ihre Zusatzfelder (z. B.

function_callim OpenAI‑Stil) den Erwartungen von CometAPI/Modell entsprechen. Bestätigen Sie die Modellunterstützung auf der Comet‑Modellseite, da sich Tool‑Semantiken je nach Anbieter unterscheiden können. - Für robuste Orchestrierung teilen Sie große Aufgaben in kleinere Aufrufe und halten Sie deterministische Checkpoints ein. M2.5 befolgt mehrstufige Anweisungen sehr gut, doch die zuverlässigste Performance erhalten Sie, wenn Sie jeden Schritt validieren.

Temperatur, max_tokens und Kostenkontrolle

- Für Code‑Generierung oder Refactoring: niedrige

temperature(0,0–0,2) undmax_tokenspassend zur erwarteten Ausgabelänge wählen. - Für explorative Prompts:

temperatureerhöhen, aber den steigenden Tokenverbrauch im Blick behalten. Beim Routing über CometAPI Preise der Anbieter und Fallback‑Regeln vergleichen — CometAPI listet Token‑Preise pro Modellinstanz im Katalog.

Kontextfenster & lange Dokumente

- M2.5‑Varianten unterstützen häufig lange Kontexte (prüfen Sie die Modellspezifikation zur Kontextlänge). Für sehr lange Dokumente: segmentieren und zusammenfassen — dann die Zusammenfassungen plus relevante Segmente statt kompletter Dateien senden.

Sicherheit, toxische Inhalte und Halluzinationsminderung

- Setzen Sie Guardrails: Systemnachrichten, externe Validatoren und Test‑Suiten (z. B. Unit‑Tests für generierten Code) reduzieren Risiken.

- Externe Referenzen validieren: Wenn das Modell Fakten oder Code aus dem Web zitiert, programmatisch verifizieren, bevor Sie diese Ergebnisse vertrauen oder ausliefern.

Häufige Fallstricke und wie man sie vermeidet

Fallstrick: Übermäßiges Vertrauen in eine einzelne Modellausgabe

Gegenmaßnahme: Tests und statische Checks ausführen und für kritische Logik mehrere unabhängige Completions anfordern und vergleichen. CometAPI erlaubt das Umschalten zwischen mehreren Modellen, und Sie können jederzeit zwischen ihnen wechseln, indem Sie das OpenAI‑Chatformat verwenden.

Fallstrick: Hohe Temperatur für produktiven Code verwenden

Gegenmaßnahme: temperature niedrig halten; wenn Sie kreative Alternativen benötigen, mehrere Low‑Temperature‑Varianten anfordern oder das Modell um Erklärungen der Unterschiede bitten.

Fallstrick: Modellversionierung ignorieren

Gegenmaßnahme: Modellnamen und Provider‑Strings in Ihren Deployment‑Manifests nachverfolgen. Wenn Sie von MiniMax-M2.5 zu MiniMax-M2.5-highspeed oder zu einem anderen Anbieter wechseln, behandeln Sie dies als Release‑Änderung und führen Sie Regressionstests durch.

Abschließende Empfehlungen und realistische Erwartungen

MiniMax‑M2.5 ist ein bemerkenswerter Schritt nach vorn für codezentrierte, agentische LLMs — es verspricht starke Code‑Generierung, mehrstufiges Reasoning und tool‑sicheres Verhalten. Wenn die Prioritäten Ihres Teams robuste Developer‑Tools, Agent‑Frameworks oder Code‑Assistenten sind, verdient M2.5 einen Platz in Ihrer Vergleichsmatrix. Die Nutzung von CometAPI als einheitliches Gateway kann die Experimentierphase beschleunigen und ermöglicht, Anbieter oder Modelle zu wechseln bzw. A/B‑Tests zu fahren, ohne die gesamte Integration neu zu bauen.

Einige pragmatische Kernaussagen:

- Schnell im CometAPI‑Playground prototypen, dann Modell‑Bezeichner im Code fixieren.

- Niedrige Temperatur verwenden, um Tests und Erklärungen bitten und stets automatisierte Validierung ausführen.

- Das Modell als leistungsstarken Co‑Developer behandeln — nicht als unfehlbaren: menschliches Review, CI‑Pipelines und Telemetrie anwenden.

Entwickler können auf MInimax‑M2.5 über CometAPI zugreifen. Für den Einstieg erkunden Sie die Fähigkeiten des Modells im Playground und konsultieren den API guide für detaillierte Anweisungen. Stellen Sie vor dem Zugriff sicher, dass Sie sich bei CometAPI angemeldet und den API‑Key erhalten haben. CometAPI bietet einen deutlich günstigeren Preis als den offiziellen, um Ihre Integration zu erleichtern.

Bereit loszulegen?→ Noch heute für M2.5 registrieren !

Wenn Sie mehr Tipps, Leitfäden und Neuigkeiten zu KI erfahren möchten, folgen Sie uns auf VK, X und Discord!