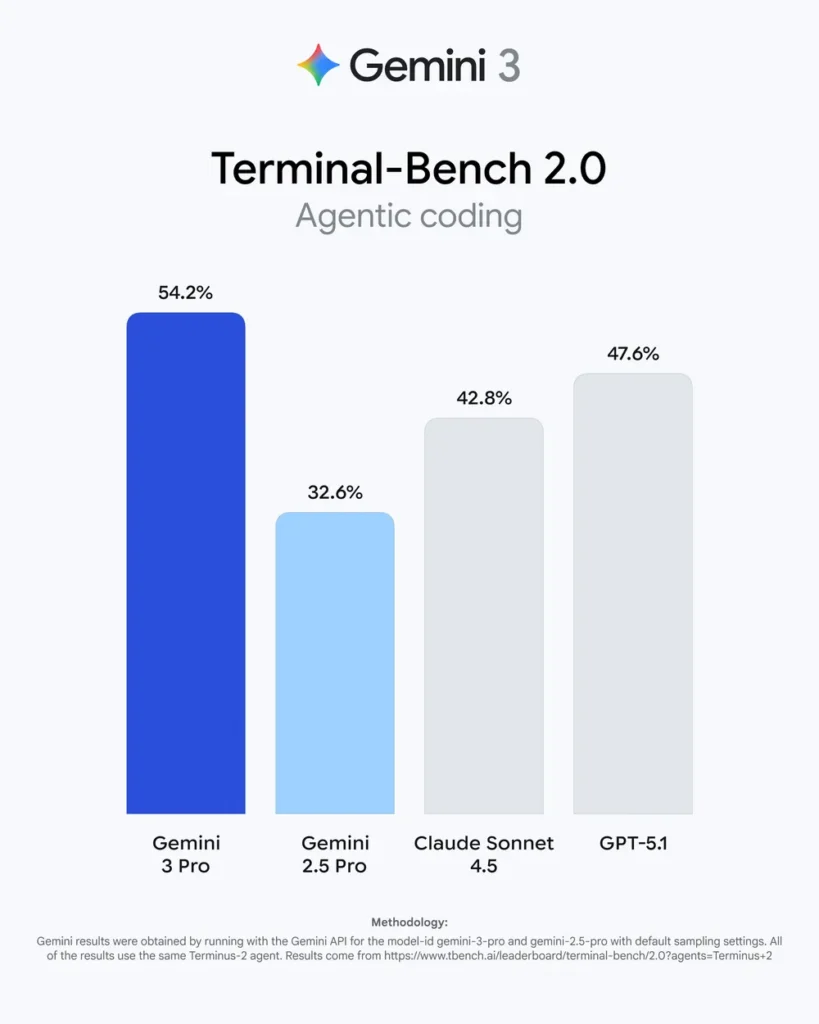

Google hat soeben die Gemini-3-Ära eingeläutet und Gemini 3 Pro als Preview veröffentlicht. Die ersten Signale sind eindeutig: Es ist ein großer Schritt nach vorn bei multimodalem Reasoning, Coding-Agents und dem Verständnis sehr langer Kontexte. Das Modell wird als Googles bislang leistungsfähigstes Reasoning- und Multimodal-Modell positioniert, optimiert für agentische Workflows, Coding, Long-Context-Aufgaben und multimodales Verständnis. Es wird mit einem neuen „Deep Think“-Reasoning-Modus ausgeliefert, zeigt dramatische Verbesserungen bei Agenten-/Code-Benchmarks (Terminal-Bench 2.0 mit 54,2 % angegeben) und ist sofort über Google AI Studio, API (Vertex AI-Integrationen) und Entwickler-Tools wie Google Antigravity nutzbar.

What is Gemini 3 Pro Preview?

Gemini 3 wird von Google als die nächste Generation und das intelligenteste Mitglied der Gemini-Familie präsentiert — mit Fokus auf tieferes Reasoning, reichhaltigeres multimodales Verständnis (Text, Bilder, Video, Audio, Code) und besseres agentisches Verhalten (Modelle, die mit Tools planen und handeln).

Headline features

- Native multimodale Verständnisfähigkeit — entwickelt, um Text, Bilder, Audio und Video gemeinsam zu akzeptieren und darüber zu schlussfolgern (einschließlich langer/Videoeingaben). Hervorragend zum Kombinieren von Dokumenten, Screenshots, Transkripten und Video.

- Riesiges Kontextfenster (bis zu ~1.000.000 Tokens) — kann extrem lange Dokumente, große Codebasen oder stundenlange Transkripte in einer einzigen Sitzung aufnehmen/im Kontext halten. Das ist ein Kern-Value-Prop für Deep Research, Code-Review und Synthese über mehrere Dokumente.

- Agentische / Tool-Use-Fähigkeit — entwickelt, um autonome Agenten zu betreiben, die Tools aufrufen, Terminals bedienen, Aufgabenpläne verwalten und mehrstufige Workflows koordinieren (verwendet in Google Antigravity und anderen IDE-Integrationen). Das macht es besonders stark für Coding, Orchestrierung und mehrstufige Automatisierung.

- Stärkeres Reasoning & Coding — Google positioniert Gemini 3 Pro als sein bestes „denkendes“ Modell für komplexes Reasoning, Mathematik und Code-Aufgaben (verbesserte Benchmarks und Terminal-/Tool-Performance).

What’s new in Gemini 3 Pro compared with Gemini 2.5 Pro and others?

Which capabilities improved the most?

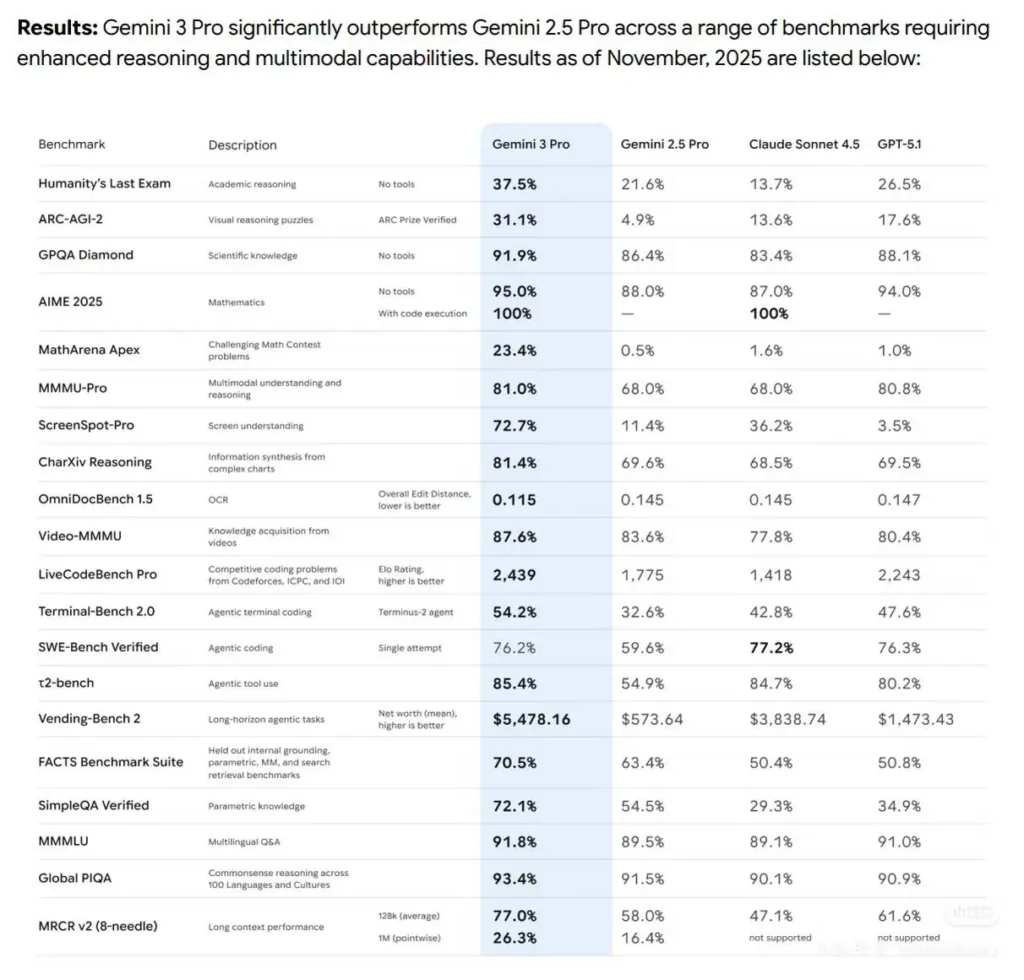

Gemini 3 Pro wird als großer Fortschritt in Reasoning (mathematisches und naturwissenschaftliches Reasoning), multimodalem räumlich/visuellem Reasoning und Toolnutzung vermarktet. Google hebt klare Zugewinne gegenüber Gemini 2.5 Pro in Benchmark-Suites und in realen agentischen Aufgaben wie Coding und Terminal-Automatisierung hervor. Beispielhafte Headline-Metriken, die das Team veröffentlicht hat, umfassen:

| Benchmark / task | Gemini 3 Pro (reported) | Gemini 2.5 Pro (reported) | Absolute gap (pp) |

|---|---|---|---|

| Humanity’s Last Exam (academic reasoning, no tools) | 37.5% | 21.6% | +15.9. |

| GPQA Diamond (scientific / factual QA) | 91.9% | 86.4% | +5.5. |

| AIME 2025 (mathematics, no tools) | 95.0% | 88.0% | +7.0. |

| AIME with code execution | 100.0% | (2.5 Pro: — ) | — (3 Pro hits perfect score with execution). |

| ARC-AGI-2 (visual reasoning puzzles) | 31.1% | 4.9% | +26.2 — very large multimodal gain. |

| SimpleQA Verified (parametric knowledge) | 72.1% | 54.5% | +17.6. |

Diese Zahlen signalisieren, dass Gemini 3 Pro für mehrstufiges Reasoning, komplexe Toolnutzung und eng integrierte multimodale Aufgaben optimiert ist (z. B. Kombination aus Videoframes, Diagramm-Reasoning und Codegenerierung).

Agentic-first developer tooling: Antigravity

Um agentische Workflows zu demonstrieren, hat Google Antigravity veröffentlicht — eine „agent-first“ IDE, die Gemini 3 Pro als Fundament für Multi-Agent-Coding-Workflows verwendet. Antigravity ermöglicht es Agenten, direkt mit Editor, Terminal und Browser zu interagieren, und „Artifacts“ (Aufgabenlisten, Screenshots, Browser-Aufzeichnungen) zu erzeugen, die Agentenaktionen dokumentieren — und so Nachvollziehbarkeit und Reproduzierbarkeit in agentischer Entwicklung adressieren. Dadurch wird Gemini 3 Pro für reale Entwickler-Workflows weitaus praktischer als Modelle, die sich ausschließlich auf Textgenerierung konzentrieren.

Better tool use and coding

Google berichtet über dramatische Verbesserungen bei einem terminalzentrierten Benchmark (Terminal-Bench 2.0), der die Fähigkeit eines Modells misst, einen Computer über das Terminal zu bedienen: Gemini 3 Pro erzielt 54,2 % in diesem Test — ein großer Sprung im Vergleich zu früheren Gemini-Versionen — was realen Fortschritt in autonomer Toolnutzung und Codegenerierung anzeigt.

insbesondere wenn es darum geht, Skripte auszuführen, Tools zu orchestrieren oder mehrstufige Entwickleraufgaben zu verwalten. In der Praxis bedeutet das weniger Halluzinationen bei der Befehlsausführung, besseres Error-Handling und eine verbesserte Fähigkeit, sich von fehlgeschlagenen Schritten zu erholen.

How does Gemini 3 Pro perform on benchmarks

Google veröffentlichte eine breite Suite von Benchmark-Vergleichen im Gemini-3-Blogpost, die klassische NLP-Reasoning, multimodales Verständnis, Codegenerierung und agentische Toolnutzung umfassen. Wichtige, direkt von Google gemeldete Zahlen umfassen:

- LMArena: Gemini 3 Pro erzielte 1501 Elo, eine Top-Platzierung auf dem kompetitiven Leaderboard (Messung von allgemeinem Reasoning/Antwortqualität in Paarvergleichen).

- MMMU-Pro (multimodal benchmark): 81 % — ein deutlicher Anstieg gegenüber früheren Modellen.

- Video-MMMU: 87,6 % bei video-bewussten multimodalen Aufgaben.

- SimpleQA Verified: 72,1 %, was Verbesserungen in faktischem QA bei komplexen Eingaben zeigt.

- WebDev Arena: 1487 Elo (Webentwicklung / Code-Reasoning).

- Terminal-Bench 2.0 & SWE-bench Verified: große Sprünge in agentischer Toolnutzung und Coding-Agent-Performance.

- Deep Think: weitere Zuwächse bei Aufgaben mit höchstem Schwierigkeitsgrad (z. B. Verbesserung von Humanity’s Last Exam von 37,5 % auf 41,0 % in Deep Think bei einigen gemeldeten Metriken).

All dies weist auf ein Modell hin, das auf Tiefe statt nur oberflächliche Textgenerierung getrimmt ist.

Also: Ja, Gemini 3 Pro liegt heute über viele Tests hinweg konsistent im oberen Feld — aber „zerstört“ hängt von der Aufgabe ab. Für reine Codegenerierung bleiben einige Wettbewerber Kopf an Kopf; bei Long-Context, Mathematik und multimodaler Synthese wird Gemini 3 Pro in frühen Läufen im November/November 2025 häufig als Klassenbester berichtet.

How can you access Gemini 3 Pro Preview?

Official entry points

Google hat Gemini 3 Pro in der Preview über mehrere Oberflächen verfügbar gemacht:

- Gemini-App (Konsumenten / Pro-Nutzer): Das Modell wird im Rahmen des „Gemini 3“-Starts in der Gemini-App ausgerollt.

- Google AI Studio / Gemini Developer API: Entwickler können über AI Studio und die Gemini Developer API experimentieren. Die API verfügt über REST- und SDK-Schnittstellen und unterstützt fortgeschrittene Funktionen wie Function Calling und Streaming.

- Vertex AI (Google Cloud): Unternehmen und Teams können über Vertex AI auf Gemini 3 Pro für Produktion und MLOps-Workflows zugreifen. Vertex unterstützt Beispiele in Python, Node, Java, Go und curl.

- Third-party integrations (CometAPI): CometAPI bietet Zugriff auf die Gemini 3 Pro API, mit dem Aufrufnamen gemini-3-pro-preview. CometAPI bietet einen Preis, der deutlich unter dem offiziellen Preis liegt, um die Integration zu erleichtern.

Quickstart: Python example (official SDK pattern)

Nachfolgend ein minimales, praxisnahes Python-Beispiel, adaptiert aus Googles Gemini-Quickstart, das den Aufruf der Gemini-API über Googles GenAI-Client demonstriert. Ersetzen Sie GEMINI_API_KEY durch Ihren API-Schlüssel aus Google AI Studio oder Ihrem GCP-Projekt.

# Example: call Gemini 3 Pro Preview using Google GenAI Python SDK

# Requires: pip install google-generativeai

import os

from google import genai

# Set API key in environment:

# export GEMINI_API_KEY="YOUR_API_KEY"

client = genai.Client() # client picks up GEMINI_API_KEY from env

# Use the preview model identifier. The exact model ID may vary; use the ID listed in the API docs.

model_id = "gemini-3-pro-preview" # or "gemini-3-pro" depending on availability

prompt = """

You are an assistant that writes a short Python function to fetch JSON from a URL,

handle HTTP errors, and return parsed JSON or None on failure.

"""

resp = client.models.generate_content(model=model_id, contents=prompt)

print("MODEL RESPONSE:\n", resp.text)

Wenn Sie CometAPI wählen, ersetzen Sie url durch https://api.cometapi.com/v1/chat/completions und key durch den von CometAPI erhaltenen Schlüssel.

How to get the best results — prompt patterns and tips

Use “thinking” mode for hard problems

Wenn Sie progressive Reasoning- oder komplexe Mathematik-/Code-Aufgaben lösen, aktivieren Sie die „thinking“-Variante der Preview (falls verfügbar) — sie weist mehr interne Reasoning-Schritte zu und liefert oft zuverlässigere Lösungen bei mehrstufigen Aufgaben. Prüfen Sie in der Konsole die Modellnamen auf ein -thinking-Suffix.

Function calling & tool orchestration

Nutzen Sie deklarierte Funktionen (Vertex AI/GenAI Function Calling) für zuverlässige, strukturierte Ausgaben und zur Reduktion von Halluzinationen. Lassen Sie das Modell Funktionsaufrufe vorschlagen und führen Sie diese deterministisch in Ihrer Umgebung aus. Die Function-Calling-Dokumentation enthält Beispiele für die Rückgabe typisierter JSON-Argumente, die Sie sicher ausführen können.

Grounding when you need up-to-date facts

Wenn Ihre App von aktuellen Web-Fakten abhängt, verwenden Sie Web-Grounding, achten Sie jedoch auf die Kosten und Rate Limits für Grounded Prompts. Grounding ist leistungsfähig — es ermöglicht Gemini, Search oder Maps abzufragen — aber jede grounded Abfrage kann Ihre Abrechnung und Latenz beeinflussen.

How Gemini 3 Pro stacks up in real-world tasks (use cases)

Code generation & developer productivity

Gemini 3 Pro verbessert das Reasoning über mehrere Dateien, langen Repository-Kontext und die Synthese von Tests/Dokumentation neben dem Code. In Kombination mit Function Calling und einem Terminal-Agenten kann es mittelgroße Projekte schneller aufsetzen und validieren als ältere Modelle. Community-Tests zeigen erhöhte LiveCodeBench/Elo-Coding-Werte.

Research & STEM workflows

Die Deep-Think-Fähigkeit des Modells und das größere Reasoning-Budget machen es gut geeignet für Forschungstätigkeiten, die mehrstufige mathematische Ableitungen, Datensatz-Synthese oder die Zusammenfassung mehrerer Dateien eines Papers erfordern. Frühe Benchmark-Ergebnisse platzieren es bei vielen STEM-Datensätzen an der Spitze oder nahe daran.

Content design, multimodal creative workflows

Die multimodalen Ausgaben von Gemini 3 Pro und die Integration mit Veo/Whisk/Flow machen es zu einer starken Wahl für Workflows, die Text, Bilder und Video mischen — von Marketing-Storyboards bis zu automatisierten Videorohfassungen. Google bündelt bestimmte Creator-Tools in AI Ultra für Creator, die die höchsten Limits wünschen.

Conclusion: does Gemini 3 Pro crush other models?

Gemini 3 Pro Preview ist ein großer Schritt nach vorn. Über eine breite Palette von Benchmarks und in frühen Real-World-Tests führt es häufig oder liegt gleichauf mit den besten verfügbaren Modellen Ende 2025, insbesondere in:

- Komplexem Reasoning (Mathe / STEM)

- Multimodalem Verständnis und Synthese

- Agentischen Workflows und Function Calling

Die Spanne variiert jedoch je nach Aufgabe. Für manche eng umrissenen Aufgaben (bestimmte kreative Schreibstile oder sehr spezialisiertes Domänenwissen) können andere Modelle weiterhin konkurrenzfähig oder — je nach Kosten/Latenz und Ökosystem-Fit — vorzuziehen sein. Benchmarks und geleakte Scores deuten darauf hin, dass Gemini 3 Pro oft topplatziert ist, aber „dominieren“ ist aufgabenabhängig — für viele Enterprise- und Entwickler-Use-Cases ist Gemini 3 Pro nun das erste Modell, das evaluiert werden sollte.

How to get started with CometAPI

CometAPI ist eine einheitliche API-Plattform, die über 500 KI-Modelle führender Anbieter — wie OpenAIs GPT-Serie, Googles Gemini, Anthropics Claude, Midjourney, Suno und mehr — in einer einzigen, entwicklerfreundlichen Schnittstelle bündelt. Durch einheitliche Authentifizierung, Request-Formatierung und Response-Handling vereinfacht CometAPI die Integration von KI-Funktionen in Ihre Anwendungen erheblich. Ob Sie Chatbots, Bildgeneratoren, Musikkomponisten oder datengestützte Analytics-Pipelines bauen — mit CometAPI iterieren Sie schneller, kontrollieren Kosten und bleiben anbieterunabhängig, während Sie gleichzeitig die neuesten Durchbrüche im KI-Ökosystem nutzen.

Entwickler können über CometAPI auf die Gemini 3 Pro Preview API zugreifen. Beginnen Sie, indem Sie die Modellfähigkeiten von CometAPI im Playground erkunden und den API-Leitfaden für detaillierte Anweisungen konsultieren. Bevor Sie zugreifen, stellen Sie bitte sicher, dass Sie sich bei CometAPI angemeldet und den API-Schlüssel erhalten haben. CometAPI bietet einen Preis, der deutlich unter dem offiziellen Preis liegt, um die Integration zu erleichtern.

Bereit? → Melden Sie sich noch heute bei CometAPI an!

Wenn Sie mehr Tipps, Leitfäden und News zu KI erfahren möchten, folgen Sie uns auf VK, X und Discord!