Kling 2.1 markiert einen bedeutenden Fortschritt im sich rasant entwickelnden Bereich der KI-gesteuerten Videoproduktion. Kling 2025 wurde im Mai 2.1 von der KI-Forschungsabteilung von Kuaishou eingeführt und baut auf dem Erfolg seiner Vorgänger (Kling 1.6 und 2.0) auf, um kinoreife Videoinhalte aus Text- und Bildaufforderungen zu liefern. Dieser Artikel untersucht anhand einer Reihe strukturierter Fragen die Kernfunktionen von Kling 2.1, die Weiterentwicklungen gegenüber früheren Versionen, praktische Zugriffsmethoden, Anwendungsbeispiele und Zukunftsaussichten.

Was ist Kling 2.1?

Kerndefinition

Kling 2.1 ist ein hochmodernes, KI-gestütztes Videogenerierungsmodell, das Textbeschreibungen und Referenzbilder in hochauflösende Videos in Filmqualität umwandelt. Im Gegensatz zu vielen reinen Text-zu-Video-Systemen nutzt es sowohl multimodale Eingaben – Bilder als auch Text – zur Steuerung der Generierung und gewährleistet so die präzise Einhaltung des visuellen Kontexts und der Benutzerabsicht. Das Training mit Petabytes an unterschiedlichen Videodaten untermauert seine robuste Leistung in Bezug auf Bildkonsistenz, Bewegungsrealismus und Szenenkohärenz.

Schlüsselinnovationen

Mehrere technische Durchbrüche unterscheiden Kling 2.1 von früheren Versionen:

- 3D räumlich-zeitliche Aufmerksamkeit: Ermöglicht dem Modell, die Objekt- und Kameradynamik in drei Dimensionen zu verstehen und erzeugt physikalisch plausible Bewegungen und nahtlose zeitliche Übergänge.

- Diffusionstransformator-Architektur: Integriert Diffusionsprozesse mit transformatorbasierter Aufmerksamkeit und gleicht kreative Variation mit prompter Wiedergabetreue aus.

- Rendering auf Meisterniveau: Eine gehobene „Master“-Stufe bietet visuelle Effekte in Kinoqualität – dramatische Beleuchtung, komplexe Kamerabewegungen und erweiterte Animationssequenzen.

Wie unterscheidet sich Kling 2.1 von früheren Versionen?

Verbesserungen der Bewegungssteuerung

Eine der bemerkenswertesten Verbesserungen betrifft die Bewegungsdynamik. Die verfeinerten Steuerungsalgorithmen von Kling 2.1 ermöglichen es Entwicklern, komplexe Kamerabewegungen – Schwenks, Zooms und Kamerafahrten – mit beispielloser Präzision zu steuern. Dies behebt direkt die bei früheren Modellen auftretenden Probleme mit der Charakterdrift und stellt sicher, dass die Motive auf dem Bildschirm während des gesamten Videos stabil und vorhersehbar bleiben.

Konsistenz- und Qualitätsverbesserungen

Zeitliche Konsistenz – die Beibehaltung einheitlicher Details über alle Frames hinweg – war lange Zeit eine Herausforderung für KI-Videomodelle. Kling 2.1 erreicht nahezu perfekte Bild-zu-Frame-Kohärenz und eliminiert Flimmern und Artefakte, die den Zuschauer ablenken könnten. Auch die Rendering-Geschwindigkeit hat sich deutlich verbessert: Nutzer berichten, dass 30-sekündige Vorschauclips in weniger als drei Minuten generiert wurden, verglichen mit über fünf Minuten bei Kling 2.0.

Benchmarks zeigen, dass Kling 2.1 einen 1080p-Clip mit 30 FPS durchschnittlich in unter einer Minute rendern kann – fast 30 % schneller als Kling 2.0 – und gleichzeitig die Kosten pro Videosekunde in der Master-Version um bis zu 65 % reduziert (). Diese Kombination aus Geschwindigkeit, Wiedergabetreue und Preis macht Kling 2.1 zu einem starken Konkurrenten sowohl für professionelle Studios als auch für unabhängige Produzenten.

Warum sollten sich Kreative für Kling 2.1 entscheiden?

Anwendungsfälle

Kling 2.1 richtet sich an ein breites Spektrum an Kreativen:

- Filmemacher & Animatoren: Schnelles Prototyping von Szenenkonzepten mit Kameraführung.

- Vermarkter und Werbetreibende: Erstellung von Produktdemovideos mit dynamischen Aufnahmen und realistischer Beleuchtung.

- Social Media Influencers: Auffällige Kurzclips, die auf Plattformen wie TikTok und Instagram auffallen.

Wettbewerbsvorteile

Im Vergleich mit Konkurrenzplattformen (z. B. Google Veo 3, OpenAIs Sora, Flow AI) erreicht oder übertrifft Kling 2.1 diese oft in puncto Bildtreue und Benutzerfreundlichkeit. Die dreistufige Modellhierarchie – Standard (720p), High-Quality (1080p) und Master (1080p Kino) – deckt unterschiedliche Budgets und Qualitätsanforderungen ab und bietet unabhängigen Kreativen einen leichteren Einstieg. Erste Tester berichten, dass Videos im Standardmodus nur 20 „Inspirationspunkte“ (ca. 0.20 $) kosten – eine Reduzierung um 65 % gegenüber dem bisherigen Preis für den Master-Modus.

Wie kann man auf Kling 2.1 zugreifen?

Registrierung und Preise

Der Zugriff auf Kling 2.1 ist über die offizielle Kling AI-Website und die mobilen Apps möglich. Weltweit registrieren sich Nutzer mit einer E-Mail-Adresse, um kostenlose „Inspirationspunkte“ für Testversionen zu erhalten. Die Preise sind wie folgt:

- Standard (720p): 20 Punkte pro 5-Sekunden-Clip

- Hohe Qualität (1080p): 35 Punkte pro 5-Sekunden-Clip

- Master (1080p Kino): 100 Punkte pro 5-Sekunden-Clip

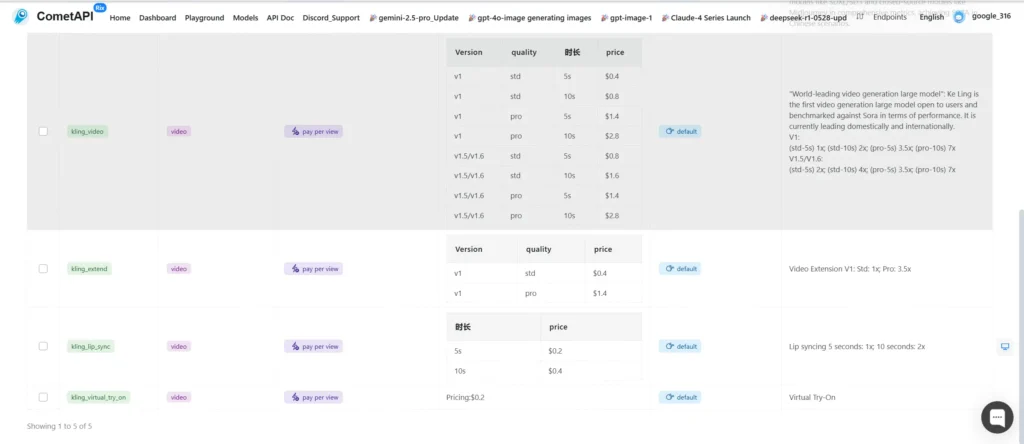

API- und Plattformverfügbarkeit

Neben Web- und mobilen Benutzeroberflächen bietet Kling 2.1 eine RESTful-API, die eine nahtlose Integration in Workflows von Drittanbietern ermöglicht. Entwickler können Bild-/Texteingaben programmgesteuert übermitteln, Rendering-Parameter (Auflösung, Bildrate, Kamerabewegung) festlegen und finale Video-Assets abrufen – alles im Rahmen unternehmensweiter SLAs.

Wie können Sie Kling 2.1 verwenden?

Erste Schritte: Eine Schritt-für-Schritt-Anleitung

- Konto erstellen: Melden Sie sich mit Ihrer E-Mail-Adresse auf der Plattform von Kling AI an und erhalten Sie eine Startgutschrift für den Test.

- Eingabemodus auswählen: Wählen Sie „Text + Bild“ oder „Nur Text“. Laden Sie bei der Verwendung von Bildern einen Referenzrahmen hoch (JPEG/PNG, max. 10 MB, min. 300 × 300 Pixel).

- Parameter konfigurieren: Definieren Sie Auflösung (720p/1080p), Bildrate (bis zu 30 FPS), Videolänge (max. 10 s) und Kameraanweisungen („langsam nach links schwenken“, „Dolly heranfahren“).

- Senden und rendern: Klicken Sie auf „Generieren“. Beobachten Sie einen Fortschrittsbalken, während Kling 2.1 die Anfrage verarbeitet – die typische Renderzeit beträgt 2–5 Minuten.

- Überprüfen und herunterladen: Zeigen Sie eine Vorschau des Clips an, passen Sie Eingabeaufforderungen oder Parameter nach Bedarf an und laden Sie dann die endgültige MP4-Datei herunter oder teilen Sie sie direkt über soziale Links.

Beispiel: Vom Bild zum Video

Angenommen, Sie haben ein Standbild eines Oldtimers, der nachts unter Neonlicht geparkt ist. So animieren Sie diese Szene:

- Laden Sie das Foto hoch: Wählen Sie das Autobild als Referenzrahmen.

- Geben Sie eine Textaufforderung ein: „Die Kamera zoomt langsam auf die Chromstoßstange des Autos, die Scheinwerfer reflektieren Neonschilder, während ein leichter Nebel über den Asphalt rollt.“

- Auf Master-Modus einstellen: Wählen Sie 1080p Master für kinoreife Beleuchtung und flüssige Bewegungen.

- Generieren: Nach einem 4-minütigen Rendervorgang erhalten Sie einen 7-sekündigen Clip mit realistischer Nebeldynamik, präzisen Reflexionen und flüssiger Kamerabewegung – alles ganz nach Ihren Vorgaben.

Durch die Kombination fortschrittlicher multimodaler KI-Architekturen mit benutzerzentrierten Preis- und Zugriffsmodellen ermöglicht Kling 2.1 Kreativen aller Erfahrungsstufen die Produktion professioneller Videos in Hollywood-Qualität mit beispielloser Leichtigkeit und Kosteneffizienz. Ob freiberuflicher Animator, Marketingprofi oder Social-Media-Influencer – Kling 2.1 bietet die Tools, um Ihre Vision noch heute in lebendige Bewegung umzusetzen.

Erste Schritte

CometAPI bietet eine einheitliche REST-Schnittstelle, die Hunderte von KI-Modellen – einschließlich der ChatGPT-Familie – unter einem konsistenten Endpunkt aggregiert, mit integrierter API-Schlüsselverwaltung, Nutzungskontingenten und Abrechnungs-Dashboards. Anstatt mit mehreren Anbieter-URLs und Anmeldeinformationen zu jonglieren.

Erkunden Sie zunächst die Fähigkeiten der Modelle in der Spielplatz und konsultieren Sie die API-Leitfaden Für detaillierte Anweisungen. Stellen Sie vor dem Zugriff sicher, dass Sie sich bei CometAPI angemeldet und den API-Schlüssel erhalten haben.

Die neueste Integration Kling 2.1 API wird bald auf CometAPI erscheinen, also bleiben Sie dran! Während wir den Upload des Kling 2.1-Modells abschließen, erkunden Sie unsere anderen Modelle auf der Modelle-Seite oder probieren Sie sie im KI-Spielplatz. Klings neuestes Modell in CometAPI ist Kling v1.6(Kling 1.6 Standard-API),siehe Anleitung: