Was ist die GPT-5.2-API

Die GPT-5.2-API ist dasselbe wie GPT-5.2 Thinking in ChatGPT. GPT-5.2 Thinking ist die mittlere Variante der GPT-5.2-Familie von OpenAI und wurde für anspruchsvollere Aufgaben entwickelt: mehrstufiges Schlussfolgern, Zusammenfassung langer Dokumente, hochwertige Codegenerierung und professionelle Wissensarbeit, bei der Genauigkeit und eine nutzbare Struktur wichtiger sind als reine Durchsatzleistung. In der API wird sie als Modell gpt-5.2 bereitgestellt (Responses API / Chat Completions) und positioniert sich zwischen der latenzarmen Instant-Variante und der qualitativ besseren, aber teureren Pro-Variante.

Hauptfunktionen

- Sehr langer Kontext & Komprimierung: 400K effektives Kontextfenster und Komprimierungswerkzeuge, um die Relevanz über lange Unterhaltungen und Dokumente hinweg zu verwalten.

- Konfigurierbarer Reasoning-Aufwand:

none | medium | high | xhigh(xhighaktiviert die maximale interne Rechenleistung für anspruchsvolle Schlussfolgerungen).xhighist für Thinking-/Pro-Varianten verfügbar. - Stärkere Tool- und Funktionsunterstützung: erstklassiges Tool-Calling, Grammatiken (CFG/Lark) zur Einschränkung strukturierter Ausgaben und verbesserte agentische Verhaltensweisen, die komplexe mehrstufige Automatisierung vereinfachen.

- Multimodales Verständnis: erweitertes Verständnis von Bild- und Textinhalten sowie deren Integration in mehrstufige Aufgaben.

- Verbesserte Sicherheit / Umgang mit sensiblen Inhalten: gezielte Eingriffe zur Verringerung unerwünschter Antworten in Bereichen wie Selbstverletzung und anderen sensiblen Kontexten.

Technische Fähigkeiten & Spezifikationen (Entwicklersicht)

- API-Endpunkte & Modell-IDs:

gpt-5.2für Thinking (Responses API),gpt-5.2-chat-latestfür Chat-/Instant-Workflows undgpt-5.2-profür die Pro-Stufe; verfügbar über die Responses API und Chat Completions, wo angegeben. - Reasoning-Tokens & Aufwandssteuerung: Die API unterstützt explizite Parameter, um die Rechenleistung (Reasoning-Aufwand) pro Anfrage zuzuweisen; höherer Aufwand erhöht Latenz und Kosten, verbessert aber die Ausgabequalität bei komplexen Aufgaben.

- Tools für strukturierte Ausgaben: Unterstützung für Grammatiken (Lark / CFG), um die Modellausgabe auf eine DSL oder exakte Syntax zu beschränken (nützlich für SQL, JSON, DSL-Generierung).

- Paralleles Tool-Calling & agentische Koordination: verbesserte Parallelisierung und sauberere Tool-Orchestrierung verringern den Bedarf an aufwendigen System-Prompts und Multi-Agent-Scaffolding.

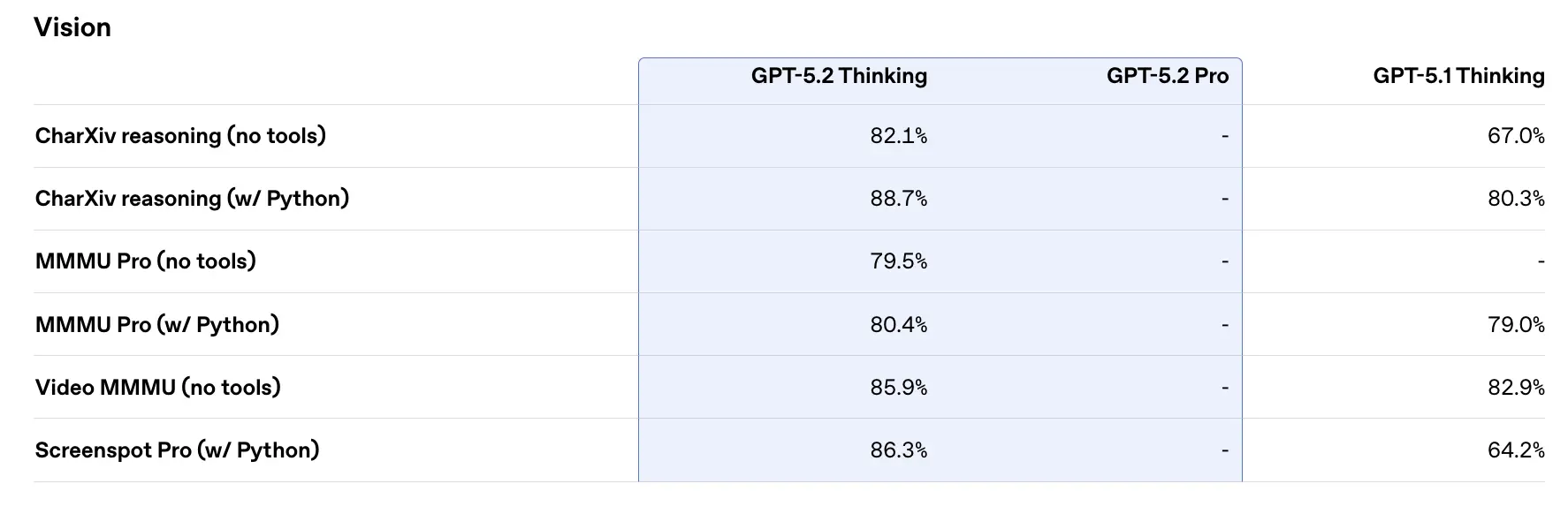

Benchmark-Leistung & unterstützende Daten

OpenAI veröffentlichte eine Vielzahl interner und externer Benchmark-Ergebnisse für GPT-5.2. Ausgewählte Highlights (von OpenAI gemeldete Zahlen):

- GDPval (44 Berufe, Wissensarbeit) — GPT-5.2 Thinking „übertrifft oder erreicht führende Branchenexpert:innen bei 70.9% der Vergleiche“; laut OpenAI wurden die Ausgaben bei ihren GDPval-Aufgaben mit >11× der Geschwindigkeit und <1% der Kosten von Fachleuten erzeugt (Geschwindigkeits- und Kostenschätzungen basieren auf historischen Daten). Diese Aufgaben umfassen Tabellenmodelle, Präsentationen und kurze Videos.

- SWE-Bench Pro (Coding) — GPT-5.2 Thinking erreicht laut OpenAI ≈55.6% bei SWE-Bench Pro und ~80% bei SWE-Bench Verified (nur Python) und setzt damit in ihren Tests einen neuen Stand der Technik für Codegenerierungs-/Engineering-Evaluierung. Laut den Beispielen von OpenAI führt dies in der Praxis zu zuverlässigerem Debugging und End-to-End-Korrekturen.

- GPQA Diamond (wissenschaftliches Q&A auf Graduiertenniveau) — GPT-5.2 Pro: 93.2%, GPT-5.2 Thinking: 92.4% bei GPQA Diamond (ohne Tools, maximales Reasoning).

- ARC-AGI-Serie — Bei ARC-AGI-2 (einem schwierigeren Benchmark für fluides Denken) erzielte GPT-5.2 Thinking 52.9% und GPT-5.2 Pro 54.2% (OpenAI sagt, dies seien neue Bestwerte für Modelle im Stil von Chain-of-Thought).

- Long-Context (OpenAI MRCRv2) — GPT-5.2 Thinking zeigt beim 4-Needle-MRCR-Variantentest bis zu 256k Tokens eine Genauigkeit nahe 100% und deutlich verbesserte Werte gegenüber GPT-5.1 in Long-Context-Szenarien. (OpenAI veröffentlichte MRCRv2-Diagramme und -Tabellen.)

Vergleich mit zeitgenössischen Modellen

- vs Google Gemini 3 (Gemini 3 Pro / Deep Think): Gemini 3 Pro wurde öffentlich mit einem Kontextfenster von ~1,048,576 (≈1M) Tokens sowie breiten multimodalen Eingaben (Text, Bild, Audio, Video, PDFs) und starken agentischen Integrationen über Vertex AI / AI Studio vorgestellt. Auf dem Papier ist das größere Kontextfenster von Gemini 3 ein Unterscheidungsmerkmal für extrem große Single-Session-Workloads; Gegenüberstellungen betreffen unter anderem Tooling-Oberfläche und Ökosystem-Fit.

- vs Anthropic Claude Opus 4.5: Anthropic’s Opus 4.5 legt den Schwerpunkt auf Enterprise-Coding-/Agent-Workflows und berichtet über starke SWE-bench-Ergebnisse sowie Robustheit bei langen agentischen Sitzungen; Anthropic positioniert Opus für Automatisierung und Codegenerierung mit einem 200k-Kontextfenster und spezialisierten Agent-/Excel-Integrationen. Opus 4.5 ist ein starker Wettbewerber bei Enterprise-Automatisierung und Code-Aufgaben.

Praktische Schlussfolgerung: GPT-5.2 zielt auf ein ausgewogenes Set von Verbesserungen ab (400k Kontext, hohe Token-Ausgaben, verbessertes Reasoning/Coding). Gemini 3 zielt auf die absolut größten Single-Session-Kontexte (≈1M), während Claude Opus den Fokus auf Enterprise-Engineering und agentische Robustheit legt. Wählen Sie anhand von Kontextgröße, Modalitätsanforderungen, Feature-/Tooling-Fit sowie Kosten-/Latenzabwägungen.

So greifen Sie auf die GPT-5.2-API zu und verwenden sie

Schritt 1: Für einen API-Schlüssel registrieren

Melden Sie sich bei cometapi.com an. Wenn Sie noch kein Benutzer sind, registrieren Sie sich bitte zuerst. Melden Sie sich in Ihrer CometAPI-Konsole an. Rufen Sie den API-Schlüssel als Zugriffsdaten für die Schnittstelle ab. Klicken Sie im persönlichen Bereich unter API-Token auf „Add Token“, erhalten Sie den Token-Schlüssel: sk-xxxxx und senden Sie ihn ab.

Schritt 2: Anfragen an die GPT-5.2-API senden

Wählen Sie den Endpunkt „gpt-5.2“, um die API-Anfrage zu senden, und legen Sie den Request-Body fest. Die Request-Methode und der Request-Body finden Sie in der API-Dokumentation auf unserer Website. Unsere Website bietet zu Ihrer Bequemlichkeit auch Apifox-Tests an. Ersetzen Sie <YOUR_API_KEY> durch Ihren tatsächlichen CometAPI-Schlüssel aus Ihrem Konto. Entwickler rufen diese über die Responses API / Chat Endpunkte auf.

Fügen Sie Ihre Frage oder Anfrage in das Feld content ein — darauf wird das Modell antworten. Verarbeiten Sie die API-Antwort, um die generierte Ausgabe zu erhalten.

Schritt 3: Ergebnisse abrufen und überprüfen

Verarbeiten Sie die API-Antwort, um die generierte Ausgabe zu erhalten. Nach der Verarbeitung gibt die API den Aufgabenstatus und die Ausgabedaten zurück.

Siehe auch Gemini 3 Pro Preview API