Technische Spezifikationen von GPT-5.4 Mini

| Angabe | GPT-5.4 Mini (Schätzung aus offiziellen Angaben + Kreuzvalidierung) |

|---|---|

| Modellfamilie | GPT-5.4-Serie (kosteneffiziente „Mini“-Variante) |

| Anbieter | OpenAI |

| Eingabetypen | Text, Bild |

| Ausgabetypen | Text |

| Kontextfenster | 400,000 Token |

| Max. Ausgabetoken | 128,000 Token |

| Wissensstand | ~31. Mai 2024 (übernimmt Mini-Linie) |

| Reasoning-Unterstützung | Ja (leichter als das volle GPT-5.4) |

| Tool-Unterstützung | Function Calling, Websuche, Dateisuche, Agents (aus der GPT-5-Familie abgeleitet) |

| Positionierung | Hochgeschwindigkeits-, kosteneffizientes Near-Frontier-Modell |

Was ist GPT-5.4 Mini?

GPT-5.4 Mini ist eine kosteneffiziente Hochgeschwindigkeitsvariante von GPT-5.4, entwickelt für latenzeempfindliche, hochvolumige Workloads. Sie bringt einen erheblichen Teil der Reasoning-, Coding- und Multimodal-Fähigkeiten von GPT-5.4 in ein kleineres, schnelleres Modell, das für Systeme im Produktionsmaßstab optimiert ist.

Im Vergleich zu früheren „Mini“-Modellen ist GPT-5.4 Mini als „Near-Frontier“-Kleinmodell positioniert, das sich der Performance von Flaggschiffmodellen annähert und gleichzeitig Kosten und Reaktionszeit drastisch senkt.

Zentrale Funktionen von GPT-5.4 Mini

- Hochgeschwindigkeits-Inferenz: Optimiert für Anwendungen mit niedriger Latenz wie Chatbots, Copilots und Echtzeitsysteme

- Großes Kontextfenster (400K): Unterstützt lange Dokumente, mehrstufige Workflows und Agenten-Memory

- Starke Coding- und Agent-Unterstützung: Ausgelegt für Toolnutzung, mehrstufiges Reasoning und delegierte Subagent-Aufgaben

- Multimodale Eingabe: Akzeptiert sowohl Text- als auch Bildeingaben für reichhaltigere Workflows

- Kosteneffiziente Skalierung: Deutlich günstiger als GPT-5.4 bei gleichzeitig starker Reasoning-Fähigkeit

- Optimierung von Agent-Pipelines: Ideal für Multi-Modell-Architekturen, in denen große Modelle planen und Mini-Modelle ausführen

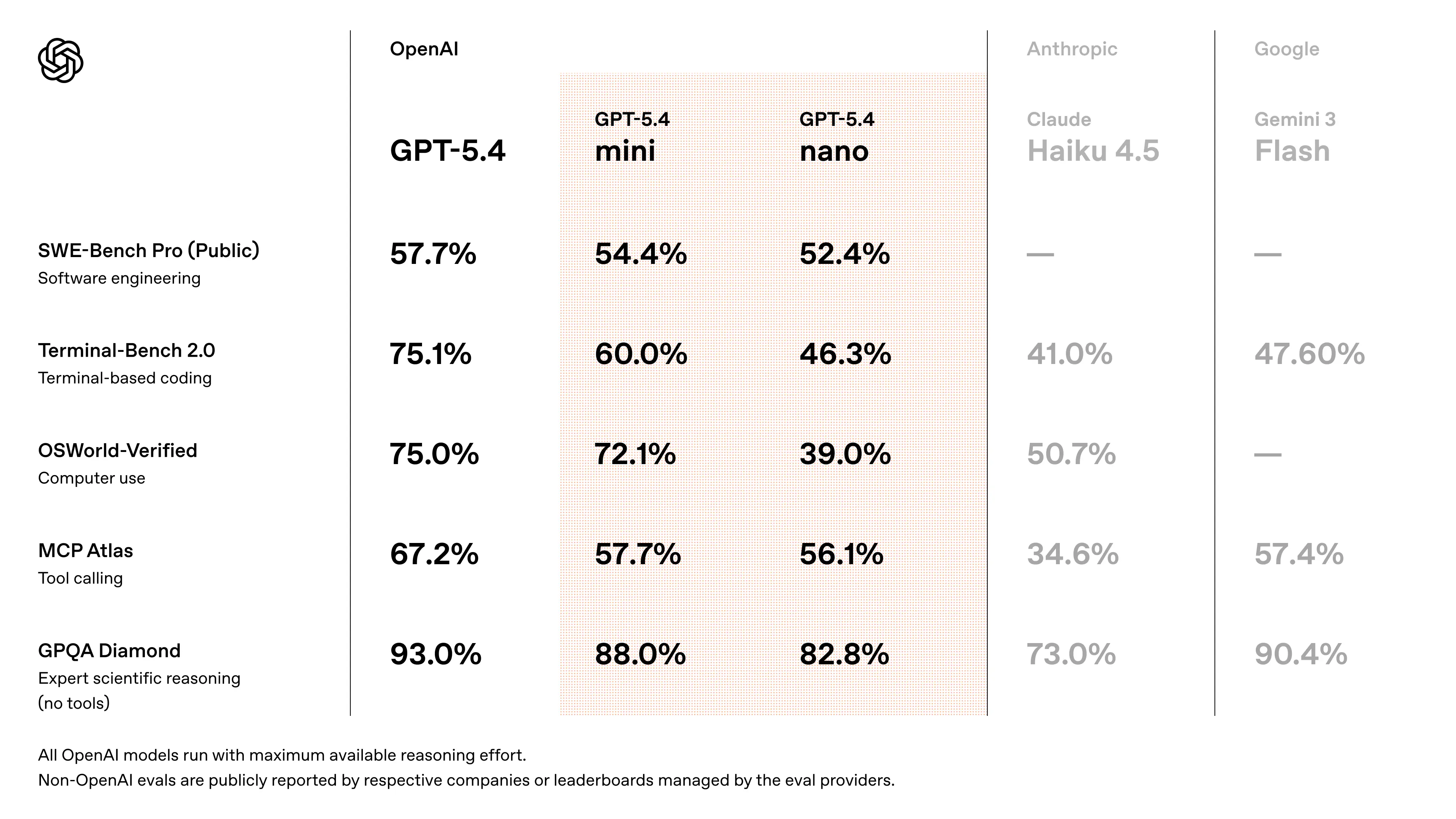

Benchmark-Leistung von GPT-5.4 Mini

- Erreicht nahezu die GPT-5.4-Leistung bei SWE-Bench-ähnlichen Coding-Aufgaben (~94–95 % der Flaggschiff-Performance) (kreuzvalidierte Schätzung aus Veröffentlichungsdiskussionen)

- Deutliche Verbesserungen gegenüber GPT-5 Mini bei:

- Reasoning-Genauigkeit

- Zuverlässigkeit der Toolnutzung

- Multimodalem Verständnis

- Ausgelegt, frühere „Mini“-Generationen in Agent-Workflows und Coding-Benchmarks zu übertreffen

- Geschwindigkeitsmessungen: frühe API-Tester berichten von ~180–190 Token/s auf GPT-5.4 Mini (vs. ~55–120 Token/s bei älteren GPT-5-Mini-Varianten, abhängig von Prioritätsmodi).

👉 Kernaussage: GPT-5.4 Mini liefert Near-Frontier-Performance zu einem Bruchteil der Kosten und Latenz und ist damit ideal für skalierbare Systeme.

Repräsentative Anwendungsfälle

- Coding-Assistenten und Editoren (IDE-Plugins, Copilot): schnelles Kontext-Parsing, Codebase-Erkundung und schnelle Vervollständigungen machen GPT-5.4 Mini ideal für In-Editor-Vorschläge, bei denen Time-to-First-Token zählt. GitHub Copilot ist eine frühe Integration.

- Subagenten / delegierte Worker: wenn ein Master-Agent kurze, schnelle Aufgaben (Formatierung, kleine Reasoning-Schritte, grep-ähnliche Suchen) an einen günstigen, schnellen Worker delegiert. OpenAI positioniert Mini/Nano für diese Rollen.

- API-Automatisierung mit hohem Volumen: massenhafte Codegenerierung, automatisches Ticket-Triage, Log-Zusammenfassungen in großem Maßstab, bei denen pro Call Kosten und Latenz die Hauptfaktoren sind. Community-Durchsatzwerte weisen auf erhebliche betriebliche Vorteile für Mini hin.

- Tool-Wrapping und Toolchains: schnelle Tool-Aufrufe, bei denen das Modell Aufrufe an externe Tools (Suche, grep, Tests ausführen) orchestriert und kompakte, umsetzbare Ausgaben zurückgibt. Die GPT-5-Familie umfasst verbesserte „Computer Use“-Fähigkeiten.

Zugriff auf die GPT-5.4 Mini API

Schritt 1: Für API-Schlüssel registrieren

Melden Sie sich bei cometapi.com an. Wenn Sie noch kein Nutzer sind, registrieren Sie sich zuerst. Melden Sie sich in Ihrer CometAPI-Konsole an. Rufen Sie den Zugangs-API-Schlüssel der Schnittstelle ab. Klicken Sie im persönlichen Bereich beim API-Token auf „Add Token“, erhalten Sie den Token-Schlüssel: sk-xxxxx und senden Sie ihn ab.

Schritt 2: Anfragen an die GPT-5.4 Mini API senden

Wählen Sie den „gpt-5.4-mini“-Endpunkt, um die API-Anfrage zu senden, und legen Sie den Request-Body fest. Anfragemethode und Request-Body entnehmen Sie unserer Website-API-Dokumentation. Unsere Website bietet zudem Apifox-Tests zur Vereinfachung. Ersetzen Sie <YOUR_API_KEY> durch Ihren tatsächlichen CometAPI-Schlüssel aus Ihrem Konto. Die Basis-URL ist Chat Completions und Responses.

Fügen Sie Ihre Frage oder Anforderung in das Content-Feld ein—darauf antwortet das Modell. Verarbeiten Sie die API-Antwort, um die generierte Antwort zu erhalten.

Schritt 3: Ergebnisse abrufen und verifizieren

Verarbeiten Sie die API-Antwort, um die generierte Antwort zu erhalten. Nach der Verarbeitung antwortet die API mit dem Aufgabenstatus und den Ausgabedaten.