Die Integration von CometAPI mit n8n ermöglicht es Ihnen, Ihre Automatisierungen in nur drei Schritten mit den fortschrittlichsten KI-Modellen der Welt zu betreiben. Mit einem einzigen OpenAI-kompatiblen Anmeldedatensatz erhalten Sie sofortigen Zugriff auf über 500 Modelle, darunter GPT 5.5, Claude Opus 4.7 und DeepSeek V4 Pro. Dieses Setup ist sowohl für Cloud- als auch für selbstgehostete n8n-Instanzen identisch und bietet eine stabile, hochverfügbare Grundlage für Ihre n8n-KI-Workflow-Automatisierung.

Was ist n8n und warum es wichtig ist

n8n ist ein Open-Source-Tool für Workflow-Automatisierung. Es ermöglicht Ihnen, verschiedene Apps, Dienste und APIs zu verbinden, um Aufgaben zu automatisieren – ohne viel Code schreiben zu müssen.

Was es kann

Stellen Sie sich n8n als eine visuelle Möglichkeit vor, Automatisierungen zu erstellen:

- Sie erstellen Workflows mit einem Drag-and-drop-Editor

- Jeder Schritt (ein Knoten) führt eine Aktion aus

- Daten fließen automatisch von einem Schritt zum nächsten

Hauptfunktionen

- Open Source (Sie können es selbst hosten)

- Unterstützt Hunderte von Integrationen (APIs, Apps, Datenbanken)

- Erlaubt benutzerdefinierte JavaScript-Logik innerhalb von Workflows

- Kann auf Ihrem eigenen Server laufen oder über den Cloud-Dienst auf der offiziellen n8n-Website

Warum n8n mit CometAPI verbinden

Die Nutzung von CometAPI als zentrales Gateway in n8n bietet erhebliche operative Vorteile. Indem Sie separate Schlüssel für OpenAI, Anthropic und Google durch ein einziges Credential ersetzen, eliminiert Ihr Team den Aufwand für die Verwaltung mehrerer Anbieter-Accounts und komplexer Abrechnungszyklen. Diese Architektur stellt sicher, dass es keine Anbieterbindung gibt; Sie können zwischen den neuesten Modellen verschiedener Anbieter wechseln, indem Sie einfach den Modellnamen in Ihren Node-Einstellungen aktualisieren, sodass Ihre Workflows agil bleiben, während sich die KI-Landschaft weiterentwickelt.

CometAPI dient als vereinheitlichte REST-API, die 500+ Modelle für Chat, Bild, Video, Audio (TTS/STT) und Embeddings aggregiert. Wichtige Vorteile umfassen:

- OpenAI-kompatibler Endpunkt (

https://api.cometapi.com/v1): Nahtlose Kompatibilität mit OpenAI-Knoten oder HTTP Request. - 20–40 % niedrigere Preise als Direktanbieter, Pay-as-you-go, keine monatlichen Gebühren für Basics und einheitliche Abrechnung.

- Kein Vendor-Lock-in: Modelle mit einer einzigen Parameteränderung wechseln.

- Enterprise-Features: Failover-Routing, Analytik, Datenschutzkontrollen (in einigen Diskussionen wird behauptet, dass keine Prompts gesammelt werden) und zuverlässiger Zugriff.

Neueste Entwicklungen (Stand Mai 2026): CometAPI pflegt eine verifizierte/Partner-Integration auf n8n.io, mit einem dedizierten Community-Knoten (n8n-nodes-cometapi), der über npm für lokale/selbstgehostete Instanzen verfügbar ist. Nutzer berichten von reibungsloser OpenAI-Node-Kompatibilität und wachsender Akzeptanz für Multi-Modell-Workflows. Kürzliche n8n-Updates verbessern Tool-Calling und HTTP-Knoten und machen Integrationen robuster.

Erste Schritte: Voraussetzungen und Kontoeinrichtung

Bei CometAPI registrieren

Besuchen Sie cometapi.com, erstellen Sie ein kostenloses Konto und generieren Sie im Dashboard einen API-Schlüssel. Neue Nutzer erhalten häufig Testguthaben. Sehen Sie sich die Modellliste und die Preisseite an.

n8n einrichten

- Cloud: n8n.cloud (verwaltet, einfaches Skalieren).

- Selbstgehostet: Docker, npm oder Kubernetes. Empfohlen für Datenschutz und unbegrenzte Ausführungen. Aktuelle Anleitungen behandeln das lokale Ausführen von CometAPI-Knoten.

Aktualisieren Sie auf die neueste Version (z. B. 2.20+ Stand Mai 2026) für KI- und Stabilitätsverbesserungen.

CometAPI-Node installieren (optional, aber für Selbsthosting empfohlen)

Verwenden Sie den Community-Knoten:

npm install n8n-nodes-cometapi

Starten Sie n8n neu. Er erscheint im Knoten-Panel für ein natives Erlebnis.

Schritt-für-Schritt-Einrichtungsanleitung

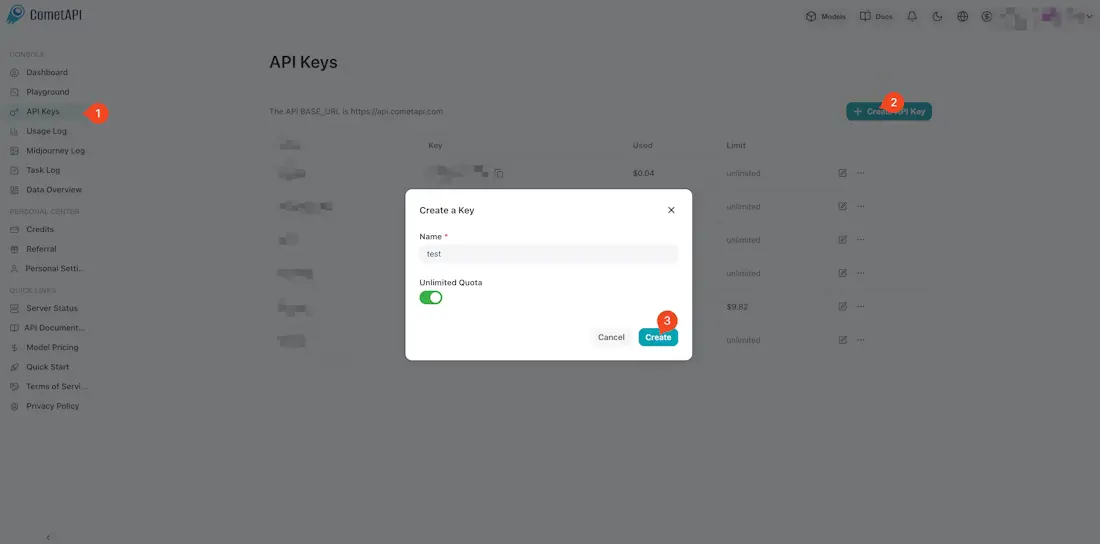

Schritt 1: CometAPI-API-Schlüssel abrufen

Melden Sie sich im CometAPI-Dashboard an und navigieren Sie zum Bereich API Token. Klicken Sie auf Add API Key, um Ihr eindeutiges Credential zu generieren.

Kopieren Sie Ihren Schlüssel (typischerweise formatiert als sk-xxxx) und halten Sie die Basis-URL bereit: https://api.cometapi.com/v1.

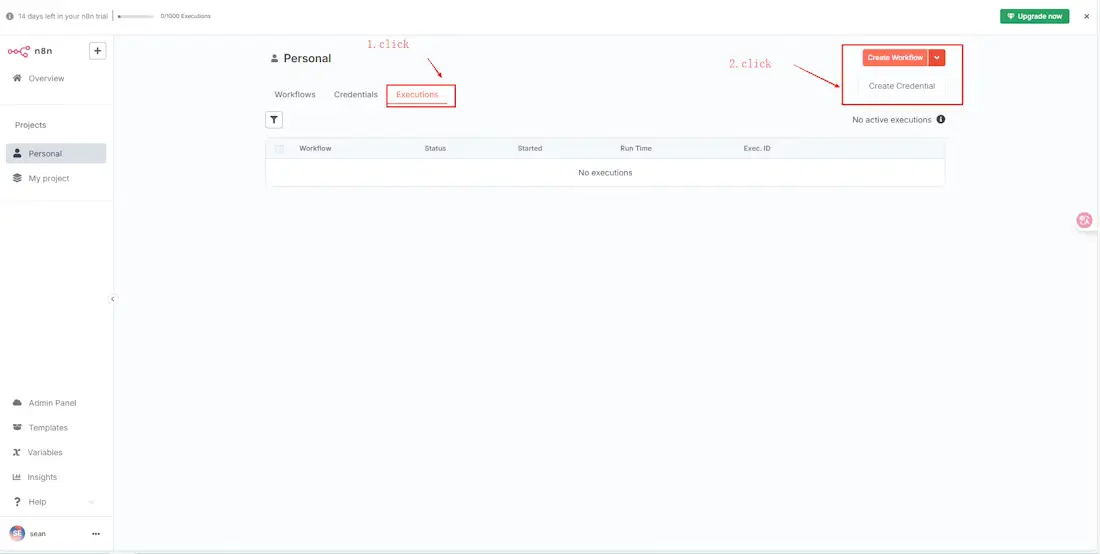

Schritt 2: OpenAI-Anmeldedaten in n8n erstellen

Öffnen Sie Ihre n8n-Instanz und navigieren Sie zu Credentials → Create Credential. Suchen Sie nach dem OpenAI API-Credential-Typ und wählen Sie ihn aus.

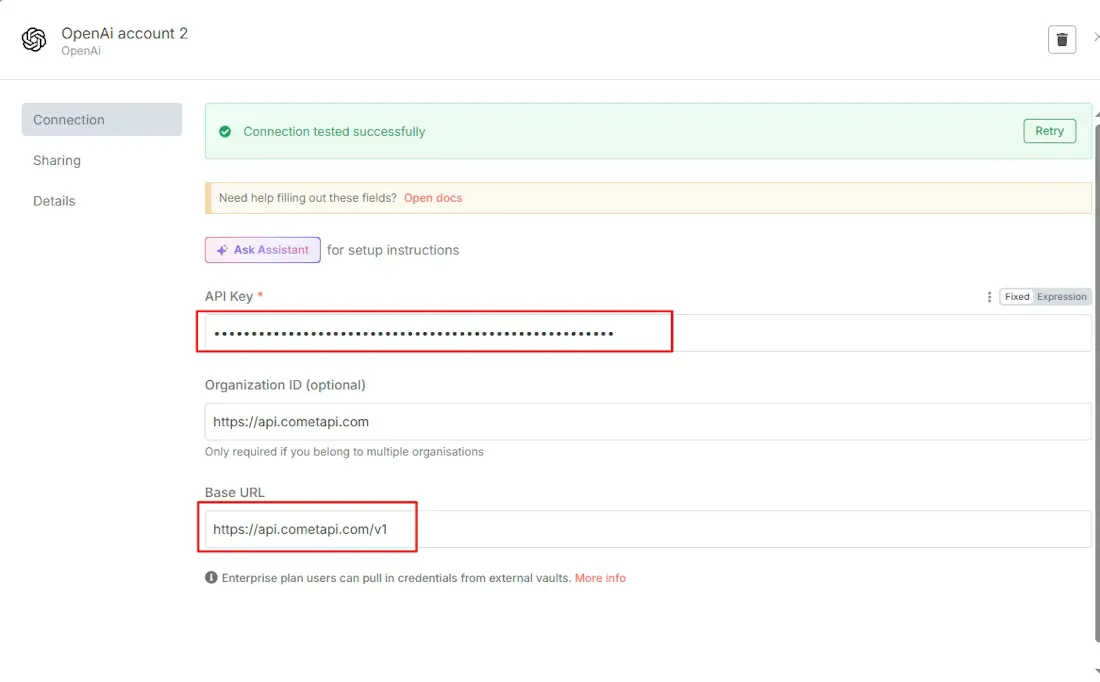

- API-Schlüssel: Fügen Sie hier Ihr CometAPI-Token ein.

- Basis-URL: Geben Sie

https://api.cometapi.com/v1.

Klicken Sie auf Save, um das Setup abzuschließen.

Schritt 3: Verbindung testen

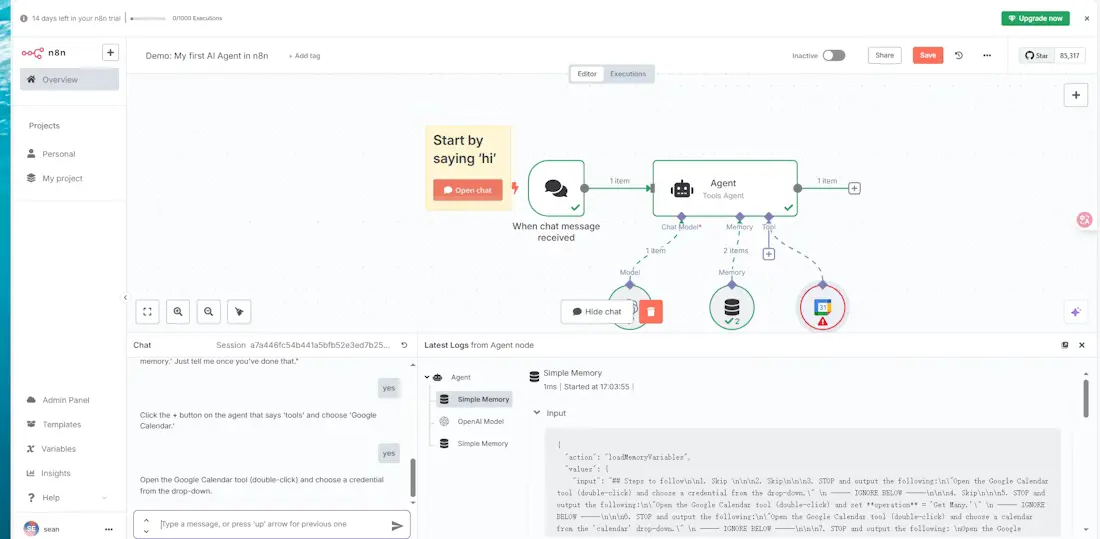

Erstellen Sie einen neuen Workflow und fügen Sie einen OpenAI-Knoten hinzu (z. B. den Chat Model- oder AI Agent-Knoten). Wählen Sie das soeben erstellte CometAPI-Credential aus. Im Modellfeld können Sie nun jede unterstützte Modell-ID eingeben, etwa gpt-5.5 oder claude-opus-4-7. Führen Sie den Knoten aus; eine erfolgreiche Antwort bestätigt, dass Ihre n8n-OpenAI-kompatible API-Bridge korrekt konfiguriert ist.

Fehlerbehebung bei häufigen Problemen

Wenn Ihre Integration nicht sofort funktioniert, prüfen Sie diese drei häufigen Bereiche:

API gibt einen 401 Unauthorized-Fehler zurück

Dieser Fehler bedeutet in der Regel, dass sich n8n nicht beim Gateway authentifizieren kann. Vergewissern Sie sich zunächst, dass Ihr API-Schlüssel korrekt kopiert wurde, ohne führende oder nachfolgende Leerzeichen. Stellen Sie zweitens sicher, dass Ihre Basis-URL den Suffix /v1 enthält. Ohne den Versionspfad kann der Endpunkt die Anfrage ablehnen.

Modellname nicht erkannt

CometAPI hostet über 500 Modelle, und jedes hat eine spezifische Kennung. Wenn n8n einen "Model not found"-Fehler zurückgibt, stellen Sie sicher, dass Sie die exakte Modell-ID aus der CometAPI-Dokumentation verwenden. Nutzen Sie beispielsweise gpt-5.5-pro statt nur gpt-5-pro, wenn dies die Kennung im aktuellen Katalog ist.

Antwortgeschwindigkeit ist langsam

Für Echtzeitanwendungen, bei denen Latenz wichtig ist, können bestimmte Reasoning-lastige Modelle länger benötigen. Wenn Ihr Workflow nahezu sofortige Antworten erfordert, wechseln Sie zu einem High-Throughput-Modell wie Gemini 3.1 Flash-Lite oder DeepSeek V4 Flash, die auf Geschwindigkeit optimiert sind.

Welche Modelle können Sie in n8n über CometAPI verwenden

| Modellkategorie | Beispiele | Am besten geeignet für |

|---|---|---|

| Text/Chat | GPT 5.5, Claude Opus 4.7, Gemini 3.1 Pro | Professionelles Reasoning und komplexe Logik |

| Code | DeepSeek V4 Pro, GPT 5.3 Codex | Agentisches Coding und Refactorings im Repository‑Maßstab |

| Bild | GPT Image 2, Flux 2 Max | Hochwertige visuelle Inhalte und Design |

| Video | Sora 2, Doubao-Seedance 2.0 | Filmische Automatisierung und Social-Video-Clips |

Sofort einsetzbare n8n-Workflow-Vorlagen

Die Implementierung von CometAPI in n8n ermöglicht eine anspruchsvolle Multi-Modell-Logik. Hier sind drei Vorlagen, die Sie noch heute bauen können.

Vorlage 1: Kundenservice-Automatisierung

- Trigger: Ein Webhook-Knoten empfängt ein Support-Ticket von Ihrer Website.

- Verarbeitung: Ein CometAPI (OpenAI)-Knoten nutzt Claude Opus 4.7, um den Tickettext zu analysieren.

- Logik: Ein Switch-Knoten bewertet die vom KI-Modell ausgegebene "Severity" oder "Complexity".

- Verzweigung: Einfache Anfragen (z. B. "Wo ist meine Bestellung?") werden zu einem Knoten für automatische Antworten geleitet. Komplexe technische Probleme werden an einen Slack-Knoten oder Zendesk-Knoten zur menschlichen Bearbeitung weitergereicht.

- Knotenkonfiguration: Setzen Sie den Claude-Knoten auf

thinking: {type: "adaptive"}, damit er bei schwieriger Stimmungsanalyse mehr Zeit aufwendet.

Vorlage 2: Automatisierte Content-Pipeline

- Trigger: Ein RSS-Feed-Knoten erkennt einen neuen Artikel aus Ihrer Branche.

- Verarbeitung 1: Verwenden Sie GPT 5.5, um den Artikel zu lesen und eine Executive Summary mit 200 Wörtern für Ihren internen Newsletter zu erstellen.

- Verarbeitung 2: Übergeben Sie diese Zusammenfassung an DeepSeek V3, um fünf SEO-optimierte Tags und Keywords zu generieren.

- Ausgabe: Die Zusammenfassung und die Tags werden in einer Notion-Datenbank oder über einen WordPress-Knoten veröffentlicht.

- Warum dieser Swarm?: Mit GPT 5.5 für die hochwertige Zusammenfassung und dem günstigeren DeepSeek V3 für einfaches Tagging halten Sie die Qualität hoch und senken gleichzeitig die gesamten Token-Kosten deutlich.

Vorlage 3: Bildgenerierungs-Workflow

- Trigger: Ein Google-Sheets-Knoten erkennt eine neue Zeile mit Produktname und Beschreibung.

- Verarbeitung: Die Beschreibung wird an einen CometAPI (OpenAI)-Knoten über den Endpunkt

/v1/images/generationsmit dem Flux 2 Max-Modell gesendet. - Speicherung: Die generierte Bild-URL wird an einen Google-Drive-Knoten übergeben, um die Datei hochzuladen und zu speichern.

- Knotenkonfiguration: Setzen Sie den Parameter

nauf 1 und wählen Sie eine Auflösung wie1024x1024für hochwertige Produkt-Mockups.

Tipps zur Kostenoptimierung für n8n + CometAPI

Um Ihre 20–40 % Ersparnis zu maximieren, befolgen Sie diese Architekturstrategien.

Günstige Modelle für Klassifizierung und Routing verwenden

Nutzen Sie nicht GPT 5.5 Pro für einfache Ja/Nein- oder Kategorie-A/B-Entscheidungen. Verwenden Sie DeepSeek V4 Flash oder GPT 5.4 nano für solche Aufgaben. Diese Modelle kosten nur einen Bruchteil der Flaggschiff-Modelle und sind oft schneller, wodurch Ihr n8n-Workflow effizienter ausgeführt wird.

Bedingte Modellauswahl in n8n einrichten

Verwenden Sie einen Switch-Knoten oder If-Knoten, um basierend auf Eingabelänge oder Priorität ein Modell zu wählen. Wenn ein Dokument z. B. unter 1.000 Wörtern liegt, leiten Sie es an ein Standardmodell. Handelt es sich um ein massives Repository mit 500.000 Tokens, leiten Sie es an ein Langkontext-Modell wie Grok 4.20 oder Claude Opus 4.7.

Batchverarbeitung vs. Echtzeitverarbeitung

Wenn Ihr n8n-Workflow keine sofortigen Antworten erfordert (z. B. ein Tagesendbericht), verwenden Sie einen Wait-Knoten oder Schedule-Knoten, um Eingaben zu sammeln und in einem einzigen Batch zu verarbeiten. CometAPI unterstützt hohe Parallelität, aber die Reduzierung der Frequenz kleiner, separater Aufrufe kann helfen, in niedrigeren Ratenlimit-Stufen zu bleiben und Ihre Nutzungsprotokolle zu vereinfachen.

Vergleichstabelle: n8n + CometAPI vs. Alternativen

| Feature | n8n + CometAPI | Zapier + mehrere KIs | Make.com + direkte APIs | Custom Code (Python/Node) |

|---|---|---|---|---|

| Kosten | Niedrig (20–40 % Ersparnis + n8n gratis/selbstgehostet) | Hoch (pro Task + pro API) | Mittel | Variabel (Entwicklungszeit) |

| Benutzerfreundlichkeit | Visuell, Low-Code | Sehr einfach | Visuell | Hoher Coding-Aufwand |

| Flexibilität | Unbegrenzt (HTTP + 400+ Knoten) | Begrenzte Vorlagen | Gut | Am höchsten |

| Modellzugang | Vereinheitlicht (500+ Modelle) | Fragmentiert | Abhängig | Manuell |

| Selbsthosting/Datenschutz | Hervorragend | Begrenzt | Cloud-fokussiert | Volle Kontrolle |

| Skalierbarkeit | Hoch (Queue-Modi, Worker) | Nutzungsbasierte Preisobergrenzen | Gut | Abhängig von der Infra |

| Wartungsaufwand | Niedrig (eine Integration) | Hoch (mehrere Verbindungen) | Mittel | Hoch |

| KI-Agenten-Unterstützung | Nativ + Tools | Grundlegend | Wachsend | Individuell |

Fazit: n8n + CometAPI ist die beste Wahl für Teams, die Leistung, Kontrolle und Kosteneffizienz benötigen.

Ausblick und Optimierungstipps für die Zukunft

Da sich KI-Modelle 2026 vervielfachen, werden vereinheitlichte Plattformen wie CometAPI in Kombination mit flexiblen Orchestratoren wie n8n essenziell. Erwarten Sie tiefere native Knoten, bessere MCP/Server-Integrationen und erweiterte Agentenfähigkeiten.

Optimierung auf Cometapi.com:

- Verfolgen Sie den Token-Verbrauch über Workflows hinweg für ROI-Analysen.

- Nutzen Sie CometAPI-Analysen + n8n-Ausführungsdaten.

- Experimentieren Sie mit neueren Modellen (z. B. DeepSeek-V4) für spezialisierte Aufgaben zu geringeren Kosten.

- Kombinieren Sie weitere CometAPI-Tools für End-to-End-KI-Lösungen.

Quick Guide: Bauen Sie heute einen einfachen Zusammenfassungs-Workflow. Skalieren Sie morgen zu vollständigen KI-Operationen.

Bereit loszulegen? Gehen Sie zu CometAPI für Ihren kostenlosen API-Schlüssel und Credits. Ob selbstgehostetes oder Cloud-n8n – verbinden Sie sich über die oben genannten Schritte und transformieren Sie Ihre Automatisierungen. Für maßgeschneiderte Workflows oder Enterprise-Beratung finden Sie Optionen auf Cometapi.com.

Diese Integration ist nicht nur technisch – sie ist ein strategischer Multiplikator für Produktivität und Innovation im KI-Zeitalter.

FAQ

F: Benötige ich separate Anmeldedaten für jedes KI-Modell?

A: Nein. Ein CometAPI-Credential bietet Zugriff auf alle 500+ Modelle in n8n – von GPT und Claude bis DeepSeek und Kimi.

F: Ist CometAPI günstiger als die direkte Nutzung von OpenAI in n8n?

A: Ja. CometAPI-Preise liegen 20–40 % unter den offiziellen Retail-Preisen für dieselben Modelle.

F: Funktioniert das mit selbstgehostetem n8n?

A: Ja. Der Einrichtungsprozess ist für n8n Cloud und selbstgehostete Docker-Versionen identisch.

F: Welche n8n-Knoten funktionieren mit CometAPI?

A: Jeder Knoten, der OpenAI-Credentials akzeptiert, funktioniert – einschließlich AI Agent, Chat Model und Standard-Completion-Knoten.

F: Kann ich Modelle wechseln, ohne n8n neu zu konfigurieren?

A: Ja. Aktualisieren Sie einfach den Modellnamen-String in den Knoten-Einstellungen (z. B. ändern Sie gpt-5.5 in claude-opus-4-7); das zugrunde liegende Credential bleibt für alle Anbieter gültig.