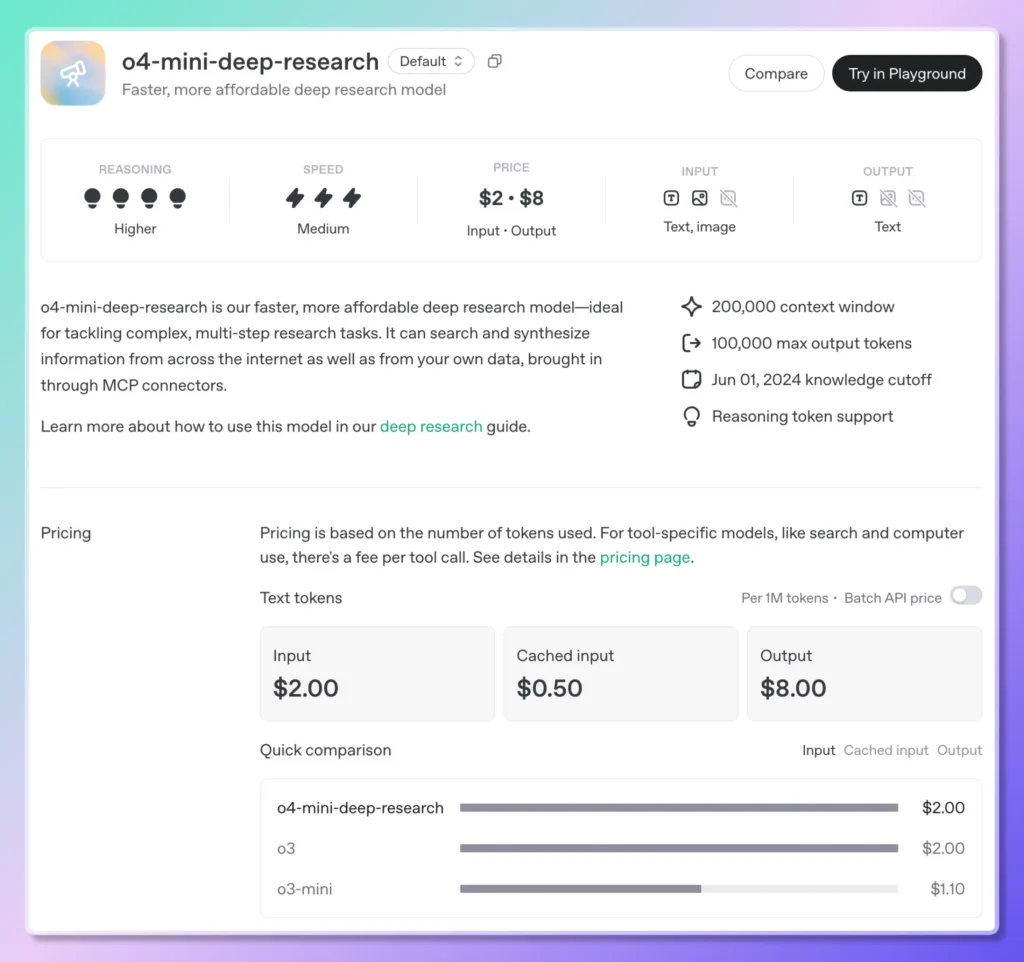

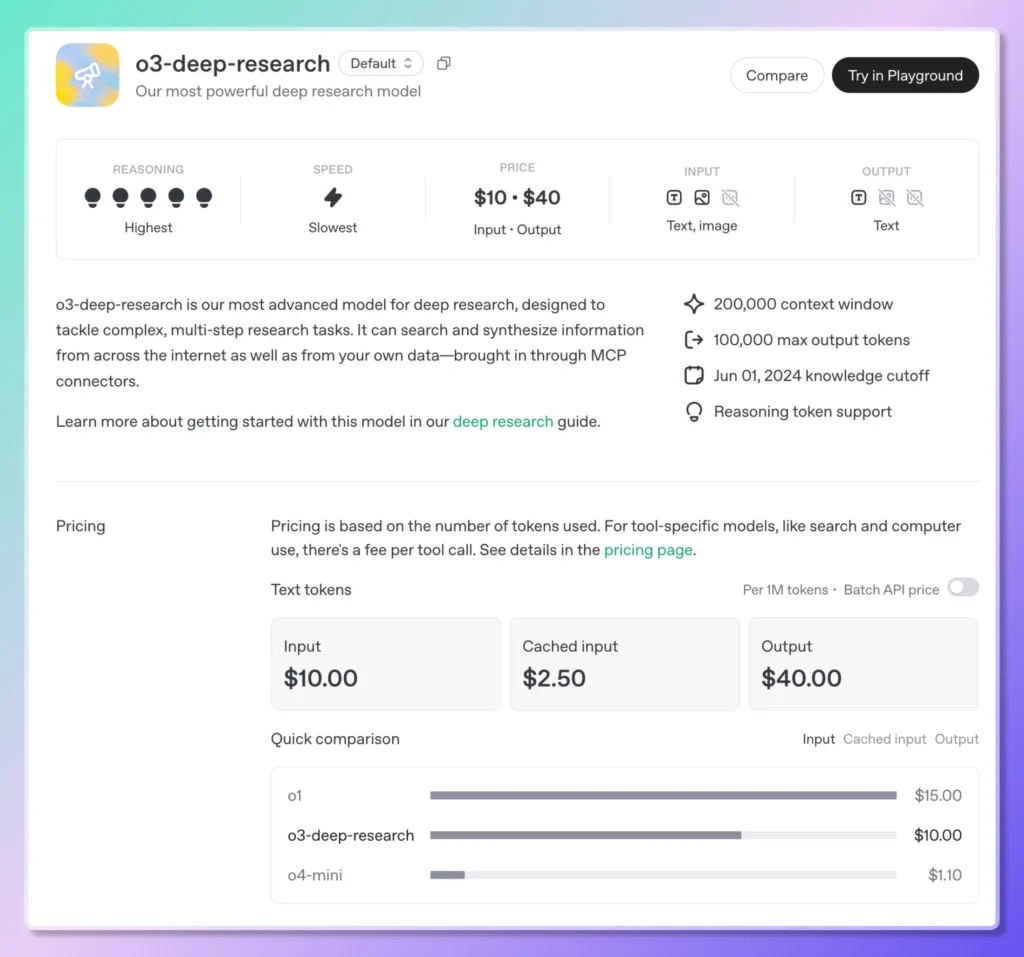

Am 27. Juni 2025 eröffnete OpenAI offiziell den API-Zugriff auf seine Deep Research-Funktionen und ermöglichte es Entwicklern, komplexe, mehrstufige Forschungsabläufe programmgesteuert zu automatisieren. Die sogenannte Deep Research API, dieser neue Dienst stellt zwei speziell entwickelte Modelle bereit—o3-deep-research-2025-06-26 für eine tiefgehende Synthese und eine „höhere Qualität“ der Ausgabe, und die leichtere, niedrigere Latenz o4-mini-deep-research-2025-06-26– über den Standard-Endpunkt „Chat Completions“. Diese Modelle basieren auf den Reasoning Engines, die Anfang des Jahres erstmals im Deep Research-Agenten von ChatGPT eingeführt wurden, bieten Entwicklern nun aber die volle Kontrolle über das Prompt-Design, die Tool-Konfiguration und die asynchrone Ausführung im Hintergrundmodus.

Neben der Bereitstellung dieser spezialisierten Deep Research-Varianten von o3 und o4-mini hat OpenAI auch seine gängigen Reasoning-Modelle verbessert –o3, o3-pro und o4-mini– mit integrierten Websuchfunktionen. Diese Integration ermöglicht es den Modellen, Live-Suchen durchzuführen, aktuelle Informationen abzurufen und Ergebnisse direkt in einem einzigen Aufruf zu synthetisieren. Die Preise für den neuen Service „Reasoning Web Search“ beginnen bei 10 $ pro 1,000 Anrufe, was die erforderliche Premium-Rechenleistung und API-Orchestrierung widerspiegelt; gleichzeitig senkte OpenAI die Kosten für die Websuche auf seinen multimodalen Flaggschiffmodellen (GPT-4o und GPT-4.1) auf 25 $ pro 1,000 Anrufe .

Um langwierige Forschungsaufgaben zu rationalisieren, unterstützt die API jetzt WebhakenEntwickler können Callback-Endpunkte registrieren, um nach Abschluss eines Deep-Research-Jobs automatisch benachrichtigt zu werden. Dadurch entfallen Pollings oder manuelle Statusprüfungen. Dieser Webhook-Mechanismus empfiehlt sich insbesondere für asynchron laufende Workflows – wie mehrstündige Marktanalysen oder Richtlinienüberprüfungen – und gewährleistet so Zuverlässigkeit und effiziente Ressourcennutzung in Produktionssystemen.

Der Zugriff auf die Deep Research API ist unkompliziert. Nach der Installation des neuesten OpenAI SDK und der Authentifizierung mit Ihrem API-Schlüssel geben Entwickler einfach einen der beiden neuen Deep Research-Modellnamen in ihrer Chat Completions-Anfrage an. Durch die Aktivierung Werkzeuge Google Trends, Amazons Bestseller web_search_preview kombiniert mit einem nachhaltigen Materialprofil. code_interpreter und Einstellen der background Flag auf „true“ gesetzt ist, zerlegt das Modell Abfragen auf hoher Ebene selbstständig in Unterfragen, führt Suchvorgänge aus, führt Analysen durch und gibt einen strukturierten, zitationsreichen Bericht zurück – komplett mit Inline-Metadaten und Quell-URLs.

Diese Einführung stellt eine bedeutende Weiterentwicklung der Produkt-Roadmap von OpenAI dar. Anfang dieses Jahres, im Februar 2025, debütierte der Deep Research Agent in ChatGPT als Funktion der nächsten Generation – basierend auf einer optimierten Variante von o3 – für Aufgaben, die menschliche Analysten früher Dutzende von Stunden in Anspruch nahmen. Er kombinierte Browsing, die Nutzung von Python-Tools und iteratives Denken, um in weniger als einer halben Stunde fundierte, überprüfbare Ergebnisse zu liefern. Mit der API-Version können Unternehmen und Startups diese analytische Leistungsfähigkeit in ihre eigenen Anwendungen integrieren und so Anwendungsfälle von Wettbewerbsanalysen und Literaturrecherchen bis hin zu technischer Due Diligence und darüber hinaus vorantreiben.

Darüber hinaus verwischt die breitere Einführung der Websuche in den Modellen o3, o3-pro und o4-mini die Grenze zwischen statischem Wissen und Echtzeit-Informationsabruf. Entwickler können nun Eingabeaufforderungen erstellen, die das Modell anweisen, „die neueste Quartalsergebnismeldung zu finden“ oder „aktuelle regulatorische Entwicklungen im EU-Datenschutz zusammenzufassen“. Das Modell ruft relevante Quellen selbstständig ab, interpretiert sie und zitiert sie – alles innerhalb einer einzigen API-Transaktion. Dieser einheitliche Ansatz steht im Gegensatz zu früheren Mustern, bei denen separate Such- und Zusammenfassungspipelines erforderlich waren, und reduziert so Integrationskomplexität und Latenz.

Aus geschäftlicher Sicht spiegeln die mit diesen Funktionen verbundenen Preisanpassungen OpenAIs Bestreben wider, fortgeschrittenes Reasoning zu demokratisieren und gleichzeitig die Infrastrukturkosten niedrig zu halten. Der Tarif von 10 US-Dollar pro 1-Anruf für die Reasoning-Websuche positioniert den Dienst wettbewerbsfähig gegenüber spezialisierten Datenpipeline-Anbietern, während der reduzierte Tarif von 25 US-Dollar pro 1-Anruf für die GPT-4/4.1-Websuche OpenAIs Engagement unterstreicht, dynamische, toolgestützte KI in großem Maßstab erschwinglich zu machen.

Für die Zukunft hat OpenAI kontinuierliche Investitionen in das Deep Research-Ökosystem angekündigt: Modellaktualisierungen, erweiterte Tool-Unterstützung (einschließlich direkter Datenbankkonnektoren und privater Dokumentintegrationen über MCP) sowie tiefergehende multimodale Analysefunktionen stehen auf dem Plan. Mit der Weiterentwicklung dieser Funktionen wird sich die Grenze zwischen KI als Gesprächspartner und KI als autonomem Forschungsassistenten weiter auflösen – und damit eine neue Ära agentenbasierter Anwendungen einläuten, die mit minimalem menschlichen Eingriff untersuchen, argumentieren und umsetzbare Erkenntnisse liefern können.

Erste Schritte

CometAPI bietet eine einheitliche REST-Schnittstelle, die Hunderte von KI-Modellen aggregiert – unter einem konsistenten Endpunkt, mit integrierter API-Schlüsselverwaltung, Nutzungskontingenten und Abrechnungs-Dashboards. Anstatt mit mehreren Anbieter-URLs und Anmeldeinformationen zu jonglieren.

Entwickler können zugreifen o3-Pro API(Modell: o3-pro; o3-pro-2025-06-10), O3 API (Modell:o3;o3-2025-04-16 )und O4-Mini API(Modell: o4-mini;o4-mini-2025-04-16) Durch CometAPIDie neuesten Modelle sind zum Veröffentlichungsdatum des Artikels aufgeführt. Erkunden Sie zunächst die Funktionen des Modells im Spielplatz und konsultieren Sie die API-Leitfaden Für detaillierte Anweisungen. Stellen Sie vor dem Zugriff sicher, dass Sie sich bei CometAPI angemeldet und den API-Schlüssel erhalten haben. CometAPI bieten einen Preis weit unter dem offiziellen Preis an, um Ihnen bei der Integration zu helfen.

Die neueste Integration o3-deep-research (Modell:

o3-deep-research-2025-06-26) und o4-mini-deep-research (Modell: o4-mini-deep-research-2025-06-26) wird bald auf CometAPI erscheinen, also bleiben Sie dran! Während wir den Upload des Gemini 2.5 Flash-Lite-Modells abschließen, erkunden Sie unsere anderen Modelle auf der Seite „Modelle“ oder probieren Sie sie im AI Playground aus.