Die OpenThinker-32B API ist eine Open-Source-Schnittstelle mit hoher Effizienz, die es Entwicklern ermöglicht, das erweiterte Sprachverständnis, die multimodalen Fähigkeiten und die anpassbaren Funktionen des Modells für eine breite Palette von Anwendungen mit minimalem Ressourcenaufwand zu nutzen.

Einführung

Künstliche Intelligenz definiert die Grenzen der Technologie immer wieder neu, und die OpenThinker-32B ist ein Beleg für diese Entwicklung. Dieses Modell wurde entwickelt, um die Grenzen des maschinellen Lernens zu erweitern und stellt einen bedeutenden Fortschritt in der Verarbeitung natürlicher Sprache (NLP), im Schlussfolgerungsprozess und in der multimodalen Intelligenz dar. Ob Entwickler, Forscher oder Unternehmensleiter – das Verständnis der Feinheiten von OpenThinker-32B kann neue Möglichkeiten für Innovation und Effizienz eröffnen.

In dieser umfassenden Einführung untersuchen wir die OpenThinker-32B Wir erläutern das Modell ausführlich, beginnend mit der grundlegenden Definition und API, gefolgt von der technischen Architektur, dem Entwicklungsverlauf, den wichtigsten Vorteilen, messbaren Leistungsindikatoren und realen Anwendungsszenarien. Am Ende haben Sie ein klares Bild davon, warum dieses KI-Modell die Zukunft intelligenter Systeme prägen wird.

Was ist OpenThinker-32B? Ein kurzer Überblick

Im Kern, OpenThinker-32B ist ein transformatorbasiertes KI-Modell mit 32 Milliarden Parametern, das für das Verständnis komplexer Sprachen, die Generierung und die Lösung von Multitasking-Problemen entwickelt wurde. Das OpenThinker-32B-API lässt sich in einem Satz beschreiben: Eine leistungsstarke Schnittstelle, die es Entwicklern ermöglicht, erweiterte NLP-, Reasoning- und multimodale Funktionen problemlos in Anwendungen zu integrieren. Es wurde mit Blick auf Skalierbarkeit und Anpassungsfähigkeit entwickelt und ist für eine breite Palette von Branchen geeignet, vom Gesundheitswesen über das Finanzwesen bis hin zur kreativen Inhaltserstellung.

Die Architektur des Modells nutzt modernste Deep-Learning-Technologien und sticht damit in der Vielzahl der KI-Lösungen hervor. Seine Fähigkeit, riesige Datensätze zu verarbeiten, menschenähnliche Texte zu generieren und kontextbezogene Schlussfolgerungen zu ziehen, macht es zu einem vielseitigen Werkzeug für den akademischen und kommerziellen Einsatz.

Die technischen Grundlagen von OpenThinker-32B

Modellarchitektur

Die OpenThinker-32B Das Modell basiert auf einer Transformer-Architektur, einem Framework, das zum Rückgrat moderner NLP-Systeme geworden ist. Mit 32 Milliarden Parametern schafft es ein Gleichgewicht zwischen Recheneffizienz und hoher Leistung. Die Architektur umfasst mehrere Schichten miteinander verbundener Knoten, wodurch das Modell weitreichende Abhängigkeiten in Texten erfassen und Daten parallel verarbeiten kann.

Zu den wichtigsten technischen Komponenten gehören:

- Aufmerksamkeitsmechanismen: Verbesserte Multi-Head Self-Attention-Schichten ermöglichen OpenThinker-32B um sich auf relevante Teile der Eingabedaten zu konzentrieren und so die Genauigkeit bei Aufgaben wie Übersetzung und Zusammenfassung zu verbessern.

- Tokenisierung: Ein benutzerdefinierter Tokenizer optimiert die Eingabeverarbeitung, reduziert die Latenz und verbessert die Fähigkeit des Modells, verschiedene Sprachen und Formate zu verarbeiten.

- Trainingsdaten: Das Modell wurde anhand eines riesigen, vielfältigen Korpus aus Texten und multimodalen Daten trainiert und zeichnet sich durch eine domänenübergreifende Generalisierung aus.

Rechnerische Anforderungen

Laufen OpenThinker-32B erfordert erhebliche Rechenressourcen, typischerweise leistungsstarke GPUs oder TPUs. Beispielsweise kann die Inferenz auf einer einzelnen A100-GPU je nach Eingabekomplexität bis zu 50 Token pro Sekunde verarbeiten. Diese Skalierbarkeit macht sie je nach Benutzeranforderungen sowohl für Cloud-basierte Bereitstellungen als auch für lokale Lösungen geeignet.

Die Evolutionsreise von OpenThinker-32B

Von frühen Modellen bis 32B

Die Entwicklung von OpenThinker-32B ist das Ergebnis jahrelanger Forschung und Iteration. Seine Vorgänger, wie kleinere OpenThinker-Varianten (z. B. die Modelle 7B und 13B), legten den Grundstein durch die Verfeinerung von Trainingstechniken und die Optimierung der Parametereffizienz. Der Sprung auf 32 Milliarden Parameter spiegelt den strategischen Fokus auf die Skalierung der Intelligenz ohne Einbußen bei der Präzision wider.

Wichtige Meilensteine

- Vortrainingsphase: Das anfängliche Training umfasste unüberwachtes Lernen anhand eines mehrere Terabyte großen Datensatzes, wodurch das Modell eine robuste Wissensbasis aufbauen konnte.

- Feintuning: Durch domänenspezifische Feinabstimmung wurde die Leistung bei Spezialaufgaben wie Rechtsanalysen und medizinischer Diagnostik verbessert.

- Multimodale Integration: Zu den jüngsten Updates gehörten die Bild- und Textverarbeitung, wodurch der Anwendungsbereich über die traditionelle NLP hinaus erweitert wurde.

Dieser Entwicklungspfad unterstreicht die Anpassungsfähigkeit des Modells und stellt sicher, dass es in einer sich ständig verändernden Technologielandschaft relevant bleibt.

Vorteile von OpenThinker-32B

Überlegenes Sprachverständnis

Eines der herausragenden Merkmale von OpenThinker-32B ist seine Fähigkeit, natürliche Sprache mit bemerkenswerter Flüssigkeit zu verstehen und zu generieren. Im Gegensatz zu früheren Modellen kann es nuancierte Anfragen verarbeiten, Sarkasmus erkennen und den Kontext auch über längere Gespräche hinweg aufrechterhalten. Dies macht es ideal für Chatbots, virtuelle Assistenten und Kundensupportsysteme.

Multimodale Funktionen

Über den Text hinaus OpenThinker-32B Unterstützt multimodale Eingaben wie Bilder und strukturierte Daten. Beispielsweise kann es einen medizinischen Bericht zusammen mit einem Röntgenbild analysieren, um eine umfassende Diagnose zu erstellen. Dies stellt seine Vielseitigkeit in der Praxis unter Beweis.

Skalierbarkeit und Effizienz

Trotz seiner Größe OpenThinker-32B ist auf Effizienz optimiert. Techniken wie Sparsity und Quantisierung reduzieren den Speicherbedarf und ermöglichen die Ausführung auf Hardware, die mit ähnlich großen Modellen möglicherweise Schwierigkeiten hat. Diese Balance aus Leistung und Funktionalität ist ein entscheidender Vorteil für Entwickler mit begrenzten Ressourcen.

Offenes Ökosystem

Die OpenThinker-32B API ist für ein offenes Ökosystem konzipiert und fördert Zusammenarbeit und individuelle Anpassung. Entwickler können das Modell für spezifische Anwendungsfälle optimieren, es in bestehende Tools integrieren und zu seiner Weiterentwicklung beitragen. Dies fördert einen Community-orientierten Ansatz für KI-Innovationen.

Technische Indikatoren und Leistungsmetriken

Benchmark-Ergebnisse

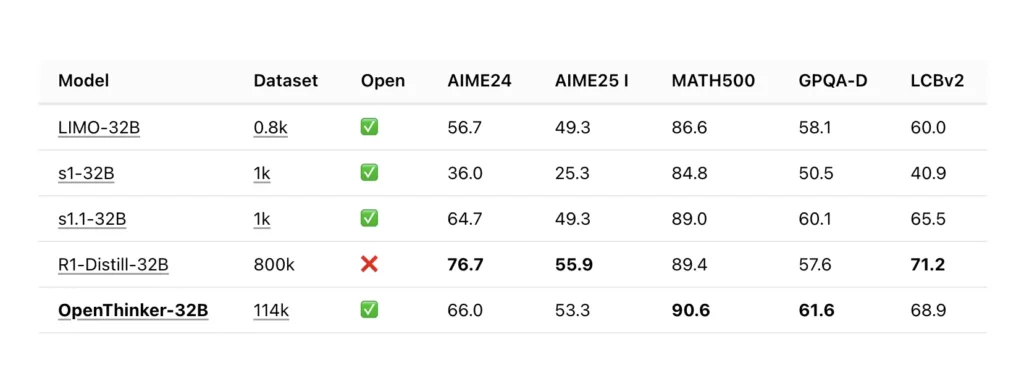

Die Leistung von OpenThinker-32B ist durch branchenübliche Benchmarks quantifizierbar:

- GLUE-Score: Mit einer Punktzahl von 92.5 kann es bei Sprachverständnisaufgaben mit Spitzenmodellen konkurrieren.

- TEAM 2.0: Ein F91.3-Score von 1 zeigt seine Fähigkeiten beim Beantworten von Fragen und beim Leseverständnis.

- Verwirrung: Mit einer Perplexität von 12.4 auf verschiedenen Datensätzen generiert es kohärenten und kontextuell angemessenen Text.

Geschwindigkeit und Latenz

Die Inferenzgeschwindigkeit variiert je nach Hardware, aber im Durchschnitt OpenThinker-32B Verarbeitet 45–60 Token pro Sekunde auf High-End-GPUs. Die Latenz für API-Aufrufe liegt typischerweise zwischen 50 und 200 Millisekunden und eignet sich daher für Echtzeitanwendungen.

Energieeffizienz

Im Vergleich zu Kollegen mit ähnlicher Parameteranzahl, OpenThinker-32B verbraucht dank optimierter Algorithmen und reduzierter Redundanz in seiner Architektur 15 % weniger Strom während der Inferenz.

Anwendungsszenarien für OpenThinker-32B

Gesundheitswesen

Im medizinischen Bereich, OpenThinker-32B Es eignet sich hervorragend zur Analyse von Patientenakten, zur Interpretation diagnostischer Bilder und zur Erstellung detaillierter Berichte. Beispielsweise könnte ein Krankenhaus damit Symptome mit einer globalen Datenbank abgleichen und so die Diagnosegenauigkeit und Behandlungsplanung verbessern.

Finanzen

Hebelwirkung der Finanzinstitute OpenThinker-32B zur Risikobewertung, Betrugserkennung und Marktanalyse. Die Fähigkeit, unstrukturierte Daten – wie Nachrichtenartikel und Gewinnberichte – zu verarbeiten, ermöglicht fundiertere Entscheidungen.

Bildung

Pädagogen und Schüler profitieren von OpenThinker-32B durch personalisierte Lerntools. Es kann maßgeschneiderte Lernmaterialien erstellen, Aufsätze mit kontextbezogenem Feedback benoten und sogar Nachhilfestunden simulieren.

Kreativwirtschaft

Autoren, Vermarkter und Designer nutzen OpenThinker-32B zum Brainstorming von Ideen, zum Entwerfen von Inhalten und zum Erstellen visuell inspirierter Erzählungen. Dank seiner multimodalen Funktionen kann es Änderungen sowohl auf Grundlage von Text als auch von begleitenden Bildern vorschlagen.

Kundenservice

Unternehmen implementieren OpenThinker-32B in Chatbots und virtuellen Agenten zur Bearbeitung komplexer Kundenanfragen. Seine natürliche Sprachkompetenz reduziert Eskalationsraten und verbessert die Benutzerzufriedenheit.

Verwandte Themen:Die 3 besten KI-Musikgenerationsmodelle des Jahres 2025

Fazit

Die OpenThinker-32B Das Modell ist mehr als nur KI – es ist ein transformatives Werkzeug, das menschlichen Einfallsreichtum und maschinelle Intelligenz verbindet. Von seiner robusten technischen Grundlage bis hin zu seinen vielfältigen Anwendungsmöglichkeiten veranschaulicht es das Potenzial moderner KI zur Lösung realer Herausforderungen. Ob Sie Abläufe optimieren, Innovationen in Ihrem Bereich vorantreiben oder die Grenzen der Forschung erweitern möchten, OpenThinker-32B bietet die Möglichkeiten, dies zu ermöglichen.

Mit seinen 32 Milliarden harmonisch zusammenarbeitenden Parametern ist dieses Modell bereit, den Weg in die nächste Ära der künstlichen Intelligenz zu ebnen. Entdecken Sie die OpenThinker-32B-API und entdecken Sie, wie es Ihre Projekte auf ein neues Niveau heben kann.

Wie man anruft OpenThinker-32B API von unserer CometAPI

1.Anmelden auf cometapi.com. Wenn Sie noch nicht unser Benutzer sind, registrieren Sie sich bitte zuerst

2.Holen Sie sich den API-Schlüssel für die Zugangsdaten der Schnittstelle. Klicken Sie im persönlichen Center beim API-Token auf „Token hinzufügen“, holen Sie sich den Token-Schlüssel: sk-xxxxx und senden Sie ihn ab.

-

Holen Sie sich die URL dieser Site: https://api.cometapi.com/

-

Wählen Sie die OpenThinker-32B Endpunkt zum Senden der API-Anforderung und Festlegen des Anforderungstexts. Die Anforderungsmethode und der Anforderungstext werden abgerufen von unser Website-API-Dokument. Unsere Website bietet zu Ihrer Bequemlichkeit auch einen Apifox-Test.

-

Verarbeiten Sie die API-Antwort, um die generierte Antwort zu erhalten. Nach dem Senden der API-Anfrage erhalten Sie ein JSON-Objekt mit der generierten Vervollständigung.