Die Qwen2.5-Omni-7B-API bietet Entwicklern OpenAI-kompatible Methoden zur Interaktion mit dem Modell, ermöglicht die Verarbeitung von Text-, Bild-, Audio- und Videoeingaben und generiert sowohl Text- als auch natürliche Sprachantworten in Echtzeit.

Was ist Qwen2.5-Omni-7B?

Qwen2.5-Omni-7B ist Alibabas Flaggschiff-Modell für multimodale KI mit 7 Milliarden Parametern. Es wurde für die Verarbeitung und das Verständnis mehrerer Datenmodalitäten entwickelt und unterstützt Text-, Bild-, Audio- und Videoeingaben. Das Modell ermöglicht Sprach- und Videointeraktionen in Echtzeit und ist somit ein vielseitiges Werkzeug für verschiedene Anwendungen.

Hauptmerkmale von Qwen2.5-Omni-7B

- Multimodale Verarbeitung: Kann unterschiedliche Eingaben verarbeiten, darunter Text, Bilder, Audio und Video, und ermöglicht so ein umfassendes Datenverständnis.

- Echtzeit-Interaktion: Unterstützt die Verarbeitung mit geringer Latenz und ermöglicht so Sprach- und Videogespräche in Echtzeit.

- Denker-Sprecher-Architektur: Verwendet ein System mit dualer Architektur, bei dem der „Denker“ die Datenverarbeitung und das Datenverständnis verwaltet, während der „Sprecher“ flüssige Sprachausgaben erzeugt.

- Zeitlich ausgerichtetes multimodales RoPE (TMRoPE): Verwendet TMRoPE für die präzise Synchronisierung zeitlicher Daten über verschiedene Modalitäten hinweg und gewährleistet so ein kohärentes Verständnis und die Generierung von Antworten.

Leistungskennzahlen:

Benchmark-Erfolge

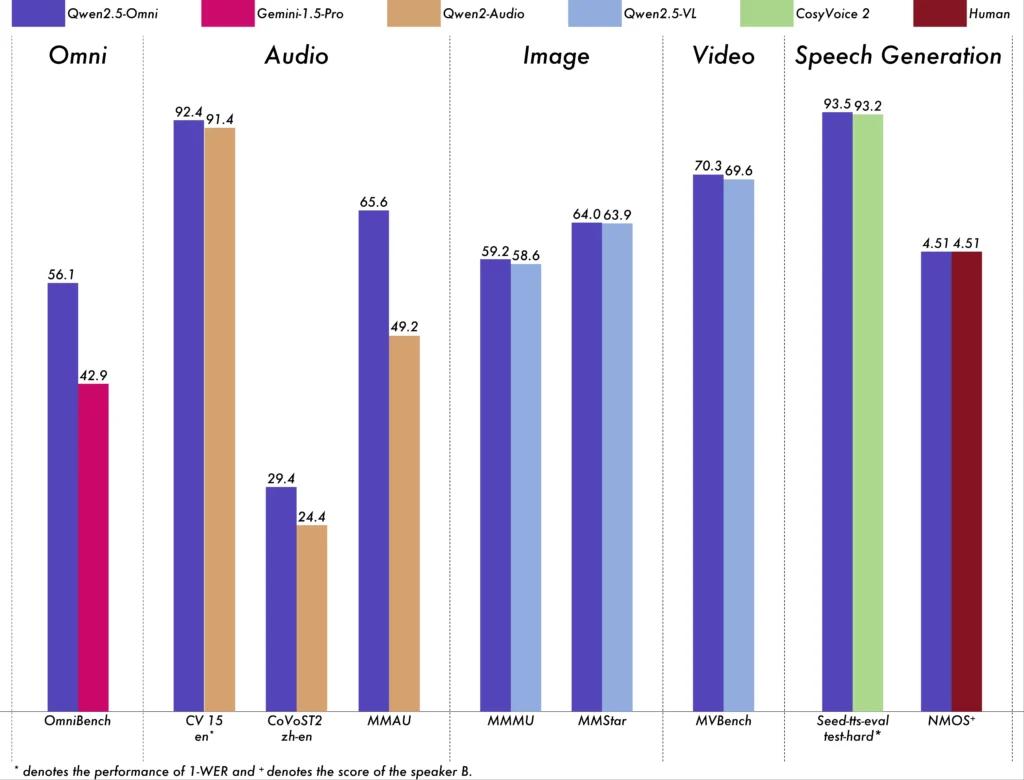

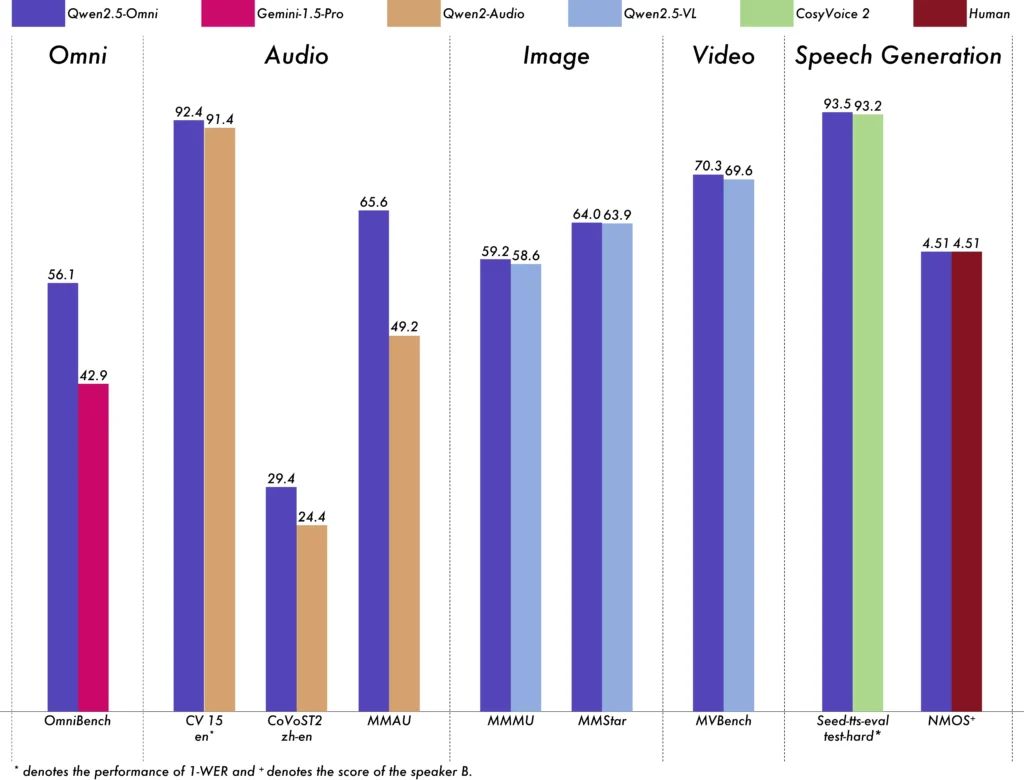

Qwen2.5-Omni-7B hat in verschiedenen Benchmarks eine außergewöhnliche Leistung gezeigt:

- OmniBench: Erreichte eine durchschnittliche Punktzahl von 56.13 % und übertraf damit Modelle wie Gemini-1.5-Pro (42.91 %) und MIO-Instruct (33.80 %).

- Spracherkennung: Im Librispeech-Datensatz erreichte es Wortfehlerraten zwischen 1.6 % und 3.5 %, vergleichbar mit spezialisierten Modellen wie Whisper-large-v3.

- Tonereigniserkennung: Erzielte einen Wert von 0.570 im Meld-Datensatz und setzte damit einen neuen Maßstab in diesem Bereich.

- Musikverständnis: Erreichte im GiantSteps Tempo-Benchmark eine Punktzahl von 0.88, was seine Kompetenz im Musikverständnis unterstreicht.

Echtzeit-Verarbeitungsfunktionen

Qwen2.5-Omni-7B wurde für Echtzeitanwendungen entwickelt und unterstützt Block-für-Block-Streaming, wodurch eine sofortige Audiogenerierung mit minimaler Latenz ermöglicht wird. Diese Funktion ist besonders nützlich für Anwendungen, die schnelle Reaktionen erfordern, wie z. B. virtuelle Assistenten und interaktive KI-Systeme.

Technische Daten

Architekturdesign

- Denker-Sprecher-Rahmenwerk: Die Komponente „Thinker“ verarbeitet und versteht multimodale Eingaben und generiert hochrangige semantische Darstellungen und Textausgaben. Der „Talker“ wandelt diese Darstellungen in natürliche, flüssige Sprache um und gewährleistet so eine nahtlose Kommunikation zwischen dem KI-System und den Nutzern.

- TMRoPE-Mechanismus: Bewältigt die Herausforderung der Synchronisierung zeitlicher Daten aus verschiedenen Quellen durch die Ausrichtung der Zeitstempel von Video- und Audioeingaben und erleichtert so ein kohärentes multimodales Verständnis.

Trainingsmethodik

Das Modell durchlief einen dreiphasigen Trainingsprozess:

- Phase Eins: Feste Sprachmodellparameter beim Training visueller und Audio-Encoder mithilfe umfangreicher Audio-Text- und Bild-Text-Paare zur Verbesserung des multimodalen Verständnisses.

- Phase Zwei: Alle Parameter freigegeben und anhand eines vielfältigen Datensatzes aus Bildern, Videos, Audiodateien und Text trainiert, wodurch das umfassende multimodale Verständnis weiter verbessert wird.

- Phase Drei: Der Schwerpunkt liegt auf dem Training von Langsequenzdaten, um die Fähigkeit des Modells zur Verarbeitung komplexer, erweiterter Eingaben zu stärken.

Entwicklung der Qwen-Modelle

Fortschritt von Qwen zu Qwen2.5

Die Weiterentwicklung von Qwen zu Qwen2.5 stellt einen erheblichen Sprung in der Entwicklung von KI-Modellen dar:

- Erweiterte Parameter: Qwen2.5 wurde auf Modelle mit bis zu 72 Milliarden Parametern erweitert und bietet skalierbare Lösungen für verschiedene Anwendungen.

- Erweiterte Kontextverarbeitung: Einführung der Fähigkeit, bis zu 128,000 Token zu verarbeiten, was die Handhabung umfangreicher Dokumente und komplexer Gespräche erleichtert.

- Codierungsfunktionen: Die Variante Qwen2.5-Coder unterstützt über 92 Programmiersprachen und hilft bei der Codegenerierung, Fehlerbehebung und Optimierungsaufgaben.

Vorteile von Qwen2.5-Omni-7B

Umfassende multimodale Integration

Durch die effektive Verarbeitung von Text, Bildern, Audio und Video bietet Qwen2.5-Omni-7B eine ganzheitliche KI-Lösung, die für eine breite Palette von Anwendungen geeignet ist.

Echtzeit-Interaktion

Die Verarbeitung mit geringer Latenz gewährleistet sofortige Reaktionen und verbessert das Benutzererlebnis bei interaktiven Anwendungen.

Open-Source-Zugänglichkeit

Als Open-Source-Modell fördert Qwen2.5-Omni-7B die Transparenz und ermöglicht Entwicklern, das Modell ohne proprietäre Einschränkungen anzupassen und in verschiedene Plattformen zu integrieren.

Technische Indikatoren

- Modellparameter: 7 Milliarden

- Eingabemodalitäten: Text, Bild, Audio, Video

- Ausgabemodalitäten: Text, Sprache

- Verarbeitungsfähigkeit: Sprach- und Videointeraktion in Echtzeit

- Leistungsbenchmarks:

- OmniBench: 56.13 % Durchschnittsnote

- Librispeech (Wortfehlerrate): Test-sauber: 1.8 %, Test-andere: 3.4 %

Anwendungsszenarien

Interaktive virtuelle Assistenten

Die Echtzeitverarbeitung und das multimodale Verständnis von Qwen2.5-Omni-7B machen es ideal für virtuelle Assistenten, die natürlich sehen, hören und reagieren können.

Erstellung multimedialer Inhalte

Inhaltsersteller können das Modell nutzen, um ansprechende Multimediainhalte zu erstellen und dabei Text, Bilder und Audio nahtlos zu kombinieren.

Assistive Technologien

Die Funktionen des Modells können Menschen mit Behinderungen helfen, beispielsweise durch die Bereitstellung von beschreibendem Audio für visuelle Inhalte.

Anwendungstipps

Leistung optimieren

Um eine optimale Leistung zu erzielen, insbesondere bei Echtzeitanwendungen, wird empfohlen, Hardwarebeschleuniger zu verwenden und für ausreichend GPU-Speicher zu sorgen.

Integration mit bestehenden Systemen

Entwickler sollten bei der Integration in vorhandene Anwendungen die Eingabe- und Ausgabeformate des Modells berücksichtigen, um die Kompatibilität sicherzustellen und die Effizienz zu maximieren.

Bleiben Sie auf dem Laufenden

Überprüfen Sie regelmäßig die offiziellen Repositories und die Dokumentation auf Updates und Best Practices, um die Funktionen von Qwen2.5-Omni-7B voll auszuschöpfen.

Verwandte Themen So führen Sie das Qwen2.5-Omni-7B-Modell aus

Fazit

Qwen2.5-Omni-7B veranschaulicht die Konvergenz von fortschrittlicher KI-Forschung und praktischer Anwendung und bietet eine vielseitige und effiziente Lösung für eine Vielzahl von Aufgaben in verschiedenen Branchen. Der Open-Source-Charakter gewährleistet die Zugänglichkeit und Anpassungsfähigkeit und ebnet so den Weg für zukünftige Innovationen im Bereich multimodaler KI.

So rufen Sie die Qwen2.5-Omni-7B-API von CometAPI auf

1.Anmelden zu cometapi.comWenn Sie noch nicht unser Benutzer sind, registrieren Sie sich bitte zuerst

2.Holen Sie sich den API-Schlüssel für die Zugangsdaten der Schnittstelle. Klicken Sie im persönlichen Center beim API-Token auf „Token hinzufügen“, holen Sie sich den Token-Schlüssel: sk-xxxxx und senden Sie ihn ab.

-

Holen Sie sich die URL dieser Site: https://api.cometapi.com/

-

Wählen Sie den Qwen2.5-Omni-7B-Endpunkt aus, um die API-Anforderung zu senden und den Anforderungstext festzulegen. Die Anforderungsmethode und der Anforderungstext werden abgerufen von unser Website-API-Dokument. Unsere Website bietet zu Ihrer Bequemlichkeit auch einen Apifox-Test.

-

Verarbeiten Sie die API-Antwort, um die generierte Antwort zu erhalten. Nach dem Senden der API-Anfrage erhalten Sie ein JSON-Objekt mit der generierten Vervollständigung.