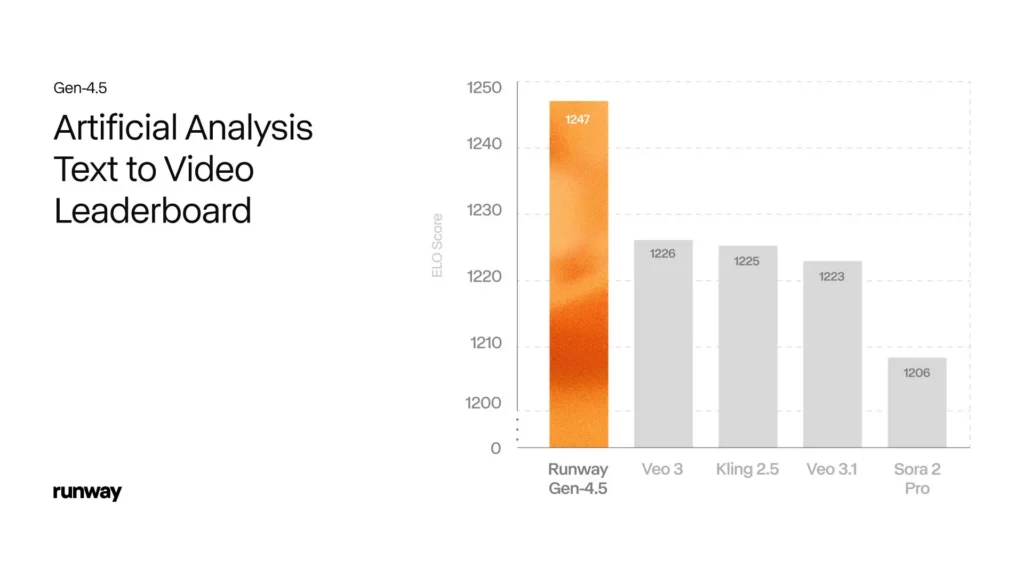

Runway Gen-4.5 ist das neueste Flaggschiff-Modell des Unternehmens für Text-zu-Video-Konvertierung und wurde am 1. Dezember 2025 angekündigt. Es positioniert sich als schrittweise, aber bedeutende Weiterentwicklung der Gen-4-Familie mit gezielten Verbesserungen in Bewegungsqualität, Reaktionsschnelligkeit und zeitlichem/physikalischem Realismus – genau jenen Bereichen, die in der Vergangenheit „gute“ von „glaubwürdigen“ KI-Videos unterschieden haben. Runway Gen-4.5 führt aktuell die Rangliste der KI-gestützten Text-zu-Video-Konvertierung an (1,247 Elo-Punkte) und ist auf kinoreife, kontrollierbare Ergebnisse optimiert – weist aber dennoch die typischen Einschränkungen generativer KI auf, wie z. B. Artefakte in kleinen Details und gelegentliche Kausalitätsfehler.

Nachfolgend finden Sie einen detaillierten, praxisorientierten und (wo möglich) faktengestützten Einblick in die Gen-4.5-Technologie, die Neuerungen gegenüber der Gen-4-Technologie, ihren Vergleich mit Konkurrenten wie Googles Veo (3.1) und OpenAIs Sora 2, reale Leistungsindikatoren und Benchmark-Angaben sowie eine offene Diskussion über Einschränkungen, Risiken und bewährte Verfahren.

Was ist Runway Gen-4.5?

Runway Gen-4.5 ist das neueste Text-zu-Video-Generierungsmodell von Runway und stellt ein umfassendes, aber iteratives Upgrade der Gen-4-Reihe dar. Runway positioniert Gen-4.5 als „neue Grenze“ der Videogenerierung und hebt drei wesentliche Verbesserungen gegenüber früheren Versionen hervor: deutlich verbesserte physikalische Genauigkeit (Objekte haben realistisches Gewicht und eine realistische Bewegung), zuverlässigere Umsetzung von Eingabeaufforderungen (Ihre Eingabe wird zuverlässiger ausgeführt) und höhere visuelle Qualität über Bewegung und Zeit hinweg (Details wie Haare, Stoffstruktur und Oberflächenreflexionen bleiben in allen Frames konsistent). Gen-4.5 belegt derzeit den Spitzenplatz in unabhängigen, von Experten bewerteten Bestenlisten für Text-zu-Video-Benchmarks.

Woher stammt Runway Gen-4.5 und warum ist das wichtig?

Die Videomodelle von Runway haben sich von Gen-1 über Gen-3/Alpha zu Gen-4 rasant weiterentwickelt. Gen-4.5 präsentiert sich als Konsolidierung und Optimierung architektonischer Verbesserungen, Strategien für das Vortraining und Techniken für das Nachtraining, um Dynamik, zeitliche Konsistenz und Kontrollierbarkeit zu maximieren. Für Kreative und Produktionsteams sollen diese Verbesserungen KI-generierte Clips funktional nutzbar machen – für die Vorvisualisierung, Werbe-/Marketinginhalte und die Produktion kurzer narrativer Formate –, indem der unfertige Eindruck, den frühere Text-zu-Video-Modelle oft vermittelten, reduziert wird.

4 Hauptmerkmale von Runway Gen-4.5

1) Verbesserte physikalische Realitätsnähe und Bewegungsdynamik

Runway Gen-4.5 legt Wert auf flüssigere und physikalisch plausiblere Bewegungen. Der Fokus liegt auf realistischen Objektbewegungen – Gewicht, Trägheit, Flüssigkeiten, Stoffe und physikalisch plausible Kollisionen – wodurch Sequenzen entstehen, in denen Interaktionen weniger schwebend und realistischer wirken. In Demos und meinem Test zeigte das Modell verbesserte Objektbahnen, realistischere Kamerabewegungen und weniger Artefakte, die frühere Videomodelle beeinträchtigten. Dies ist eines der wichtigsten Upgrades gegenüber Gen-4.

2) Visuelle Wiedergabetreue und Stileinstellungen

Runway Gen-4.5 erweitert die Steuerungsmodi von Runway (Text-zu-Video, Bild-zu-Video, Video-zu-Video, Keyframes) und verbessert fotorealistisches Rendering, Stilisierung und filmische Komposition. Laut Runway kann Gen-4.5 fotorealistische Clips erzeugen, die in kurzen Sequenzen kaum von realen Aufnahmen zu unterscheiden sind, insbesondere in Kombination mit einem guten Referenzbild oder Keyframes.

3) Bessere Einhaltung der Vorgaben und ein besseres Verständnis der Zusammensetzung.

Das Modell zeigt eine verbesserte Genauigkeit, wenn die Anweisungen mehrere Akteure, Kamerarichtungen oder Szenenübergänge beinhalten; es befolgt Anweisungen zuverlässiger als frühere Generationen. Es erreicht eine höhere Genauigkeit bei der Umsetzung beschreibender Anweisungen, was zu weniger halluzinierten oder irrelevanten Elementen in einem Clip führt.

4) Höhere visuelle Detailgenauigkeit und zeitliche Stabilität.

Oberflächentextur, Haar-/Filamentkontinuität und gleichmäßige Beleuchtung über alle Frames hinweg wurden deutlich verbessert. Charaktere und Objekte verändern ihr Aussehen seltener mitten im Clip. Laut Runway wurden diese Verbesserungen erzielt, ohne das Latenzprofil von Gen-4 zu beeinträchtigen. Eine der produktionsrelevanteren Neuerungen ist die verbesserte Darstellung von Gesichtsausdrücken und impliziten Emotionen über verschiedene Einstellungen hinweg. Runway Gen-4.5 ist zwar kein Ersatz für professionelle Schauspieler, bewahrt aber die emotionale Kontinuität besser (der Gesichtsausdruck eines Charakters bleibt beispielsweise auch bei Kamerabewegungen erhalten) und kann aus kurzen Anweisungen wie „ängstliches Lächeln, Blick abgewandt, scharfes Atmen“ plausible Performance-Hinweise generieren.

Wie schneidet Runway Gen-4.5 in Benchmarks und realen Tests ab?

Runway meldet eine Elo-Punktzahl von 1,247 auf der Rangliste für Text-zu-Video-Anwendungen von Artificial Analysis (zum Zeitpunkt der Ankündigung) – wodurch Gen-4.5 zum Zeitpunkt der Berichterstattung an der Spitze dieses speziellen Benchmarks steht. Benchmarks wie diese verwenden paarweise menschliche oder automatisierte Präferenzbeurteilungen über viele Modellausgaben hinweg;

Praktische Leistung (was Benutzer erwarten können)

- Cliplängen und Auflösung: Gen-4.5 ist aktuell für kurze Filmclips optimiert (Einzelaufnahmen, üblicherweise 4–20 Sekunden in HD/1080p). Runway legte Wert darauf, im Vergleich zu Gen-4 eine höhere Bildqualität ohne zusätzliche Latenz zu bieten.

- Renderzeiten und Kosten: Runway gibt an, dass Kosten und Latenz über alle Abonnementstufen hinweg mit Gen-4 vergleichbar sind; die tatsächlichen Laufzeiten variieren je nach gewählter Auflösung, Qualitätseinstellung und Warteschlangenauslastung.

Worin unterscheidet sich Runway Gen-4.5 von Gen-4?

Gen-4 legte die Produktionsziele von Runway fest: einheitliche Charaktere, Bild-zu-Video-Steuerungsmodi (Bild→Video, Keyframing, Video→Video) und ein Fokus auf benutzerfreundliche Arbeitsabläufe. Gen-4.5 behält diese Grundlage bei, erweitert sie aber um Weltmodellierung (Physik, Bewegung) und prompte Einhaltung ohne Einbußen beim Durchsatz. In der Praxis ist Gen-4 nach wie vor hervorragend für schnelle, stilorientierte Aufgaben und kleinere Budgets geeignet; Gen-4.5 ist der richtige Upgrade-Pfad, wenn Sie realistischere Dynamik und eine feinere Steuerung benötigen.

Was hat sich technisch (auf hoher Ebene) geändert?

Runway Gen-4.5 wird als Weiterentwicklung und nicht als vollständige architektonische Neuentwicklung dargestellt. Laut Runway-Dokumentation profitiert das Modell von einer verbesserten Effizienz der Trainingsdaten vor dem Training sowie von optimierten Techniken nach dem Training (z. B. gezieltes Feintuning und temporale Regularisierung). Konkret bedeutet dies eine bessere Gewichts- und Bewegungsmodellierung, kohärentere Szenen mit mehreren Elementen und eine verbesserte Beibehaltung hochfrequenter Details (Haare, Stoffstruktur) über mehrere Frames hinweg.

Praktische Unterschiede, die Entwickler bemerken werden

- Besseres körperliches Verhalten: Objekte gehorchen der wahrgenommenen Masse und Flüssigkeiten verhalten sich plausibler.

- Weniger Identitätsbrüche: Charaktere und Objekte verändern ihr Aussehen während eines Clips seltener.

- Gleiche Geschwindigkeit, höhere Qualität: Runway gibt an, dass die Leistung (Latenz) mit Gen-4 vergleichbar ist, die Qualität jedoch steigt. Das macht Gen-4.5 attraktiv für Produktionsteams, die keine großen Rendering-Verzögerungen akzeptieren können.

Wann sollte man sich für die 4. Generation oder die 4.5. Generation entscheiden?

- Nutzen Sie Gen-4 wenn Sie einen kostengünstigeren, schnellen Machbarkeitsnachweis benötigen oder wenn bestehende Pipelines/Steuerungen bereits auf diesen Motor abgestimmt sind.

- Nutzen Sie Gen-4.5 Wenn Sie einen höheren Realismus, komplexe Interaktionen mehrerer Objekte oder Ergebnisse in Produktionsqualität benötigen, bei denen Bewegungsphysik und prompte Genauigkeit wichtig sind (z. B. Produktvisualisierungen, VFX-Vorvisualisierung, charaktergetriebene Kurzfilme).

Kompatibilität mit Gen-4-Bedienelementen. Alle von Runway unterstützten Bearbeitungsmodi (Bild→Video, Keyframes, Video→Video, Schauspielerreferenzen) werden in Gen-4.5 integriert, sodass Kreative vertraute Steuerelemente mit besseren Ergebnissen wiederverwenden können.

Wie schneidet Gen-4.5 im Vergleich zu Veo 3.1 und Sora 2 ab?

Wie schneidet es im Vergleich zu Googles Veo 3.1 ab?

Veo 3.1 ist Googles Familie für hochauflösende Text-zu-Video-Umwandlung (Veo 3 → 3.1 Updates). Das Modell wird für seine filmische Textur, die ausdrucksstarke Stilwiedergabe und die präzise Farb- und Lichtsteuerung gelobt. Unabhängige Vergleiche zeigen, dass Veo 3.1 bei stimmungsvollen und stilisierten Szenen hervorragend abschneidet und über Googles APIs weit verbreitet ist. Allerdings kann es im Vergleich zu den besten spezialisierten Konkurrenten bei der Berechnung von Physik mit mehreren Objekten und der zeitlichen Kohärenz über längere Zeiträume Schwierigkeiten haben. Erste Blindtests und Nutzerberichte deuten darauf hin, dass Runway Gen-4.5 bei bewegungsrealistischen und prompter Umsetzung von Physik-intensiven Aufgaben die Nase vorn hat, während Veo bei Tests mit stilisierten, malerischen oder filmischen Einzelszenen oft die Nase vorn hat.

Wohin Veo tendenziell führt: Audioqualität und Funktionen für strukturierte Erzählstrukturen (Flow/Veo Studio) sowie enge Integration in das Google-Ökosystem (Gemini API/Vertex AI).

Wohin Gen-4.5 tendenziell führtBlindtests zur Präferenz von Nutzern hinsichtlich visuellen Realismus, schneller Reaktionsfähigkeit und komplexem Bewegungsverhalten (gemäß den von Runway zitierten Video Arena-Rankings) ergaben, dass Gen-4.5 in mehreren öffentlichen Blindvergleichen einen knappen Vorsprung in der Elo-Wertung gegenüber Veo-Varianten aufweist, wobei die Differenz und ihre Aussagekraft je nach Inhaltstyp variieren.

Wie schneidet es im Vergleich zu OpenAIs Sora 2 ab?

Sora 2 (OpenAI) Sora 2 legt Wert auf physikalische Genauigkeit, synchronisierten Ton (einschließlich Dialoge und Soundeffekte) und Steuerbarkeit. Es eignet sich hervorragend für die Erstellung kohärenter animierter Szenen mit aussagekräftigen narrativen Hinweisen und für Arbeitsabläufe, in denen Ton und Dialoge wichtige Bestandteile der Generierungspipeline sind.

Wohin Sora 2 tendenziell führt: Integrierte Audioerzeugung und multimodale Synchronisierung in bestimmten Umgebungen; erzeugt tendenziell sehr atmosphärische, erzählerisch orientierte Clips.

Wohin Gen-4.5 tendenziell führtLaut den von Runway zitierten unabhängigen Blindtests zeichnen sich die Geräte durch wahrgenommenen visuellen Realismus, präzise Reaktionszeiten und konsistente Bewegungsabläufe aus. Die praktische Wahl hängt jedoch von Ihren Prioritäten ab: Sind native Audiowiedergabe und integrierte Tools entscheidend, sind Sora 2 oder Veo möglicherweise die bessere Wahl; steht hingegen die reine Bildqualität für komplexe Szenen im Vordergrund, ist der Vorteil der Gen-4.5-Technologie im Blindtest relevant.

Praktische Vergleichstabelle (Zusammenfassung)

| Gebiet | Landebahn Gen-4.5 | Start- und Landebahn Gen-4 (vorher) | Google Veo 3.1 | OpenAI Sora 2 |

|---|---|---|---|---|

| Veröffentlichung / Positionierung | Dezember 2025 – „Gen-4.5“: Qualitäts- und Wiedergabetreueverbesserung; Bestwert im Benchmark (1,247 Elo) | Frühere Gen-4: Ein wichtiger Schritt für Konsistenz und Kontrollierbarkeit | Veo 3.1: Googles Videogenerator; native Audio- und schnelle/schnelle Qualitätsoptionen | Sora 2: OpenAIs Flaggschiff-Modell für Video und Audio; legt Wert auf physikalische Genauigkeit und synchronisiertes Audio |

| Kernstärken | Bewegungsqualität, präzise Wiedergabetreue, kinoreife Bildqualität, API-Integration | Charakterkontinuität, Konsistenz über mehrere Einstellungen hinweg, Kontrollierbarkeit | Schnelle 8-Sekunden-Ausgabe, native Audio-/Dialoggenerierung, optimiert für Geschwindigkeit/Benutzerfreundlichkeit | Physik & Realismus, synchronisierter Ton/Dialoge, Steuerbarkeit |

| Ausgabelänge / Formate | Kurze, filmische Clips; unterstützt Bild→Video, Text→Video, Keyframes usw. | Kurze Clips; ähnliche Steuermodi | Hochwertige 8-Sekunden-Videos, Veo 3.1 Fast-Option | 720p/1080p-Ausgänge mit Audio, Schwerpunkt auf Wiedergabetreue |

| Natives Audio | Nicht die Hauptaussage (Fokus liegt auf visueller Wiedergabetreue), aber Runway unterstützt Audio-Workflows über entsprechende Tools. | Begrenzte native Audioerzeugung | Native Audiogenerierung (Soundeffekte, Dialoge). Fokus auf Audioqualität. | Synchronisierte Audio- und Soundeffekte sind explizite Merkmale. |

| Typische Einschränkungen | Artefakte im Detail (Gesichter/Menschenmengen), gelegentliche Kausalitäts-/Zeitfehler | Frühere Artefakte, mehr Inkonsistenz als bei 4.5 in den Bewegungen | Kurze Laufzeit ist ein gestalterischer Kompromiss; Qualität versus Länge | Enge Ausfallmodi in komplexen Szenen; noch in der Entwicklung |

- Visueller Realismus & Bewegung: Gen-4.5 > Veo 3.1 ≈ Sora 2 (variiert je nach Szene).

- Audio & nativer Sound: Veo 3.1 ≥ Sora 2 > Runway (Runway verfügt über Workflow-Audio-Tools, aber Veo & Sora integrieren eine tiefergehende native Audiogenerierung in die Produktentwicklung).

- Steuerung & BearbeitungRunway (Keyframes, Bild→Video, Referenzkontinuität) und Veo (Flow Studio) bieten beide eine starke Kontrolle; Sora konzentriert sich auf synchronisierte multimodale Steuerelemente.

- Kurz gesagt: Sora 2 punktet mit narrativer Kontinuität; Veo 3.1 mit filmischer Textur; Gen-4.5 mit Bewegungsrealismus und Kontrollierbarkeit.

Welche konkreten Einschränkungen und Risiken bestehen bei Gen-4.5 weiterhin?

Kein Modell ist perfekt, und Gen-4.5 hat bekannte Einschränkungen und Risiken in der Praxis, die vor der Einführung berücksichtigt werden müssen.

Technische Einschränkungen

- Physikalische Grenzfälle und kausale Fehler: Das Modell hat sich zwar deutlich verbessert, erzeugt aber bei sehr komplexen Szenen immer noch gelegentlich Fehlinterpretationen der Kausalkette (beispielsweise tritt eine Wirkung vor ihrer Ursache auf) und subtile Fehler in der Objektpermanenz. Diese treten zwar seltener auf, sind aber weiterhin vorhanden.

- Kohärenz im Langformat: Wie die meisten aktuellen Text-zu-Video-Modelle ist auch Gen-4.5 für kurze Clips (Sekundenlänge) optimiert. Die Erstellung längerer Szenen oder ganzer Sequenzen erfordert weiterhin das Zusammenfügen der einzelnen Clips, redaktionelle Eingriffe oder hybride Arbeitsabläufe.

- Identität und Konsistenz im großen Maßstab: Die Produktion von Hunderten von Einstellungen mit exakt demselben Charakterverhalten bleibt workflowintensiv; Gen-4.5 hilft dabei, ersetzt aber weder Referenzdesignsysteme noch zentralisierte Asset-Pipelines.

Sicherheits-, Missbrauchs- und ethische Risiken

- Deepfake-/Identitätsdiebstahlrisiko: Hochwertige Videogeneratoren erhöhen das Risiko realistischer, aber irreführender Medien. Organisationen sollten daher Schutzmaßnahmen (Wasserzeichen, Inhaltsrichtlinien, Identitätsprüfung) implementieren und das Missbrauchsrisiko überwachen.

- Urheberrecht und Herkunft der Datensätze: Die Herkunft von Trainingsdaten bleibt ein branchenweites Anliegen. Urheber und Rechteinhaber sollten sich bewusst sein, dass die Ergebnisse gelernte Muster aus urheberrechtlich geschütztem Material widerspiegeln können, was rechtliche und ethische Fragen hinsichtlich der Wiederverwendung im kommerziellen Kontext aufwirft.

- Voreingenommenheit und Repräsentationsschäden: Generative Modelle können Verzerrungen aus den Trainingsdaten reproduzieren (z. B. Über-/Unterrepräsentation, stereotype Darstellungen). Strenge Tests und Strategien zur Risikominderung während der Entwicklungspipeline sind weiterhin notwendig.

Fazit – Wo Gen-4.5 in der sich entwickelnden KI-Videolandschaft ihren Platz findet

Runway Gen-4.5 stellt einen bedeutenden Fortschritt in puncto Realismus und Steuerbarkeit der Text-zu-Video-Umwandlung dar. Es belegt derzeit Spitzenplätze in unabhängigen Blindtests und positioniert sich dank der Produktkommunikation und ersten Berichten als praktisches Upgrade für Kreative, die überzeugendere Bewegungen, eine höhere Wiedergabetreue und eine verbesserte zeitliche Kohärenz benötigen, ohne dabei Kompromisse bei der Generierungsgeschwindigkeit einzugehen. Gleichzeitig treiben konkurrierende Systeme von Google (Veo 3.1) und OpenAI (Sora 2) ihre komplementären Stärken weiter voran, wie z. B. integriertes Audio, vorgefertigte Story-/Narrativ-Tools und eine tiefere Integration in das jeweilige Ökosystem. Die Wahl der richtigen Plattform hängt weiterhin vom jeweiligen Projekt ab: Welche Priorität haben visuelle Realitätsnähe, natives Audio, Plattformintegration oder Kontrollmöglichkeiten?

Gen-4.5 wird in verschiedenen Tarifen mit vergleichbarer Preisgestaltung wie Gen-4 eingeführt.

Entwickler können zugreifen Veo 3.1 , Sora 2 kombiniert mit einem nachhaltigen Materialprofil. Runway/gen4_aleph usw. über CometAPI, die neuste Modellversion wird immer mit der offiziellen Website aktualisiert. Erkunden Sie zunächst die Fähigkeiten des Modells in der Spielplatz und konsultieren Sie die API-Leitfaden Für detaillierte Anweisungen. Stellen Sie vor dem Zugriff sicher, dass Sie sich bei CometAPI angemeldet und den API-Schlüssel erhalten haben. CometAPI bieten einen Preis weit unter dem offiziellen Preis an, um Ihnen bei der Integration zu helfen.

Bereit loszulegen? → Kostenlose Testversion von Gen 4.5 !

Wenn Sie weitere Tipps, Anleitungen und Neuigkeiten zu KI erfahren möchten, folgen Sie uns auf VK, X kombiniert mit einem nachhaltigen Materialprofil. Discord!